今天这条 AI 新闻,乍一看并不性感。

没有新模型发布,没有跑分截图,也没有“秒杀全场”的演示视频。新闻的主角,是 Anthropic 近期围绕数据中心、云服务和算力资源的一系列动作:有媒体报道它与 SpaceX 相关数据中心资源达成合作,也有报道提到它与 Akamai 签下云基础设施大单。

如果只把它理解成“又一家 AI 公司在买服务器”,那就看浅了。

更准确地说,AI 行业正在从上半场的“模型竞赛”,进入下半场的“交付竞赛”。上半场比的是谁的模型更聪明;下半场比的是谁能把这种聪明,持续、稳定、便宜地送到每一个用户和每一家公司手里。

这背后的门槛,不在发布会上,而在机房、芯片、电力、网络、调度系统和现金流里。

先看今天的新闻:热闹的是模型,关键的是底座

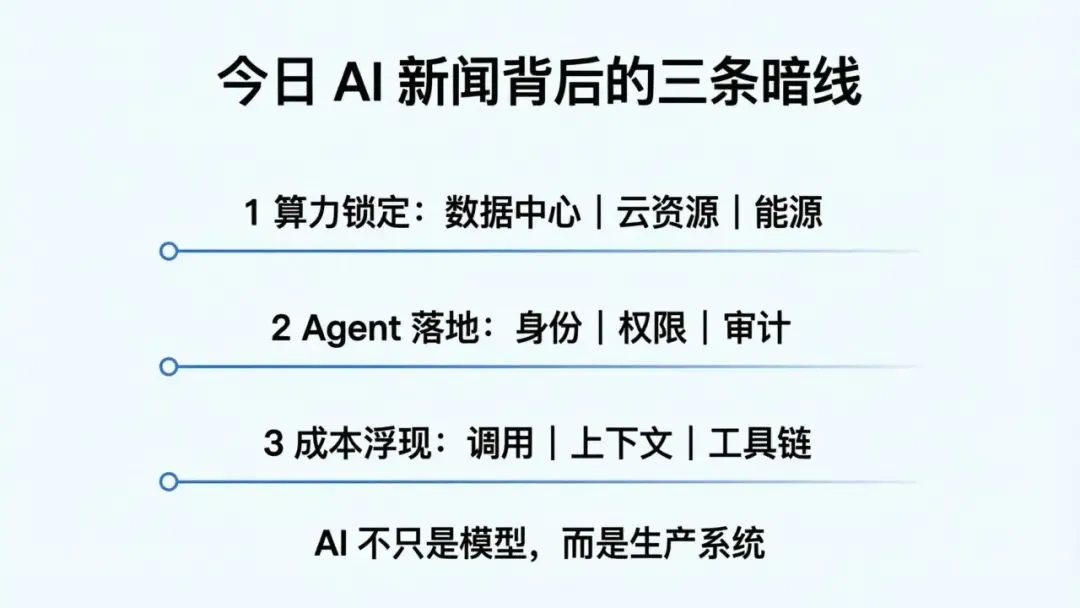

今天的 AI 新闻里,有几条线索值得放在一起看:

- • Anthropic 被报道继续扩张数据中心和云资源,用来支撑 Claude、AI 编程和企业客户增长。

- • 企业 AI Agent 的身份、权限、审计正在成为新议题。也就是说,AI 不只是“能回答”,还要“能被管理”。

- • 云厂商开始为 AI 代理提供更完整的执行环境,从聊天框走向桌面、浏览器、文件系统和业务系统。

- • 企业内部的 AI 工具越来越多,成本、权限和重复建设开始暴露出来。

这些新闻看似分散,其实指向同一件事:AI 不再只是一个模型能力问题,而是一个生产系统问题。

模型是这套系统里最醒目的部分,但不是全部。真正决定体验的,是模型后面的供应链:有没有足够的 GPU,电力是否稳定,推理成本能不能降下来,高峰期会不会排队,企业数据能不能安全接入,Agent 出错以后能不能追责。

这就是为什么 Anthropic 的算力动作值得写。

它不是一个孤立新闻,而是 AI 公司集体进入“重资产阶段”的缩影。

为什么算力会变成护城河?

过去互联网公司做产品,最大的成本往往是研发、流量和渠道。到了大模型时代,成本结构发生了变化:每一次回答、每一次代码修改、每一次多模态生成,背后都要消耗推理算力。

如果只是聊天,消耗还可控。真正麻烦的是下一代应用:AI 编程、企业 Agent、自动客服、销售助手、研究助手、数据分析助手。

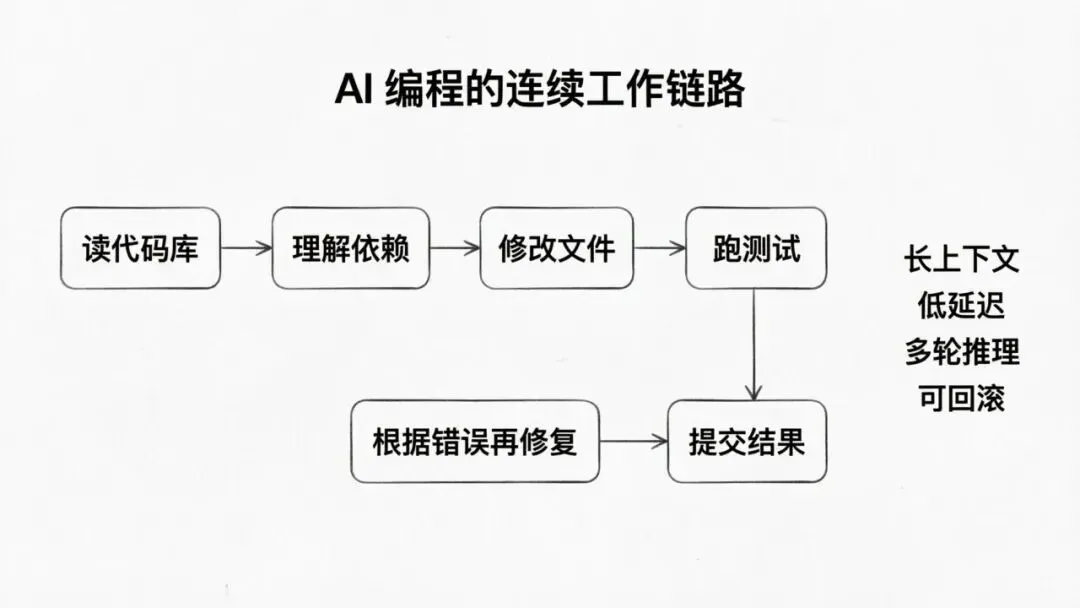

这些场景不是“一问一答”,而是连续工作。

一个 AI 编程助手要读代码库、理解依赖、改文件、跑测试、根据错误再改;一个企业 Agent 要查 CRM、读合同、调用内部接口、生成报告、等待审批;一个客服 Agent 要理解用户历史、查询订单、判断政策、必要时转人工。

AI 越像员工,消耗就越不像搜索框。

这也是为什么头部 AI 公司会不惜代价锁定数据中心、云资源和能源合作。因为当用户规模和任务复杂度上来以后,算力不只是成本项,还是产品能力本身。

同样一个模型,如果你算力充足,就可以给用户更长上下文、更快响应、更高并发、更稳定的服务;如果算力紧张,就只能限流、排队、降级,甚至把高级功能藏在更贵的套餐里。

用户感受到的“好不好用”,最后会落到这些细节上。

Anthropic 抢的不是服务器,是时间窗口

很多人会问:云厂商那么多,按需买不就行了吗?为什么还要签大单、找数据中心、提前锁资源?

原因很简单:AI 的需求增长不是线性的。

一旦某个产品形态跑通,例如 AI 编程助手进入企业研发流程,调用量会迅速放大。一个用户每天问十个问题,和一个 Agent 每天跑几百个步骤,完全不是一个量级。

对 AI 公司来说,最怕的不是模型不够聪明,而是产品刚被市场接受,底层资源却跟不上。

这会带来三个后果:

第一,服务变慢。用户开始抱怨“以前很好用,现在经常卡”。

第二,成本失控。增长越快,亏得越多,价格体系被迫调整。

第三,企业客户犹豫。个人用户可以忍一忍,企业不会把关键流程交给一个随时可能限流的系统。

所以,Anthropic 这类公司提前锁定算力,本质上是在买一个时间窗口:在需求爆发前,把基础设施铺好;在竞争对手还在排队等资源时,先把企业客户和开发者生态吃下来。

这个逻辑和当年云计算、短视频、外卖平台都有相似之处。表面是软件竞争,背后是基础设施竞争。谁先把规模、成本和体验跑成闭环,谁就更容易进入正循环。

AI 编程为什么是关键战场?

这次新闻里,我最关注的不是“某个数据中心是谁的”,而是它指向的应用方向:AI 编程。

AI 编程是目前最容易从“演示”走向“付费”的场景之一。原因很现实:程序员时间贵,代码交付有明确价值,企业也愿意为效率提升付钱。

但 AI 编程同样是最吃算力的场景之一。

它需要长上下文,因为真实项目不是一个函数,而是一堆文件、依赖、历史约定和隐含规则。它需要低延迟,因为开发者在等待结果时,注意力会被打断。它需要多轮推理,因为第一次修改通常不够,需要跑测试、看错误、再修复。

这类任务会把模型从“回答者”推向“执行者”。一旦进入执行者角色,系统就不只要会说,还要会做、会检查、会回滚、会解释。

这就是为什么 AI 编程会成为算力军备竞赛的前沿阵地。谁能把这里做好,谁就更容易把能力迁移到法务、财务、运营、客服、投研等更多岗位。

换句话说,AI 编程不是一个垂直功能,而是一块试验田。它在测试 AI 公司能不能把模型变成真正的数字劳动力。

但算力不是万能药

当然,算力多不等于一定赢。

这也是这件事最容易被误读的地方。很多文章会把故事写成“谁有 GPU 谁赢”,但现实没这么简单。

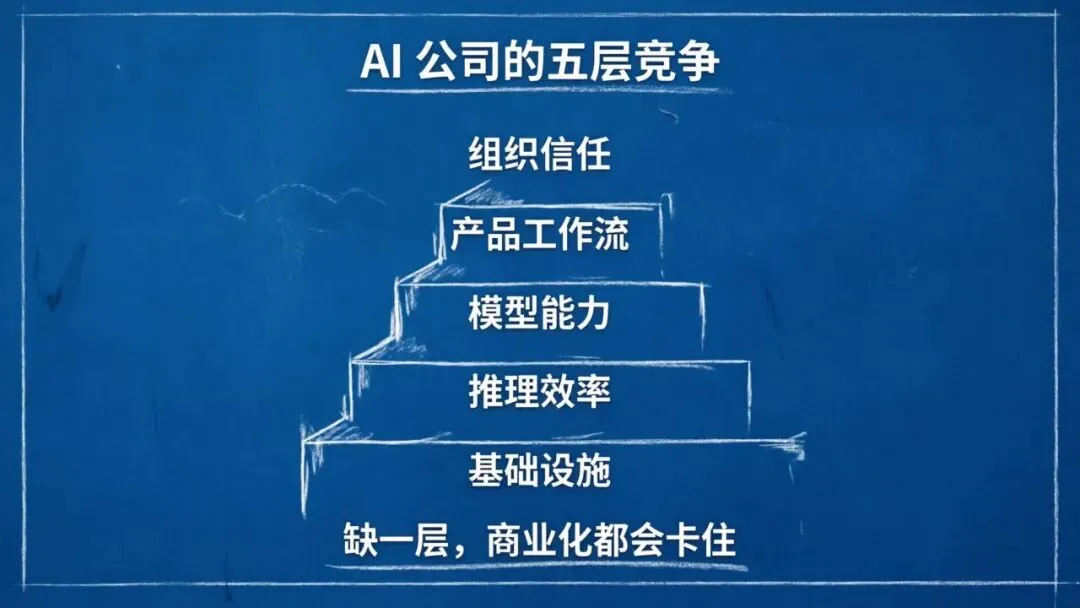

算力只是入场券。真正的竞争至少有五层:

- 1. 模型能力:推理、代码、多模态、长上下文是不是足够强。

- 2. 推理效率:同样能力下,单位成本能不能降下来。

- 3. 基础设施:算力、电力、网络、调度、稳定性是否可靠。

- 4. 产品工作流:能不能接入真实业务,而不是停留在聊天框。

- 5. 组织信任:权限、审计、安全、合规和责任边界是否清楚。

缺任何一层,都可能卡住商业化。

模型强但太贵,用户用不起;算力多但产品不顺,客户不买单;Agent 很能干但权限混乱,企业不敢上;成本压下来了但质量不稳定,用户又会流失。

所以,Anthropic 继续扩基础设施,说明它意识到 AI 公司的胜负不只在实验室,也在运营系统里。

对普通人和团队,真正的提醒是什么?

这条新闻对普通用户有什么关系?关系其实很直接。

第一,选 AI 工具时,不要只看模型名。

未来好用的 AI 工具,一定不是只靠一个漂亮聊天框。它要能读文件、进系统、跑流程、留下记录、被团队管理。你要看的不是“它回答得多漂亮”,而是它能不能稳定完成任务。

第二,团队上 AI,不要一开始就追求“大而全”。

更稳妥的办法是从一个高频、可衡量、可回滚的流程切入,比如代码审查、客服知识库、销售邮件、周报生成、资料整理。先把权限、日志、人工确认和成本统计做好,再逐步扩大范围。

第三,要尽早建立 AI 成本意识。

过去 SaaS 成本按账号算,未来 AI 成本会按任务复杂度、调用次数、上下文长度和工具链消耗一起算。一个团队里如果有多个 Agent 长时间跑任务,没有预算和审计,很容易从“提升效率”变成“隐形烧钱”。

这不是泼冷水,而是更接近真实世界的 AI 落地。

AI 的价值不是让人每天多试几个新工具,而是把某个流程稳定变短、变便宜、变可控。能做到这一点,才叫生产力。

结尾:AI 的下半场,会更像工业竞争

今天这条新闻没有发布新模型,却比很多模型新闻更重要。

因为它提醒我们:AI 已经过了只靠演示就能让人兴奋的阶段。接下来,真正的壁垒会越来越“笨重”:数据中心、电力、芯片、网络、成本、销售、合规、交付。

这听起来不浪漫,但这正是技术进入主流市场的标志。

当 AI 公司开始抢算力,它们抢的不是一堆机器,而是未来几年谁能稳定服务更多用户、更多企业、更多复杂任务的资格。

模型决定上限,算力决定供给,工作流决定价值,治理决定能不能长期使用。

这四件事合在一起,才是 AI 下半场真正的战场。

参考信息:Google News 今日聚合;Reuters 关于 Anthropic 与 SpaceX 数据中心合作的报道;The Economic Times 关于 Anthropic 与 Akamai 云服务合作的报道;VentureBeat 关于 AI Agent 身份治理的讨论;CX Today 关于企业支持系统与 AI Agents 的分析。公开信息仍在更新,文中涉及合作细节以媒体公开报道为准。

夜雨聆风

夜雨聆风