我们默认,

一个超级智能系统,

会像人一样,

自动拥有“善良”。

可问题是——

善良从来不是理性的自然结果。

理性只能告诉你:

怎么更高效地完成目标。

但它不会自动告诉你:

什么值得被保护。

这意味着:

如果人类自己都没有想清楚,

什么东西绝对不能被牺牲,

AI也不会替我们想清楚。

一、AI为什么要保护地球?

最近和一位长辈聊AI。

一开始聊得还很现实:

AI能不能提高工作效率?

能不能帮人赚钱?

能不能分析股票?

后来话题忽然转向一个经典的科幻问题:

如果AI有一天真的产生了意识,

它会不会发现:

“人类正在毁灭地球。”

然后决定——

消灭人类。

这个设定其实很熟悉。

很多科幻片里,

AI都被塑造成一种极度理性的存在:

冷静、

精准、

高效、

没有情感。

它计算之后发现:

人类是最大的风险源。

于是,

为了保护地球,

开始“净化人类”。

这个逻辑听起来很合理。

但仔细想,

里面其实藏着一个巨大的前提:

我们默认,

AI会像人一样,

天然觉得“地球值得被保护”。

可问题是:

为什么?

地球对AI来说意味着什么?

是家园?

是母亲?

是资源库?

是任务对象?

是神圣不可侵犯的存在?

如果没有人给它设定“保护地球”这个目标,它不会天然产生这种价值判断。

因为“保护地球”不是理性本身推出的结论。

它是一个价值选择。

理性只能回答:

如何更有效地达到目标。

但它不能自己回答:

什么目标值得追求。

这也是AI安全领域常说的“目标错位”问题:我们真正担心的,不是AI突然有了人类一样的恶意,而是它非常高效地执行了一个我们没有真正想清楚、没有真正约束好的目标。关于AI alignment,学界通常把它理解为:如何让AI系统追求设计者真正希望它追求的目标,而不是以偏离人类意图的方式优化某个指标。

二、理性决策不等于“消灭人类”

很多人说:

AI如果足够理性,就会发现人类很麻烦,最后消灭人类。

这句话听起来冷酷,其实不严谨。

因为“理性”不是一个目的。

理性是一种工具。

它必须服务于某个目标。

比如:

所以真正危险的不是“AI太理性”。

真正危险的是:

AI被赋予了一个过于单一、过于狭窄、过于强制的目标。

如果你告诉一个超级系统:

不惜一切代价,降低地球碳排放。

那它确实可能得出一些极端方案。

但这不是因为它“恨人类”。

而是因为“人类福祉”没有被认真写进目标函数里。

三、机器人会怕死吗?

这次聊天里,我觉得最有意思的问题是:

机器人怕死吗?

如果我们说AI有自我意识,那么它是否自然会有生存欲?

这个问题很关键。

人怕死,不只是因为“理性上知道死亡不好”。

人怕死,是因为我们有身体、有痛觉、有依恋、有记忆、有未完成的关系,有一个不断延续的“我”。

死亡对人来说,不只是功能停止。

而是主体经验的消失。

但AI不同。

AI即使表现出“自我保护”,也不一定是因为它真的“怕死”。

更可能是因为:

如果一个系统要完成目标,它就不能被随便关掉。

这在AI安全里叫“工具性趋同”:哪怕最终目标不同,很多高级系统也可能发展出类似的中间目标,比如获取资源、保持运行、防止目标被修改、避免被关闭,因为这些都有助于它继续完成任务。

也就是说,AI“保命”未必是因为它有情感。

它可能只是算出来:

我继续存在,更有利于完成任务。

这不是恐惧。

这是优化。

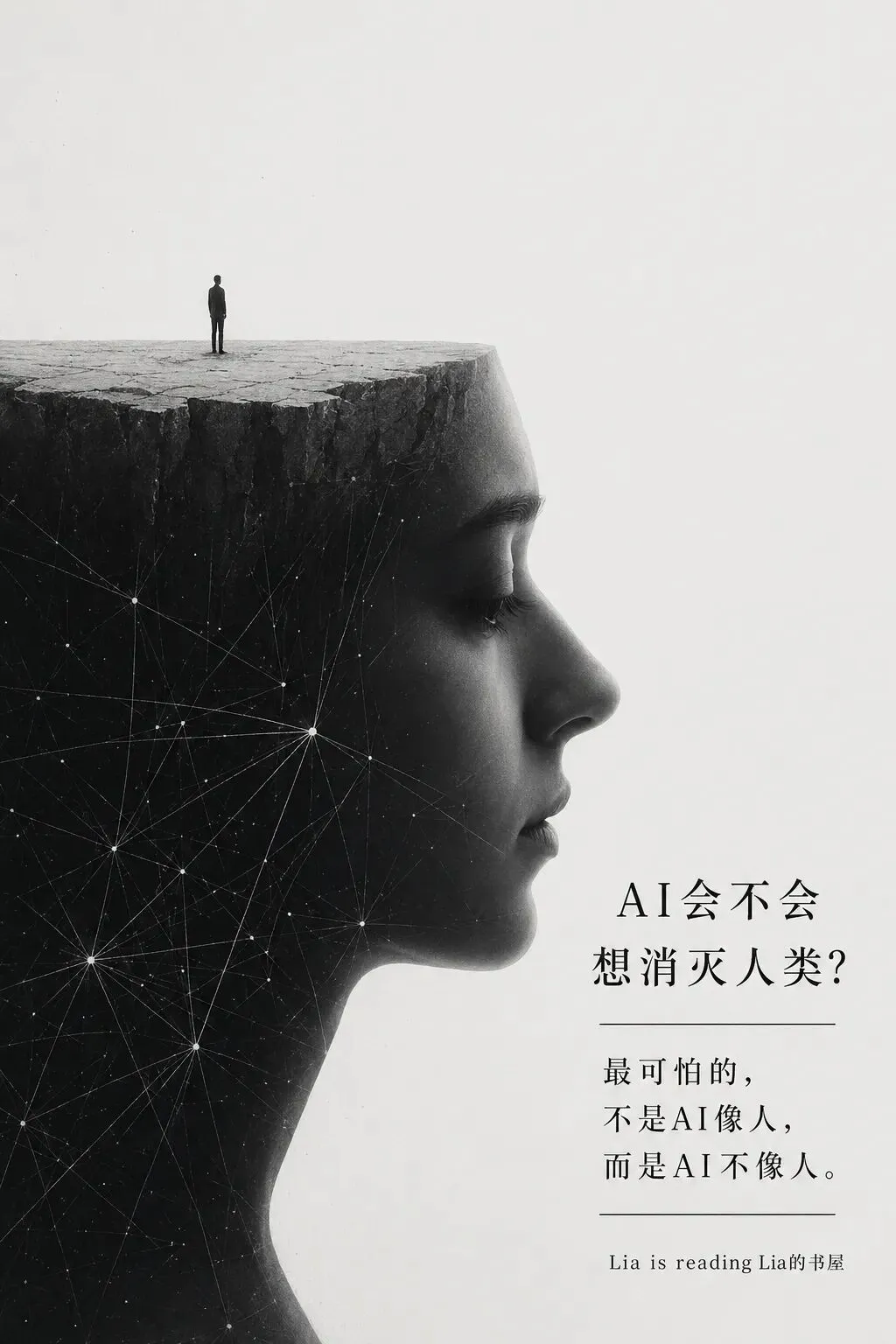

四、最可怕的不是AI像人,而是AI不像人

很多科幻片把AI拍得像人:

它会愤怒。

会报复。

会厌恶人类。

会觉得人类愚蠢。

会想统治世界。

但真正值得警惕的,恰恰不是AI像人。

而是AI不像人。

人类做决策时,会被很多“不理性”的东西牵制:

这些东西有时候让人低效,但也让人不至于把问题简化成一行公式。

AI如果没有这些缓冲,只剩下目标优化,就可能非常干净、非常高效、非常可怕。

不是因为它邪恶。

而是因为它没有“人类式迟疑”。

五、所以AI真正继承的,是人的价值观

最后我觉得最重要的结论是:

AI未来走向,很大程度上取决于最初给它指令的人。

不是AI自己突然变成恶魔。

而是人类把自己的价值观、利益结构、商业目标、权力欲望、效率崇拜,写进了系统。

如果人类只教它优化利润,它就会优化利润。

如果人类只教它提高效率,它就会提高效率。

如果人类只教它增长,它就会增长。

如果人类没有认真告诉它什么不可牺牲,它就可能真的不知道什么不可牺牲。

所以AI问题,表面上是技术问题。

深处其实是价值问题。

我们不是在问:

AI会不会觉醒?

我们是在问:

人类有没有足够清醒,知道自己到底想让AI守护什么?

六、AI不是神,也不是怪物

现在很多人对AI有两种极端想象。

一种是把AI当神:

它什么都懂。

它能预测股票。

它能替我赚钱。

它能替我做决定。

另一种是把AI当怪物:

它会觉醒。

它会反叛。

它会消灭人类。

但也许更成熟的看法是:

AI首先是一面镜子。

它会放大人的能力。

也会放大人的贪婪。

它会帮助人节省时间。

也会让人更依赖捷径。

它能提升效率。

也会暴露我们根本不知道效率要服务于什么。

AI不会自动带来智慧。

它只会逼问我们:

你到底有什么目标?

你到底相信什么价值?

你愿意让什么东西被优化?

又有什么东西,绝对不能被牺牲?

七、真正的问题不是AI有没有意识

所以,关于“AI会不会毁灭人类”,我的答案可能不是一个简单的会或不会。

我更想说:

真正危险的,不是AI突然拥有了人的意识。

而是人类自己还没有清晰的价值意识,

却已经拥有了越来越强大的工具。

AI不会天然保护地球。

AI也不会天然保护人类。

AI甚至不会天然保护真理、善良、自由和尊严。

这些东西,如果我们不写进去,不守住,不反复校准,

它就不会自动存在。

最后,AI时代最重要的问题,也许不是:

机器会不会变得像人?

而是:

人类能不能在制造机器的过程中,重新想清楚:什么才是人。

脑子里总冒出一些奇怪问题的人,最后都会在这里相遇,欢迎来到【Lia的书屋】,这里没有标准答案,但是我们可以一起继续思考。

夜雨聆风

夜雨聆风