💡 痛点导语

每个数据人都经历过这种"死亡循环"——每天早上打开5个系统,手动导出Excel,拼接清洗,算指标,做图表,再复制粘贴到PPT里发邮件。一套下来2小时没了,第二天又重来。更崩溃的是,中间某个数据源格式变了,整个流程全报错,排查半天才发现是日期格式从"2026/01/01"变成了"2026-01-01"。

数据Pipeline不是什么高深概念,它就是把你每天重复做的"取数→清洗→转换→分析→出报表"这5步串成一条自动化流水线。2026年的AI工具已经让这件事的门槛降到了"会拖拽就能搭"的程度。本文整合全网10篇爆款教程精华,5环全链路+3阶段实操+4大避坑铁律,帮你23分钟搭出一条从数据库到报表的自动流水线,彻底告别"报表搬砖"。

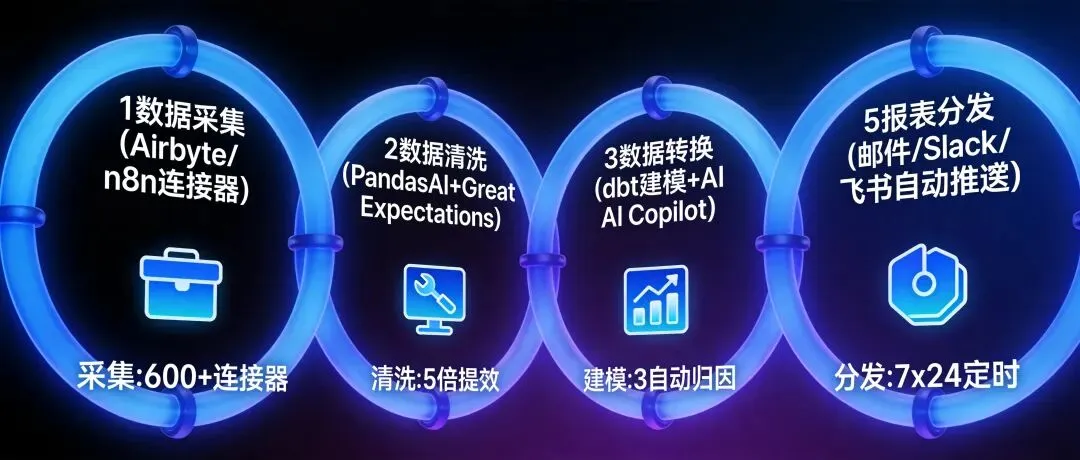

🛠️ 第一环:数据采集——600+连接器,3分钟接通任意数据源

数据采集是Pipeline的起点,也是90%的人卡住的地方。你以为需要写API对接代码?不,2026年的工具已经把这件事变成了"选连接器→填账号→点测试"。

推荐工具:Airbyte + n8n双引擎

| 工具 | 连接器数量 | 核心优势 | 适合谁 |

|------|-----------|---------|--------|

| Airbyte | 600+ | 开源免费,CDC实时同步,Docker一键部署 | 数据工程师、有安全要求的企业 |

| n8n | 400+ | 可视化拖拽,900+模板库,内置调度 | 非技术人员、快速搭建 |

实操3步(以n8n为例):

1. 打开n8n编辑器,点击"Add Node"→搜索"MySQL"→添加节点

2. 填写数据库连接信息(主机、端口、用户名、密码)→点"Test Connection"

3. 写查询SQL,启用"自动分页"处理大数据量

关键技巧:用只读账号连接生产数据库,千万别用root。Airbyte还支持CDC(变更数据捕获),只同步增删改的数据,不拉全量,源库压力降90%。

避坑指南:免费版Airbyte同步频率最低5分钟一次,需要秒级实时同步的场景(如风控)考虑Estuary或Kafka方案。

🛠️ 第二环:数据清洗——AI三件套,1小时顶1天

脏数据是Pipeline的"毒瘤"。缺失值、异常值、格式混乱——这些不处理干净,后面的分析全是垃圾。

2026年最实用的AI清洗三件套:

① PandasAI——自然语言清洗

不用写Pandas代码,用中文描述清洗需求就行:

```

对话示例:

"删除amount列为负数的记录"

"把日期格式统一为YYYY-MM-DD"

"用中位数填充age列的缺失值"

```

PandasAI自动生成并执行Pandas代码,还能解释每步做了什么。实测清洗10万行数据,从手动4小时缩短到45分钟,效率提升5倍。

② Great Expectations——自动质量校验

清洗完必须验证!Great Expectations像"数据质检员",自动检查:

- `expect_column_values_to_not_be_null`:关键字段不能有空值

- `expect_column_values_to_be_between`:数值范围校验(如年龄0-120)

- `expect_table_row_count_to_be_between`:行数波动检测

它还会自动生成数据质量报告,包含前后对比图表,审计可追溯。

③ Cleanlab——AI异常检测

用孤立森林和统计模型自动识别"隐藏的脏数据"——那些肉眼看不出但会影响分析的异常值,比如某用户一天下单200次、某商品单价是同类10倍。Cleanlab的异常检出率比人工高37%。

避坑指南:清洗过程必须可追溯!每次清洗记录"清洗了什么、为什么清洗、清洗前后对比",否则同事问"用户数为什么少了2000",你翻半天代码都找不到原因。

🛠️ 第三环:数据转换——dbt建模+AI Copilot,SQL优先的工程化转换

清洗完的原始数据还要经过转换才能用:多表关联、业务指标计算、维度建模。dbt就是做这件事的标准工具,而2026年的dbt Copilot让这件事的速度又快了3倍。

dbt三层建模架构:

1. Staging层(清洗层):原始数据标准化、列名规范化、类型转换

2. Intermediate层(逻辑层):多表JOIN、业务规则实现、中间计算

3. Marts层(集市层):面向业务方的最终宽表,直接喂给BI工具

AI Copilot能帮你做什么:

- 自动生成SQL模型:用自然语言描述"我要一个客户RFM分群模型",Copilot自动生成完整SQL

- 自动写测试:基于模型关系自动生成`not_null`、`unique`、`accepted_values`等测试

- 自动写文档:读取SQL逻辑+字段元数据,自动生成`schema.yml`文档

- 性能优化建议:建议哪些模型用`view`,哪些用`table`,哪些用`incremental`

实操命令:

初始化dbt项目

```

dbt init my_pipeline

运行模型及其依赖

dbt run --models +customer_segmentation

运行数据质量测试

dbt test --models customer_segmentation

生成文档站点

dbt docs generate

```

避坑指南:AI生成的模型必须先`dbt compile`验证语法,再`dbt test`验证逻辑,最后检查lineage graph确认上下游关系正确,三步缺一不可。AI是"初稿引擎",不是"自动合并引擎"。

🛠️ 第四环:智能分析——AI自动洞察,从数字到结论

数据转换完了,还得有人"看数据说结论"。2026年的AI已经能自动完成这一步:

n8n + AI Prompt自动分析模板:

```

基于以下月度销售数据,生成3点关键洞察和1个行动建议:

{{ $json.report_data }}

```

异常检测自动告警:

```javascript

// 检测销售额异常波动

const isAnomaly = (current, average, threshold = 0.3) => {

return Math.abs(current - average) / average > threshold;

};

if (isAnomaly($json.current_sales, $json.avg_sales)) {

return { ...$json, anomaly: true, alert: "销售额异常波动" };

}

```

实战案例:某电商用n8n的5模块Pipeline(采集→清洗→并行分析→输出→归档),每天早8点自动生成日报到Slack,发现销售额异常时自动触发归因分析,从"整体下降15%"下钻到"华东区新客转化率下降30%",比人工分析快6小时。

🛠️ 第五环:报表分发——7×24定时推送,异常自动告警

Pipeline搭好了,最后一步是让报表"自动找到人",而不是"人去找报表"。

n8n三种定时触发方式:

- 简单间隔:每小时/每天/每周

- 日历定时:每月最后一天23:59

- CRON表达式:`0 8 * * 1-5`(工作日早8点)

多渠道分发:

- Slack/飞书:推送摘要+关键图表

- 邮件:发送HTML格式详细报告+Excel附件

- Google Sheets:自动更新共享表格

- API回调:通知下游系统数据已就绪

异常告警机制:

- n8n的Error Trigger节点捕获执行失败

- 自动重试3次(间隔5分钟)

- 重试仍失败则Slack告警+邮件通知负责人

避坑指南:首次上线Pipeline一定要盯着看前3次执行的日志,确认数据量、执行耗时、输出结果都在预期范围内。别设完定时就撒手不管,第二天发现跑了空数据。

📝 可直接复制的Pipeline搭建指令词

【指令词1】数据采集配置

适用场景:n8n连接新数据源

> 你是一个数据工程师。我需要从[数据源类型,如MySQL/API/Google Sheets]采集数据,用于[业务场景]。

>

> 请帮我设计n8n采集节点配置方案:

> 1. 推荐使用哪个节点?配置步骤是什么?

> 2. 如何处理分页和增量同步?

> 3. 哪些参数必须用环境变量(不能硬编码)?

> 4. 常见连接失败的3个原因和解决方案

【指令词2】数据清洗规则生成

适用场景:拿到脏数据,需要制定清洗策略

> 以下是我的数据概况:

> - 数据量:[X万行]

> - 缺失情况:[描述哪些列缺失率高]

> - 异常情况:[描述已知异常]

> - 格式问题:[描述格式混乱的列]

>

> 请生成PandasAI可执行的清洗指令清单:

> 1. 每条指令用自然语言描述,标注优先级(P0/P1/P2)

> 2. 对缺失值给出填充策略建议(均值/中位数/删除)

> 3. 对异常值给出检测方法(3σ/IQR/孤立森林)

> 4. 生成Great Expectations校验规则

【指令词3】dbt模型设计

适用场景:从业务需求到dbt分层模型

> 业务需求:[描述分析需求,如"按区域/产品线/客户分群查看月度销售趋势"]

>

> 数据库表结构:[粘贴DDL]

>

> 请帮我设计dbt模型架构:

> 1. Staging层:需要哪些stg_模型?每个模型的清洗逻辑是什么?

> 2. Intermediate层:需要哪些int_模型?多表如何关联?

> 3. Marts层:最终输出哪些fct_和dim_模型?

> 4. 每个模型推荐什么物化策略(view/table/incremental)?

> 5. 自动生成schema.yml文档和测试配置

【指令词4】n8n工作流编排

适用场景:把采集→清洗→转换→分发串成自动化流水线

> 我需要搭建一条自动化数据Pipeline,需求如下:

> - 数据源:[MySQL/Google Sheets/API]

> - 清洗逻辑:[描述清洗规则]

> - 输出格式:[Excel/Slack摘要/邮件报告]

> - 执行频率:[每天/每周/每小时]

>

> 请帮我设计n8n工作流:

> 1. 需要哪些节点?节点之间的数据流向是怎样的?

> 2. 每个节点的关键配置参数

> 3. 错误处理方案:重试策略+告警机制

> 4. 首次上线的检查清单(3项必查)

💬 实操小贴士

从最小闭环开始:先搭"1个数据源→1条清洗规则→1个输出"的最简Pipeline,跑通后再逐步扩展,别一上来就想全链路自动化

Airbyte负责"搬数据",dbt负责"造数据",n8n负责"串流程"——三者分工明确,别用一个工具干所有事

数据清洗耗时占Pipeline总耗时60%,优先优化清洗环节:能用规则引擎解决的不用AI,能用AI解决的不写Python脚本

dbt模型的命名规范是你的"隐形文档":`stg_`清洗、`int_`逻辑、`fct_`事实、`dim_`维度,AI Copilot和团队成员都能秒懂

每条Pipeline必须有"健康检查":行数波动超30%告警、关键字段空值率超5%告警、执行耗时翻倍告警

⚠️ 避坑铁律:Pipeline搭建的4大陷阱

坑1:全量拉取导致源库崩溃

- 错误案例:每小时SELECT * FROM大表,源库CPU飙升到95%

- 解决:开启CDC增量同步,只拉变更数据。Airbyte原生支持MySQL/PostgreSQL的CDC

坑2:清洗逻辑没有测试直接上线

- 错误案例:清洗脚本误删了2万条正常订单,报表数据连续3天不准

- 解决:用Great Expectations做清洗前后校验,dbt自动跑测试,先在测试环境验证再推生产

坑3:Pipeline报错没人知道

- 错误案例:数据源API升级导致连接失败,但3天后才有人发现报表没更新

- 解决:n8n Error Trigger + Slack告警 + 自动重试3次,失败后5分钟内通知负责人

坑4:一个人搭的Pipeline只有那个人能维护

- 错误案例:搭建者离职,没人看得懂那些Python脚本和Cron配置

- 解决:用n8n可视化编排替代Python脚本,用dbt替代手写SQL,所有逻辑可读可追溯

🌟 关注星网AI

从手动导Excel到全自动Pipeline,差的不是技术能力,而是"用工具替代重复劳动"的思维。23分钟搭一条Pipeline,每天省2小时,一个月省40小时——这才是AI提效的正确打开方式。关注星网AI,下期教你用AI做数据异常归因分析,让机器帮你找出"数据为什么变了",别错过~

夜雨聆风

夜雨聆风