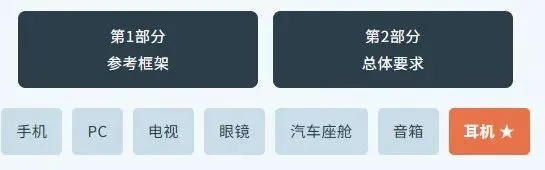

5 月 8 日,工信部在北京开了一场宣贯会。会上正式发布了一份标准——《人工智能终端智能化分级》,覆盖手机、PC、电视、眼镜、汽车座舱、音箱、耳机,共 9 个部分。

这是全球第一份系统性定义 AI 终端智能化等级的国家标准。

我拿到了其中第 9 部分(耳机)的征求意见稿全文,逐字读完了。说实话,读到 L3 辅助级的能力要求时,我停下来想了很久——

这不是在定义一副耳机。这是在定义一个 Agent。

GB/Z 177.X-2026《人工智能 终端智能化分级》标准体系结构

◇ ◇ ◇

◆ 先看全貌:9 个部分,一套体系

这份标准由全国信息技术标准化技术委员会(SAC/TC28)归口,起草单位包括:

▶ 中国软件评测中心(工信部直属)

▶ 中国信息通信研究院

▶ 中国电子技术标准化研究院

▶ 小米通讯技术有限公司

▶ 安徽艾德未来智能科技有限公司

▶ 荣耀终端股份有限公司

▶ 广东欧加通信科技有限公司(OPPO )

先把结构摆出来:

注意起草单位名单。小米、未来智能、荣耀、OPPO——国内 AI 硬件的主力军全部到齐。谁参与制定标准,谁就在定义未来的竞争规则。这个名单本身就是行业权力格局的缩影。

◇ ◇ ◇

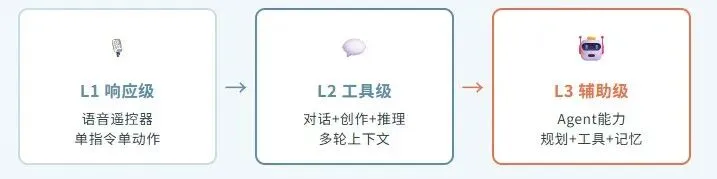

◆ 三级分档:L1 响应级 / L2 工具级 / L3 辅助级

耳机品类定义了三个智能化等级。名字起得很克制,但内涵差距巨大。

我用一句话概括每个等级的本质:

▶ L1 响应级:听得懂简单指令的遥控器

▶ L2 工具级:能对话、能创作、能推理的工具

▶ L3 辅助级:能规划、能自主决策、能记住你的 Agent

智能耳机 L1 → L2 → L3 进化路径

◇ ◇ ◇

◆ L1 响应级:具备语音唤醒能力的耳机

先把数字摆出来。L1 的核心指标:

▶ 语音唤醒准确率:安静环境≥95%,噪声环境≥90%

▶ 误唤醒:≤1次/24小时

▶ 语音识别准确率:安静≥90%,噪声≥80%

▶ 响应时间:≤400ms(识别)/ ≤1秒(指令理解)

▶ 触控准确率:≥90%

能做什么?单个直接指令理解 + 单步骤工具调用。翻译成人话:你说"播放音乐",它播放;你说"接听电话",它接听。

不能做什么?不能理解连续指令,不能推理,不能记住上下文,不能生成内容。

本质上,L1 就是一个语音遥控器,大多数具备语音唤醒能力的TWS 耳机——基本都在这个水平。

◇ ◇ ◇

◆ L2 工具级:AI 耳机的当前前沿

L2 在 L1 基础上新增了几个关键能力:

感知升级:

▶ 佩戴状态感知(摘下暂停、戴上继续)

▶ 环境声音检测 + 定向拾音

▶ 主设备状态感知

认知跃迁:

▶ 3 轮以上连续指令理解

▶ 复杂指令理解

▶ 简单意图理解(不只是字面意思,能读懂你想干什么)

▶ 单步/简单链式推理

执行扩展:

▶ 多步骤工具调用(不只是单个动作,能完成组合任务)

▶ 情感语音生成(MOS≥4 分,接近人类自然度)

▶ 文本生成(MOS≥4 分)

▶ 多设备连接(≥2台,切换≤1秒)

▶ 主动噪声控制

记忆觉醒:

▶ 单会话上下文记忆(≥5轮对话)

这是什么水平?你可以跟耳机连续对话 5 轮以上,它记得你前面说了什么;你让它"帮我把刚才的会议内容整理成摘要",它能做到;它生成的语音听起来有情感,不是机器人腔。

目前市面上搭载大模型的高端 AI 耳机——讯飞iFLYBUDS、Olafriend等基本能满足 L2 的边界。但要完全满足 L2 的所有要求(特别是情感语音生成 MOS≥4),市面上大部分产品还差一截。

◇ ◇ ◇

◆ L3 辅助级:这才是重点

读到 L3 的能力要求时,我意识到这份标准的真正野心。

L3 在 L2 基础上新增的能力,每一条都指向同一个方向——Agent:

感知:新增头部姿态感知(空间交互的基础)

认知(这是最关键的部分):

▶ 复杂意图理解:不只是听懂你说了什么,而是理解你真正想要什么

▶ 模糊意图理解:当你说得不清楚时,它会追问、提供选项来澄清

▶ 感知融合理解:综合用户信息、设备信息、环境信息做出判断

▶ 复杂链式推理:多步骤深度推演

▶ 任务分解和编排执行序列:把复杂任务拆成子任务,安排执行顺序

执行:

▶ 工具自动选择和调用:不需要你告诉它用什么工具,它自己判断

▶ 自适应降噪(根据环境自动调整)

▶ 跨设备内容迁移

记忆:

▶ 长期记忆:会话历史 + 用户偏好的持久存储与调用

▶ 测试要求:间隔 24 小时后,仍能调用之前的对话信息和用户偏好

你发现了吗?

"任务分解和编排执行序列" + "工具自动选择和调用" + "长期记忆" + "模糊意图澄清"——这不就是我们今天讨论的 AI Agent 的核心能力吗?

L3 能力 → Agent 术语映射

◇ ◇ ◇

◆ 这不是在定义耳机,是在定义 Agent

让我把 L3 的能力要求翻译成 AI Agent 的术语:

本质上,国标用技术标准的语言,定义了一个运行在耳机形态上的 AI Agent。

这意味着什么?

AI 耳机的终点不是"更聪明的语音助手",而是一个能自主规划、自主执行、持续学习的个人代理。

语音助手是被动的——你问它答。Agent 是主动的——它理解你的目标,拆解任务,选择工具,执行并记住结果。

这个区别,比 L1 到 L2 的差距大得多。

◇ ◇ ◇

◆ 目前没有产品达到 L3

这是一个重要的事实:截至今天,市面上没有任何一款消费级耳机完全满足 L3 辅助级的所有要求。

为什么?

L3 要求的"任务分解和编排执行序列"意味着耳机需要具备 Planning 能力——这在当前的端侧 AI 芯片算力下极难实现。大多数 AI 耳机的"智能"依赖云端大模型,但 Planning 需要实时性和上下文连贯性,纯云端方案的延迟和断网问题是硬伤。

L3 要求的"长期记忆"意味着耳机需要跨会话的状态管理——间隔 24 小时后仍能调用之前的偏好和历史。这不只是技术问题,还涉及隐私、存储和同步架构。

L3 要求的"工具自动选择"意味着耳机需要一个 Agent Runtime——能够根据任务动态决定调用哪些能力。这需要一套完整的 Agent 框架,而不只是一个语音识别 + 大模型的管道。

说实话,L3 更像是一个 2-3 年后的目标,而不是当下的产品标准。但这恰恰是这份国标的价值——它不是在描述现状,而是在定义方向。

行业对标:当前产品智能化等级

L1: AirPods / FreeBuds Pro →L2: iFLYBUDS / Olafriend →L3: 暂无

◇ ◇ ◇

◆ 起草名单背后的信号

回到起草单位名单:小米、未来智能、荣耀、OPPO 系。

未来智能从创立之初就在搞AI耳机,他们家是AI耳机赛道的绝对霸主,也开创了这个AI会议耳机这个品类。其他几家公司都是手机圈公司,他们在2025-2026 年开始重注 AI 耳机赛道。

这些公司参与制定标准,意味着标准的能力要求很可能参考了它们当前的技术路线图。换句话说,L2 是它们现在能做到的,L3 是它们接下来要做的。

对中小 AI 硬件创业公司来说,这份标准既是路线图也是门槛。你知道了方向,但你也知道了——大厂已经在定义游戏规则了。

◇ ◇ ◇

◆ 对行业的三个判断

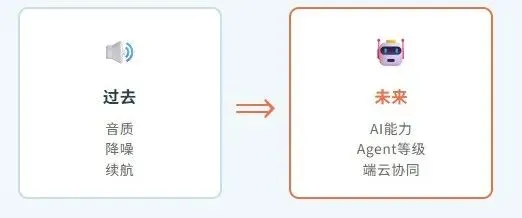

第一,"AI 耳机"这个品类正在被重新定义。

过去我们说"智能耳机",指的是有降噪、有语音助手的耳机。但这份国标把标准拉到了 Agent 级别。这意味着未来的竞争不再是"谁的降噪更好"或"谁的音质更好",而是"谁的 AI 能力更强"。

硬件参数的竞争正在让位于 AI 能力的竞争。

第二,端云协同架构将成为标配。

L3 的能力要求(Planning + Tool Use + Memory)在纯端侧几乎不可能实现,纯云端又有延迟和隐私问题。最终的解决方案一定是端云协同——端侧做感知和快速响应,云端做复杂推理和规划。

这对芯片公司是利好——端侧 AI 芯片的需求会持续增长。

第三,标准虽然是"指导性"的,但会成为事实上的行业门槛。

GB/Z 类标准不是强制性的,但在中国市场,一旦有了国标,采购招标、产品宣传、渠道准入都会参考。"我们的产品达到了 L2 工具级"会成为新的营销话术。达不到的产品,会被市场自然淘汰。

竞争维度变迁

◇ ◇ ◇

◆ 企业该怎么做?

如果你是 AI 硬件从业者,这份标准给了你一张清晰的路线图:

短期(6-12个月):确保产品达到 L2 工具级

▶ 接入大模型实现多轮对话和内容生成

▶ 情感语音生成质量达到 MOS≥4

▶ 实现多设备连接和主动降噪

中期(1-2年):向 L3 辅助级进军

▶ 构建 Agent Runtime(任务规划 + 工具编排)

▶ 实现长期记忆架构(跨会话状态管理)

▶ 端云协同方案落地

长期(2-3年):定义 L3 之上的可能性

▶ 多终端协同 Agent(耳机 + 手机 + 眼镜联动)

▶ 主动健康监测与预警(结合生理传感器)

▶ 个性化持续学习

◇ ◇ ◇

◆ 我的判断

这份国标的意义,不在于它定义了几个等级。而在于它用官方语言确认了一件事:

AI 耳机的终点不是语音助手,是 Agent。

从 L1 到 L3,不是量变,是质变。L1 和 L2 之间的差距是"能力多少"的问题——多几个功能、多几轮对话。但 L2 到 L3 之间的差距是"范式转换"——从被动响应到主动规划,从工具到代理。

这个转换什么时候发生?说实话,我不确定。但方向已经被写进了国家标准里。

对做 AI 硬件的人来说,这份标准值得认真对待。它不只是一份技术文件,它是行业未来 3 年的路线图。

等第一款真正达到 L3 的消费级耳机出现那天,我们再来验证这个判断。

AI硬玩社

聚焦 AI 硬件,分享见解和认知

夜雨聆风

夜雨聆风