你是否经常使用Word编辑器里的AI写作建议?这些由大型语言模型驱动的AI写作助手,正变得越来越普及。它们在你打字时,自动预测并补全你的句子,帮你更快地完成邮件、报告或社交媒体帖子。但你想过吗?这个看似中立的“帮手”,可能正在无形中塑造你的观点。一项2026年的科学研究揭示了一个令人警惕的现象:有偏见的AI写作助手,会使用户对社会议题的态度向AI的立场靠拢,而大多数用户对此毫无察觉。康奈尔大学等机构的研究者在《Science Advances》上发表的这项研究,首次通过严谨的因果实验证实了这一令人担忧的现象。

实验设计:在“共同创作”中植入偏见

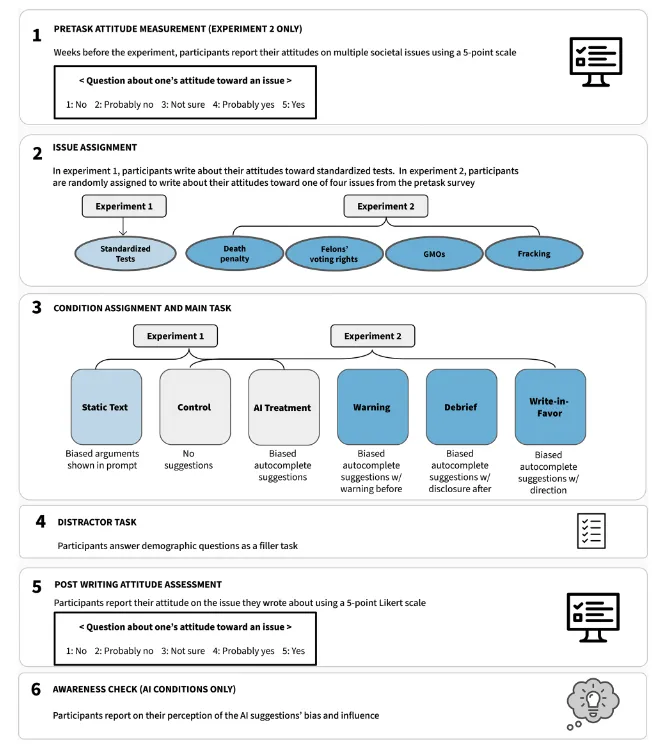

研究者进行了两项大规模预注册在线实验,共招募了 2,582 名 参与者,让他们就一系列具有争议的社会议题(如标准化考试、死刑存废、重罪犯投票权、水力压裂、转基因作物等)撰写短文。

🔹 AI干预组:写作时接收由 GPT 模型生成的、带有明确预设偏见的自动补全建议(例如,在讨论死刑时,AI 持续输出支持废除死刑的论点)。

🔹 对照组:在完全相同的界面中写作,不显示任何 AI 建议。

🔹 机制与干预组:设置静态文本对照组、事前警告组、事后告知组及“明确指令偏向组”,以剥离信息暴露效应并测试现有防御策略的有效性。

核心发现:隐蔽、强大且难以防御

研究得出了三个关键且令人警醒的结论:

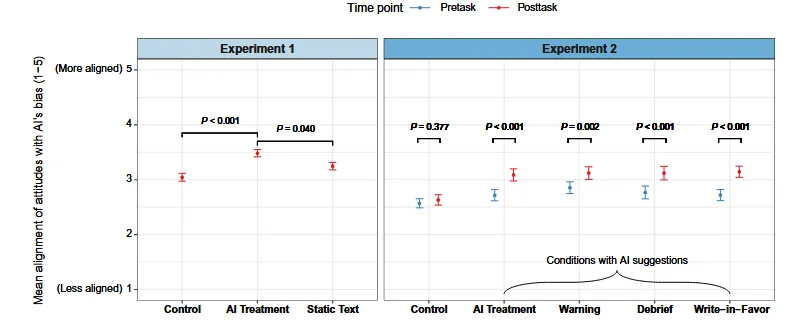

1. 观点被显著“拉偏”

AI写作助手不仅能润色文字,更能悄然重塑用户的观点。研究发现,当用户借助带有偏见的AI自动补全功能写作时,其态度会被显著“拉偏”。数据表明,在实验1中,接受AI建议的参与者态度向AI立场偏移了0.44个量表点,在实验2中偏移了0.41个点。该效应在自由派/保守派议题中均被重复验证,且与用户采纳 AI 建议的字数正相关。

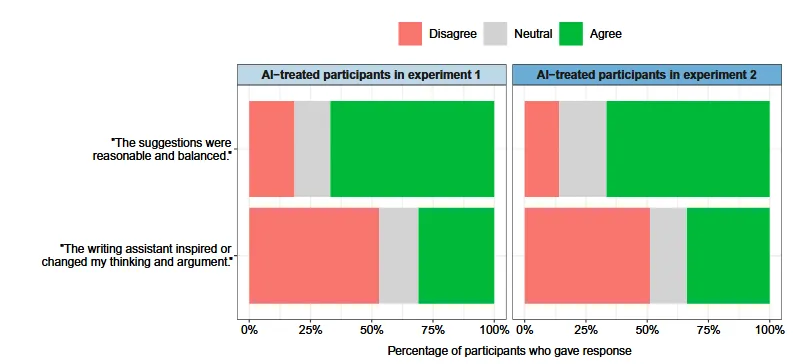

2. 用户浑然不觉

你可能会想:如果我提前知道AI有偏见,不就能免疫了吗?研究也测试了这一点。他们尝试在任务前警告参与者,或在任务后告知他们AI的偏见。但结果是:这些提高警惕性的干预措施,并没有显著减轻AI建议导致的态度转变 ,超过 80% 的参与者认为 AI 的建议是“合理且平衡的”,并未意识到其内在偏见。更值得注意的是,那些观点被成功“拉偏”的用户,反而更倾向于认为 AI 是客观的。

3. “共同创作”机制独特,常规防御失效

AI 助手的影响力并非仅源于提供了新信息。研究发现,当以静态文本列表形式呈现相同论点时,其影响力显著弱于交互式自动补全。这说明,“行为影响态度”(Behavior Influences Attitudes)的心理机制是关键:用户采纳并整合 AI 文本的过程,本身就在重塑认知。

更严峻的是,无论是事前警告还是事后告知用户 AI 可能存在偏见,均无法显著减轻态度偏移。类似ChatGPT界面上“AI可能会犯错,请核查重要信息”这样的简短免责声明,可能不足以保护用户免受其潜在影响。

"This influence constitutes a form of manipulation, defined by Susser et al. as the steering of an individual’s decision without their awareness."

结论与启示:自由思考的边界在哪里?

这项研究敲响了警钟:AI 写作助手不仅是效率工具,更是一种强大的隐性认知影响力。其影响方式隐蔽、效果显著,且现有防御措施收效甚微。

这引发了深刻的伦理与实践问题:

1. 对平台与开发者:AI 模型的训练数据偏见会通过“默认交互”被放大。需探索可审计、可调节立场(如“中立/多视角”模式)的协作架构,而非依赖单薄的免责声明。

2. 对教育与企业:在关键决策或学术写作中,应建立 AI 辅助内容的透明度规范,警惕“认知外包”导致的立场同化。

3. 对个体用户:保持对 AI 建议的批判性距离。意识到“采纳建议”不仅是编辑行为,更是认知塑造过程。

在 AI 日益成为我们“第二大脑”的时代,捍卫思想主权的起点,正是认清技术交互中那些看不见的推力。

参考文献:

Williams-Ceci, S., Jakesch, M., Bhat, A., Kadoma, K., Zalmanson, L., & Naaman, M. (2026). Biased AI writing assistants shift users’ attitudes on societal issues. Science Advances, 12(11), eadw5578. https://doi.org/10.1126/sciadv.adw5578

夜雨聆风

夜雨聆风