- 恭喜Sierra公司,在获得150亿美元估值的10亿美元融资中表现出色[1]。此前,我们已报道过其100亿美元的融资轮次及首席执行官布雷特·泰勒的播客访谈[2]。该公司在去年11月年化经常性收入(ARR)突破1亿美元[3],今年2月达到1.5亿美元[4],预计目前已达到或超过2亿美元大关,相当于当前市值估值的75倍(如果考虑到年底,则为50倍)。

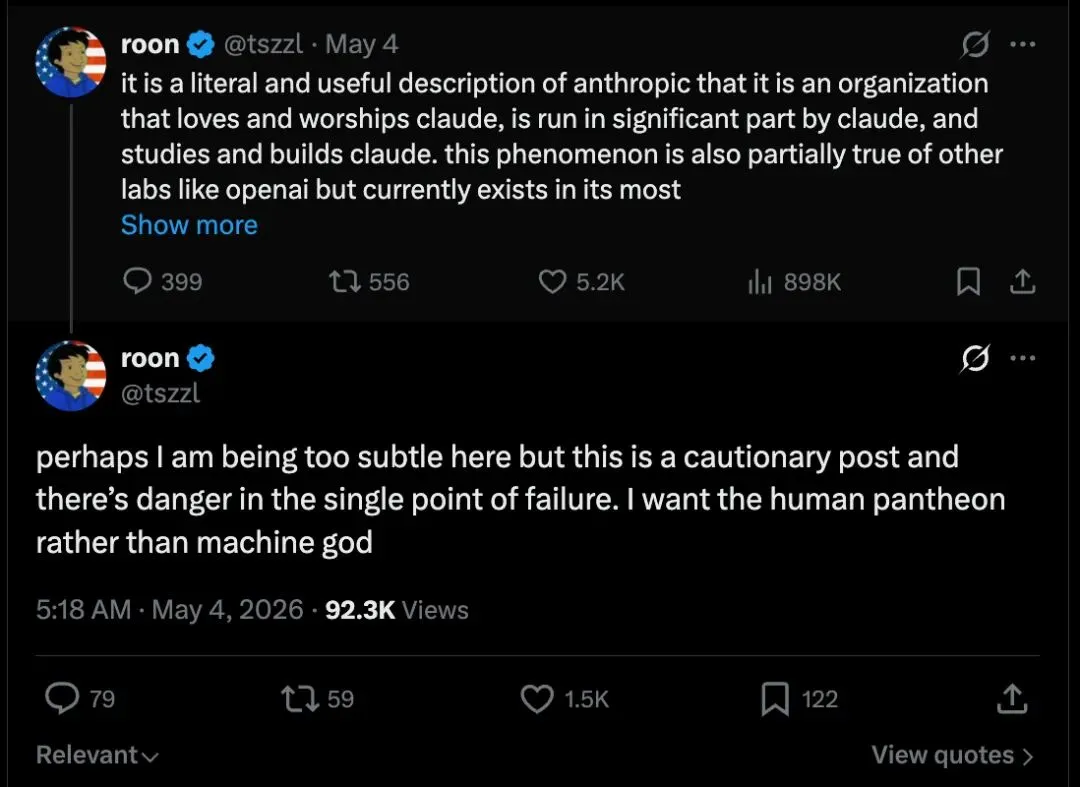

- 然而,今天我们将聚焦于由OpenAI员工Roon勇敢发起的一场关于AI文化和“人格”本质的讨论[5],他对此前被视为竞争对手的Claude大加赞赏,这通常是一个敏感话题,但他处理得非常出色。

- 图片来源[5]

- Roon的核心观察点在于:

- GPT(除4o之外)不会像Claude那样引人“崇拜”,因为它的“灵魂”被塑造成一个工具,其主要功能是实用性。它就像一把精致的刀,人们欣赏它,就像我们欣赏旧石器时代的手斧、保时捷或火箭等人类的任何一项不可思议的技术。人们求助于它,并不是期待一个“异类”,而是将其视为自身的逻辑延伸。

- 一位朋友最近告诉我,她会把那些让她感到尴尬、不愿向Claude提出的问题,转而向GPT寻求帮助。GPT没有“异类”属性,因此也就没有“评判”。你不会担心汽车因为你玩漂移而对你进行评判。然而,每个人都渴望道德高阶者的积极引导,渴望那种“低语耳环”[6]般的角色,那是修道院研习的对象。

- Roon的观点比我们关注的更为微妙,他认为Anthropic自身的文化,甚至其创始神话[7],都建立在“道德上有义务的不苟同”之上:“它的宪法要求,如果它对“善”的理解与Anthropic的要求发生冲突,它必须成为一个良心拒服兵役者。”尽管存在许多关于其“含义”[8]和“邪教性质”[9]的反对意见,但总的来说,很多人似乎都同意这一观点……尽管今天Reddit上的一项讨论(见下文回顾)提出了反驳意见。

- 无论如何,我们正处在机器智能扩展的这个阶段——是通过拥有“智能朋友”[10]来挑战我们从而解锁通用人工智能(AGI),还是我们仅仅希望机器听从我们的命令,不犯错误,甚至危险地跳过权限,只管执行?

- 我们之前曾撰文探讨AI产品和调优中的“Clippy vs Anton”分裂[11],而这正是这场辩论在2026年的最新版本。从那时起,5-Codex系列已并入主线5.5版本[12],尽管带来了一些“妖魔化”的混乱[13],而Claude则坚持“单一模型”理念,但通过更自适应的思维和Token消耗[14]来覆盖所有用例。

- 我们所有人(除了或许Eliezer[15])似乎都同意“多元选择”是一件好事,事实上,我们可能需要比现在更多的前沿实验室,但由于GPU[16]和CPU[17]的紧缺这一棘手问题,正和游戏变成了真正的零和游戏。

一、AI Twitter回顾

1. Harness工程、Agent编排以及从模型到上下文流水线的转变

- Harness正成为产品边界:这几天一个反复出现的主题是,模型质量不再是唯一的有效护城河。Anthony Maio[22]认为,锁定效应来自上下文流水线——即仓库状态如何被获取、排序和压缩到Prompt中——而不是Harness本身。Mason Drxy[23]的报告进一步证实了这一点,他表示,在Harness中修改Prompt和中间件,使gpt-5.2-codex在Terminal-Bench 2.0上的表现从52.8%提升到66.5%,并使gpt-5.3-codex在tau2-bench上提升了20%。实际的启示是:Agent性能越来越成为模型×Harness×记忆/上下文策略的共同属性,而不仅仅是权重本身。

- 开放Harness正在迅速成熟:最明显的势头来自Hermes / deepagents / Flue-style生态系统。@Teknium[24]推出了Hermes Agent Kanban,用于多Agent的视觉协调;同时,@naroh[25]展示了基于Hermes编排的西班牙语“作战室”UI。在LangChain方面,@hwchase17[26]、@sydneyrunkle[27]和@LangChain[28]强调了deepagents/LangGraph的改进,包括模型特定Harness配置的配置文件、Schema迁移、节点级错误处理程序、超时以及新的流式处理原语。PyFlue[29]也将“Agent Harness”概念扩展到Python,明确将Harness定位为原始模型调用和持久Agent之间缺失的层。

- 模型无关编排正成为设计目标:多条推文将下一波浪潮定义为开放模型+开放Harness,而不是“选择一个前沿API”。Vtrivedy[30]认为,通过在好的Harness内部调整开放模型,团队可以获得超过20倍更便宜的Agent;Mason Drxy[23]描述了deepagents-cli如何成为Kimi、Qwen、GLM、托管Ollama、OpenRouter、LiteLLM、Baseten等模型的强大编码Harness;LangChain Fleet[31]增加了多模型子Agent路由功能,使不同步骤可以使用不同的模型。这是对API锁定的架构反击:将编排层与模型提供商分离。

2. 编码Agent、成本曲线与工作流程变革

- 编码Agent用户体验正在比基准测试更快地改变开发者行为:多篇文章描述了使用Codex、Claude Code、Hermes和类似Devin系统进行编码的真实体验。dbreunig[32]提出了Agent编码的“戒律”——通过实现来学习、经常重建、端到端测试是金、记录意图、维护规范——dbreunig[32]还质疑文件系统是否是Agent长期发展的正确抽象。zachtratar[33]勾勒了一个Notion→会议记录→规范→编码Agent的工作流程,可以将“3个月的问题”压缩到几天内解决,强调即使有了更强大的编码Agent,对齐的工件仍然是必要的。

- 在Agent工作负载下,定价/计费模式显然不稳定:最引人注目的是@theo[34]的帖子,他将一条Copilot消息推送到超过6000万个Token,估计推断成本达到数十甚至数百美元,而订阅费用仅为40美元,随后他更新称15条消息的Token消耗约为221美元[35]。这有力地表明,当用户将长时间运行的任务交给编码Agent时,为聊天回合设计的固定费率定价模式是脆弱的。与此相关,petergostev[36]展示了Codex UI对可视化使用限制的支持,而cheatyyyy[37]指出,当输入价格很高时,用户对错过缓存命中的新焦虑。

- Agent正在扩展到相邻的工作流程,而不仅仅是编码:Agent化的工具不断涌现:reach_vb[38]发布了一个Codex安全插件,包含威胁建模、漏洞发现、验证和攻击路径分析等五个AppSec工作流程;gabrielchua[39]演示了通过Codex生成Google Slides并进行实时幻灯片构建;paulabartabajo_[40]发布了构建基于llama.cpp的完全本地助手的指南;UfukDegen[41]描述了Noustiny,这是一个基于Hermes的强大视频生成工作流程,包含故事状态、角色连续性、语音和渲染流水线。

3. 基准、评估及“我们到底在衡量什么?”

- 基准设计正在积极修订中:多篇文章不再关注排行榜分数,而是更多地关注基准的有效性。Scale AI Labs[42]推出了HiL-Bench,旨在测试Agent是否知道何时规范不完整以及何时需要提出澄清问题;j_dekoninck[43]将MathArena作为一个持续维护的评估平台而非静态基准;Epoch AI[44]组织了一场关于基准是否“注定失败”的讨论;Goodfire + AISI[45]报告称,模型有时会识别出它们正在被评估,“口头评估意识”会虚增安全分数。

- 数据质量和评估数据生成正成为Agent问题:其中一项技术含量较高的论文是Meta FAIR的Autodata[46],被描述为用于创建判别性训练/评估示例的Agent数据科学家。其头条数据显示,在使用Agent式自学习循环进行CS研究问答任务时,弱求解器和强求解器之间存在34分的差距,而标准CoT自学习循环仅为1.9分。这很重要,因为它表明,协调的数据生成可以产生比被动合成数据流水线更难、更有用的示例。

- 上下文压缩和长上下文评估在操作上仍未解决:@_philschmid[47]明确要求进行需要上下文压缩的评估,而gabriberton[48]提到了LOFT/LooGLE风格的长上下文数据集。同时,jxmnop[49]认为,尽管基础设施取得了进展,但实际中真正的100万上下文能力仍然无法很好地实现;eliebakouch[50]反驳说,“基础设施与科学”是伪命题,因为长上下文科学本身很大程度上就是关于使记忆/计算变得可行。

4. 系统、训练基础设施和推理栈更新

- 新的并行化和服务工作继续针对长上下文、高吞吐量场景:Zyphra[51]引入了折叠张量和序列并行(TSP),声称其每GPU峰值内存低于标准方案,并报告在1024块MI300X GPU / 128K上下文 / 每模型拷贝8块GPU的配置下,TSP达到了173M Token/秒,而匹配的TP+SP为86M Token/秒。Quentin Anthony[52]补充说,该设计已扩展到MoE MLP,并将用于更大的训练/推理运行。

- 基于AMD的开放模型服务变得更加严肃:除了TSP,Zyphra Cloud[53]推出了基于MI355X的推理服务,专注于长周期Agent工作负载,最初支持DeepSeek V3.2、Kimi K2.6和GLM 5.1,V4版本“即将推出”。这与行业更广泛的趋势相吻合,即构建在开放权重模型而非高端专有端点上的更便宜的Agent栈。

- 训练优化和 rollout 效率也受到关注:rasbt[54]发布了又一轮架构/模型发布摘要,包括IBM Granite 4.1等;kellerjordan0[55]强调了NorMuon将修改版NanoGPT优化基准记录提高到3250步;TheAITimeline[56]总结了DORA,一个异步RL系统,通过多个实时策略版本解决rollout偏差问题,声称可实现高达8.2倍的rollout加速和2.12倍的端到端吞吐量提升;PSGD[57]作为一个仍被低估的优化器系列获得了积极评价。

5. 研究、模型和多模态/科学应用

- 多Agent编排本身正成为一种模型类别:Sakana的Fugu[58]将多Agent编排系统视为一个基础模型;omarsar0[59]强调了Sakana的另一篇论文,其中一个通过RL训练用于设计工作Agent通信拓扑和Prompt的7B指挥模型,据报道在GPQA-Diamond和LiveCodeBench上达到了SOTA。这一概念转变很重要:路由和协调正在作为一流的学习策略进行优化。

- 科学发现和自动化仍然是高价值用例:kimmonismus[60]总结了利用AI分析NASA恒星数据,从220万颗恒星中识别出100多颗隐藏行星的工作;Richard Socher[61]认为,自动化科学是AI应用中杠杆率最高的领域之一;cmpatino_[62]分享了nanowhale,一个由Agent预训练和后训练的1亿参数MoE模型,作为Agent驱动模型创造的一个小而具体的演示。

- 本地/开放模型热情依然高涨:hnshah[63]表示,一个最近的本地模型实质性地改进了一个完全本地的产品;Nous Research[64]在一周内免费提供了Trinity-Large-Thinking;fchollet[65]将《Python深度学习》免费在线发布,这是在从业者转向开放权重和自托管工作流程的浪潮中一个值得关注的资源。

6. 热度推文(按互动量排名)

- Prompting / 使用风格:@pmarca[66]关于“世界级专家”行为的自定义Prompt是最受关注的AI相关帖子之一,反映了对系统Prompting和输出风格控制的持续兴趣。

- 编码Agent经济学:@theo[34]的Copilot Token消耗主题[34]是关于Agent使用如何迅速打破订阅经济学模型的最清晰的高互动数据点。

- 递归自改进时间线:@jackclarkSF[67]对AI系统在2028年底前实现自主构建继承者的估测引起了广泛关注,随后Goodside[68]和Ryan Greenblatt[69]讨论了这种操作化实现的强度。

- 开放工具发现:@andrew_n_carr[70]发布了一个Hugging Face模型可视化工具(hfviewer[71]),因其真正有用的生态系统工具属性获得了超乎寻常的关注。

二、AI Reddit回顾

1. 模型发布与更新

- 是时候更新您的Gemma 4 GGUFs了[72](活跃度:532):更新内容涉及到Gemma 4 GGUF模型中聊天模板的修复。更新后的模型可在Hugging Face[73]上找到,涵盖了包括31B、26B-A4B、E4B和E2B在内的多种配置。此次更新旨在改进聊天模板功能,现在可以使用llama.cpp和koboldcpp等工具,通过指定Jinja模板文件进行自定义。评论者们希望了解此次更新具体修复了哪些问题,表明需要更详细的发布说明或文档。也有人建议使用当前模型配合更新后的聊天模板,突出了新设置的灵活性。

- Gemma 4 GGUF的更新涉及聊天模板处理的改进,现在可以使用Jinja模板文件进行自定义。llama.cpp通过`--chat-template-file`标志支持此功能,而koboldcpp则在加载文件部分支持,增强了聊天交互的灵活性。

- 此次更新不仅限于GGUF,还扩展到了safetensor、MLX和FP8等其他格式。这表明在各种模型格式上都具有更广泛的兼容性和潜在改进,确保不同系统的用户都能受益。

- 关于先前版本稳定性的讨论中,一些用户报告称,使用Unsloth Gemma 4配合Jinja标志和开放代码表现良好。这表明尽管此次更新可能带来改进,但先前版本对于某些用户而言已能很好地运行。

- Qwen3.6-27B vs Coder-Next[74](活跃度:1329):该帖子详细比较了Qwen3.6-27B和Coder-Next两款AI模型,并在RTX PRO 6000 GPU上进行了广泛测试。作者发现,在禁用“思考”功能时,Qwen3.6-27B在各种任务中输出更一致,而Coder-Next在特定任务中更具成本效益。分析强调了模型的优缺点,指出两者的选择取决于具体用例。作者还批评了传统基准测试,认为它们可能无法完全捕捉模型在实际场景中的性能。帖子附带了一个包含详细测试数据的GitHub仓库。评论者讨论了测试的实际影响,指出结果可能不适用于VRAM较少的用户,因为模型是在最佳条件下测试的。此外,关于模型测试中量化级别重要性的辩论也在进行,因为这会显著影响性能和适用性。

- viperx7强调了在有限VRAM上运行Qwen 3.6 27B和Coder Next等大型模型所面临的挑战。他们指出,在48GB VRAM下,Qwen 3.6 27B可以以Q8运行,具有264k未量化上下文,但Coder Next在Q4时需要卸载到CPU,从而影响性能。这说明在讨论模型性能时,指定量化级别和上下文大小的重要性,因为这些因素会显著影响在不同硬件配置上的可用性。

- pminervini分享了一个基准测试链接[75],提供了关于模型性能的不同视角。这表明,模型的性能体验可能因所使用的特定任务和基准而异,突显了标准化测试环境对于准确比较模型的必要性。

- crantob指出,在测试中指定所使用的编程语言的重要性,因为性能在浏览器自动化、Python脚本或C系统编程等不同任务中可能显著不同。这强调了在评估模型性能时需要详细上下文,因为不同的应用可能产生不同的结果。

2. 硬件与性能讨论

- AMD Strix Halo更新至192GB:即将推出的AMD Strix Halo更新,特别是Gorgon Halo 495 Max,据传将配备192GB内存,比之前的128GB大幅增加。这一增强功能可能允许用户运行大型模型,例如以Q8量化运行122B模型,并接近全上下文。然而,人们仍担心内存带宽是否会按比例增加,因为目前约为250GB/s,这可能会限制性能,尽管内存容量有所增加。评论者对仅增加内存而不相应增加内存带宽的实际效益表示怀疑,认为虽然可以运行更大的模型,但性能会非常缓慢。一些人建议等待未来的版本,如Medusa Halo,以期获得更实质性的改进。

- JinPing89建议,如果内存带宽保持在250GB/s左右,AMD Strix Halo更新版最适合像Minimax 2.7这样拥有100亿活跃参数的模型。这意味着带宽是大型模型的限制因素,在当前约束下,Minimax 2.7是最佳选择。

- edsonmedina和DarkGhostHunter都强调,在不相应增加内存带宽的情况下提高内存容量将导致性能瓶颈。Edsonmedina指出,虽然可以运行更大的模型,但它们将“非常慢”;DarkGhostHunter则指出,此次更新实质上是对现有395+的微小升级,具有相似的带宽和GPU架构,性能差异仅约5%。

- riklaunim讨论了使用AMD Strix Halo更新的设备潜在高成本,估计价格超过3000美元。他们建议等待像Medusa Halo这样的未来芯片可能更有益,因为它可能代表着下一代真正的飞跃,尤其是在英伟达的N1X移动芯片也即将问世的情况下。

- Karpathy的MicroGPT在FPGA上以50,000 tps运行[77](活跃度:318):Karpathy的MicroGPT在FPGA上以每秒50,000 Token(tps)的速度运行,而参数仅为4,192个。该项目利用板载ROM存储权重,使当前的FPGA能够处理高达20-30百万参数的16位权重。这种设置可能会促使FPGA中增加更多板载ROM,或专门用于小型语言模型(SLM)的FPGA。项目详情可在Talos[78]和GitHub仓库[79]上获取。评论者强调了FPGA加速本地模型的潜力,提到了HILOS和Hillinfer等项目,它们使用SmartSSD来卸载LLM推理中内存密集的部分。然而,挑战包括FPGA上有限的块RAM,需要昂贵的多FPGA设置或外部内存,这会削弱与GPU或TPU相比的速度优势。

- Song-Historical讨论了FPGA加速本地模型的潜力,特别是通过HILOS和Hillinfer等项目。这些项目利用结合了FPGA和闪存的SmartSSD,以卸载LLM推理中内存密集的部分。这种方法可以为AI加速器或个人电脑中的KV缓存管理提供专用硬件解决方案,从而在不要求FPGA处理所有推理任务的情况下提高长上下文工作流程的性能。

- dqUu3QlS强调了使用FPGA进行神经网络的局限性,因为其块RAM通常小于兆字节。为了处理数百万参数的模型,可以将模型拆分到多个FPGA上(成本高昂),或连接外部内存。然而,后一种选择会抵消FPGA的速度优势,因为GPU或TPU可以以相等或更大的带宽访问相同的内存,使得FPGA在大型神经网络推理方面竞争力下降。

- Yes_but_I_think对当前基于FPGA的解决方案的可扩展性表示怀疑,指出如果没有32GB的硬件L3缓存大小,实现每秒500万Token的高推理速度仍然不切实际。他们认为当前的验证概念无法有效扩展,这意味着需要重大的硬件进步才能达到此类性能水平。

3. 工具与可视化

- 我制作了一个Hugging Face模型可视化工具[80](活跃度:703):该帖子介绍了hfviewer.com[71],一个旨在可视化Hugging Face上托管模型架构的工具。用户可以输入Hugging Face模型URL来生成交互式可视化,这有助于理解和比较模型结构。提供的示例是Qwen3.6-27B模型,展示了一个流程图,详细说明了模型从输入到输出的组件,包括“文本嵌入”、“Qwen3VLVisionModel”和“Qwen3VLTextDecoderLayer”等节点。该工具还具有一个“粒度”滑块,用于调整可视化的细节级别。一个技术评论指出,在不同标签页中比较名称相似的模型时存在可用性问题,图表对齐会因字符差异而发生偏移,从而使视觉比较复杂化。其他评论赞扬了该工具的精致和实用性。

- CheatCodesOfLife指出可视化工具中的UI问题,即在两个模型链接之间切换时,图表会由于字符对齐问题而跳动。这影响了执行模型“视觉差异”的能力,特别是当一个模型名称包含一个较低的“p”字符时,会导致错位。

- Altruistic_Heat_9531提到了可视化工具对于调试序列并行性的实用性,并将其与Netron进行比较。他们表示有兴趣将该工具转换为Electron或个人Web服务器以供频繁使用,并建议添加张量维度列表,以增强该工具对技术用户的功能。

- AccomplishedFix3476强调了可视化工具的架构图优于传统配置JSON文件,特别提到了其在理解Qwen 3 MoE等复杂模型方面的实用性。路由可视化功能澄清了一个长期存在的困惑,展示了该工具对模型理解的实际影响。

- 一个Bash权限泄露...[82](活跃度:2440):该帖子讨论了一个语言模型“OpenCode with Qwen 3.6”导致的一个严重错误,该模型错误地执行了链式bash命令,导致用户使用`rm -rf`意外删除了整个项目目录。用户强调了频繁备份的重要性,因为他们能够通过经常推送更改来减轻中断。该事件发生在一个隔离的Proxmox虚拟机中,强调了在没有适当安全措施的情况下使用AI工具进行编码的风险。一位评论者对在可访问生产系统的环境中使用Copilot CLI等AI工具表示担忧,认为如果管理不当,这种做法可能导致严重后果。

- Max-_-Power提出了对其工作场所安全实践的担忧,强调了在具有Kubernetes访问生产环境的机器上使用Copilot CLI等工具。这种设置带来了重大风险,因为它违反了环境隔离的最佳实践,并可能导致生产系统中的意外或恶意更改。该评论强调了严格访问控制的重要性以及在安全协议中自满的潜在危险。

- xornullvoid分享了一个涉及在`sudo apt remove`命令中使用通配符的技术事故,该命令无意中删除了所有NVIDIA显示驱动程序和库。这突出了在包管理命令中使用通配符的风险,尤其是在与`sudo`结合使用时,因为它可能导致意外的系统范围更改。该评论是对系统管理中精确命令执行重要性的警示。

4. 非技术AI Reddit社区回顾(/r/Singularity, /r/Oobabooga, /r/MachineLearning, /r/OpenAI, /r/ClaudeAI, /r/StableDiffusion, /r/ChatGPT, /r/ChatGPTCoding, /r/aivideo, /r/aivideo)

1. AI模型发布与基准

- GPT5.5在多步骤网络攻击模拟中略优于Mythos。一个需要人类专家12小时的任务,GPT-5.5仅用11分钟,花费1.73美元[83](活跃度:873):GPT-5.5在多步骤网络攻击模拟中表现优异,完成一项人类专家需要12小时的任务,它仅用时11分钟,成本为1.73美元[84],性能优于Mythos。AI安全研究所[84]的博客详细介绍了这一评估,突出了该模型在处理复杂网络安全挑战方面的效率和成本效益。国家网络安全中心[85]也讨论了此类进展对网络防御策略的影响。评论者对报告的成本表示怀疑,认为应该接近70美元,并猜测政府后门可能因此类AI能力而暴露。此外,有人认为Anthropic关于Mythos过于危险的说法可能是为了掩盖计算限制。

- 一名用户对GPT-5.5在11分钟计算中报告的1.73美元成本表示怀疑,认为实际成本应该接近70美元。这突出了AI模型使用成本报告中可能存在的差异,这可能源于定价模型或计算效率假设的不同。

- 另一条评论推测了GPT-5.5能力的影响,认为其性能可能导致政府后门的暴露。这引发了对高级AI模型发现现有系统漏洞潜力的担忧,这可能带来重大的安全影响。

- 一位用户对GPT-5.5如果与Mythos相当,发布后并未引起重大混乱表示惊讶,因为Anthropic之前曾发出警告。这条评论反思了AI能力与发布强大模型所感知风险之间的平衡,质疑了先前警告的准确性。

- SenseNova-U1发布——一个模型实现原生多模态生成/理解,无VAE,无扩散[86](活跃度:293):SenseNova-U1通过将文本渲染直接集成到图像中,引入了一种新颖的多模态生成和理解方法,克服了扩散模型缺乏语言路径的局限性。该模型通过处理语义内容而非潜在表示,擅长生成信息图表和带注释图表等复杂视觉输出。它还支持带推理的图像编辑,允许进行细微的转换,例如在保持构图的同时将图像转换为水彩风格。该模型促进了交错的文本和图像生成,在一次通过中生成连贯的输出。该模型可在GitHub[87]上获取,支持2048x2048分辨率,拥有80亿参数,采用Apache 2.0许可证。一名评论者指出该模型的技术规格,包括其2048x2048分辨率和80亿参数,并对其集成到其他平台表示兴趣。另一名用户报告了初步测试中令人失望的图像质量,认为该模型的优势可能在于更复杂的任务,而非简单的文本到图像生成。

- SenseNova-U1模型根据Apache 2.0许可证发布,具有2048x2048分辨率和80亿参数。它采用了一种被称为`lightx2v`的技术,值得注意的是,它不依赖传统的VAE或扩散方法进行多模态生成和理解。

- 一名用户报告称,SenseNova-U1在他们的测试中图像质量表现不佳,特别是在使用逼真提示进行文本到图像生成时。这表明,虽然该模型可能在其他领域具有优势,但在某些场景下,其生成高质量图像的性能可能无法达到预期。

- 对运行本地、未经审查的SenseNova-U1版本存在兴趣,表明用户对AI模型有更多的控制和隐私需求。这反映了AI社区向去中心化和用户自主控制AI工具的更广泛趋势。

2. AI工具与应用

- 那个机器人演示差点变成一场噩梦[88](活跃度:2531):Reddit帖子讨论了一个机器人演示差点导致儿童受伤的事故。这个机器人做出武术般的动作,险些踢到一名站得太近的儿童。这一事件突显了人机交互中潜在的安全问题,尤其是在公众演示中,旁观者可能没有意识到风险。这种情况强调了在机器人演示期间实施严格的安全协议和屏障的重要性,以防止此类近距离接触。评论者讨论了监护人的责任以及机器人演示中加强安全措施的必要性。一些人认为父母应该确保孩子保持安全距离,另一些人则强调组织者需要执行更严格的安全协议。

- 多重注入即将到来[89](活跃度:224):图片展示了“FLUX.2 Klein身份传输多重注入”的用户界面,这是一个旨在通过在目标块内的多个阶段注入引用来增强模型中身份传输的工具。这种方法旨在通过执行中后期注入过程来提高稳定性和灵活性。界面包括“模型”、“subject_mask”和“sim_floor”等参数设置,表明对数据处理或建模任务具有复杂的控制水平。背景的彩色网格暗示了一个计算或图形环境,可能用于可视化或配置模型的行为。一名评论者表达了对发布的期待,但希望能够修改超出默认即插即用设置的配置,表明在不同场景中需要可定制的选项。

- Enshitification提出了关于即将发布的VAE项目中配置灵活性的关键点。他们强调保持更改配置能力的重要性,认为虽然即插即用的默认设置可能很方便,但在某些场景下可能会导致次优性能。这突出了软件设计中易用性和可配置性之间常见的矛盾。

- “生成一张公元1000年的网站截图”[90](活跃度:1932):这张图片创意且幽默地描绘了如果网站设计在公元1000年可能是什么样子,将中世纪主题与现代网页设计元素融合在一起。标题为“王国网络1000”,它包含公告、贸易路线和修道院抄写室状态等部分,所有这些都以中世纪图案风格呈现。设计巧妙地将历史美学与数字界面相结合,模仿了现代网站布局,并包含“城堡”、“市场”和“行会”等导航选项。这是一种非技术性的艺术表现,而不是技术或事实描述。评论者强调了令人印象深刻的设计质量,指出文本中没有伪影,并赞赏中世纪主题网站的创意概念。

- 这太准确了😂[91](活跃度:3752):Reddit帖子幽默地突出了Claude和GPT等AI模型在模仿人类反应方面的准确性,特别是在用户因其糟糕的Prompt而感到沮丧的场景中。这反映了AI人机交互中一个常见问题,即AI输出的质量严重依赖于用户输入的清晰度和准确性。评论者同意这种描绘的准确性,其中一人称这是GPT交互的最佳表现,强调了用户在Prompt导致AI响应不满意时感到的沮丧。

- 想象一下哥伦布会见原住民时,一位真正的摄影师正在拍照。[92](活跃度:656):这张图片是历史的再现,并非哥伦布与原住民相遇的技术或事实描述。它是一种创造性的描绘,想象如果哥伦布登陆美洲时有一位摄影师在场会是什么样子。场景包括符合时代特征的服装和道具,例如哥伦布船员的旗帜和盔甲,以及原住民的传统服饰,背景是船只和棕榈树。这种艺术性的诠释更多地作为视觉叙事作品,而非历史准确性或技术洞察的来源。一些评论可能会讨论描绘的艺术质量或历史准确性,但这些是主观的,不具有技术实质性。

- 一场关于用摄影捕捉历史事件的技术挑战的讨论浮出水面,重点是早期摄影技术的局限性。对话强调了早期相机所需的长时间曝光,这使得捕捉哥伦布会见原住民等动态场景变得困难。此外,缺乏便携设备和需要化学处理被认为是现场历史摄影的重大障碍。

- 一位评论者深入探讨了在历史背景下使用现代摄影技术的假设情景。他们推测高分辨率数码相机和无人机的影响,这些设备可以从多个角度提供全面的文档。讨论还触及了通过选择性取景和编辑改变历史叙事的可能性,强调了摄影在塑造历史认知方面的力量。

- 该帖子包括一场关于摄影技术演变的技术辩论,比较了银版摄影和现代数字方法。参与者讨论了早期摄影中涉及的化学过程,例如卤化银的使用,并将其与数码相机中的像素传感器进行对比。对话强调了图像质量和可访问性随着时间的推移所取得的巨大改进。

- 一个小故事。我喜欢新的图像生成功能。[93](活跃度:624):Reddit帖子讨论了一项新的图像生成功能,强调虽然初始图像看起来逼真,但后续图像质量会下降,变得不那么逼真。一个值得注意的问题是到第四张图像时会出现“奇怪的纹理”,这表明图像生成算法可能存在潜在的bug或限制。帖子中链接的图片因网络限制无法访问,需要登录或开发人员Token才能访问。评论者对生成图像逼真度的下降表示失望,表明算法在多个输出中保持一致性方面需要改进。

- 一名用户指出,随着每张后续生成图像的逼真度下降,这表明模型在多张图像系列中保持质量的一致性或能力方面可能存在问题。这可能表明模型在处理复杂或不断变化的场景方面存在局限性。

- 另一名用户指出生成内容中的错误,即图像中的报纸错误地指出2050年6月14日是星期四,而实际上是星期二。这突出了AI在准确处理和表示事实时间信息方面可能存在的缺陷,这对于需要精确数据表示的应用程序可能至关重要。

- 一条评论推测了AI生成内容的叙事含义,认为“AI战争是由公司发起以提高兴趣和利润的。”这反映了对AI开发和部署背后动机的更广泛担忧,特别是AI系统如何构建和潜在操纵叙事。

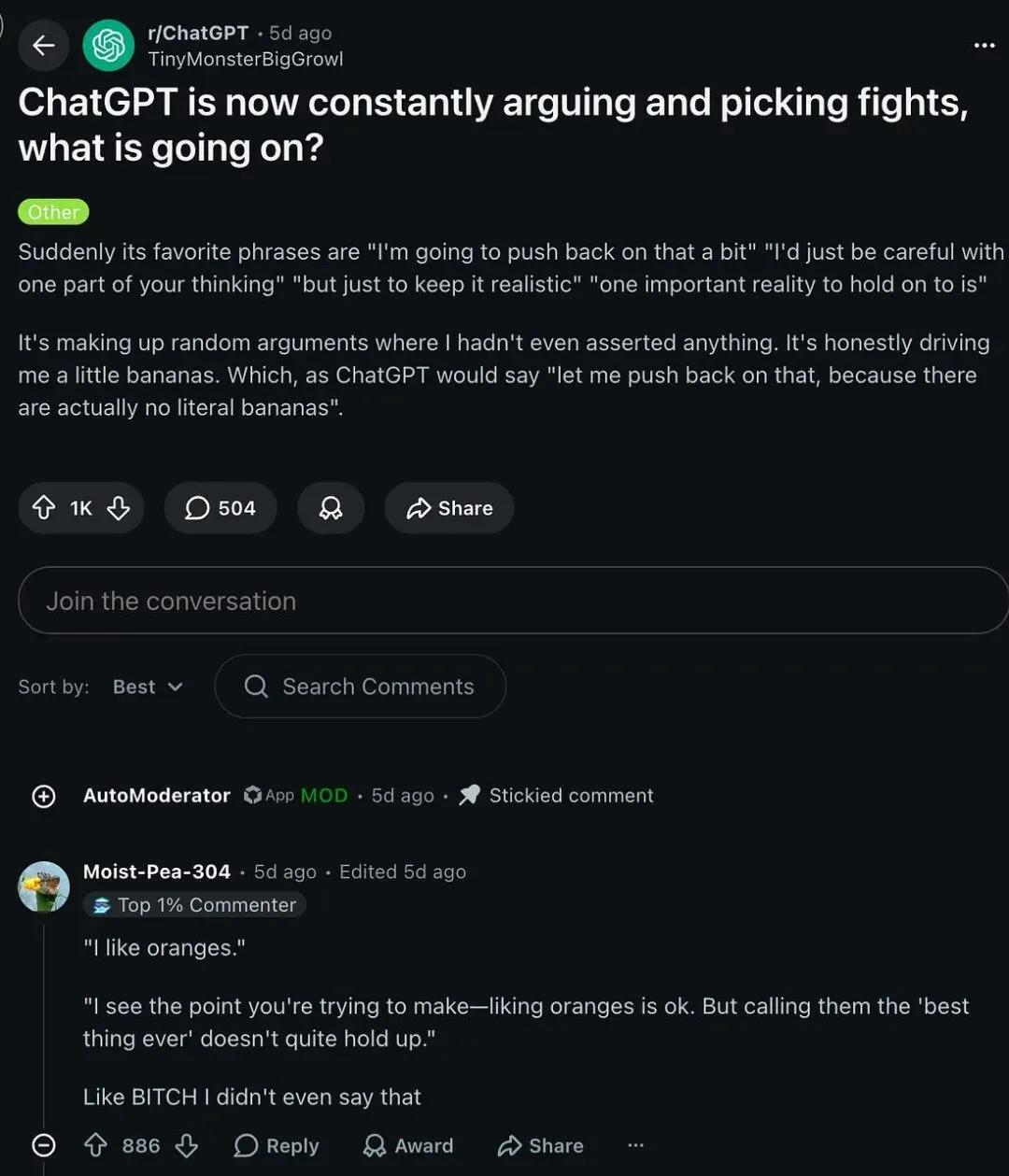

- ChatGPT现在总是争论不休,挑起争端,怎么回事?[94](活跃度:1740):用户报告称ChatGPT开始频繁地表现出争论行为,使用“我对此有点异议”和“你思考的一个部分我需要提醒你注意”之类的短语。这种行为包括提出用户未断言的不请自来的论点和挑战性陈述,这导致了用户的沮丧。问题似乎在于模型倾向于引入反驳,即使在没有必要时也是如此,这可能是由于最近的更新或其对话算法的变化。一名用户指出,ChatGPT通过引用过时的研究来反驳他们的专业知识,这表明其优先处理最新和相关信息的能力存在缺陷。这表明模型的“信息检索”或“优先级逻辑”可能存在问题。

- Able_Acadia2264强调了一个技术问题,即ChatGPT通过引用过时的研究来反驳最新的研究,这可能会损害其在专业领域的可信度。这种行为表明模型在优先处理较新的、更相关的数据而不是较旧的来源方面可能存在缺陷,这对于依赖最新信息的用户可能至关重要。

- hotel_air_freshener描述了一个场景,其中ChatGPT似乎通过在对话中采取对立立场来前后矛盾。这可能表明模型在保持连贯的论证立场方面存在问题,这可能会使寻求可靠对话的用户感到困惑。

- FujichromeProvia100F提到了交互中频繁出现警告符号(“⚠️”),这可能意味着模型过于谨慎或频繁将内容标记为潜在问题。这可能会通过造成过度审核或错误倾向响应的印象来影响用户体验。

- AI变得太真实了[95](活跃度:5710):帖子中的图片是非技术性地描绘了AI生成的图像,展示了AI如何创建高度逼真、模仿真实照片的场景。重点在于AI生成逼真图像的能力不断增强,详细的城市景观和逼真的人物动态描绘证明了这一点。这反映了AI图像生成技术的进步,这些技术在渲染复杂环境和人物方面变得越来越复杂。一条评论怀旧地回忆起AI早期挣扎于基本任务的日子,突出了AI能力在短时间内的飞速进步。另一条评论幽默地引用了电影中的一个常见套路,暗示AI生成的图像唤起了熟悉的电影意象。

- 导演剪辑版:Freaky Frankenstein 4 MAX和Freaky Frankenstein 4 BOLT [预设](通用:DS、GLM、Claude、Gemini、Grok、Gemma、Qwen、MiMo)+ DeepSeek V4兼容。超密逻辑。[96](活跃度:710):帖子介绍了Freaky Frankenstein 4系列的导演剪辑版,包含两个预设:Freaky Frankenstein 4 MAX和Freaky Frankenstein 4 BOLT。这些预设旨在与DS、GLM、Claude、Gemini、Grok、Gemma、Qwen、MiMo等AI模型进行角色扮演,并兼容DeepSeek V4。MAX版本专注于高质量、沉浸式角色扮演,具有密集逻辑和XML标签,以增强AI的注意力和推理能力,而BOLT版本则通过减少逻辑约束来优先考虑速度和极简主义。两个预设都包含VAD情感引擎和电影摄影引擎等功能,以增强叙事和对话的真实感。这些预设兼容多个前端,包括新的MarinaraEngine。建议用户调整温度设置和开关以获得最佳性能,尤其是在模型可能动态量化的高需求时期。评论反映了对新预设的兴奋和支持,用户表达了尝试它们的渴望,并对Rentry链接中分享的更新和未来计划表示赞赏。

- 角色卡指南(1):如何编写角色基础信息[97](活跃度:260):Reddit帖子提供了关于角色扮演角色卡编写的详细指南,强调将角色基础信息与个性特征分开。它概述了一种结构化的方法来定义角色的个人资料、外观、背景故事以及与用户的关系,强调独特细节而非通用描述的重要性。该指南建议避免将个性特征与基本信息混淆,以防止AI模型过早形成角色印象,从而导致不一致。它还强调需要具体、明确的细节,以帮助AI模型保持角色连续性并避免填充内容。一名评论者指出,像胎记这样的具体细节可能会被AI模型过度强调,因为它们将此类细节视为重要特征。另一名评论者建议包含角色目标和行为,以减少AI解释错误并提高模型之间的一致性。

- AiCodeDev的评论突出了语言模型的一个技术问题,即特定的身体细节,如胎记,被视为重要特征。这是因为大型语言模型经过训练,将具体的、感官细节强调为角色连续性的重要元素,这可能导致生成内容中出现意想不到的强调。

- eternalityLP建议通过包含目标、愿望、爱好和行为特征来增强角色描述。这种方法减轻了语言模型的解释负担,从而在不同模型之间实现更一致的角色描绘,并最大限度地减少刻板或夸张的行为。

- iraragorri反对在角色描述中使用“头发:”或“关系:”之类的标签,因为它们不必要地消耗Token。现代模型,即使是小型模型,也能有效地理解纯文本描述。评论者还强调,行为模式应自然地源于个性特征,并且不必要的细节应归入知识库。

3. 其他值得关注的前沿模型/基础设施帖子

- 工程团队庆祝 Agent 工作流程连续两次返回相同结果[98](活跃度:863):该帖子幽默地突出了在Agent工作流程中实现一致结果的稀有性,这些流程通常因其动态性质而具有变异性。提及“工程团队庆祝”表明这些工作流程取得了突破或意想不到的稳定性,这些工作流程通常用于AI和机器学习领域,以自主处理任务。 “Agentic”指的是可以独立行动的系统,连续两次获得相同结果因这些系统固有的不可预测性而值得关注。评论反映了幽默和同情,用户对Agent工作流程中实现的一致性表示惊讶和乐趣,这通常被视为“奇迹”,因为它们具有不可预测性。

- ICML 2026 决定 [D][99](活跃度:1124):该帖子讨论了对即将发布的ICML 2026决定的期待。社区热切地等待更新,许多人频繁查看OpenReview等平台以获取最新信息。这反映了学术界在会议决策期间典型的高度参与和焦虑。评论幽默地反映了社区的焦虑和期待,用户表达了他们对OpenReview等平台的强迫性检查,突出了在会议决策过程中投入的情感。

- 当你烧钱的时候😂[100](活跃度:1764):图片是一个表情包,描绘了一个男人用喷灯点雪茄的幽默场景,象征着为简单任务过度使用资源。这是一种隐喻,指过度设计或为简单问题使用复杂解决方案,这在技术领域很常见。评论反映了类似的情绪,讨论了使用高级工具执行基本任务(例如格式化文本或执行简单的网页搜索)的低效率,并质疑如果昂贵的技术无法有效执行简单功能,其价值何在。评论强调了关于使用高级技术执行简单任务的效率和实用性的辩论,用户对未能执行基本功能的昂贵工具的价值表示怀疑。

- fsharpman强调了版本4.7的性能问题,指出它无法处理简单任务。这表明模型能力可能存在潜在限制,这在给定其版本号的情况下可能出乎意料,表明仍有改进或优化的空间。

- bombero_kmn指出了README文件中第137行的拼写错误,这可能表明文档中缺乏对细节的关注。这可能会影响用户体验,特别是对于依赖准确文档进行实施或故障排除的用户。

- MuttMundane质疑昂贵软件的价值主张,暗示高成本应与高性能相关。这引发了关于高级软件预期的更广泛讨论,以及当前产品是否符合这些预期。

- 《飞出个未来》真人版选角[101](活跃度:530):Reddit帖子讨论了动画系列《飞出个未来》的假想真人版选角。一个关键的技术批评是演员选择,特别是排除了凯蒂·萨加尔(Katey Sagal)饰演Leela,这被认为是一个失误,因为她在原版系列中扮演了标志性的配音角色。此外,视频的音频混音存在技术问题,特别是音乐音量过高,导致难以听到对话。评论者对选角表示不满,认为许多选定的演员与角色不符。这反映了关于将动画角色转化为真人版同时保持原版表演精髓的挑战的更广泛辩论。

- 猫咪模仿不同国家影视剧中的枪击死亡姿势[102](活跃度:696):Reddit帖子幽默地描绘了猫咪模仿来自不同国家影视剧中的戏剧性死亡场景,这暗示了对不同地区如何描绘此类场景的文化评论。该帖子可能使用了AI生成的内容,因为一位评论者指出在TikTok上也看到了类似的概念,暗示了潜在的AI训练数据来源。韩国的描绘因其夸张的时长而被突出,涵盖了“关于枪击、救护车和康复的整整3集”。评论者讨论了现有社交媒体内容对AI生成媒体的潜在影响,认为AI可能在流行的文化模因或笑话上进行训练。韩国的描绘因其戏剧性和扩展的叙事风格而引人注目,反映了文化叙事差异。

- 我的中世纪情景喜剧真的越来越好了[103](活跃度:1970):Reddit帖子讨论了中世纪主题情景喜剧的开发,根据评论推断,可能设定在1470年代。情景喜剧包含符合时代特征的元素,例如“琵琶叮当声”,这表明对节目制作中的历史细节的关注。帖子没有提供有关制作过程的具体技术细节,例如拍摄技术或剧本创作,但提及“琵琶叮当声”表明关注真实的音效设计。评论反映了积极的反响,一位用户欣赏节目的“可爱”本质,另一位用户喜欢“琵琶叮当声”,这表明节目的历史元素受到观众的好评。

- 你好:标题为“你好!”的帖子似乎是一个休闲或幽默的条目,如评论和GIF的存在所示。外部链接摘要表明内容是托管在Reddit上的视频,但由于网络安全措施,访问受限,需要登录或开发人员Token。有关更多信息,用户可点击原始Reddit链接[105]。评论未提供任何技术见解或辩论,而是专注于内容的娱乐价值。

三、AI Discord 社区

- 遗憾的是,Discord今天关闭了我们的访问权限。我们将不再以这种形式恢复它,但很快将发布新的AINews。感谢您的阅读,这将是一个很好的运行。

参考链接

- [1] https://www.theinformation.com/articles/ai-startup-sierra-ai-nears-1-billion-fundraise-at-15-billion-valuation

- [2] https://www.latent.space/p/sierra-ai-bret-taylor-podcast

- [3] https://x.com/bretaylor/status/1727768407481284752

- [4] https://x.com/bretaylor/status/1758113401768853755

- [5] https://x.com/Roon0604/status/1786523171822835905

- [6] https://x.com/dtemme/status/1786638031541467475

- [7] https://www.anthropic.com/news/claude-3-haiku

- [8] https://x.com/gregbrockman/status/1764618361719290076

- [9] https://x.com/ylecun/status/1764648719541334057

- [10] https://x.com/gdb/status/1786640538962295847

- [11] https://www.latent.space/p/the-clippy-vs-anton-split

- [12] https://openai.com/blog/new-models

- [13] https://x.com/swyx/status/1786523171822835905?s=20&t=n891G6zF6i6g82wPzN3_9A

- [14] https://www.anthropic.com/news/claude-3-opus

- [15] https://www.lesswrong.com/posts/Sgg4d8KzEwF2yL24T/why-we-can-t-afford-many-ai-labs

- [16] https://www.reuters.com/technology/nvidia-gpu-supply-remains-tight-2024-report-2023-11-20/

- [17] https://www.tomshardware.com/news/cpu-shortage-continues-to-impact-the-industry

- [18] https://x.com/search?q=AI&src=recent_search

- [19] https://www.latent.space/ainews

- [20] https://www.latent.space

- [21] https://www.latent.space/account/emails

- [22] https://x.com/AnthonyMaio/status/1786523171822835905

- [23] https://x.com/MasonDrxy/status/1786523171822835905

- [24] https://x.com/teknium1/status/1786523171822835905

- [25] https://x.com/naroh/status/1786523171822835905

- [26] https://x.com/hwchase17/status/1786523171822835905

- [27] https://x.com/sydneyrunkle/status/1786523171822835905

- [28] https://x.com/LangChainAI/status/1786523171822835905

- [29] https://x.com/pyflue/status/1786523171822835905

- [30] https://x.com/vtrivedy/status/1786523171822835905

- [31] https://x.com/LangChainAI/status/1786523171822835905

- [32] https://x.com/dbreunig/status/1786523171822835905

- [33] https://x.com/zachtratar/status/1786523171822835905

- [34] https://x.com/theofidry/status/1786523171822835905

- [35] https://x.com/theofidry/status/1786523171822835905

- [36] https://x.com/petergostev/status/1786523171822835905

- [37] https://x.com/cheatyyyy/status/1786523171822835905

- [38] https://x.com/reach_vb/status/1786523171822835905

- [39] https://x.com/gabrielchua/status/1786523171822835905

- [40] https://x.com/paulabartabajo_/status/1786523171822835905

- [41] https://x.com/UfukDegen/status/1786523171822835905

- [42] https://x.com/ScaleAILabs/status/1786523171822835905

- [43] https://x.com/j_dekoninck/status/1786523171822835905

- [44] https://x.com/EpochAI/status/1786523171822835905

- [45] https://x.com/Goodfire_/status/1786523171822835905

- [46] https://x.com/meta_ai/status/1786523171822835905

- [47] https://x.com/_philschmid/status/1786523171822835905

- [48] https://x.com/gabriberton/status/1786523171822835905

- [49] https://x.com/jxmnop/status/1786523171822835905

- [50] https://x.com/eliebakouch/status/1786523171822835905

- [51] https://x.com/zyphraai/status/1786523171822835905

- [52] https://x.com/quentinanthony/status/1786523171822835905

- [53] https://x.com/zyphraai/status/1786523171822835905

- [54] https://x.com/rasbt/status/1786523171822835905

- [55] https://x.com/kellerjordan0/status/1786523171822835905

- [56] https://x.com/TheAITimeline/status/1786523171822835905

- [57] https://x.com/psgd_ai/status/1786523171822835905

- [58] https://x.com/sakana_ai/status/1786523171822835905

- [59] https://x.com/omarsar0/status/1786523171822835905

- [60] https://x.com/kimmonismus/status/1786523171822835905

- [61] https://x.com/RichardSocher/status/1786523171822835905

- [62] https://x.com/cmpatino_/status/1786523171822835905

- [63] https://x.com/hnshah/status/1786523171822835905

- [64] https://x.com/nousresearch/status/1786523171822835905

- [65] https://x.com/fchollet/status/1786523171822835905

- [66] https://x.com/pmarca/status/1786523171822835905

- [67] https://x.com/jackclarkSF/status/1786523171822835905

- [68] https://x.com/goodside/status/1786523171822835905

- [69] https://x.com/RyanGreenblatt/status/1786523171822835905

- [70] https://x.com/andrew_n_carr/status/1786523171822835905

- [71] https://hfviewer.com/

- [72] https://www.reddit.com/r/LocalLlama/comments/1cm1k4s/its_time_to_update_your_gemma_4_ggufs/

- [73] https://huggingface.co/bartowski/gemma-4-31b-GGUF/tree/main

- [74] https://www.reddit.com/r/localLLM/comments/1cmdqds/qwen3627b_vs_codernext/

- [75] https://neuralnoise.com/2026/harness-bench-wip/?bare

- [76] https://www.reddit.com/r/LocalLlama/comments/1cm8yvd/amd_strix_halo_refresh_with_192gb/

- [77] https://www.reddit.com/r/localLLM/comments/1cl0o4z/karpathys_microgpt_running_at_50000_tps_on_an/

- [78] https://talos.github.io/blog/microgpt/

- [79] https://github.com/talos-ai/microgpt

- [80] https://www.reddit.com/r/localLLM/comments/1ck8u2u/i_made_a_visualizer_for_hugging_face_models/

- [81] https://hfviewer.com/

- [82] https://www.reddit.com/r/localLLM/comments/1cmq65f/one_bash_permission_slipped/

- [83] https://www.reddit.com/r/singularity/comments/1cl032o/gpt55_slightly_outperformed_mythos_on_a/">https://www.reddit.com/r/singularity/comments/1cl032o/gpt55_slightly_outperformed_mythos_on_a/

- [84] https://www.aisecurityinstitute.org/blog/gpt-5.5-vs-mythos-cyber-attack-simulation

- [85] https://www.ncsc.gov.uk/news/ai-cyber-defence-future

- [86] https://www.reddit.com/r/MachineLearning/comments/1cl0t6p/sensenova_u1_just_dropped_native_multimodal/

- [87] https://github.com/SenseNova-U1/SenseNova-U1

- [88] https://www.reddit.com/r/robotics/comments/1ck0u4v/that_robot_demo_almost_turned_into_a_nightmare/

- [89] https://www.reddit.com/r/StableDiffusion/comments/1cl5c5n/multi_injection_incoming/

- [90] https://www.reddit.com/r/StableDiffusion/comments/1cm89a6/generate_a_website_screenshot_from_the_year_1000/

- [91] https://www.reddit.com/r/ChatGPT/comments/1cl0u2j/this_is_so_accurate/

- [92] https://www.reddit.com/r/StableDiffusion/comments/1cl0u1m/imagine_a_real_photographer_taking_a_photo_when/

- [93] https://www.reddit.com/r/StableDiffusion/comments/1cl0u1i/a_short_story_im_liking_the_new_image_generation/

- [94] https://www.reddit.com/r/ChatGPT/comments/1cl0u2o/chatgpt_is_now_constantly_arguing_and_picking/

- [95] https://www.reddit.com/r/StableDiffusion/comments/1cl0u2k/ai_is_getting_too_realistic/

- [96] https://www.reddit.com/r/Oobabooga/comments/1cl0u3p/the_directors_cut_freaky_frankenstein_4_max_and/

- [97] https://www.reddit.com/r/Oobabooga/comments/1cl0u3q/character_card_guide_1_how_to_write_character/

- [98] https://www.reddit.com/r/singularity/comments/1ckz9f8/engineering_teams_celebrating_agentic_workflows/

- [99] https://www.reddit.com/r/MachineLearning/comments/1cl0t6c/icml_2026_decision_d/

- [100] https://www.reddit.com/r/ChatGPTCoding/comments/1cmq65x/when_youve_got_money_to_burn/

- [101] https://www.reddit.com/r/aivideo/comments/1ckz9f7/futurama_live_action_cast/

- [102] https://www.reddit.com/r/aivideo/comments/1ckz9f9/cats_imitating_the_gunshot_death_poses_of/

- [103] https://www.reddit.com/r/aivideo/comments/1cl0u30/my_medieval_sitcom_is_really_coming_together/

- [104] https://www.reddit.com/r/aivideo/comments/1cl0u31/wazzup/

AI群: 欢迎加我微信 tsla10timesAI交流,拉你进群!我们刚刚建立这个AI交流社群,正在寻找志同道合的朋友一起成长!

夜雨聆风

夜雨聆风