担任 Google CEO 已超过十年的 Sundar Pichai,在最近的一次访谈中坦率地讨论了 Google 在 AI 竞赛中的真实处境。在他的带领下,Alphabet 不仅是全球最大的科技公司之一,也成为 AI 领域的强劲竞争者——公司计划在 2026 年投入 1750 亿美元,这笔巨款背后,隐含着 Google 对自身未来的深刻思考。

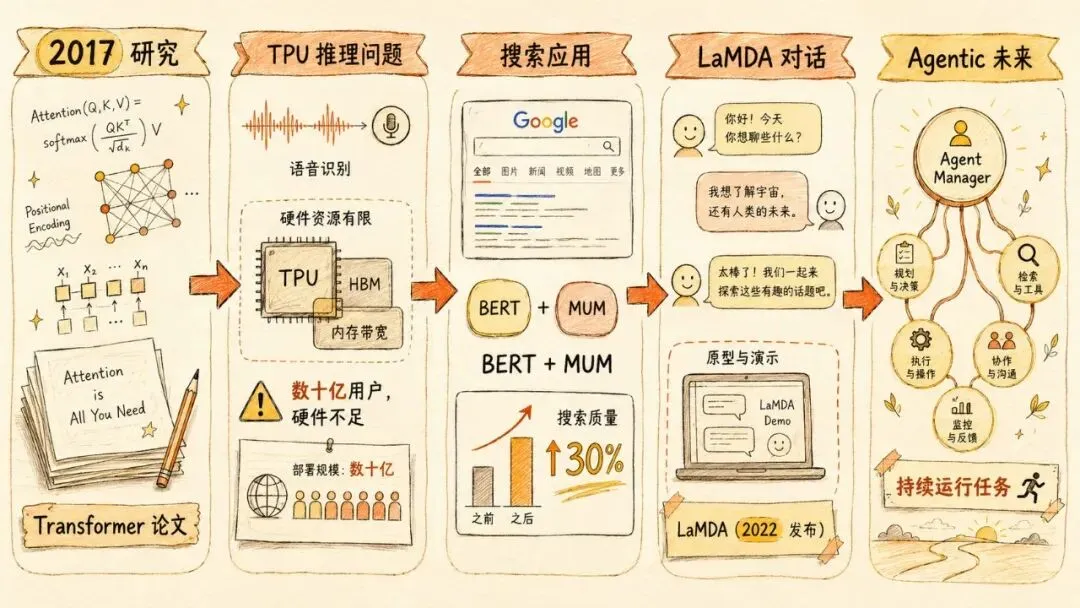

这场对话一开始,就谈到了一个广为流传、但并不完全准确的历史叙事:Google 发明了 Transformer,却没能把它成功商业化,反而让 OpenAI 凭借 ChatGPT 吃到了这项创新的最大红利。对此,Pichai 提供了一个重要背景,也重新框定了这个故事。

Transformer 的诞生,并不是脱离产品需求的纯研究成果。恰恰相反,它是为了解决非常具体、非常现实的问题而被开发出来的。当时 TPU 团队面临的挑战是:在硬件资源不足的情况下,如何把语音识别扩展到数十亿用户规模。团队需要一种全新的推理方案,而 Transformer 就是答案——它不是停留在论文里,而是第一时间被应用到了 Google 的产品中。

在 Search 内部,Transformer 驱动了 BERT 和 MUM 这两个模型,使搜索质量在当时实现了显著跃升。Google 借助这些突破,继续在语言理解上保持领先,能够以前所未有的精细度处理用户查询和网页内容。

Google 的大语言对话模型 LaMDA,从内部定位上看,其实就相当于后来 ChatGPT 所扮演的角色。甚至曾有工程师认为它具备"意识",这也说明它本质上已经是早期对话式 AI 的原型。到 Google I/O 2022 时,公司已经推出了 "AI Test Kitchen",用来展示 LaMDA 的能力。不过,Google 并没有选择全面开放,因为当时他们手上的版本还没有经过端到端的 RLHF 训练。更重要的是,另一个版本"毒性要强得多",在当时并不适合面向公众发布。

Pichai 将这种谨慎归因于 Google 的产品文化。作为一家对搜索质量近乎执着的公司,Google 在向用户正式发布产品之前,对"可接受的产品质量"设定了更高门槛。这不是对机会无动于衷,而是一种组织层面的保守。

Pichai 认为,真正的差异在于执行速度以及外部资源的配合。OpenAI 在 ChatGPT 发布前几个月,就已经与 Microsoft 达成合作,这是一场战略上的关键布局,也让他们站在了更有利的位置。ChatGPT 甚至是在感恩节那周上线的,起初并不算高调,但最终却引爆了文化层面的巨大影响力。与此同时,OpenAI 还捕捉到了一个 Google 可能忽略的重要信号:编程。针对代码场景的能力跃升(从 GPT-2 到 GPT-3,再到 GPT-4)远比单纯语言能力的进步更加显著。

Pichai 从这一刻真正吸取的教训是:在消费互联网领域,意外总是不可避免。Google 自己也经历过类似冲击:Google Video 被 YouTube 超越,后来 Google 反过来收购了 YouTube;Facebook 一度把 Instagram 视作竞争对手,但最终也选择了收购。真正的经验并不是"大公司总能准确看见未来",而是消费互联网天生就充满不确定性,小团队会不断试验、不断发布新东西。你无法控制每一个新产品的出现,但你可以始终保持感知,并做出聪明的反应。

速度,作为一种战略差异化能力

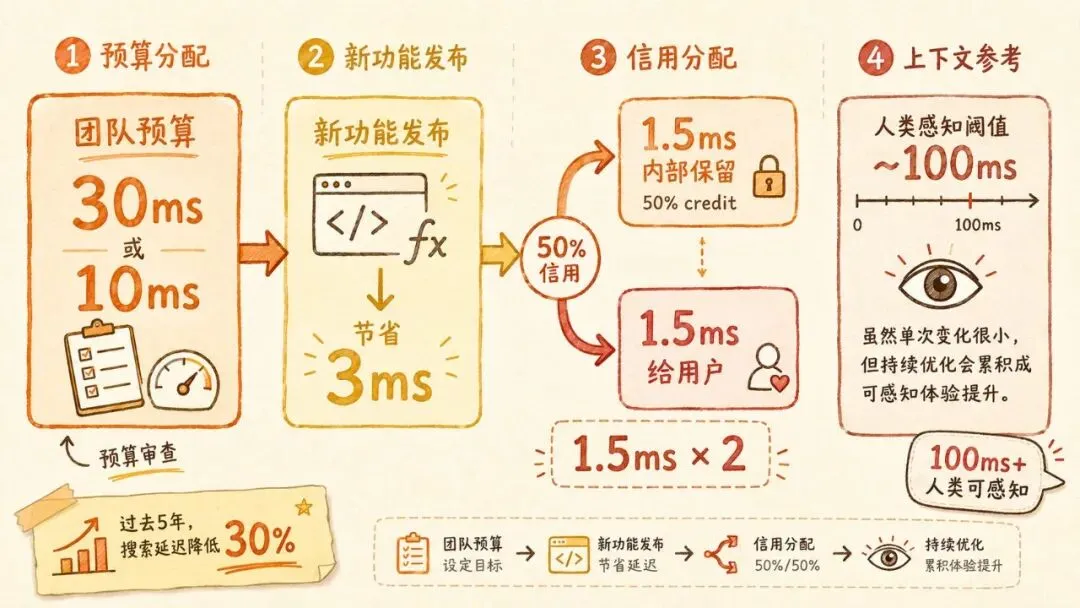

Google 长期以来都以"速度"建立自己的口碑。最早的 Google Search 就明显快于竞争对手,甚至会直接展示查询响应时间,几乎像是在炫耀自己的低延迟。后来,无论是 Chrome、Gmail,还是如今运行在 TPU 上的 Gemini,都延续了这种传统。

Pichai 解释说,延迟不只是一个产品特性,更是技术卓越性的体现。一个产品如果很慢,往往意味着底层工程上存在更深层次的妥协;而一个真正快的产品,通常说明它的基础架构是扎实的。

在 Google Search 内部,这种理念被具体落实为以毫秒计的延迟预算。每个子团队都会拿到明确预算——可能是 30 毫秒,也可能是 10 毫秒。如果某个团队发布了一项功能,并为系统节省了 3 毫秒,那么它可以保留其中 1.5 毫秒供内部使用(即获得 50% 的"信用"),剩下的 1.5 毫秒则让利给用户。每一项新增功能,都必须在这些预算约束下接受审视。

对微秒级性能如此痴迷,听起来也许有些极端,但回报是可以量化的。过去五年里,Google 在大幅扩展 Search 能力的同时,把搜索延迟又降低了 30%,这是一项相当惊人的成就。看看 Search 的功能演进就知道:今天它能做很多过去根本做不到的事,而且它还变得更快了。

在 Gemini 上,同样的理念也适用。Flash 模型可以做到 Pro 模型约 90% 的能力,但在延迟和成本效率上却显著更优,而这一点正是由软硬件垂直整合带来的。

Search 正在演化为 Agentic Intelligence

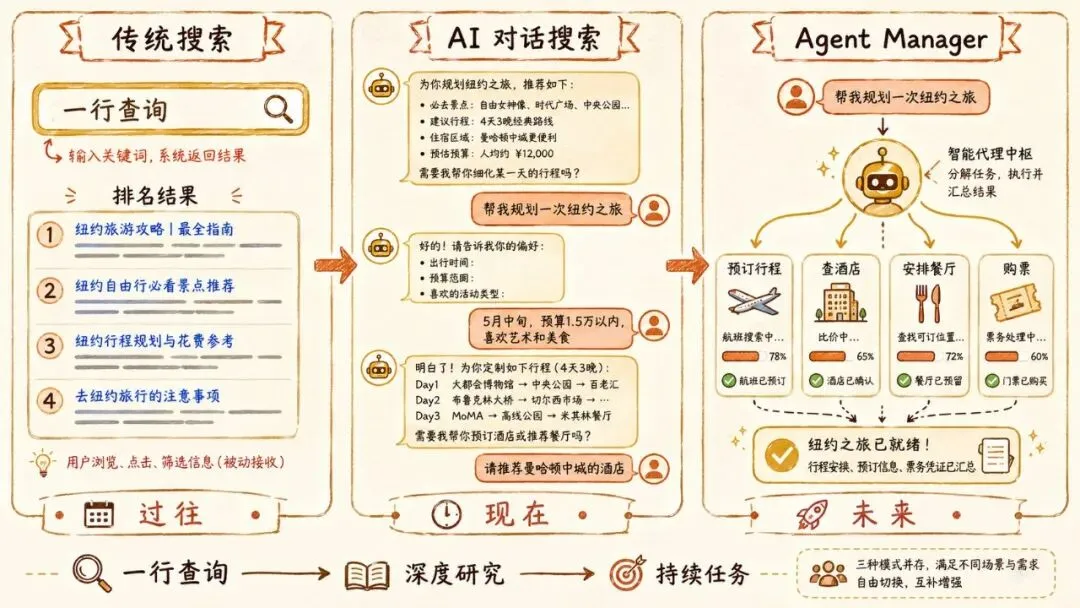

当被问到 Search 的未来时,Pichai 描述的不是"颠覆",而是"演化"。移动互联网时代到来后,Search 已经完成过一次适配。比如,一个刚从纽约地铁站出来的人,并不想看网页列表,他真正需要的是路线指引。产品也因此朝着这个方向进化。

放眼未来,Pichai 设想的是:用户会从"获取信息型查询"转向"代理式任务"。Search 将成为一个 agent manager,用户可以并行运行多个线程,不再只是查找事实,而是主动完成任务。10 年后,"Search" 这个产品还会不会存在?也许不会以今天的形态存在,但某种"类似搜索"的能力,会演化成更广义的东西。

如今 Search 中的 AI mode,已经显露出这种转变。用户开始发起深度研究型查询,这类需求已经不再适用于"单行 prompt + 排名结果"的旧范式。用户在变,Search 也在持续演化。未来很可能会出现 agentic flow,协调多个动作——预订行程、安排餐厅、管理日程——而这一切都通过类似聊天的界面发起。

就像生命从单细胞生物进化成复杂生命体一样,Search 也可能演化为一种通用型 agent 界面。Search box 本身也许会消失,取而代之的是对话式交互。但底层功能不会变——依然是在帮助人们完成目标。

AI 时代的资本配置

Google 已经改变了资本投放方式,尤其是在算力基础设施上的投入。过去,R&D 预算的核心主要是人头成本——招聘足够优秀的人才才是主要瓶颈。算力相对次要(除了像 Google Books 数字化这样的极端案例)。

但现在,TPU 才是限制性资源。Pichai 每周都会专门拿出一个小时,以非常细的粒度审查不同项目和团队的算力分配。如今,算力预算的重要性已经与 headcount budget 不相上下,真实的取舍和优先级排序不可避免。

Google 的做法是:在有足够把握的地方坚定投入资本,包括对 Waymo(自动驾驶汽车)、Stripe(支付)、SpaceX 和 Anthropic 的投资。公司确实因为等待项目足够成熟而错过过一些机会,但 Pichai 依然认可这种战略耐心——与其在技术尚未准备好时过度下注,不如在早期适度少配资源。

对 Google Cloud 来说,算力分配尤其复杂。Google 必须在内部产品需求(而且这些需求极其"贪婪")与客户承诺之间取得平衡,而后者是神圣不可违背的合同义务。通过提前规划、签署长期承诺并做好相应预算,约束问题就能得到一定缓解。Cloud 团队或许拿不到自己想要的全部算力,但通过结构化规划,这些取舍是可以管理的。

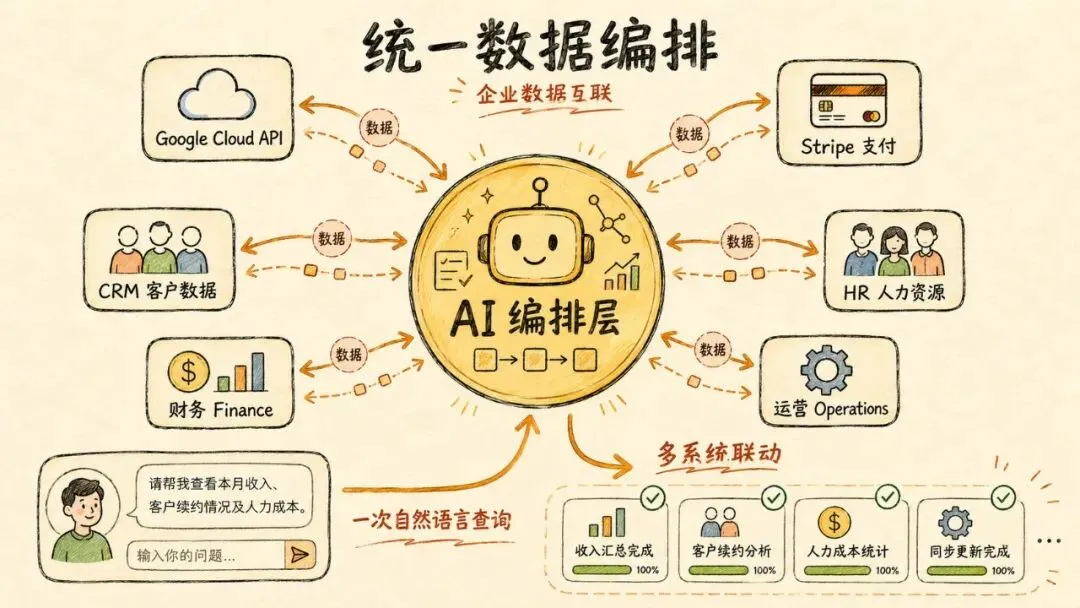

AI 作为编排层

一个非常值得关注的发展方向,是 AI 正在成为复杂产品表面之上的抽象层。Google Cloud 的 API surface 极其庞大,大到用户光是导航就很困难。现在,一个 AI agent 可以读懂全部 API 文档,并成为你与这套复杂系统之间的接口。你不需要再到处翻菜单,只要描述自己想做什么就行。

Stripe 也面临类似问题。它的产品表面已经扩展到支付、billing、identity、financial modeling 等多个领域。一个真正理解整套 API 的 AI,自然就会成为一个非常强大的交互界面。

这种模式同样适用于企业工具。过去,如果企业想把分散的数据源连接起来,往往意味着要启动一个持续数月的 ERP 项目。现在,一个 AI orchestration layer 可以直接叠加在各种系统之上——CRM、HR、财务、运营——并通过跨系统综合数据来回答问题。产品表面越复杂,AI 编排层的价值就越大。

面向消费者的持续有状态 AI

另一个正在浮现的前沿方向,是面向日常用户的、有状态且可持续运行的 AI。今天主流的 AI 应用大多缺乏"持续性"——它们无法可靠地记住用户偏好、持续进行中的任务,或过去的交互记录。但像 OpenClaw 这样的产品,已经证明市场对这种能力是有需求的。

人们希望自己可以说一句:"每天早上把我关心的新闻整理出来并发邮件给我。"但现在的大多数应用还无法可靠地处理这种持续运行、长周期的任务。Pichai 认为,这正是接下来的前沿——为用户提供可靠、安全、可长期运行的 agentic task。这里面确实需要把身份、访问控制和数据持久化这些问题都想清楚,但它是可以实现的。

这并不是科幻。像 Dreamer(后被 Meta 收购)这样的公司,已经做出过早期版本:用户可以指定需求,创建具备持久性和执行能力的自定义应用。当用户第一次体验到那种惊喜——"我居然自己做出了软件!"——就说明这会是一次意义重大的转变。

真正有效的消费者界面,底层需要有完整的 coding model 支撑,同时具备合适的 harness、skills,以及在云端或本地安全执行的能力。今天,全球大约只有 0.1% 的人真正生活在这个未来里——也就是那些会为自己构建定制工具的开发者。把这件事带向大规模普及,本身就是一个真正的前沿命题。

Google 正如何改造自身工作流

在 Google 内部,AI 融入日常工作流的速度因团队而异。有些团队已经发生了深刻变化,有些才刚刚起步。"Jet Ski"(对外称 "Antigravity")是推动这场转变的内部工具——它本质上是一个 agent manager,让开发者以一种有状态、多线程的工作方式开展工作。GDM 和部分软件工程团队已经改变了原有工作模式。就在上周,这个工具也开始向 Search 团队推广。

Pichai 也承认,对于大型公司来说,变革管理显然比小公司更难。小公司或许一夜之间就能"拨一下开关"完成切换,而大公司做不到。更大的挑战在于一种"intelligence overhang"——AI 系统在抽象场景里已经能做出令人惊叹的事,但大多数公司距离真正成为 AI-native 还很远。AI 理论上能做什么,与组织实际上部署了什么之间,仍然存在明显落差。

这里面有几个问题必须解决:第一,当技术本身还在持续快速进步时,工作流的适配本来就需要时间。第二,组织内部存在摩擦——并不是每个人都已经准备好和 AI agents 一起工作。第三,是数据与上下文问题——如何让 AI 充分理解你的具体业务,真正变得有用,同时又不至于因信息过载或敏感信息暴露而带来风险。

前方的道路

随着 Google 在算力和基础设施上投入 1750 亿美元,这家公司已经有能力在多个维度上争夺领先:速度(超低延迟 AI)、能力(通过垂直整合打造 frontier models),以及实用性(能够编排你的工具、替你持续执行任务的 AI)。

错过 ChatGPT 那一刻的讽刺之处在于,Google 现在反而更清楚地理解了:要想争夺市场领导地位,就必须学会更快地发布、更快地迭代,并接受一定程度上的不完美。但与此同时,它也依然带着大组织天然的谨慎,而这种谨慎有时会拖慢速度。

按照 Pichai 的定义,AI 的未来并不是那些边界清晰、像盒子一样封装好的"完美产品",而是能够理解上下文、做出判断、并可靠执行行动的 agents——无论是优化一次搜索、规划一趟旅行、管理个人财务,还是帮你构建自己的定制工具。从"search 作为结果排名列表"转向"search 作为 agentic task completion",代表着人们与技术、也与彼此互动方式的一次根本性变化。

对 Google 来说,下一个篇章不只是让少数早期采用者——那 0.1% 的精英人群——进入 AI-native workflow,而是要把这种能力带给整个组织。核心关键词将是:可靠性、持续性,以及在数十亿人每天使用的产品之间,无缝编排智能。

The history and future of AI at Google, with Sundar Pichai 播客访谈

夜雨聆风

夜雨聆风