在散热这行干了二十年,从给服务器挑风扇,到如今给上千瓦的AI芯片“把脉退烧”,我算是亲身经历了这场热管理革命。今天,我就用大白话,把眼下最前沿的微通道水冷板和相变技术给你们掰开揉碎了讲清楚,哪怕你刚入行,也能听明白。

先聊背景:芯片发的热,已经不是“吹吹风”能解决的了

我刚入行那会儿,一颗CPU几十瓦,一个风冷散热器绰绰有余。但现在,AI大模型训练用的加速卡,单颗功耗已经飙到了1400W,下一代奔着4400W去了。这还不是最大的问题,更棘手的是热流密度——你可以理解为,打火机那个小火苗尖上的热量,集中在一个指甲盖大小的区域往外冒。目前已经超过1500 W/cm²,而传统风冷的上限撑死也就100 W/cm²。不夸张地说,如果不把液冷请出来,芯片瞬间就能把自己“烧糊涂”,性能直接打对折。

所以,液冷不再是可选项,而是必须项。而液冷里最核心的两大法宝,就是微通道水冷板和相变冷却。

先搞懂两个关键数:TDP 和 热流密度

初学者常问,这不都是发热吗?我打个比方:TDP(热设计功耗)就是暖气片的总放热量,说明整个屋子要散多少热;热流密度则是暖气片上某个焊点突然烧红了,那一点的温度有多恐怖。AI芯片就是这种“总热量大,局部还有火苗子”的典型。你的散热方案,必须既搬得动整座“火焰山”,又能精准掐灭里面几个“炼丹炉”。

微通道水冷板:在芯片盖子上雕花的艺术

简单说,微通道就是在铜板或铝板上刻出比头发丝还细的沟槽,让水流过去。这招还是1981年两个聪明人想出来的,目的就是用巨大的接触面积把热快递出来。给它通上水,带走热量的能力比风吹强上百倍。

但怎么刻这个槽,学问就深了。早年我们就是刻直道道,全靠经验试。现在可了不得,玩法完全变了。

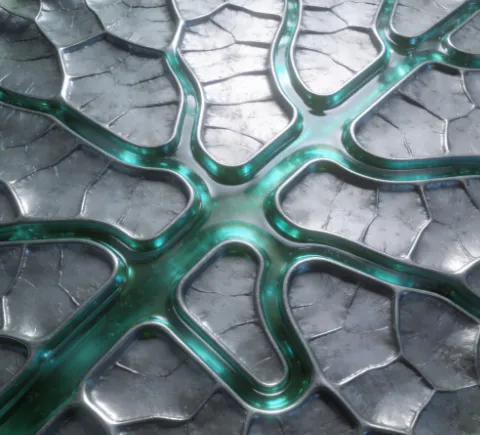

1. 拓扑优化:让计算机“进化”出最佳流道你告诉电脑:我要把这颗芯片的热点压到最低,泵的力气还不能花太大。计算机就会用算法,像生物进化一样,在给定的空间里自动长出树枝一样的最优流道。有同行用这方法,和直通道比,温度又低了4度多,水流阻力还降了三成。这就好比原先你开车走迷宫老堵车,现在AI给你修了条定制高架。

2. 仿生设计:拜大自然为师荷叶的脉络、鲨鱼的皮纹路,那都是几亿年进化出的高效流体网络。我们模仿荷叶叶脉做了岐管环状微通道,你猜怎么着?能散掉近2000W的热,压降比传统设计低了一半,温度还更均匀了。特别是AI训练那种干活一阵一阵的场景,它扛得住温度波动,皮实得很。

3. AI生成式设计:工程师也得请算法帮忙更绝的是,现在有条新路子,叫生成式设计。你把芯片的热地图、进出水口位置告诉AI,它就能自己“画”出最适合这颗芯片的冷板拓扑。有人给NVIDIA GB200超级芯片这么干过,结果比传统平行通道的平均温度低了5°C,最热点直接狂降35°C。这相当于给每个芯片都做了件量身定制的“散热内衣”。

4. 做出来:从车床铣削到3D打印、类半导体工艺传统的CNC就像用凿子雕,细活受限。现在用3D打印,能在铝板上做出180微米级的毛细管,精准给高发热区“打点滴”。更狠的Frore Systems公司,用类似造芯片的蚀刻、键合工艺来做冷板,流道精细到三维短回路,压损降到原来的四分之一,单是冷板本身就能扛住600 W/cm²的热流密度,为下一代4000多瓦的怪兽芯片备好了“退烧贴”。

5. 终极目标:把水道刻进芯片里上面这些还都是把冷板扣在芯片外壳上,中间隔着好几层导热材料,就像隔着棉袄扇扇子。最根本的散热,是直接在芯片的硅片内部刻微通道,让冷却液贴着发热点流动,这叫硅基嵌入式微通道。这招尤其能救3D堆叠芯片的命——芯片像叠罗汉一样,中间那层热量根本出不来,自己流进去散热才管用。已经有团队验证,这能让温度直降40%以上。

相变冷却:给芯片“喝汽水”,咕嘟咕嘟带走热量

如果说微通道靠的是流量大、面积广,那相变冷却就是利用了“烧开水”的物理原理。水从液态变成气态,会吸收大量的热,这叫汽化潜热。热量搬运能力是纯靠水升温的几十上百倍。

1. 均热板:摊煎饼式的散热好手均热板其实就是个扁平的真空腔体,里面有点液体。芯片热点一烤,液体立刻蒸发,蒸汽跑到整个冷面冷凝,把“点状热”均匀铺成“面状热”,然后液体靠毛细结构自动爬回来。它就像个高效的二维热均摊器,现在散热能力已经能做到1400W。在服务器里,经常让它作为第一道工序,把热点先“摊薄”,再交给后边的冷板。

2. 两相冷板:让水在微通道里沸腾把相变和微通道一结合,威力就大了。冷却液在比头发丝还细的槽里边流边沸腾,吸热效率刷刷的。但有个难题,气堵在通道里,液体进不来,壁面就干烧了,这叫临界热流密度。北京大学一个团队搞了个绝活:他们用3D打印做出分层的供液歧管,气走气的道,液走液的道,谁也不碍着谁,还往芯片背面雕出多孔硅翅片,增加沸腾点。结果呢?用绝缘液体(不导电,安全)散走了610W的热,芯片温度才69°C,整个芯片表面高低温差压在了10°C以内。这就像给沸腾的水里装了个智能导流器,既能狂暴吸热,还不会炸锅。

3. 浸没式相变:把整台服务器扔进“不导电的火锅”更极端的,就是把服务器主板直接泡在一种特制的不导电冷却液里,沸腾吸热,蒸汽上升到顶上的冷凝盘管变回液体,循环利用。曙光数创的相变浸没液冷机柜,单机柜功率能干到900 kW以上,是传统液冷的3到5倍,散热能力超200 W/cm²,PUE低到1.04。这个能效,意味着一度电里有九毛六花在了计算上,几乎不浪费在冷却上。我亲眼见过那种咕嘟咕嘟沸腾的场面,真是“给算力烧开水”。

双剑合璧:散热正在变成“芯控温”

现在最先进的思路,是把微通道和相变揉在一起用。比如,先用均热板把热点摊薄,再用微通道冷板高效输运,最后来个两相沸腾的冷板精确控温。这套组合拳,能从局部1000 W/cm²的热流密度,逐级处理到系统层面不足100 W,实现了热量的“梯级搬运”。

更重要的是,散热正在变成一个智能闭环。我们不再是建个冷系统就完事,而是要让冷却系统随着芯片负载实时起舞。借助AI算法,比如强化学习,系统能预判计算任务会带来的发热量,提前调整泵速、水温,做到芯片级±1°C的精确控温。结果就是,芯片极少因为过热而降频,算力彻底释放,PUE稳定在1.10以下。这就是从“散热”到“控温”的质变——热管理已经从保障设备不坏的配角,变成了决定算力能跑出多少分的主角。

未来已来,挑战不减

接下来,随着3D堆叠芯片走向量产,热量就像三明治夹心,逼着我们必须在芯片内部雕刻微通道,同时兼顾里面密密麻麻的通电孔。这不再是单纯的热工问题,而是需要从电路设计、封装、材料到微流体一把抓的系统工程。再远一点看,AI辅助的热设计、标准化模块化的液冷基础设施,会让顶级冷却技术从超算中心飞入寻常的数据中心。

我干了二十年,最大的感触是:做热管理,永远是在和“热”赛跑。以前我们跟在芯片后面跑,渐渐地,我们要和它并肩跑,甚至跑到前面去引领它。这行,正变得越来越有搞头。

夜雨聆风

夜雨聆风