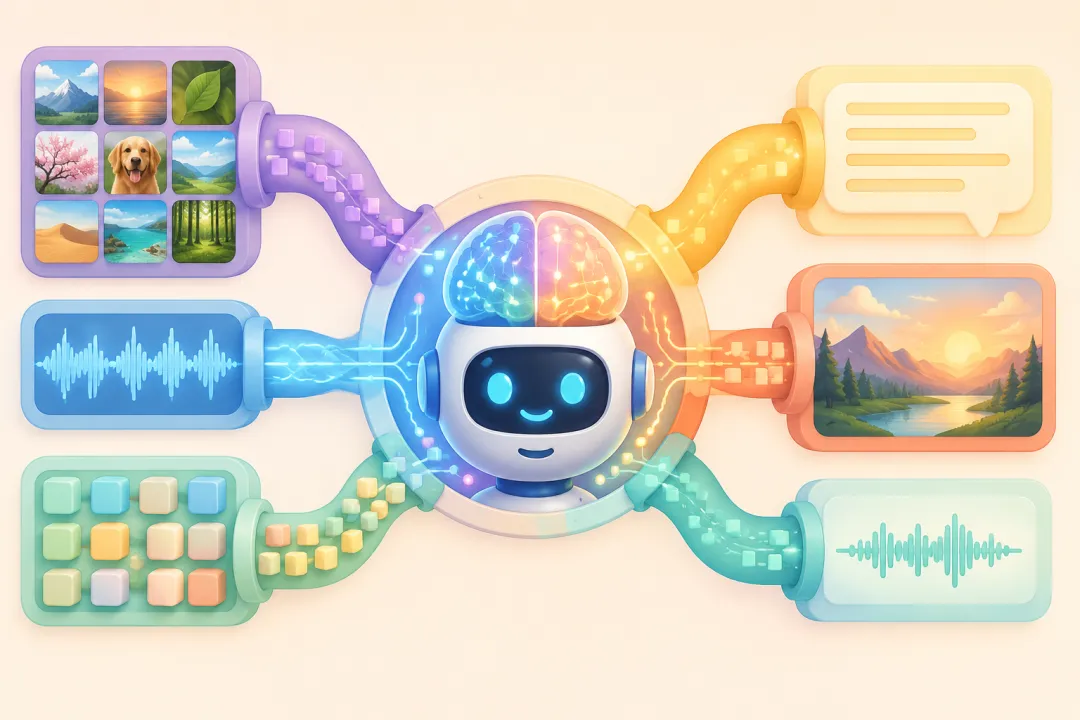

ChatGPT 只能处理文字。但现在的 AI 能看图、听声音、甚至看视频。它是怎么做到的?秘密是:把所有东西都变成同一种"语言"。

一个"全能"的 AI

大宝最近发现了一件事:

"爸爸,我给 ChatGPT 发了一张照片,它居然能告诉我照片里是什么!"

"对啊,现在的 AI 不只能读文字了。"

"那它是怎么'看'照片的?它又没有眼睛。"

好问题。上一篇我们讲了 ChatGPT 是怎么学会"听话"的。但那时候的 ChatGPT 只能处理文字——你发图片给它,它看不懂。

现在的 AI(比如 GPT-4、Gemini)不一样了。你可以:

- • 发一张数学题的照片,它帮你解题

- • 发一段语音,它听懂并回复

- • 让它根据你的描述画一张图

- • 甚至给它看一段视频,它能告诉你视频里发生了什么

从"只会读文字"到"能看能听能说"——这个跨越是怎么实现的?

秘密:把所有东西变成"积木"

还记得第 4 篇讲的 Transformer 吗?它处理的是一串"Token"(小块)。

关键洞察来了:

不只是文字可以拆成 Token。图片、声音、视频——所有东西都可以。

- • 文字 → 拆成词或字 → 每个词是一个 Token

- • 图片 → 切成小方块(比如 16×16 像素)→ 每个方块是一个 Token

- • 声音 → 切成短片段(比如 0.02 秒一段)→ 每个片段是一个 Token

- • 视频 → 切成一帧一帧 → 每帧再切成小方块 → 每个方块是一个 Token

一旦所有东西都变成了 Token,就可以用同一个 Transformer 来处理。

就像乐高积木——不管你要搭房子、搭汽车还是搭飞机,用的都是同一种积木块。只是拼法不同。

CLIP:教 AI "图文对照"

但光把图片切成 Token 还不够。AI 还需要知道"这些图片 Token 跟文字 Token 是什么关系"。

2021 年,OpenAI 做了一件很聪明的事:

他们从互联网上收集了 4 亿对"图片 + 文字描述"。比如:

- • 一张猫的照片 + "一只橘色的猫趴在沙发上"

- • 一张日落的照片 + "海边的夕阳"

然后训练一个模型(叫 CLIP):让匹配的图文对"靠近",不匹配的"远离"。

训练完之后,CLIP 学会了一个"通用语义空间"——在这个空间里,文字和图片说的是同一种"语言"。

这就是为什么你能用文字描述让 AI 画图,也能给 AI 看图让它用文字描述。 因为在 AI 的"脑子"里,文字和图片已经是同一种东西了。

多模态大模型:拼积木

有了这个基础,造一个"全能 AI"就变得很直接:

- 1. 看图:用一个"视觉编码器"把图片变成 Token

- 2. 听声音:用一个"音频编码器"把声音变成 Token

- 3. 拼在一起:把图片 Token、声音 Token、文字 Token 拼成一长串

- 4. 送进 Transformer:让它一起处理

就像你把不同颜色的乐高积木混在一起,然后用同一双手来拼——Transformer 不在乎 Token 是从文字来的还是从图片来的,它只管处理 Token 之间的关系。

GPT-4、Gemini、Claude——今天所有最强的 AI,都是这个思路。

从"理解"到"生成"

更厉害的是:AI 不只能"看懂"图片,它还能"画"图片。

原理也是一样的:

- • 理解 = 把图片变成 Token,然后用 Transformer 理解

- • 生成 = 用 Transformer 生成 Token,然后把 Token 变回图片

所以现在的 AI 能做到:

- • 你说"画一只穿西装的猫" → 它生成图片

- • 你给它一张照片说"把背景换成海滩" → 它修改图片

- • 你说"把这段文字变成一个 30 秒的视频" → 它生成视频

万物皆 Token,万物皆可生成。

🧪 动手实验:跨模态游戏

准备: 能用 ChatGPT(带图片功能)或其他多模态 AI

玩法 1:看图说话

- • 拍一张你房间的照片,发给 AI

- • 让它描述照片里有什么

- • 看看它能不能发现你故意放的"奇怪东西"(比如把一只鞋放在书架上)

玩法 2:说话画图

- • 用文字描述一个场景:"一只企鹅在沙漠里吃冰淇淋"

- • 让 AI 画出来

- • 然后把画好的图再发给 AI,问它"这张图里画的是什么?"

- • 它能准确描述回来吗?(文字→图片→文字,看信息有没有丢失)

玩法 3:听声辨物

- • 如果你的 AI 支持语音,试试用不同的语气说同一句话

- • "我很开心"(用开心的语气 vs 用难过的语气)

- • AI 能听出你的情绪吗?

👨👩👧 亲子挑战(8-12 岁 + 家长)

"AI 翻译官"游戏:

- 1. 孩子画一幅画(随便画什么)

- 2. 拍照发给 AI,让 AI 用文字描述

- 3. 把 AI 的描述念给家长听(不让家长看画)

- 4. 家长根据描述猜孩子画的是什么

讨论:AI 的描述准确吗?它漏掉了什么?它"看"画和人"看"画有什么不同?

🤔 深度思考题(12-16 岁)

- 1. AI 把图片、文字、声音都变成 Token 来处理。人类的大脑也是这样吗?我们的视觉、听觉、语言是在同一个"空间"里处理的,还是分开的?

- 2. AI 能"看图说话",但它真的"看懂"了图片吗?还是只是学会了"图片 Token 和文字 Token 之间的统计关系"?"看懂"到底意味着什么?

- 3. 如果 AI 能同时处理所有感官信息(看、听、触、嗅、味),它会不会更接近"真正的智能"?还是说智能不只是感官的问题?

🧠 想知道这些题的答案?

每道题都有详细的参考思路和延伸讨论。

关注公众号「大鱼北游」,回复「答案7」免费获取本篇完整解析。

下一篇预告

第 8 篇:「AI 助手是怎么帮人干活的?——从"回答问题"到"完成任务"」

现在的 AI 不只能聊天了——它能帮你搜信息、写代码、订机票、甚至操作你的电脑。从"你问它答"到"你说一句它帮你做完",中间差了什么?下一篇,我们来看 AI Agent 是怎么工作的。

觉得有启发?点个「在看」让更多家庭看到 👀

转发给身边有娃的朋友,一起搞懂 AI 🚀

夜雨聆风

夜雨聆风