我用了 Claude Cowork 默认模型Sonnet 4.5,。日常写文章、读文件、搜资料,大部分时候够用。

但有两件事,默认模型做起来吃力。一是读超长文件——八十页的文件PDF 丢进去,靠后的条款它会漏。二是有时需要一步接一步推好几层的问题,它推到第三层就开始跳步。

我问了一个搞开发的朋友,他说这不是Claude 的问题,是默认模型本身的定位——它设计出来做通用问答很强,但面对「一次吃一整本书」或者「一件事分五步推理」这种任务,就得换一个专门干这个的引擎。

他让我试 DeepSeek 刚发布的 V4 Pro。国产模型里第一个做到100万 token 上下文的,同时推理链也更长。说人话就是:一次能读三本书的量,复杂问题会在脑子里多转两圈再回答。

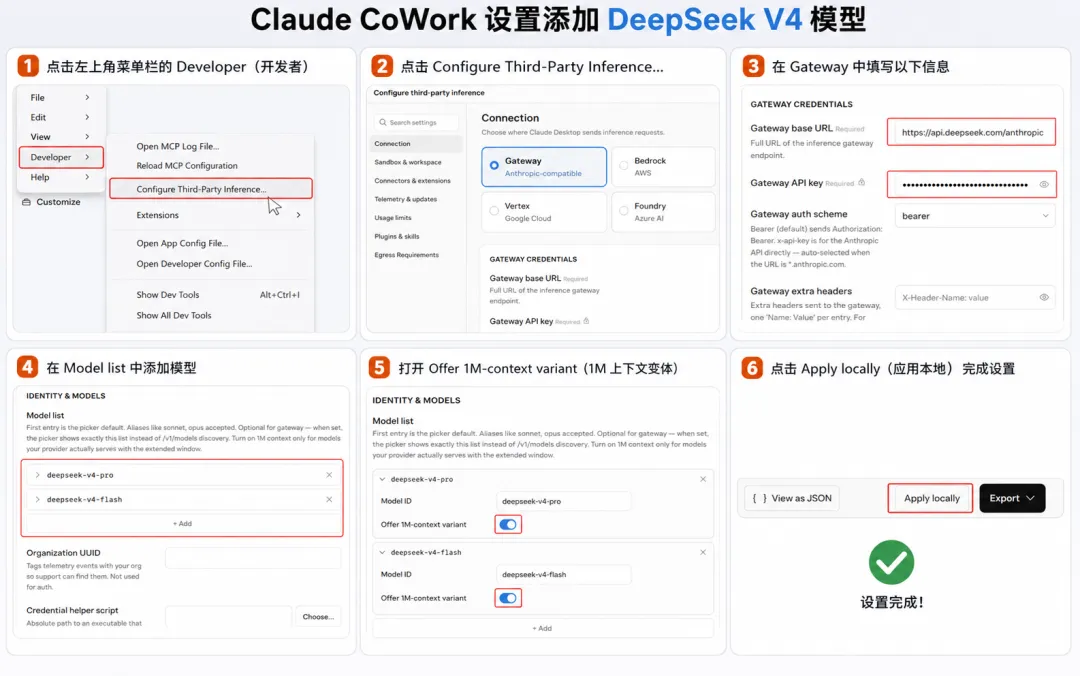

丨 操作步骤如下

第一步:拿到 DeepSeek 的 API Key。去 DeepSeek 官网开发者平台注册(有账号就跳过),创建一个 API Key。这串字符就是钥匙。费用是充值制,百万 token 几块钱——写一篇文章的成本比你发一条短信还便宜。

第二步:进入第三方推理配置。在 Cowork 界面里点击 Developer,再点击 Configure third-party inference。

第三步:填 Gateway 信息。Gateway 不用改,保持默认。Gateway Base URL 填入 https://api.deepseek.com/anthropic,Gateway API key 填入你在 DeepSeek 申请的 API Key。

第四步:填模型列表。Model list 填入 deepseek-v4-pro 和 deepseek-v4-flash。然后把 Offer 1M-context variant 打开——这一步很多人漏掉,但它是 V4 Pro 发挥 100 万上下文能力的关键开关。

第五步:Apply locally,完成。点击 Apply locally,搞定。之后在模型选择下拉菜单里就能看到 deepseek-v4-pro 了。

我帮朋友走过这个流程,十五分钟搞定。他的评价是:「就这?我以为要装什么编程环境。」不需要编程,不需要命令行,全程在界面里点点点。

丨 换了之后,什么样的任务提升最明显

长文写作。文章超过一千五百字之后,默认模型开始出现「忘了前面写过什么」的问题。V4 Pro 不会。我现在写这种长度的文章,一定切到 V4 Pro。

读超长文件。八十页的 PDF 发过去,找跟「违约金」有关的所有条款。默认模型会漏掉靠后的部分,V4 Pro 全读进去,找出来七条,我核对了一遍,一条没漏。

需要多步推理的任务。「帮我规划三天旅行,预算三千,带腿不好的老人,同时对比三个酒店每个列五个维度打分,最后输出表格」。普通 AI 大概率只做其中两步,后面糊弄了。V4 Pro 稳稳当当全跑完。

日常聊天、简单问答、翻译几句话——这些用默认模型就够了。但遇到上面这三类任务,换引擎的差别,用一次就能感觉到。

接入之后最大的感受:我终于不用因为 AI 记性不好而反复解释上下文了。

以前每次打开一个新对话,我都要重新交代一遍背景。现在我把背景资料一次性丢进去,后面不管开多少轮对话,它都记得。这个「不用重复交代」的价值,比任何单项能力提升都大——因为它省的不是一次回答的时间,是每一次打开对话窗口都要重复的那段前摇。

今天试试:如果你在用 Claude Cowork,花十五分钟按上面的步骤接入 DeepSeek V4 Pro。然后用同一个长问题对比一下默认模型和 V4 Pro 的回答——你会回来谢我的。

— END —

帮你打破AI信息差的人。不写论文,不卖课,只讲你用得上、听得懂的AI干货。

信息来源:DeepSeek 官方文档 · 个人实操经验

夜雨聆风

夜雨聆风