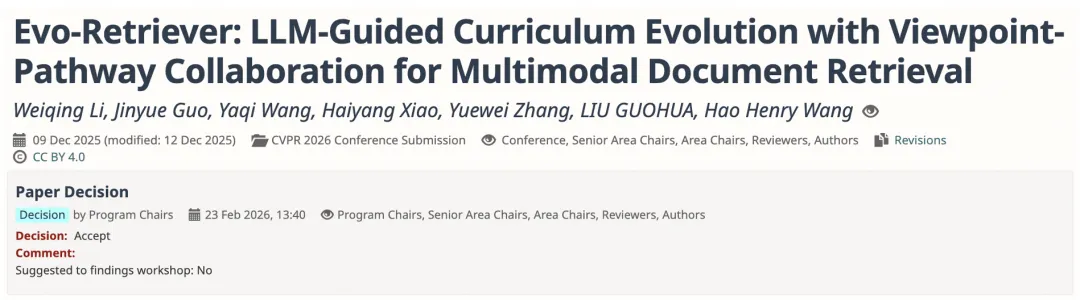

阿里云在复杂视觉文档检索和多模态对齐方向获得突破性成果,再次入选CVPR

近日,阿里云专有云团队的《Evo-Retriever: LLM-Guided Curriculum Evolution with Viewpoint-Pathway Collaboration for Multimodal Document Retrieval》论文成功入选计算机视觉领域顶级会议CVPR 2026主会。该论文首创“模型-课程协同进化”范式,通过LLM元控制器动态调整训练难度,解决静态训练限制。

CVPR评审委员会评价:“Evo-Retriever提出了一个可靠的多模态检索框架,面向多模态检索模型训练过程中难负样本静态阈值失效导致梯度衰减的痛点,引入LLM作为元控制器实现动态课程调度与自适应难负样本挖掘,规避噪声监督风险,设计具备前瞻性;结合多视图对齐和双向对比学习等设计,经充分消融验证,在ViDoRe V2、MMEB等基准及3B/7B模型上稳定取得一致性SOTA,展现强鲁棒性与应用价值。”

CVPR是计算机视觉和模式识别领域的最具影响力的顶级会议之一,在全球范围内具有重要影响力与广泛认可度。会议聚焦目标检测、图像分割、三维视觉、多模态学习与生成模型等人工智能前沿方向,代表该领域的国际最高研究水平,会议将于2026年6月3日至7日在美国科罗拉多州丹佛市举行。

技术突破

首创“模型-课程协同进化”范式

尽管现有视觉语言模型(VLMs)在数据映射方面表现优异,但现实场景中复杂的文档异构性和非结构化特征往往导致跨模态嵌入一致性受损。近期出现的后期交互方法通过多向量表征提升了图文对齐效果,但传统训练范式受限于样本规模与静态策略,难以适配模型的动态演进需求,最终引发检索结果混淆。

针对当前视觉语言模型(VLMs)在跨模态检索中的技术挑战,阿里云专有云团队提出了创新性解决方案,研发了Evo-Retriever多模态检索框架,该方案基于首创“模型-课程协同进化”范式,构建了大语言模型引导的课程进化体系,有效实现了跨模态表征的动态优化与精准对齐。

空间感知增强与语义消歧

利用多视图图像增强(MVA)技术,通过多尺度、多方向视角提升细粒度匹配能力,强化对文档布局变化的鲁棒性,并引入双向对比学习(BCL)及难负查询样本生成器,通过视觉与文本路径互补,有效锚定语义与视觉依据

LLM引导的动态课程

由大语言模型作为元控制器,根据训练状态自动调整负样本难度,筛选难负图像和难负查询,确保监督信号始终具有挑战性。

检索性能SOTA

在ViDoRe V2和MMEB基准测试中取得当前最优效果,nDCG@5分数分别达到65.2%和77.1%,验证了动态课程策略显著优于传统。

此次论文入选CVPR2026主会,不仅代表阿里云专有云团队在多模态检索领域创新实力已受到国际认可,更是“模型-课程协同进化”在业界创新落地的重要里程碑。从理论突破到SOTA性能验证,Evo-Retriever展现了阿里云在AI基础设施与算法深度融合上的深厚积累。

未来,阿里云专有云团队将继续秉持“技术驱动价值”的理念,深耕多模态与大模型前沿技术,推动更多技术成果创新转化为可落地的生产力。

目前,Evo-Retriever相关模型已在ModelScope开源,欢迎全球开发者下载体验,共创多模态检索新生态。

「模型下载链接」

3B版本:

https://www.modelscope.cn/models/Apsara-Stack-MaaS/EvoQwen2.5-VL-Retriever-3B-v1

7B版本:

https://www.modelscope.cn/models/Apsara-Stack-MaaS/EvoQwen2.5-VL-Retriever-7B-v1

/ END /

夜雨聆风

夜雨聆风