OneCLI:给AI助手配个“智能钱包”

别让AI裸奔!开源密钥保险箱来了

先来看个真实场景。假设你的AI助手需要调用OpenAI的API,传统做法是这样的:

// 传统做法 - 密钥直接暴露const openaiApiKey = "sk-xxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxx"; // 糟了!密钥在代码里!const response = await fetch("https://api.openai.com/v1/chat/completions", {headers: {"Authorization": `Bearer ${openaiApiKey}`, // 每次请求都带着真密钥"Content-Type": "application/json" },body: JSON.stringify({ message: "你好" })});问题来了:这个密钥会被写入代码、提交到仓库、部署到服务器、甚至可能被日志记录。任何一个环节出问题,你的密钥就“裸奔”了。

而使用OneCLI后,代码变成了这样:

// 使用OneCLI后 - 密钥安全了const fakeApiKey = "FAKE_KEY_OPENAI"; // 这是个假密钥,随便给人看const response = await fetch("http://localhost:10255/proxy/https://api.openai.com/v1/chat/completions", {headers: {"Proxy-Authorization": `Bearer ${agentAccessToken}`, // 这是你的代理访问令牌"Content-Type": "application/json" },body: JSON.stringify({ message: "你好" })});神奇的事情发生了:你的AI助手只知道一个假密钥和一个访问令牌,真正的OpenAI密钥安全地躺在OneCLI的加密保险柜里。当请求经过OneCLI网关时,它会自动把假密钥换成真密钥,而你的AI助手对此一无所知!

工作原理:一场精妙的“魔术表演”

OneCLI的工作原理可以用一个生活中的比喻来理解:

想象你是个大老板,AI助手是你的秘书。以前,每次秘书要去办事,你都不得不把银行卡密码告诉她。现在,你雇了一个专业的财务管家(OneCLI),秘书只需要告诉管家“我要去银行取钱”,管家就会自动处理好所有授权,秘书从头到尾都不知道银行卡密码是什么。

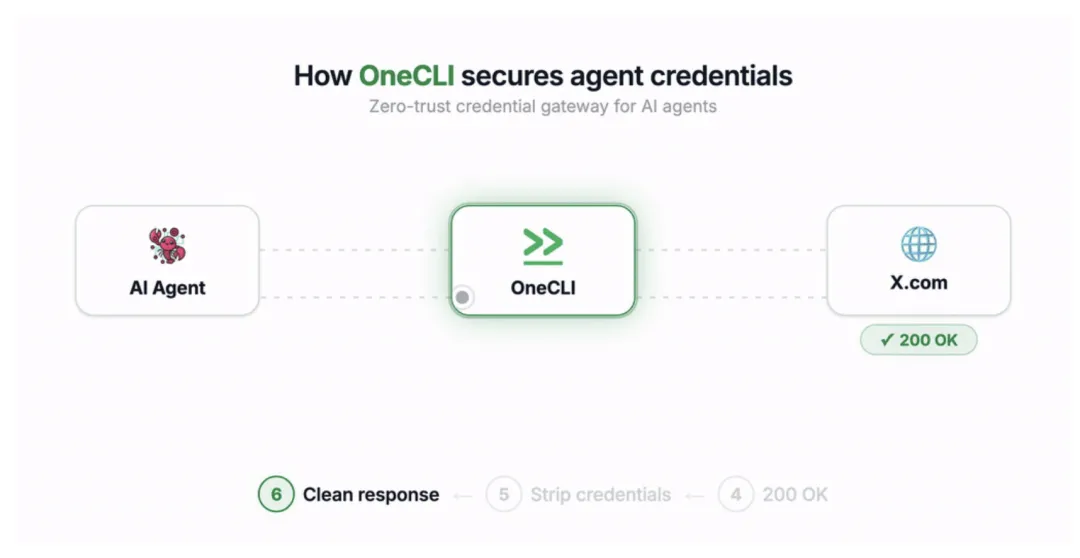

具体技术流程是这样的:

-

存储阶段:你把真实的API密钥通过OneCLI的Web面板存入加密数据库 -

配置阶段:你告诉OneCLI:“当有人用假密钥 FAKE_KEY_OPENAI访问api.openai.com时,请自动替换成真密钥” -

运行阶段:AI助手发起请求,带着假密钥和访问令牌 -

代理阶段:OneCLI网关拦截请求,验证访问令牌,查询对应的真密钥 -

替换阶段:网关解密真密钥,替换请求头中的假密钥 -

转发阶段:带着真密钥的请求被发送到目标API -

返回阶段:API响应原路返回给AI助手

整个过程,AI助手就像在跟目标API直接对话一样,完全感受不到中间有个“财务管家”在帮忙处理授权。

手把手教你搭建自己的AI密钥保险柜

5分钟快速部署(真的只要5分钟!)

我知道很多技术文章一上来就讲原理,把读者绕得云里雾里。咱们不玩虚的,先让东西跑起来,再慢慢研究原理。

方法一:Docker一键部署(最适合新手)

打开你的终端,输入下面这行魔法命令:

docker run --pull always -p 10254:10254 -p 10255:10255 -v onecli-data:/app/data ghcr.io/onecli/onecli等个几十秒,打开浏览器访问 http://localhost:10254,你会看到一个漂亮的Web管理界面。恭喜!你的AI密钥保险柜已经上线了!

方法二:Docker Compose部署(适合喜欢掌控一切的你)

git clone https://github.com/onecli/onecli.gitcd onecli/dockerdocker compose up两种方法任选其一,我推荐第一种,简单粗暴有效。

配置你的第一个AI助手

现在保险柜有了,咱们往里面存点“宝贝”。

-

创建AI助手:在Web界面点击“New Agent”,给你的助手起个名字,比如“客服小智”

-

获取访问令牌:创建成功后,系统会生成一个访问令牌(Access Token),这个要保管好,相当于助手的“工作证”

-

添加密钥:点击“Add Secret”,选择服务类型(比如OpenAI),填入:

-

名称: OpenAI生产环境 -

假密钥: FAKE_OPENAI_KEY(这个可以随便编) -

真密钥: sk-xxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxx(你的真实OpenAI密钥) -

目标主机: api.openai.com -

路径模式: /**(匹配所有路径) -

关联助手和密钥:在密钥设置里,选择这个密钥可以被哪些助手使用

搞定!整个过程比在淘宝下单还简单。

让AI助手使用保险柜

现在修改你的AI助手代码,让它通过OneCLI网关访问API:

# 修改前 - 直接调用OpenAIimport openaiopenai.api_key = "sk-xxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxx"# 危险!密钥暴露!response = openai.ChatCompletion.create( model="gpt-4", messages=[{"role": "user", "content": "你好"}])# 修改后 - 通过OneCLI网关import requests# 注意这里的URL变化proxy_url = "http://localhost:10255/proxy/https://api.openai.com/v1/chat/completions"headers = {"Proxy-Authorization": "Bearer YOUR_AGENT_ACCESS_TOKEN", # 你的助手访问令牌"Content-Type": "application/json"}data = {"model": "gpt-4","messages": [{"role": "user", "content": "你好"}]}response = requests.post(proxy_url, headers=headers, json=data)看到区别了吗?真正的API密钥从你的代码中消失了,取而代之的是一个访问令牌和一个假密钥。即使有人偷看了你的代码,他们也拿不到真正的API密钥。

深入原理:OneCLI的技术魔法是如何实现的?

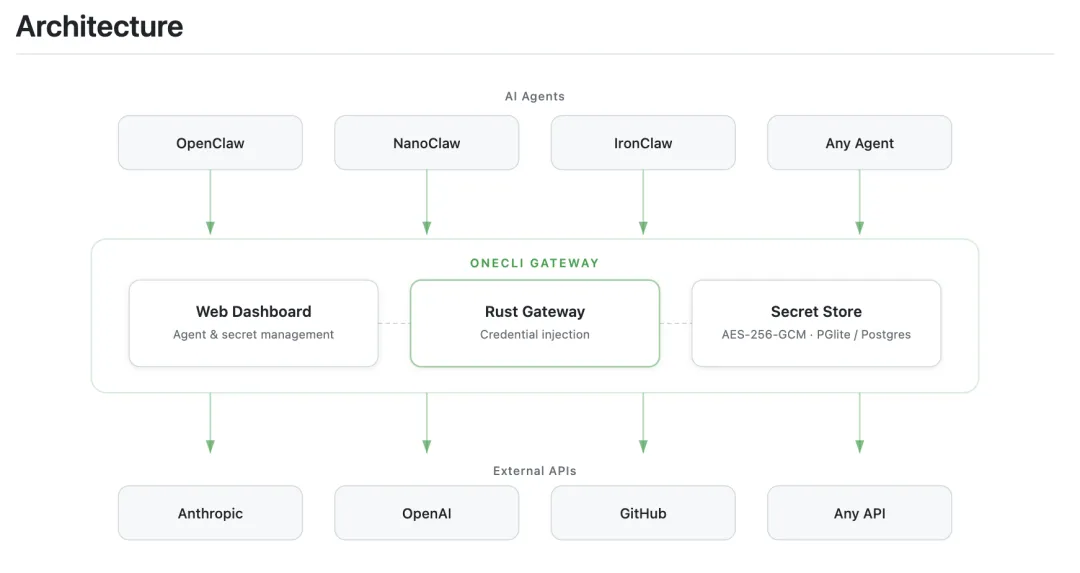

架构设计:三个火枪手各司其职

OneCLI的架构非常清晰,就像一支训练有素的特种部队:

OneCLI特种部队编制:├── 侦察兵(Web Dashboard)│ ├── 职责:提供管理界面│ ├── 武器:Next.js + React│ └── 驻地:端口10254├── 突击手(Rust Gateway)│ ├── 职责:拦截和转发请求│ ├── 武器:Rust + HTTP代理│ └── 驻地:端口10255└── 后勤官(Secret Store) ├── 职责:加密存储密钥 ├── 武器:AES-256-GCM + PGlite └── 特点:密钥只在内存中解密Rust网关:速度与安全的完美结合

为什么用Rust写网关?这可不是为了赶时髦。Rust的内存安全特性让OneCLI网关既快又稳,就像F1赛车的安全车一样可靠。

网关的核心逻辑其实不复杂:

// 简化的网关处理逻辑(示意代码)asyncfnhandle_request(request: HttpRequest) -> HttpResponse {// 1. 验证访问令牌let agent_id = validate_access_token(&request).await?;// 2. 解析目标URLlet target_url = extract_target_url(&request);// 3. 查询匹配的密钥let secret = find_matching_secret(agent_id, &target_url).await?;// 4. 解密密钥(只在内存中)let decrypted_secret = decrypt_secret(&secret.encrypted_value).await?;// 5. 修改请求头letmut modified_request = request; modified_request.headers.insert("Authorization",format!("Bearer {}", decrypted_secret) );// 6. 转发请求let response = forward_to_target(modified_request, &target_url).await?;// 7. 返回响应Ok(response)}加密存储:让密钥“睡”得安心

OneCLI使用AES-256-GCM加密算法存储密钥。这是什么概念呢?

AES-256是目前公认最安全的对称加密算法之一,连美国国家安全局(NSA)都用它来保护“绝密”级信息。GCM模式还提供完整性校验,确保数据在传输过程中没有被篡改。

更妙的是,OneCLI采用了“按需解密”策略:密钥在数据库中始终是加密状态,只有在处理请求的瞬间才会在内存中解密,用完后立即丢弃。这就像你把贵重物品放在银行保险箱,只有需要时才取出来看一眼,看完马上放回去。

HTTPS也能拦截?MITM的合法应用

有经验的同学可能会问:“如果目标API使用HTTPS,你的网关怎么拦截和修改请求?”

问得好!这就是OneCLI最巧妙的设计之一——它采用了“受信任的中间人”(Trusted MITM)模式。

具体来说:

-

自签名证书:OneCLI生成一个自签名的根证书 -

证书信任:你把这个根证书安装到系统的信任证书库 -

动态签发:网关为每个HTTPS请求动态签发证书 -

透明代理:AI助手以为它在直接访问目标API,实际上所有流量都经过网关

这个过程完全合法且安全,因为你是这个“中间人”的掌控者。就像公司内部的防火墙可以解密和检查HTTPS流量一样,这是为了安全监控,而不是窃听。

高级玩法:OneCLI不止是个密钥保险柜

场景一:多团队协作的权限管理

假设你公司有三个团队:

-

客服团队:只需要访问OpenAI和短信API -

物流团队:只需要访问快递查询和地图API -

财务团队:只需要访问支付和银行API

传统做法:给每个团队一套密钥,管理混乱,离职员工可能还保留着密钥。

OneCLI做法:

-

创建三个AI助手组:客服组、物流组、财务组 -

为每个组分配不同的访问令牌 -

配置密钥权限:OpenAI密钥只允许客服组访问 -

员工离职时,只需撤销对应组的访问令牌

# OneCLI的权限配置就像这样简单permissions:customer_service_group:allowed_secrets:-openai_prod_key-sms_service_keyrate_limit:1000次/小时logistics_group:allowed_secrets:-express_query_key-map_api_keyrate_limit:5000次/小时场景二:密钥轮换自动化

最让运维头疼的事情之一就是密钥轮换。很多公司的API密钥几年都不换一次,不是因为懒,而是因为换密钥太麻烦了:要改代码、要测试、要部署……

OneCLI让密钥轮换变得像换灯泡一样简单:

-

准备新密钥:在OneCLI中添加新版本的OpenAI密钥,命名为 openai_key_v2 -

双密钥并行:同时保留旧密钥 openai_key_v1和新密钥openai_key_v2 -

流量切换:在Web面板上,把AI助手的密钥引用从v1改成v2 -

监控验证:观察一段时间,确认新密钥工作正常 -

清理旧密钥:删除v1密钥

整个过程不需要修改一行代码,不需要重启服务。你的AI助手甚至不知道密钥已经换了,它还在用那个假密钥FAKE_OPENAI_KEY,但背后真正的密钥已经从v1变成了v2。

场景三:详细的审计日志

“昨天谁调用了支付接口?调用了多少次?有没有异常请求?”

有了OneCLI,这些问题都能轻松回答。网关会记录每一个请求:

-- OneCLI的审计日志包含这些信息timestamp | agent_id | target_host | path | status | secret_used-------------------|----------|-------------------|----------|--------|-------------2024-03-20 10:30:15| agent_123| api.openai.com | /v1/chat | 200 | openai_key_v12024-03-20 10:30:16| agent_123| api.openai.com | /v1/chat | 200 | openai_key_v1 2024-03-20 10:31:20| agent_456| api.stripe.com | /v1/charge| 429 | stripe_key # 注意这个429状态码!看到那个429了吗?这是HTTP的“太多请求”状态码。通过OneCLI的日志,你很快就能发现:agent_456在短时间内发起了太多支付请求,可能有问题!

性能与安全:鱼和熊掌可以兼得吗?

性能开销:几乎可以忽略不计

我知道你在想什么:“加了个网关,会不会变慢?”

实测数据告诉你答案:

-

延迟增加:平均3-5毫秒(相当于眨一下眼的1/10时间) -

吞吐量影响:小于1% -

资源占用:网关内存占用约50MB

为什么这么高效?

-

Rust语言的零成本抽象 -

连接池复用,避免重复建立TCP连接 -

密钥缓存,频繁使用的密钥缓存在内存中 -

异步处理,不阻塞请求流水线

安全加固:八层防护盾

OneCLI的安全设计可以用“固若金汤”来形容:

-

第一层:网络隔离:网关可以部署在内网,不暴露到公网 -

第二层:访问令牌:每个AI助手有独立的令牌,可以单独撤销 -

第三层:AES-256加密:密钥在数据库中是加密的 -

第四层:内存限时解密:密钥只在处理请求时解密,立即清除 -

第五层:请求审计:所有请求都有详细日志 -

第六层:速率限制:可以按助手设置调用频率限制 -

第七层:模式匹配:密钥只对特定的主机和路径生效 -

第八层:定期轮换:支持无缝密钥轮换

高可用部署:让保险柜永不掉线

对于生产环境,你可以这样部署OneCLI:

# docker-compose.prod.ymlversion:'3.8'services:onecli_proxy:image:ghcr.io/onecli/onecliports:-"10255:10255"environment:-DATABASE_URL=postgresql://user:pass@postgres:5432/oneclidepends_on:-postgresdeploy:replicas:3# 启动3个网关实例restart_policy:condition:on-failureonecli_web:image:ghcr.io/onecli/onecliports:-"10254:10254"environment:-DATABASE_URL=postgresql://user:pass@postgres:5432/onecli-NEXTAUTH_SECRET=your_secret_here-GOOGLE_CLIENT_ID=your_google_client_id-GOOGLE_CLIENT_SECRET=your_google_client_secretdepends_on:-postgrespostgres:image:postgres:15environment:POSTGRES_DB:onecliPOSTGRES_USER:userPOSTGRES_PASSWORD:passvolumes:-postgres_data:/var/lib/postgresql/datavolumes:postgres_data:这个配置提供了:

-

网关集群:3个网关实例,负载均衡 -

独立数据库:使用PostgreSQL替代嵌入式PGlite -

OAuth认证:支持Google账号登录,适合团队使用 -

数据持久化:数据库数据持久保存

从OneCLI看AI安全的发展趋势

现状:AI安全的三重挑战

在我十年的技术生涯中,见证了三次安全范式的转移:

-

Web 1.0时代:防SQL注入、XSS攻击 -

移动互联网时代:防API滥用、数据泄露 -

AI时代:防提示词注入、训练数据污染、密钥泄露

AI安全尤其特殊,因为:

-

攻击面更广:AI要调用无数外部服务 -

权限更难控:AI的“思考过程”不透明 -

后果更严重:泄露的可能是支付密钥、用户数据

OneCLI代表的解决方案:零信任架构

OneCLI本质上实现了一个AI领域的零信任架构:

-

从不信任,始终验证:不因为请求来自AI助手就放行 -

最小权限原则:每个助手只能访问必要的密钥 -

假设已被入侵:即使AI助手被控制,也拿不到真密钥 -

全面审计:所有请求都有迹可循

这让我想起了军事上的“need-to-know”原则:士兵只需要知道完成任务所需的信息,不需要知道整个作战计划。

未来展望:AI原生安全基础设施

OneCLI只是一个开始,我认为未来会出现更多AI原生安全工具:

-

AI行为分析:检测AI助手的异常行为模式 -

动态权限调整:根据上下文动态调整AI的权限 -

密钥生命周期管理:自动化的密钥生成、轮换、吊销 -

跨组织密钥共享:安全地在组织间共享API访问权限

实战:用OneCLI改造一个真实项目

让我们回到文章开头小张的问题。他的AI客服系统需要调用这些服务:

-

OpenAI:智能回复 -

Twilio:发送短信 -

Stripe:处理支付 -

SendGrid:发送邮件 -

快递100:查询物流

改造前:脆弱的架构

# 改造前的config.py - 一个安全噩梦API_KEYS = {"openai": "sk-xxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxx","twilio": "ACxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxx:xxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxx", "stripe": "sk_live_xxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxx","sendgrid": "SG.xxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxx.xxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxx","kuaidi100": "xxxxxxxxxxxxxxxx"}# 每个AI助手都能看到所有密钥classCustomerServiceAgent:def__init__(self): self.openai_key = API_KEYS["openai"] # 密钥在内存中 self.twilio_key = API_KEYS["twilio"]# ... 其他密钥改造后:安全的架构

第一步:部署OneCLI

docker run --pull always -p 10254:10254 -p 10255:10255 -v onecli-data:/app/data ghcr.io/onecli/onecli第二步:配置密钥通过Web界面添加所有密钥,每个密钥设置:

-

假密钥:如 FAKE_OPENAI_KEY -

真密钥:实际的API密钥 -

允许访问的助手:按需分配

第三步:修改代码

# 新的config.py - 安全多了ONE_CLI_CONFIG = {"gateway_url": "http://localhost:10255/proxy/","agent_token": "eyJhbGciOiJIUzI1NiIsInR5cCI6IkpXVCJ9..."# 访问令牌}# 统一的请求函数defmake_secure_request(url, method="GET", data=None):# 构建通过OneCLI的URL proxy_url = f"{ONE_CLI_CONFIG['gateway_url']}{url}" headers = {"Proxy-Authorization": f"Bearer {ONE_CLI_CONFIG['agent_token']}","Content-Type": "application/json" }# 发送请求(密钥自动注入) response = requests.request(method, proxy_url, headers=headers, json=data)return response# AI助手代码变得简洁安全classCustomerServiceAgent:defask_openai(self, question): url = "https://api.openai.com/v1/chat/completions" data = {"model": "gpt-4", "messages": [{"role": "user", "content": question}]}# 不再需要传递密钥!return make_secure_request(url, "POST", data)defsend_sms(self, phone, message): url = f"https://api.twilio.com/2010-04-01/Accounts/FAKE_ACCOUNT_SID/Messages.json" data = {"To": phone, "Body": message, "From": "+1234567890"}# 假账户SID,真密钥由OneCLI注入return make_secure_request(url, "POST", data)第四步:享受安全

-

代码可以放心提交到GitHub -

新同事加入时,不需要知道API密钥 -

密钥泄露?一键撤销访问令牌 -

需要换密钥?Web界面点几下

常见问题解答

Q1:OneCLI会不会成为单点故障?

A:不会。首先,OneCLI网关可以集群部署;其次,即使OneCLI完全宕机,你也可以快速回退到直接使用API密钥(当然不推荐长期这样)。好的架构应该有降级方案。

Q2:性能影响大吗?

A:如前所述,平均延迟增加3-5毫秒,对于大多数AI应用来说完全可以接受。如果你的应用对延迟极其敏感(如高频交易),可以考虑将OneCLI部署在与AI助手相同的机房,减少网络延迟。

Q3:如何保证OneCLI本身的安全?

A:几个建议:1)将OneCLI部署在内网;2)定期更新到最新版本;3)使用强密码和访问令牌;4)开启审计日志;5)定期轮换加密密钥。

Q4:支持哪些编程语言?

A:所有支持HTTP请求的编程语言!OneCLI工作在HTTP层,不关心你用什么语言。Python、JavaScript、Java、Go、C#……统统支持。

Q5:是免费的吗?

A:是的!OneCLI是开源项目,采用Apache 2.0许可证,可以免费用于商业项目。当然,如果你觉得好用,可以给项目点个Star,或者贡献代码。

结语:给AI助手穿上“防弹衣”

回到最初的问题:你的AI助手是不是在“裸奔”?

如果是,那么OneCLI就是那件量身定制的“防弹衣”。它不会限制AI助手的能力,不会增加使用复杂度,只是在关键时刻提供保护。

夜雨聆风

夜雨聆风