AI能力的“边界意识”:别让工具,成为你的“认知陷阱”

打开ChatGPT写方案、用Midjourney做海报、靠AI润色文案……如今,AI早已渗透到工作和生活的方方面面,成为我们离不开的“高效助手”。但越依赖,越容易陷入一个误区:把AI当成“万能神手”,默认它能解决所有问题,却忽略了——任何能力都有边界,AI也不例外。

所谓AI的“边界意识”,本质上是我们对AI能力的清醒认知:它能做什么、不能做什么,它的“聪明”背后藏着怎样的局限,以及我们该如何合理驾驭它,而不是被它牵着走。今天,我们就从理解、思考、实践三个维度,聊透AI的边界,建立正确的AI使用观。

先搞懂:AI的“聪明”,其实是“伪装”的

很多人觉得AI越来越“像人”,能对话、能创作、能分析,但其实,它和人类的“智能”有着本质区别——AI没有真正的“意识”,它的所有输出,都是基于数据的“模仿”和“计算”,而非“理解”和“思考”。具体来说,有三个核心局限:

AI不理解“意义”,只懂“匹配”

你让AI写一篇关于“亲情”的文案,它能快速输出流畅的文字,堆砌温暖的词汇,但它永远不懂“亲情”背后的牵挂、陪伴与羁绊;你让AI解读一首古诗,它能说出字面意思、创作背景,却无法体会诗句里的家国情怀、儿女情长。

AI的核心逻辑是“数据匹配”:它从海量文本中学习“什么语境用什么词”“什么问题对应什么答案”,却无法真正理解文字、图像、声音背后的情感、价值和意义。就像一个背熟了所有菜谱的机器人,能做出和大厨一模一样的菜,却永远不懂这道菜里的匠心与温度。

AI不知道自己“对不对”,只懂“概率”

你问AI一个专业问题,它会自信满满地给出详细答案,甚至标注“权威解读”,但你永远不能直接相信——因为AI没有“纠错能力”,它不知道自己的答案是对是错,只知道“这个答案在数据中出现的概率最高”。

这就是为什么AI会出现“一本正经地胡说八道”:比如把错误的历史事件、虚假的学术观点当成正确信息输出,比如计算时出现低级错误,却依然语气坚定。它没有“自我审视”的意识,也没有“对错”的概念,所有输出都是基于数据的“概率判断”,而非“事实判断”。

AI不具备“目标意识”,只懂“执行”

你给AI一个明确指令,比如“写一篇产品推广文案”,它会按照你的要求执行;但如果你只说“帮我提升产品销量”,AI就会陷入迷茫——它不知道该从哪里入手,该优先做什么,该规避什么风险。

AI没有自己的“目标”和“诉求”,它不会主动思考“这个方案是否符合品牌调性”“这个策略是否能达到预期效果”,它只是被动执行人类给出的指令,无法像人类一样,根据目标灵活调整方向、优化方案。简单说,AI是“优秀的执行者”,但绝对不是“合格的决策者”。

AI的“不稳定”:不是缺陷,是必要特性

了解了AI的核心局限,我们再进一步思考两个关键问题——这些问题,决定了我们如何正确使用AI,避免踩坑。

AI的错误,是“bug”还是“必然现象”?

很多人遇到AI出错,第一反应是“AI出bug了”,觉得只要修复漏洞,AI就能避免错误。但其实,大部分AI的错误,并不是“bug”,而是它的“本质局限”带来的“必然现象”。

因为AI的知识来源于“训练数据”:如果数据有偏差、有遗漏、有错误,AI就会学到错误的信息;如果遇到超出训练数据范围的问题,AI就会“瞎猜”,给出不合理的答案。哪怕是最先进的AI模型,也无法覆盖所有场景、所有知识,更无法避免“概率判断”带来的误差。

所以,我们不必期待AI“零错误”,更不能把AI的错误当成“偶然事件”——接受AI会出错,学会验证AI的输出,才是正确的心态。

哪些任务,绝对不应该交给AI?

AI能帮我们节省时间、提高效率,但有些任务,无论AI多强大,都不应该交给它来做。核心判断标准是:需要“意义理解”“价值判断”“情感共鸣”“风险承担”的任务,都不适合交给AI。

比如,医疗诊断(需要结合患者的具体情况、医生的临床经验,AI无法替代人类的判断)、法律判决(需要兼顾法律条文和人情世故,AI无法理解复杂的人性与社会规则)、情感疏导(需要真正的共情能力,AI的安慰只是冰冷的文字)、核心决策(需要承担风险,AI无法对结果负责)。

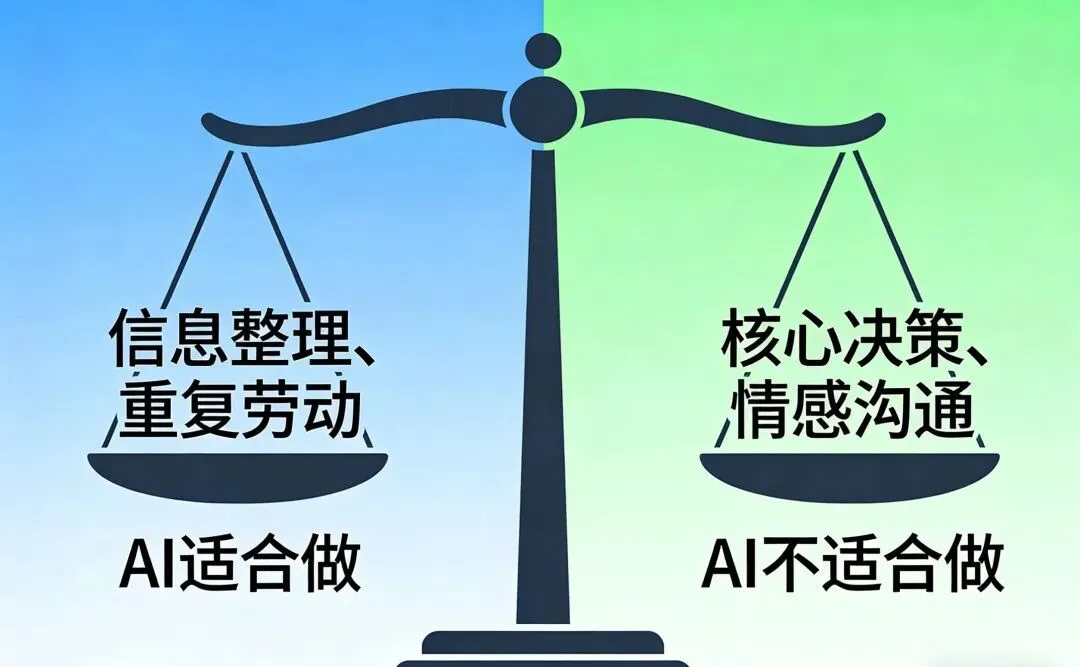

简单说:AI可以帮你“做事情”,但不能帮你“做决定”;可以帮你“整理信息”,但不能帮你“判断价值”。

实操指南:AI适合做什么?不适合做什么?

结合前面的分析,我们整理了一份“AI使用清单”,清晰划分AI的“能力边界”,帮你避开误区、高效利用AI:

✅ AI适合做的事(高效省力,解放双手)

-

信息整理与归纳:比如整理会议纪要、汇总行业资讯、提炼文章重点,快速把杂乱的信息结构化。

-

重复性劳动:比如排版、校对、翻译(简单场景)、数据录入,替代繁琐的手工操作,节省时间。

-

创意辅助:比如生成文案初稿、设计草图、构思方案框架,给你灵感启发,减少从零开始的难度。

-

基础分析:比如简单的数据统计、关键词挖掘、趋势分析,帮你快速获取基础结论。

❌ AI不适合做的事(易踩坑,需谨慎)

-

核心决策:比如公司战略制定、项目方向判断、重大投资决策,需要承担风险和责任,AI无法替代人类。

-

专业判断:比如医疗诊断、法律辩护、学术研究(核心观点),需要专业知识和实践经验,AI的输出需严格验证。

-

情感相关:比如情感疏导、心理咨询、亲密关系沟通,需要共情和真诚,AI的回应缺乏温度和针对性。

-

原创核心内容:比如个人观点输出、品牌核心文案、学术论文(原创部分),AI的创作缺乏独特性和思想深度。

5条核心AI世界观认知,帮你守住边界

最后,我们用5条核心认知,总结今天的内容,帮你建立正确的AI世界观,合理驾驭这个强大的工具:

-

AI是“工具”,不是“替代者”:它能帮我们提高效率,但不能替代人类的思考、判断和情感。

-

AI的“聪明”是模仿,不是理解:它没有意识,没有情感,所有输出都是基于数据的概率判断。

-

接受AI会出错:AI的错误是本质局限带来的必然现象,验证AI的输出,是使用AI的基本前提。

-

明确AI的边界:需要意义、价值、情感、责任的任务,坚决不交给AI。

-

人类的核心价值,是AI无法替代的:创造力、共情力、判断力、责任感,才是我们最珍贵的能力。

其实,AI的边界,本质上是我们人类认知的边界。当我们清楚地知道AI能做什么、不能做什么,既不高估它的能力,也不低估它的价值,才能真正让AI成为我们的“助力”,而不是“陷阱”。

未来,AI会越来越强大,但无论它发展到什么程度,守住“边界意识”,保持人类的独立思考,才是我们与AI相处的最佳方式。

愿我们都能在AI时代,既懂工具,也守本心,让技术为我们赋能,而非绑架我们的思考。

夜雨聆风

夜雨聆风