我用了三天配好的AI工具,被一个不用MCP的项目一句话气到了

去年年底,我折腾了一个MCP服务器,前前后后花了三天。

调通的那一刻,我觉得自己挺厉害的。

然后我看到有人在讨论OpenClaw。有人问他们为什么没有用MCP,得到的回答只有一句话:

「CLA能做的,MCP做不到;MCP能做的,CLA也能做。」

我盯着这句话看了很久。

那三天,突然不值钱了。

MCP是什么,以及它为什么让人又爱又恨

MCP(Model Context Protocol)是Anthropic推出的一套工具调用协议。

简单说,就是给AI装插件。你写一个server,定义好工具的输入输出,AI就能通过这个接口调用各种能力——搜索、查数据库、发邮件、操作文件,等等。

理念很美好。

社区也确实热闹了一阵。

但用过的人,大多都有这种体验:

一开始兴冲冲,写server,配schema,调试JSON。搞定之后发现,这个工具只在当前客户端能用。换一个环境,全得重来。任务稍微超出预设范围,AI就卡壳,什么都做不了。

X上有工程师吐槽,说为了让AI帮他查一下内部Wiki,他写了整整一个下午的MCP server,最后发现如果直接让AI开浏览器去找,十分钟就完事了。

评论区一片共鸣。

这种共鸣背后,是一个真正的问题:

MCP的设计逻辑,是不是从一开始就走偏了?

01 工具的本质是限制,不是赋能

听起来有点反直觉,但仔细想想不难理解。

每一个工具,都是对能力的一次具体化。

你设计了一个”搜索工具”,AI就只会在这个工具里搜索。

你设计了一个”发邮件工具”,AI就只能按你预设的格式发邮件。

工具的边界,就是AI能力的边界。

而人类能预设的工具,永远跟不上真实任务的复杂性。

现实里的任务不是这样的。

现实里的任务是:帮我把这份报告里的数据,整理成表格,发给对应的人,然后在日历上帮我定一个讨论会议。

这个任务要穿越多少个工具的边界?

如果每一个步骤都要有人预先写好对应的MCP server,那AI所谓的”自主能力”,不过是人类脚本的另一种包装而已。

一位做AI基础设施的工程师说过一句话,我觉得很到位:

「我们花了大量时间告诉AI能做什么,却忘了问AI想怎么做。」

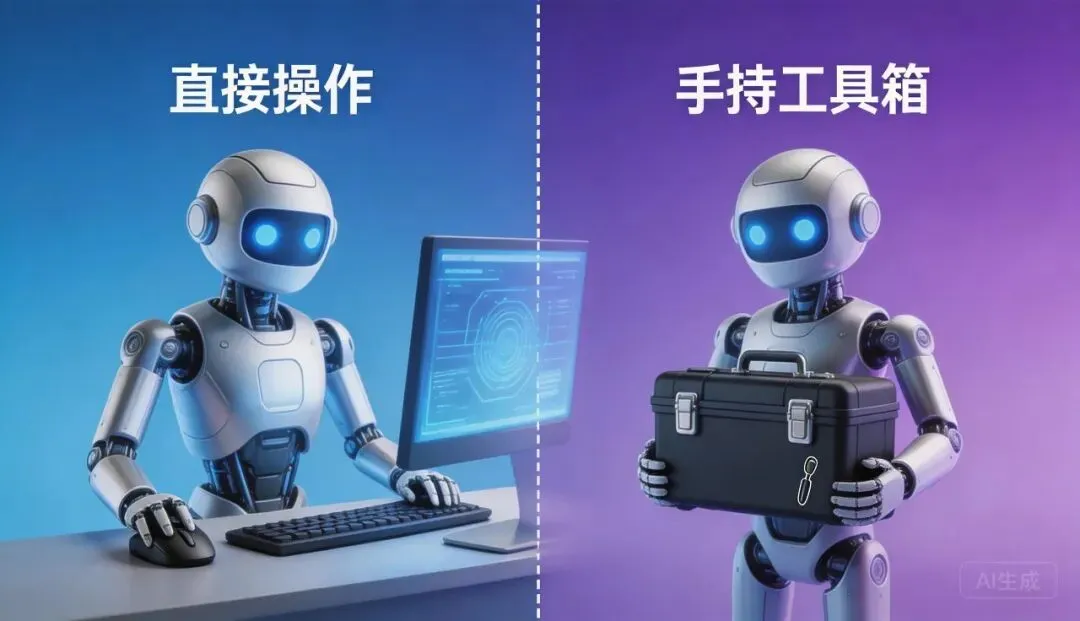

02 CLA给的不是工具,是一双手

CLA模式(Claude Computer Use,也是OpenClaw采用的核心架构)的逻辑,和MCP截然不同。

它不给AI装插件。

它给AI一个可以直接操作的环境——浏览器、终端、文件系统、GUI界面。

AI看到屏幕,移动鼠标,点击按钮,输入文字。

就像一个真正的人坐在电脑前工作一样。

没有预设接口,没有schema定义,没有server配置。

任务来了,AI自己想办法。

这个差异,听起来只是技术路线的不同,但背后的含义完全不一样。

MCP的世界里,AI的能力上限,是所有已经写好的工具的总和。

CLA的世界里,AI的能力上限,是AI自身的理解能力和规划能力。

哪个天花板更高,不用多说。

有人做过一个测试:同样的任务,让MCP方案和CLA方案各跑一次。MCP需要提前准备7个工具,CLA需要准备的是:什么都不用准备。

03 真正的AI原生,不需要插件市场

OpenClaw是一个很有意思的例子。

它能调浏览器、操作文件、发飞书消息、管理代码仓库、运行终端命令——能力覆盖面不比任何一个MCP生态差。

但它的核心架构里,几乎没有MCP的痕迹。

用的是什么?

CLA模式 + 原生tool-use的组合。

AI直接感知环境,直接规划行动,直接执行。

工具不是插件,而是AI的延伸。

这就是”AI原生”的真正含义——不是给AI一套人类设计好的工具体系,而是让AI在真实环境里直接解决问题。

一个用过这套架构的开发者说:「第一次看到AI自己打开浏览器查到我要的信息时,我突然理解了为什么MCP感觉越用越别扭。那不是AI在工作,那是AI在执行我写好的脚本。」

不是MCP不好,是它的前提假设过时了

我无意全盘否定MCP。

在某些场景下,它依然有价值——比如需要严格接口管理的企业环境,比如对安全边界要求极高的系统。

但有一个前提假设,正在快速失效:

AI需要人类预先定义好工具,才能行动。

当AI有了直接感知和操作环境的能力,这个假设就站不住脚了。

工具调用,会慢慢从”必要条件”退化成”可选选项”。

有些任务,你给AI一双手,比给AI一箱工具,更有用。

▽

有句话我一直记着:「技术的最高境界,不是功能越来越多,而是越来越少的东西,能做越来越多的事。」

MCP走的是加法。

CLA走的是减法。

历史一次次证明,减法更难,也更持久。

点个推荐,与朋友们共勉。

夜雨聆风

夜雨聆风