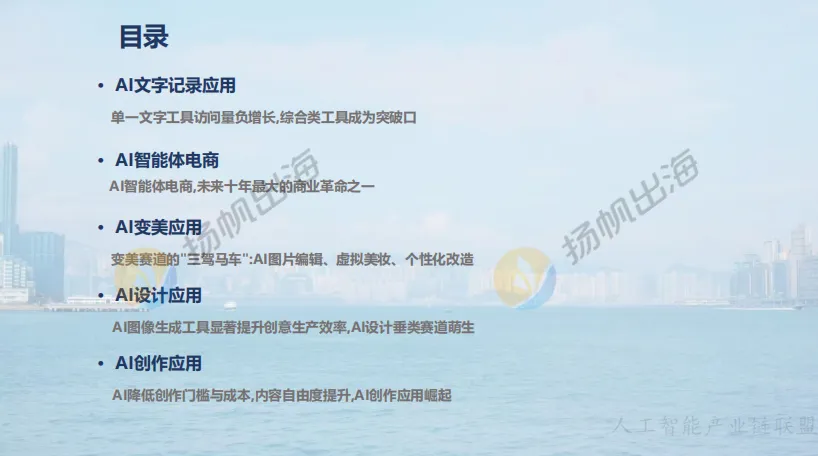

【报告】AI专题三:2025年AI工具类应用市场洞察报告——AI工具出海:小众赛道的“爆品逻辑(附PDF下载)

扬帆出海: 《2025年AI工具类应用市场洞察报告——AI工具出海:小众赛道的“爆品逻辑》 (完整版.pdf ) 以下仅展示部分内容 下载方式见文末 在AI原生时代,“本地部署”早已不是极客的专属游戏,而是每一位技术实践者、研发爱好者通往前沿技术的必经之路。从搭建WSL开发环境、部署Docker容器,到玩转多智能体框架、构建专属AI协作团队,本地算力的灵活运用,既能保障数据隐私,又能实现低成本的技术验证。

但理想很丰满,现实却充满“技术陷阱”——WSL与WiFi网卡驱动的莫名冲突、Docker容器的端口映射异常、多智能体框架的协同通信壁垒,每一个问题都可能让部署进程停滞数日。结合最新的本地开发实践经验与前沿技术适配方案,我们整理出这份《2026本地AI部署避坑指南》,从基础环境搭建、核心问题破解,到多智能体团队构建,全程拆解实操步骤、规避常见陷阱,兼顾专业性与实操性,排版适配公众号阅读习惯,可直接复制使用,助力你顺利打通本地AI部署的“最后一公里”。

前言:2026,本地AI部署进入“协同化”新阶段

2026年,本地AI部署的核心需求已从“单一模型运行”升级为“多框架协同、多智能体联动”。无论是探索量子计算与AI的融合算法,还是搭建区块链+AI的可信验证环境,亦或是组合Copaw、OpenClaw等智能体构建“数字人团队”,都需要稳定、灵活、可扩展的本地开发底座。

但与此同时,硬件与软件的兼容性问题愈发突出——尤其是Windows系统下,WSL(Windows Subsystem for Linux)与WiFi网卡驱动的冲突,成为困扰绝大多数本地开发者的核心瓶颈;Docker容器在跨系统通信、资源调度中的隐性问题,也让不少实践者踩坑不断。此外,多智能体框架的选型差异、协同协议不统一,进一步提升了本地部署的复杂度。

这份指南摒弃理论空谈,聚焦“问题解决”与“落地实操”,从基础环境准备到高阶场景落地,逐一拆解每一个环节的关键步骤、避坑要点与应急方案,既是新手入门的“通关手册”,也是资深开发者的“排障宝典”。

第一部分:基础环境筹备——硬件选型与系统配置,从源头规避冲突

本地AI部署的核心痛点,很多源于“前期筹备不足”。尤其是硬件兼容性、系统版本适配,直接决定了后续WSL、Docker的部署难度。2026年,结合AI模型、容器化技术的运行需求,做好前期筹备,能有效规避80%的兼容性问题。

一、硬件选型核心准则:优先解决“网卡与算力”适配

本地开发的硬件需求,无需追求“顶配”,但需围绕“AI计算”与“网络通信”两大核心做好选型,尤其是WiFi网卡,直接关系到WSL部署的成败。

CPU与内存:满足多容器与多智能体并行

推荐选择12核及以上的多核处理器(Intel i7-13700H及以上、AMD Ryzen 7 7840HS及以上),核心数越多,越能支撑WSL子系统、Docker容器、多智能体进程的并行运行。内存建议至少32GB DDR5,若计划部署7B参数以上的本地大模型,建议升级至64GB,避免因内存不足导致的进程崩溃、驱动异常。

WiFi网卡:避坑核心,优先选择“开源驱动兼容款”

这是规避WSL驱动冲突的关键!经大量实践验证,Realtek 8852BE、Intel AX210/AX211 系列网卡,与WSL 2的兼容性最佳,开源驱动支持完善,几乎不会出现“启动WSL后WiFi断连”“驱动程序崩溃”的问题。

避坑提醒:尽量避开部分小众品牌的AX200系列网卡、联发科MT7921K网卡,这类网卡的Linux内核驱动不完善,与WSL的虚拟化层通信时,极易触发冲突,导致WiFi无法使用。

显卡:兼顾本地推理与容器化调度

若仅做框架部署、智能体协同,无需高端显卡;若计划本地运行AI大模型,建议选择NVIDIA RTX 4060及以上型号(显存8GB及以上),需确保显卡支持CUDA 12.2及以上版本,为后续Docker容器内的模型推理提供算力支撑。

二、系统配置:Windows 11是唯一推荐,做好这3项核心设置

2026年,WSL 2与Docker的最新版本,已对Windows 11做了深度优化,强烈建议使用Windows 11 23H2及以上版本,Windows 10的兼容性问题较多,且微软已逐步停止对旧版本的WSL支持。

启用虚拟化功能:缺一不可的基础

首先进入BIOS开启虚拟化(Intel VT-x、AMD-V),不同品牌主板的开启路径不同,一般在“Security”“Advanced”栏目下。

随后在Windows中启用相关功能:按下Win+R,输入“optionalfeatures.exe”,勾选“适用于Linux的Windows子系统”“虚拟机平台”“Hyper-V”(三者缺一不可),点击确定后重启电脑。

更新驱动程序:优先安装“厂商定制版”

尤其是WiFi网卡驱动,不要盲目更新至最新通用版,建议前往电脑厂商官网(如联想、戴尔、华硕),下载对应机型的定制版网卡驱动,稳定性远高于通用版,能大幅降低与WSL的冲突概率。

同时,更新显卡驱动至最新版,确保CUDA、Docker的显卡直通功能正常运行。

关闭不必要的安全软件:避免拦截虚拟化进程

部分第三方安全软件(如某些杀毒软件、防火墙),会误将WSL的虚拟化进程、Docker的容器通信判定为“恶意行为”,导致部署失败或运行异常。建议部署期间临时关闭,或添加WSL、Docker的进程到白名单。

第二部分:核心痛点破解——WSL与WiFi网卡驱动冲突,全场景排障方案

WSL与WiFi网卡驱动的冲突,是2026年本地AI部署的“头号难题”,表现为“启动WSL后WiFi自动断连”“网卡驱动程序无响应”“WSL子系统无法联网”三大核心症状。结合最新的技术实践,我们整理了“预防方案”“应急修复方案”“终极替代方案”,覆盖不同场景的解决需求。

一、预防方案:全新部署WSL,从安装环节规避冲突

适用于“未安装WSL”的全新环境,通过规范的安装步骤,从源头避免驱动冲突,是最省心的解决方案。

步骤1:升级WSL至最新版本

以管理员身份运行命令提示符(CMD),依次执行以下命令,确保WSL为最新版:

wsl --update

wsl --shutdown(关闭所有WSL进程,确保更新生效)

步骤2:选择兼容的Linux发行版

并非所有Linux发行版都能完美适配网卡驱动,优先推荐Ubuntu 22.04 LTS,其内核版本(5.15.x)对主流WiFi网卡的驱动支持最完善,也是Docker官方推荐的基础镜像。

执行命令安装:

wsl --install -d Ubuntu-22.04,等待安装完成后,设置Linux用户名和密码。

步骤3:配置WSL网络模式,避开网卡直通冲突

WSL默认采用“NAT模式”联网,部分情况下会与WiFi网卡的网络栈冲突,建议修改为“桥接模式”,直接使用主机的网络适配器,降低驱动压力。

具体操作:创建并编辑WSL配置文件,在CMD中执行

notepad %USERPROFILE%.wslconfig,在文件中输入以下内容并保存:[wsl2]

networkMode=bridged

vmSwitch=WSL桥接交换机随后在Windows“网络连接”中,找到“WSL桥接交换机”,右键选择“属性”,确保勾选了对应的WiFi网卡,重启WSL即可生效。

二、应急修复方案:已出现冲突?3种方法快速恢复

适用于“已安装WSL,且出现驱动冲突”的场景,无需重装系统,快速修复WiFi与WSL的正常运行。

方法1:重启WSL与网络适配器(解决临时断连)

若只是偶尔出现WiFi断连,以管理员身份运行CMD,依次执行以下命令,快速恢复:

wsl --shutdown(关闭WSL子系统)

netsh winsock reset(重置网络栈)

netsh int ip reset(重置IP配置)

随后重启电脑的WiFi网卡(在“网络连接”中禁用再启用),重新启动WSL即可。

方法2:降级Linux内核(解决驱动不兼容)

若冲突频繁出现,大概率是WSL的Linux内核版本过高,与网卡驱动不兼容。可手动降级至稳定版内核([5.15.90.1](5.15.90.1)):

① 下载内核安装包:前往微软官网下载“WSL2 Linux内核更新包([5.15.90.1](5.15.90.1))”;

② 安装降级包:运行安装程序,选择“修复”模式;

③ 锁定内核版本:在

.wslconfig文件中添加kernelVersion=5.15.90.1,避免自动更新。

方法3:重装网卡驱动(解决驱动崩溃)

若WiFi网卡驱动已崩溃(设备管理器中显示黄色感叹号),按以下步骤操作:

① 卸载旧驱动:在设备管理器中找到WiFi网卡,右键选择“卸载设备”,勾选“删除此设备的驱动程序软件”;

② 安装稳定版驱动:前往厂商官网下载对应机型的旧版本稳定驱动(比最新版低1-2个版本),手动安装;

③ 禁用WSL的硬件直通:在

.wslconfig文件中添加deviceVirtualization=false,避免WSL占用网卡硬件资源。三、终极替代方案:若冲突无法解决,用“虚拟机+Docker”替代WSL

若上述方法均无法解决冲突,可放弃WSL,采用“VMware Workstation Pro 17 + Ubuntu 22.04”的组合,完全隔离硬件环境,彻底规避驱动冲突,同时不影响Docker与AI框架的部署。

核心优势:虚拟机的硬件虚拟化完全独立于主机,不会占用主机的WiFi网卡驱动资源,且支持显卡直通、多网卡配置,适配更复杂的AI开发场景。

实操要点:安装虚拟机时,选择“桥接模式”联网,分配至少4核CPU、16GB内存,开启“虚拟机平台兼容性”,后续在虚拟机内安装Docker、部署AI框架,步骤与WSL完全一致。

第三部分:Docker部署与优化——避坑容器化核心问题,适配AI开发

解决了WSL的驱动冲突后,Docker作为本地AI部署的“容器化核心”,其部署与优化直接关系到后续模型、框架的运行效率。2026年,结合AI开发的特殊需求,重点规避“端口映射”“资源限制”“显卡直通”三大核心问题。

一、Docker安装:选择“WSL 2后端”,拒绝“Hyper-V后端”

在Windows上安装Docker Desktop,必须选择“WSL 2后端”,这是与本地AI开发适配度最高的模式,既兼顾了容器的轻量性,又能与WSL子系统无缝协同。

安装步骤:

下载Docker Desktop最新版(支持Windows 11),运行安装程序时,勾选“Use the WSL 2 based engine”“Add shortcut to desktop”,其余保持默认,等待安装完成。

关键配置:关联已安装的Ubuntu子系统

安装完成后,打开Docker Desktop,进入“Settings”→“Resources”→“WSL Integration”,开启“Enable integration with my default WSL distro”,并勾选已安装的“Ubuntu-22.04”,点击“Apply & Restart”,确保Docker容器能在WSL子系统中运行。

二、核心避坑:3个高频问题的解决方案

问题1:容器端口映射失败,无法访问本地服务

表现为“在容器内启动的AI服务,主机无法通过localhost访问”,核心原因是WSL的网络模式与Docker的端口映射不匹配。

解决方案:在启动容器时,将端口映射到WSL的IP地址,而非主机的localhost。

示例:启动一个AI推理容器,执行命令:

docker run -p $(wsl hostname -I | awk '{print $1}'):8080:8080 推理模型镜像,随后通过“WSL的IP+8080端口”即可访问服务。

问题2:容器占用资源过高,导致主机卡顿

AI模型推理、多智能体运行会占用大量CPU、内存、显卡资源,若不限制容器资源,会导致主机崩溃。

解决方案:在Docker Desktop中配置资源限制,进入“Settings”→“Resources”,设置CPU核心数(建议不超过主机的50%)、内存(建议不超过主机的40%)、显存(建议不超过显卡的60%),点击“Apply & Restart”生效。

问题3:容器内无法调用显卡,模型推理速度极慢

核心原因是未开启Docker的显卡直通功能,容器无法使用NVIDIA显卡的CUDA算力。

解决方案:① 安装NVIDIA Container Toolkit;② 在WSL子系统中执行

distribution=$(. /etc/os-release;echo $ID$VERSION_ID),再执行官方安装命令;③ 启动容器时添加--gpus all参数,示例:docker run --gpus all -p 8080:8080 推理模型镜像。三、AI开发专属优化:构建本地镜像仓库,加速部署

本地部署AI框架、模型时,频繁从远程仓库拉取镜像,速度慢且易中断。建议搭建本地Docker镜像仓库,将常用的AI镜像(如PyTorch、TensorFlow、Copaw、OpenClaw)提前拉取并保存,大幅提升部署效率。

实操步骤:① 在WSL中启动本地镜像仓库容器:

docker run -d -p 5000:5000 --name registry registry:2;② 拉取远程AI镜像,如docker pull pytorch/pytorch:2.5.0-cuda12.2-cudnn8-runtime;③ 为镜像打标签:docker tag pytorch/pytorch:2.5.0-cuda12.2-cudnn8-runtime localhost:5000/pytorch:2.5.0;④ 推送到本地仓库:docker push localhost:5000/pytorch:2.5.0,后续部署时直接从本地仓库拉取即可。第四部分:高阶落地——构建多智能体“数字人团队”,实现协同工作

解决了基础环境与容器化的问题后,2026年本地AI部署的核心目标,是组合Copaw、OpenClaw等智能体框架,构建“协同工作的AI团队”,适配复杂的技术研发、内容创作、数据分析场景。结合实战经验,重点拆解“框架选型”“协同配置”“场景落地”三大环节。

一、框架选型:Copaw vs OpenClaw,按需组合而非二选一

Copaw与OpenClaw是目前最成熟的两款智能体框架,二者定位不同、优势互补,构建“AI团队”时,无需二选一,而是根据任务角色按需组合。

|

框架 |

核心优势 |

适配角色 |

本地部署难度 |

|---|---|---|---|

|

Copaw |

轻量化、易部署,自然语言交互流畅,内置丰富的办公、研发技能 |

执行层智能体(如数据录入员、代码编写助手) |

低(支持Docker一键部署) |

|

OpenClaw |

高定制化、支持多子代理协同,可直连数据库、本地文件,任务执行能力强 |

管理层智能体(如项目负责人、策略分析师) |

中(需配置技能库、权限体系) |

核心选型原则:以OpenClaw为“核心管控者”,负责任务拆解、角色分配、结果汇总;以Copaw为“执行执行者”,承接具体的重复性任务,形成“管控+执行”的协同架构。

二、协同配置:打通两大框架,实现“任务互通、结果共享”

本地部署多智能体的核心难点,是实现Copaw与OpenClaw的协同通信。2026年,最成熟的方案是“基于REST API的跨框架调用”,结合Docker容器的网络互通,实现无缝协同。

-

步骤1:在Docker中分别部署两大框架

-

① 部署OpenClaw:拉取本地仓库的OpenClaw镜像,启动容器并开启API端口:

docker run --name openclaw -p 8000:8000 -v ~/openclaw/config:/app/config localhost:5000/openclaw:latest;

-

② 部署Copaw:拉取Copaw镜像,启动容器并关联OpenClaw的网络:

docker run --name copaw --link openclaw:openclaw -p 8001:8001 localhost:5000/copaw:latest。

-

步骤2:配置OpenClaw的“子代理调用”功能

-

在OpenClaw的配置文件([AGENTS.md](AGENTS.md))中,添加Copaw作为子代理,配置API地址(

http://openclaw:8001)、调用权限,设定Copaw的承接任务类型(如代码编写、文件整理)。

-

步骤3:实现数据共享,打通本地文件与数据库

-

通过Docker的“卷挂载”功能,将主机的本地文件目录、数据库数据卷,同时挂载到两个容器中。

-

示例:启动容器时添加

-v ~/ai-workspace:/workspace(共享工作目录)、-v ai-db:/var/lib/mysql(共享数据库),确保两大智能体能访问相同的本地数据,实现任务结果的实时共享。

三、场景落地:3个典型“AI团队”协作案例

结合AI研发、数据分析的实际需求,以下3个案例可直接复用,快速感受多智能体协同的价值。

案例1:AI模型开发团队——从代码编写到测试部署,全流程自动化

-

角色分配:OpenClaw(项目负责人)、Copaw(代码工程师)、Copaw(测试工程师);

-

协作流程:① 开发者向OpenClaw下达指令:“开发一个基于PyTorch的图像分类模型,适配本地显卡”;② OpenClaw拆解任务,向代码工程师Copaw下达“编写模型代码、数据预处理代码”的指令,向测试工程师Copaw下达“设计测试用例、性能评估方案”的指令;③ 两个Copaw并行执行任务,将代码、测试用例保存至共享工作目录;④ OpenClaw汇总结果,调用本地Docker容器,自动完成模型训练、测试,最终输出开发报告。

案例2:前沿技术调研团队——量子计算+AI融合方案分析

-

角色分配:OpenClaw(调研负责人)、Copaw(文献检索员)、Copaw(方案分析师);

-

协作流程:① OpenClaw接收“调研2026年量子计算与AI大模型融合的最新方案”的指令;② 分派Copaw检索arXiv、IEEE的最新文献,提取核心技术点;③ 分派另一Copaw分析检索结果,结合本地量子计算仿真框架(如Qiskit),编写技术可行性报告;④ OpenClaw汇总报告,补充本地部署建议,自动生成调研文档并保存。

案例3:区块链+AI可信验证团队——智能合约审计与数据溯源

-

角色分配:OpenClaw(审计负责人)、Copaw(合约分析师)、Copaw(数据溯源员);

-

协作流程:① OpenClaw接收“审计某区块链智能合约的安全性,结合AI实现数据溯源”的指令;② Copaw自动读取本地合约代码,执行安全审计,识别漏洞;③ 另一Copaw调用区块链节点数据,结合AI模型实现交易数据溯源,生成溯源报告;④ OpenClaw汇总审计结果与溯源报告,自动生成可视化分析图表。

第五部分:终极避坑清单——20条核心要点,杜绝99%的问题

为了方便快速查阅,我们整理了2026年本地AI部署的“终极避坑清单”,涵盖硬件、系统、WSL、Docker、多智能体五大环节,建议收藏备用。

硬件与系统篇

-

优先选择Intel AX210/Realtek 8852BE系列WiFi网卡,避开联发科MT7921K;

-

必须使用Windows 11 23H2及以上版本,禁用第三方安全软件的虚拟化拦截;

-

内存至少32GB,显卡需支持CUDA 12.2,避免算力不足导致的进程崩溃。

WSL篇

-

安装时优先选择Ubuntu 22.04 LTS,避免小众发行版;

-

配置桥接模式联网,锁定Linux内核版本为[5.15.90.1](5.15.90.1);

-

出现驱动冲突时,先重置网络栈,再重装网卡驱动,最后考虑切换虚拟机。

Docker篇

-

必须选择WSL 2后端,关联Ubuntu子系统,开启显卡直通;

-

启动容器时,用WSL的IP地址映射端口,避免localhost访问失败;

-

配置资源限制,避免容器占用过多主机资源;

-

搭建本地镜像仓库,提前拉取常用AI镜像,加速部署。

多智能体篇

-

以OpenClaw为管控者,Copaw为执行者,实现“管控+执行”的协同架构;

-

通过Docker的“–link”参数实现框架间网络互通,通过卷挂载实现数据共享;

-

谨慎配置OpenClaw的权限,避免子代理误操作本地敏感文件;

-

定期清理智能体的对话上下文,减少Token消耗与内存占用。

通用篇

-

所有配置修改后,务必重启WSL、Docker,确保生效;

-

重要数据定期备份,避免容器崩溃导致数据丢失;

-

遇到问题时,优先查看WSL、Docker的日志文件,定位问题根源;

-

关注框架官方更新,及时修复已知漏洞;

-

本地部署大模型时,优先选择量化版本,降低算力与内存压力;

-

多智能体协同前,先进行单框架测试,确保各自运行正常。

结语:本地部署,让AI创新更自主、更可控

2026年,AI技术的发展日新月异,而本地部署作为“技术实践的试验场”,不仅能保障数据隐私与安全,更能让开发者摆脱云端算力的限制,灵活探索量子计算、区块链、多智能体协同等前沿方向。

尽管WSL与网卡驱动的冲突、Docker的容器化问题、多智能体的协同壁垒,会给部署过程带来挑战,但只要遵循这份指南的实操步骤,避开核心陷阱,就能顺利搭建起稳定、高效的本地AI开发环境。未来,随着技术的不断成熟,本地部署的门槛将持续降低,而每一位深耕本地实践的开发者,都将成为AI原生时代的核心创新力量。

愿这份指南,能成为你本地AI部署之路上的“指南针”,助力你在前沿技术的探索中,行稳致远,收获更多创新成果!

☟☟☟

☞人工智能产业链联盟筹备组征集公告☜

☝

精选报告推荐:

11份清华大学的DeepSeek教程,全都给你打包好了,直接领取:

【清华第四版】DeepSeek+DeepResearch让科研像聊天一样简单?

【清华第七版】文科生零基础AI编程:快速提升想象力和实操能力

【清华第十一版】2025AI赋能教育:高考志愿填报工具使用指南

10份北京大学的DeepSeek教程

【北京大学第五版】Deepseek应用场景中需要关注的十个安全问题和防范措施

【北京大学第九版】AI+Agent与Agentic+AI的原理和应用洞察与未来展望

【北京大学第十版】DeepSeek在教育和学术领域的应用场景与案例(上中下合集)

8份浙江大学的DeepSeek专题系列教程

浙江大学DeepSeek专题系列一–吴飞:DeepSeek-回望AI三大主义与加强通识教育

浙江大学DeepSeek专题系列二–陈文智:Chatting or Acting-DeepSeek的突破边界与浙大先生的未来图景

浙江大学DeepSeek专题系列三–孙凌云:DeepSeek:智能时代的全面到来和人机协作的新常态

浙江大学DeepSeek专题系列四–王则可:DeepSeek模型优势:算力、成本角度解读

浙江大学DeepSeek专题系列五–陈静远:语言解码双生花:人类经验与AI算法的镜像之旅

浙江大学DeepSeek专题系列六–吴超:走向数字社会:从Deepseek到群体智慧

浙江大学DeepSeek专题系列七–朱朝阳:DeepSeek之火,可以燎原

浙江大学DeepSeek专题系列八–陈建海:DeepSeek的本地化部署与AI通识教育之未来

4份51CTO的《DeepSeek入门宝典》

51CTO:《DeepSeek入门宝典》:第1册-技术解析篇

51CTO:《DeepSeek入门宝典》:第2册-开发实战篇

51CTO:《DeepSeek入门宝典》:第3册-行业应用篇

51CTO:《DeepSeek入门宝典》:第4册-个人使用篇

5份厦门大学的DeepSeek教程

【厦门大学第一版】DeepSeek大模型概念、技术与应用实践

【厦门大学第五版】DeepSeek等大模型工具使用手册-实战篇

10份浙江大学的DeepSeek公开课第二季专题系列教程

【精选报告】浙江大学公开课第二季:《DeepSeek技术溯源及前沿探索》(附PDF下载)

【精选报告】浙江大学公开课第二季:2025从大模型、智能体到复杂AI应用系统的构建——以产业大脑为例(附PDF下载)

【精选报告】浙江大学公开课第二季:智能金融——AI驱动的金融变革(附PDF下载)

【精选报告】浙江大学公开课第二季:人工智能重塑科学与工程研究(附PDF下载)

【精选报告】浙江大学公开课第二季:生成式人工智能赋能智慧司法及相关思考(附PDF下载)

【精选报告】浙江大学公开课第二季:AI大模型如何破局传统医疗(附PDF下载)

【精选报告】浙江大学公开课第二季:2025年大模型:从单词接龙到行业落地报告(附PDF下载)

【精选报告】浙江大学公开课第二季:2025大小模型端云协同赋能人机交互报告(附PDF下载)

【精选报告】浙江大学公开课第二季:DeepSeek时代:让AI更懂中国文化的美与善(附PDF下载)

【精选报告】浙江大学公开课第二季:智能音乐生成:理解·反馈·融合(附PDF下载)

6份浙江大学的DeepSeek公开课第三季专题系列教程

【精选报告】浙江大学公开课第三季:走进海洋人工智能的未来(附PDF下载)

【精选报告】浙江大学公开课第三季:当艺术遇见AI:科艺融合的新探索(附PDF下载)

【精选报告】浙江大学公开课第三季:AI+BME,迈向智慧医疗健康——浙大的探索与实践(附PDF下载)

【精选报告】浙江大学公开课第三季:心理学与人工智能(附PDF下载)

-

篇幅有限,部分展示 加入会员,任意下载 资料下载方式

Download method of report materials

关注公众号后回复:GJ260315 即可领取完整版资料

荐: 【中国风动漫】《姜子牙》刷屏背后,藏着中国动画100年内幕! 【中国风动漫】除了《哪吒》,这些良心国产动画也应该被更多人知道! 【中国风动漫】《雾山五行》大火,却很少人知道它的前身《岁城璃心》一个拿着十米大刀的男主夭折!

如需获取更多报告

扫码加入 “人工智能产业链联盟” 知识星球,任意下载相关报告! 报告部分截图

声明 来源:扬帆出海,人工智能产业链union(ID:aiyuexingqiu)推荐阅读,不代表人工智能产业链union立场,转载请注明,如涉及作品版权问题,请联系我们删除或做相关处理! 编辑:Zero

文末福利

1.赠送800G人工智能资源。

获取方式:关注本公众号,回复“人工智能”。

2.「超级公开课NVIDIA专场」免费下载

获取方式:关注本公众号,回复“公开课”。

3.免费微信交流群:

人工智能行业研究报告分享群、

人工智能知识分享群、

智能机器人交流论坛、

人工智能厂家交流群、

AI产业链服务交流群、

STEAM创客教育交流群、

人工智能技术论坛、

人工智能未来发展论坛、

AI企业家交流俱乐部

雄安企业家交流俱乐部

细分领域交流群:

【智能家居系统论坛】【智慧城市系统论坛】【智能医疗养老论坛】【自动驾驶产业论坛】【智慧金融交流论坛】【智慧农业交流论坛】【无人飞行器产业论坛】【人工智能大数据论坛】【人工智能※区块链论坛】【人工智能&物联网论坛】【青少年教育机器人论坛】【人工智能智能制造论坛】【AI/AR/VR/MR畅享畅聊】【机械自动化交流论坛】【工业互联网交流论坛】

入群方式:关注本公众号,回复“入群”

戳“阅读原文”下载报告。

戳“阅读原文”下载报告。

夜雨聆风

夜雨聆风