MCP 真的死了吗?一场关于 AI 工具接口的大争论

↑阅读之前记得关注+星标⭐️,😄,每天才能第一时间接收到更新。

Perplexity 的 CTO 在公司内部宣布放弃 MCP,改用 CLI 和 API。

这件事的讽刺之处在于:这竟然成了 MCP 近期曝光度最高的新闻。

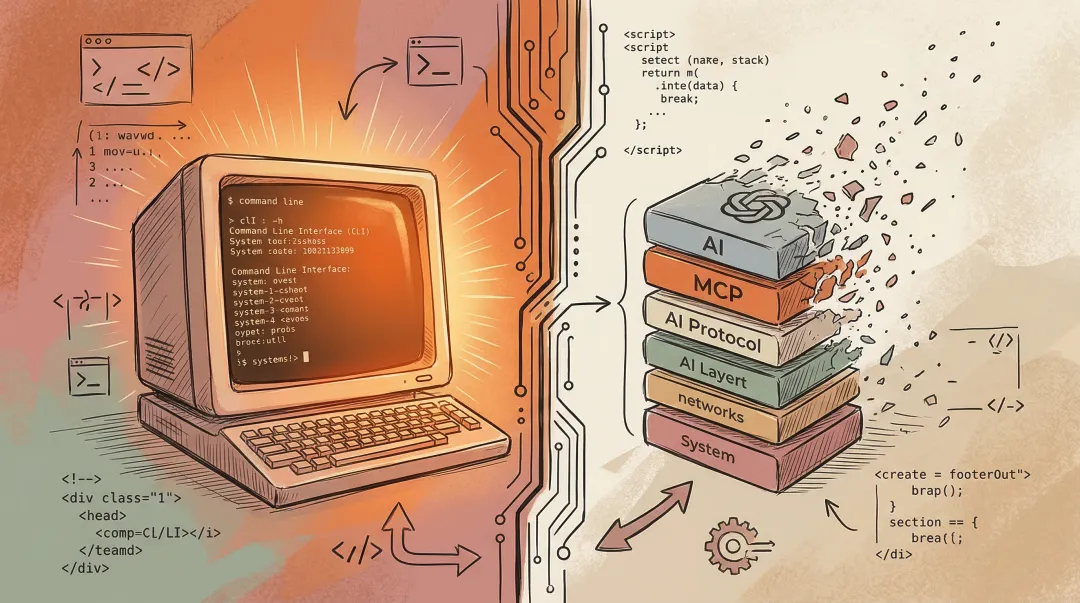

什么是 MCP,它许诺过什么?

2024 年 11 月,Anthropic 推出了 MCP(Model Context Protocol,模型上下文协议)。

它的愿景很诱人:为 AI Agent 提供一套标准化的工具接口,让大模型能够统一地调用外部服务——就像 USB-C 之于设备充电一样,接一次,全部通。

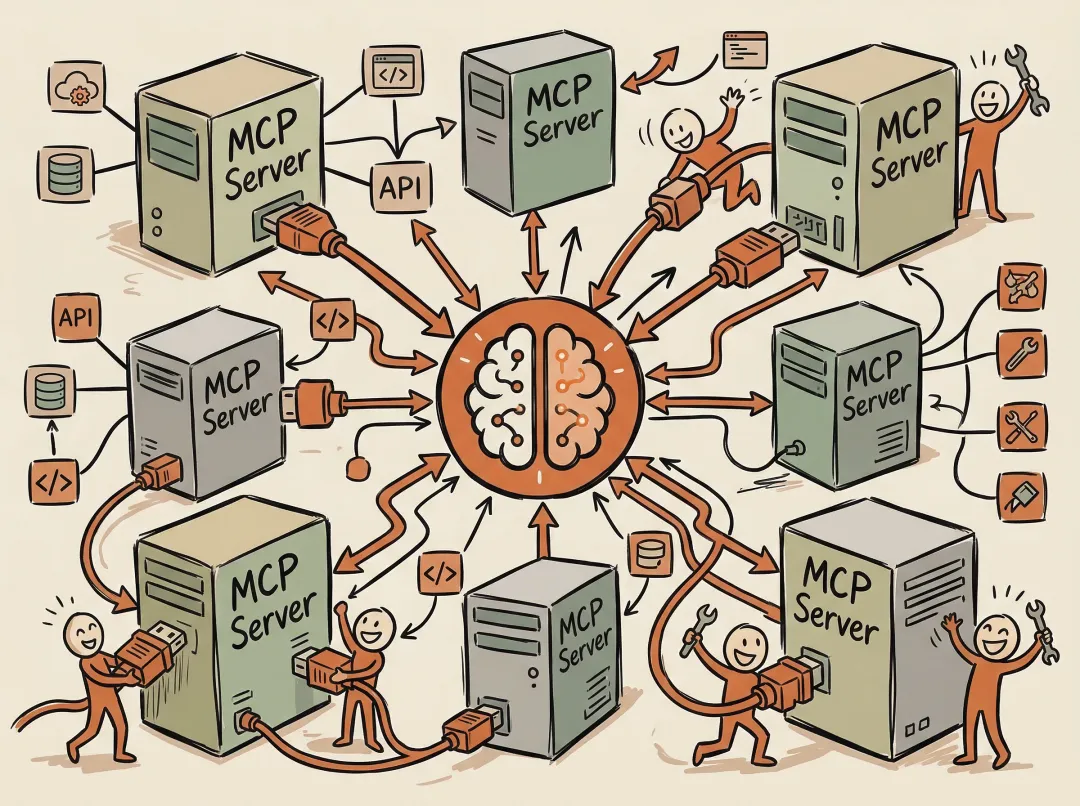

开发者们蜂拥而至,MCP Server 以每周数百个的速度涌现。社区里弥漫着乐观气氛:AI 工具标准化的时代要来了。

一年多过去了,情况却反过来了。

问题出在哪里?——三把刀捅穿 MCP 的幻象

第一刀:线性上下文成本

MCP 的工作方式是:把所有工具的名称、描述、参数 Schema 注入 Agent 的上下文窗口,然后让模型决定调用哪个。

账是这么算的:

-

10 个服务 × 每服务 5 个工具 = 50 个工具描述 -

50 个工具描述 × 平均几百 Token = 上千 Token 的静态开销 -

Agent 还没干任何事,上下文窗口就已经烧掉一大块

你只有三条路走,每条都是权衡地狱:

| 选择 | 代价 |

|---|---|

| 预加载所有工具 | 推理空间被挤占,质量下降 |

| 限制集成数量 | Agent 能力残废 |

| 动态工具加载 | 延迟 + 中间件复杂度 |

上下文窗口是 Agent 最宝贵的资产。MCP 用这笔钱换来的,是一个会漏气的抽象层。

第二刀:工程可靠性差

实际用过 Claude Code 的人都懂这个痛:

-

MCP Server 经常启动失败,要重启才能恢复 -

多个工具就要多次走认证流程 -

权限只能按名称白名单,无法限制只读范围或参数边界

这不是产品缺陷,是协议设计带来的结构性问题。

第三刀:不可调试、不可组合

MCP 工具只存在于 LLM 的对话内部。出了问题,你只能去翻 JSON 传输日志。

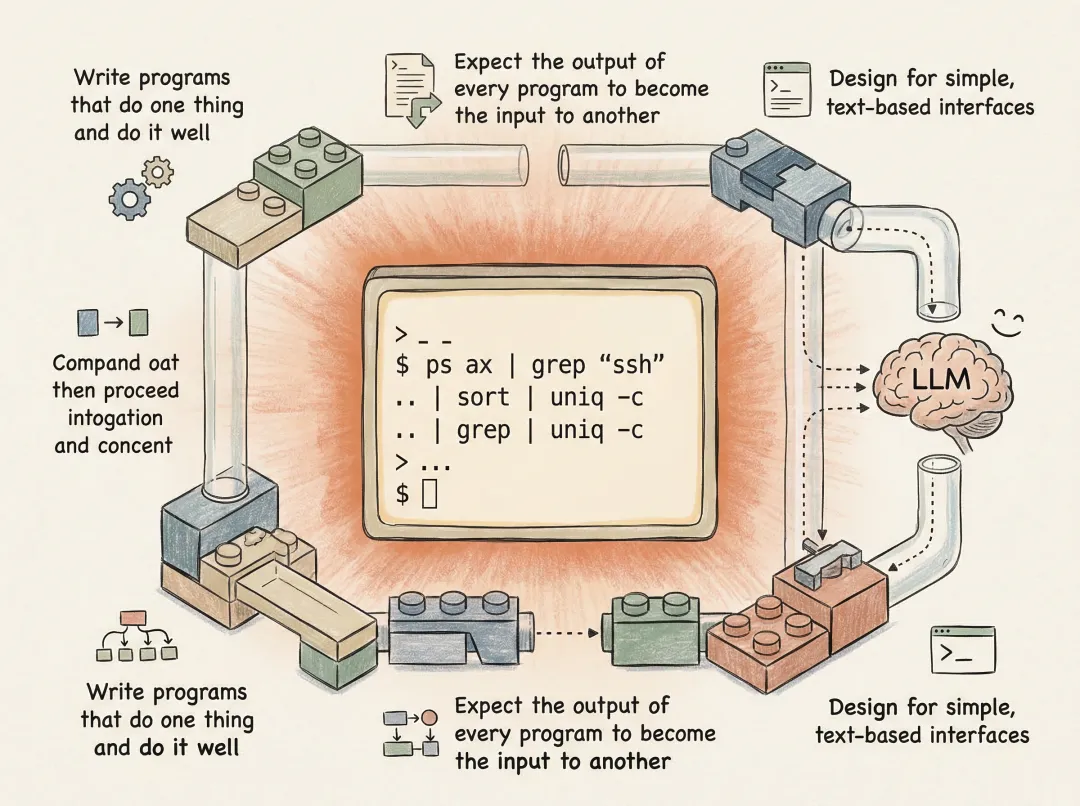

对比 CLI:出错了,直接跑同一条命令,输入输出完全透明。

更致命的是可组合性。CLI 可以用管道串联、用 grep 过滤、重定向到文件。这不是便利,通常是唯一可行的方案。MCP 做不到这些——要么把整个数据塞进上下文,要么在 Server 端自己造过滤轮子。

CLI 为什么反而赢了?

工程师 Eric Holmes 写了一篇广为流传的文章,核心论点只有一句:

“LLM 已经在数以百万计的 man 手册、Stack Overflow 回答、GitHub Shell 脚本上训练过了。给它一个 CLI 和一份文档,它就能如鱼得水。”

CLI 的优势不是新发明出来的,而是几十年打磨的产物:

-

对人类和机器同样好用 -

可组合、可调试、认证体系成熟 -

LLM 对 CLI 的理解是原生能力,不需要额外适配

MCP 承诺提供更简洁的接口,但实践证明,你还是要写同样的文档——工具是什么、接受什么参数、什么时候用它。和 man 页面没有本质区别。

最好的工具,是对人类和机器都好用的工具。CLI 早就是了。

等等——MCP 真的死了吗?

这里要踩刹车,给”MCP已死”这个判断打上问号。

放弃 MCP 的有:

-

Perplexity(生产级 AI Agent) -

Duetchat(在 v2 版本彻底删除 MCP 集成) -

YC CEO Garry Tan:”MCP sucks”

还在用 MCP 的有:

-

Cursor、VSCode(IDE 集成场景) -

Claude Desktop(桌面助手场景) -

Anthropic 自己(MCP 的发起者,没有放弃)

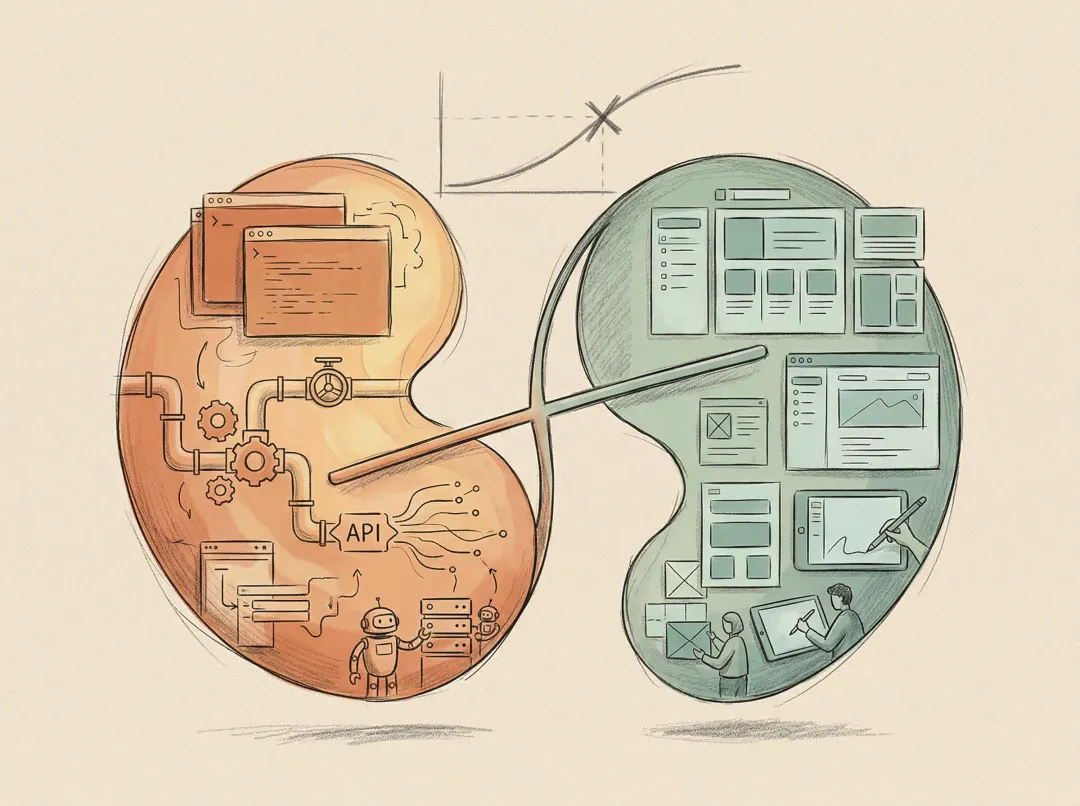

这两组用户有一个关键区别:前者在生产环境跑 Agent,后者在开发者工具场景用 MCP 做工具连接。

CLI 适合服务端 Agent——这是有前提的。它对非技术用户不友好,在浏览器端和端侧场景也无法使用。MCP 的可视化配置、标准化接口,在桌面工具场景仍然有价值。

所以更准确的判断是:MCP 在生产级 AI Agent 的主流地位受到挑战,但没有全面死亡。

更深的问题:抽象层什么时候会溢出?

MCP 的失败,可能不是”技术路线错了”,而是发布时机错了。

2024年11月,AI Agent 框架还不成熟。MCP 试图在一个尚未稳定的生态上建立标准,结果变成了”builder 多于 user”的困境——服务器写了一堆,真正在生产跑的 Agent 很少。

更根本的矛盾是:

当 LLM 足够强,它不需要专门为它设计的接口——直接给 CLI 就行。

当 LLM 不够强,专门设计的接口也救不了它。

这是一个”抽象层溢出”的问题。当模型的原生泛化能力超过某个阈值,中间层就变成了纯粹的摩擦力。

随着 Coding Agent 越来越强,这个阈值正在被突破。

对 AI 产品建设者的实际意义

这场争论背后有一个清晰的工程信号:

AI 工具链正在分层,中间层在收缩。

-

能力层:LLM 越来越强,开始内化原来需要外部工具的能力 -

接口层:MCP 想做的”标准化”正在被 LLM 的原生泛化能力替代 -

执行层:CLI/API 这种经过验证的基础设施,比新造的抽象协议更抗风险

对于正在构建 AI 产品的人:现阶段,给 Agent 配 CLI 工具的 ROI,高于开发专属 MCP Server。 把精力放在让 Agent 更好地使用现有工具上,而不是为 Agent 造新的接口层。

MCP 会不会卷土重来?可能会,但需要等 Agent 生态更成熟、工具管理问题有新的解法之后。

现在,CLI 赢了这一局。

参考资料:

[1] Eric Holmes: MCP is Dead, Long Live the CLI

[2] Denis Yarats(Perplexity CTO)内部邮件(X 上流传)

夜雨聆风

夜雨聆风