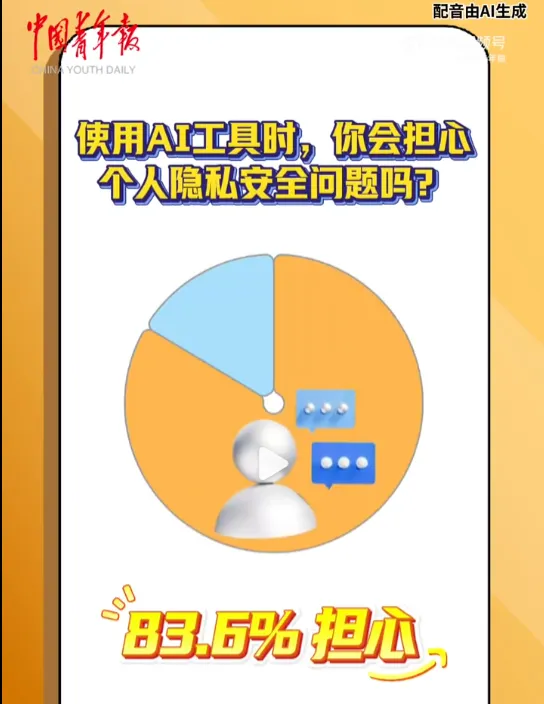

超八成受访青年担心AI隐私安全说明什么?

近日,国家互联网应急中心发布关于OpenClaw安全应用的风险提示。

当OpenClaw这类AI智能体忙着“解锁”更多实操功能,成为不少青年的日常工具时,一项覆盖1334名青年的调查给出了耐人寻味的答案:83.6%的受访青年担心AI隐私安全,超过半数忌惮高权限AI智能体,近五成忧心智能语音助手和AI面试官的隐私风险。

面对AI越智能、越“能干”,青年的心慌感反而越强烈,这绝非无中生有,更不是青年对新技术的排斥,而是藏在AI便利背后的现实焦虑——这份心慌,背后是技术失控的隐忧、规则滞后的短板,更藏着青年对隐私安全的迫切诉求,值得我们逐一拆解。

青年之所以心慌,本质是对“技术失控”的警惕,是隐私边界被打破的不安。比如,87.5%的受访青年会使用AI工具,近七成要么每天用要么经常用,AI早已从“新鲜事物”变成了学习工作的“好帮手”。但当AI的能力从“对话”延伸到“实操”,从简单答疑变成能操控系统、读取信息的“超级大脑”,它可触及的个人信息范围也呈指数级扩大。就像武汉00后学生周明哲担心的,“半夜睡着了,AI在后台自己运行,它到底在干什么,你其实不清楚”,这种不可控性,正是青年心慌的核心。更别说53.4%的青年担心的高权限AI智能体、49.8%担心的智能语音助手,它们就像一把把“双刃剑”,一边给生活“提效”,一边可能悄悄“窥探”隐私,这种“便利与风险并存”的矛盾,让青年们不得不防、怎能不慌?

其次,青年的心慌,更源于法律监管与技术发展的“时差”,是对“规则滞后”的无声倒逼。中国政法大学商希雪副教授分析得很透彻,高权限AI智能体的出现,带来了“信息处理模式的根本性变革”,传统法律针对的是“有人工介入的平台式信息处理”,而如今AI的自动化决策,让信息处理主体变得模糊,现行法律的相关规定早已“跟不上”技术的脚步。这就好比AI已经跑在了前面,而规范它的“红绿灯”还没安装到位,青年们的心慌,其实是对“有法可依、有规可循”的迫切期待。毕竟,当AI处理隐私的“黑箱”无法被看透,当违规采集、泄露隐私的行为没有明确的处罚标准,用户的隐私就只能靠“运气”保护,这也是81.2%的受访青年支持加快出台相关立法的原因——没有规则兜底,面对越来越“能干”的AI,青年怎能不心慌?

更值得注意的是,青年的心慌,从来不是“拖技术后腿”,而是推动AI健康发展的“清醒声音”,更是对“安全与便利兼顾”的真诚期待。有人说,青年对隐私安全太敏感,但反过来想,正是这种敏感,才让我们看到技术发展中被忽视的短板。AI创业者王柱说AI能弥补执行力不足,但他或许忽略了,没有隐私保护的“安全底座”,再高效的技术也难以让人安心;青年教师陈志远选择暂时观望,不是保守,而是对未知风险的理性敬畏。这份心慌,更是给企业和监管部门提了醒:企业不能只追求技术迭代和商业利益,更要把用户隐私保护放在首位,明确告知信息采集范围和用途,杜绝“暗箱操作”;监管部门要加快补齐法律短板,精准划定AI数据使用的红线,既给技术创新留足空间,也给用户隐私筑牢“防护网”——唯有守住隐私底线,才能化解青年的心慌,让AI真正成为青年的“助力者”。

AI的初衷是服务于人,而不是成为侵犯隐私的“工具”。超八成青年的隐私担忧,不是对新技术的否定,而是对“安全便利两不误”的美好期待。对青年而言,要保持警惕,不随意开放高权限、不泄露核心隐私;对企业而言,要守住底线,把隐私保护融入技术研发的每一个环节;对监管而言,要加快补位,让法律跟上技术的步伐。唯有如此,才能让AI真正成为青年成长的“助力者”,让技术发展的红利,真正惠及每一个人,而不是让隐私焦虑,成为青年拥抱新技术的“绊脚石”。(图片来源视频新闻截屏)

夜雨聆风

夜雨聆风