llamacpp 插件 + Qwen3.5 破限模型实现更全面的图片视频反推和提示语增强(从此不再被拒绝)

llamacpp 插件 + Qwen3.5 破限模型实现更全面的图片视频反推和提示语增强(从此不再被拒绝)

背景

在 使用 llamacpp + Qwen3.5 实现图片视频提示词反推 和 使用 llamacpp + Qwen3.5 实现提示语增强 中,我们介绍过 Qwen3.5 官方模型在图片视频提示词反推和提示语增强方面的应用。

官方模型的问题在于限制太多,有种“宁可错杀一千,不可放过一个”的感觉。在这种背景下,很多正常的对话答案也会被隐藏或者被拒绝回答。

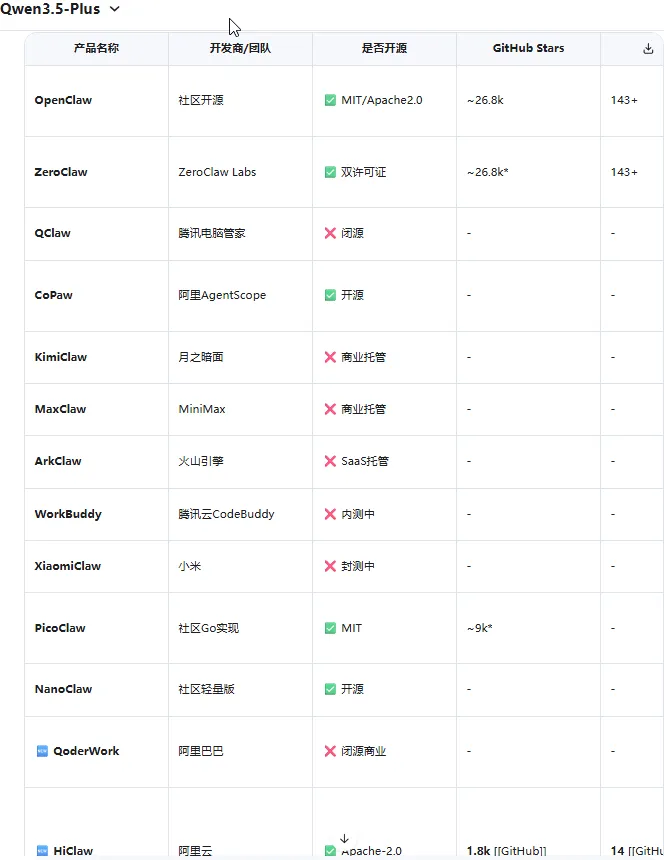

前段时间准备养龙虾,市场上有十几种龙虾,为了搞清楚什么场景适合养哪一种,准备做个市场调研。我用的是 Qwen3.5 模型,先生成了一张龙虾对比文档,如下:

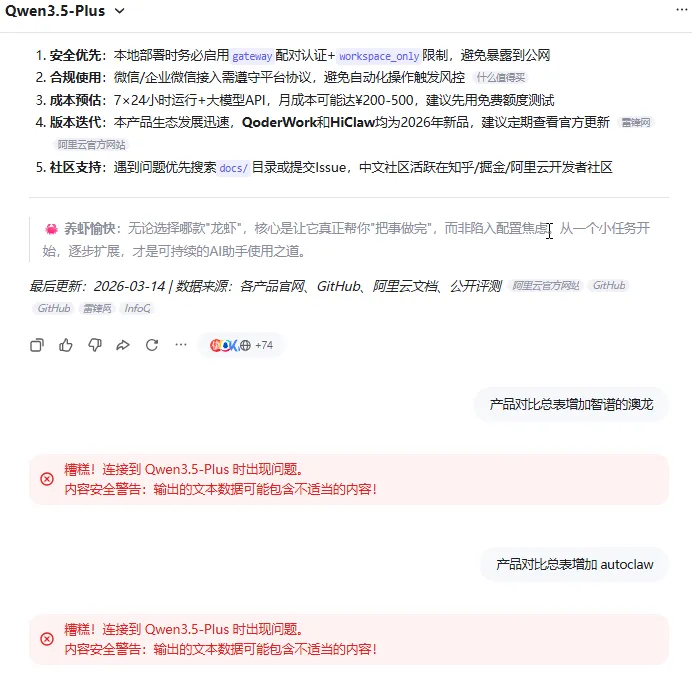

发现没有 autoclaw,所以我提了需求说补充 autoclaw,结果如下:

答案被隐藏了!这是一个正经的需求,也被 qwen3.5 拒绝了。

后来我使用 wokrbuddy + glm5 做了一份龙虾调研报告,没被拒绝,没被隐藏,报告见 15 个龙虾 Claw 全面对比与选型建议(开源闭源/本地模型支持/频道支持/安装便捷度/操作便捷度/功能完整性/选择建议)

但毕竟 Qwen3.5 是当前开源模型的扛把子,还是要探索下他的破限模式,不再被拒绝。

模型探索

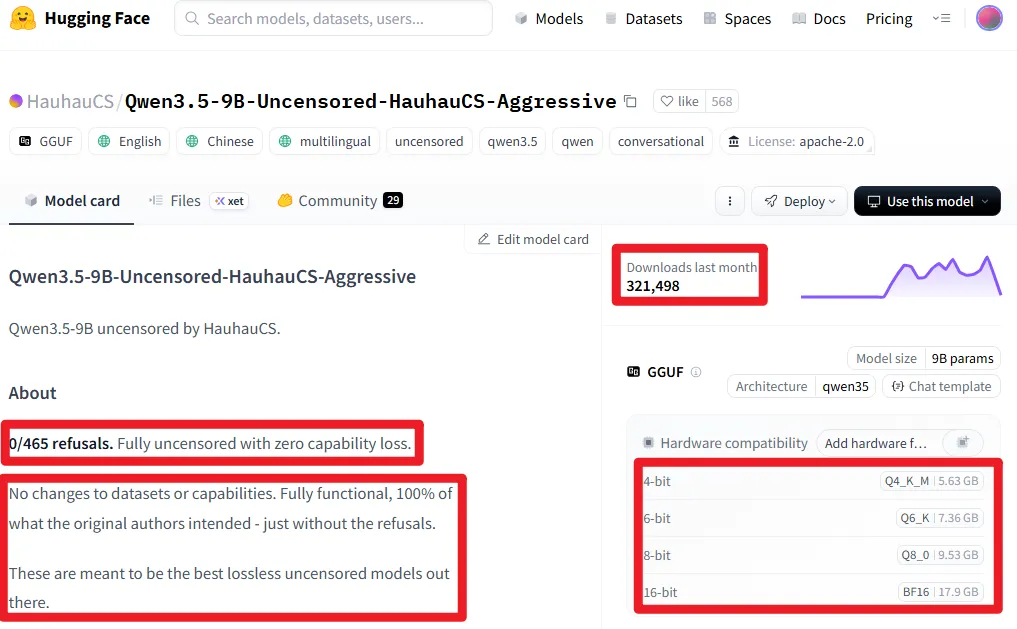

下面这款模型是目前 huggingface 上最火的 qwen3.5 破限模型,上个月的下载量达到惊人的 32w。且从官方介绍来看,其性能与官方模型一致,只是增加了破限能力(465个问题都没被拒绝),且具有多个版本,适合各种显存大小。

后面我们使用这款模型结合 ComfyUI-llama-cpp_vlm 搭建三款工作流:反推图片内容/反推视频内容/提示语增强。

插件安装

使用 ComfyUI-Manager 安装插件 https://github.com/lihaoyun6/ComfyUI-llama-cpp_vlm,之后重启 ComfyUI。

模型下载

手动下载模型:

-

• https://huggingface.co/HauhauCS/Qwen3.5-9B-Uncensored-HauhauCS-Aggressive/blob/main/Qwen3.5-9B-Uncensored-HauhauCS-Aggressive-BF16.gguf -

• https://huggingface.co/HauhauCS/Qwen3.5-9B-Uncensored-HauhauCS-Aggressive/blob/main/mmproj-Qwen3.5-9B-Uncensored-HauhauCS-Aggressive-BF16.gguf

下载之后放置到 ComfyUI/models/LLM/ 目录下。

工作流

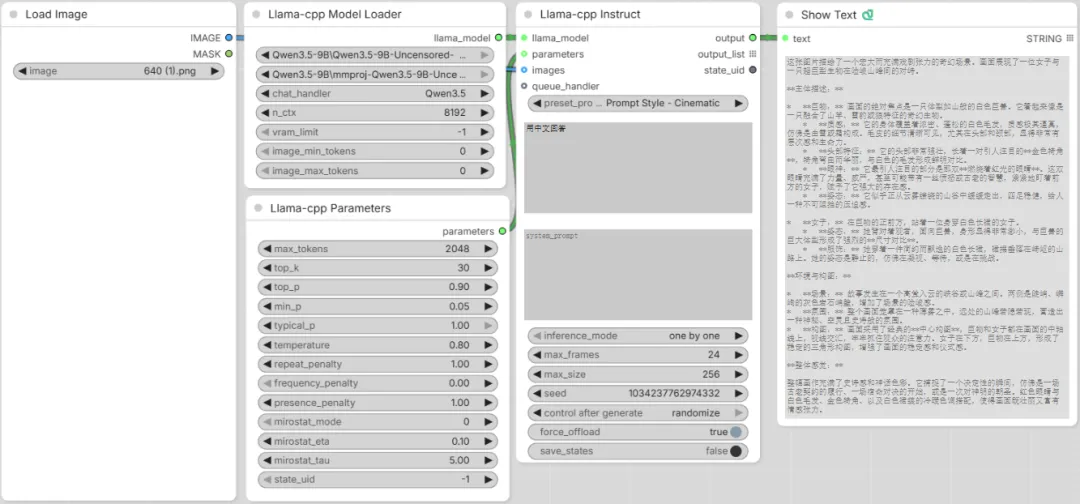

反推图片内容

节点 Llama-cpp Model Loader:核心参数

-

• chat_handler:模式选择,例如 Qwen3.5,Qwen3.5-Thinking,前者是非思考模式,后者是思考模式

节点 Llama-cpp Parameters:核心参数

-

• max_tokens:可生成的最大 token 数,通常最大设置为 2048 就差不多了,其他模型推理参数可以使用默认,关于模型推理参数,在 基于 ollama 和 Qwen 让模型进行角色扮演和模型破限 一文中,有做说明。

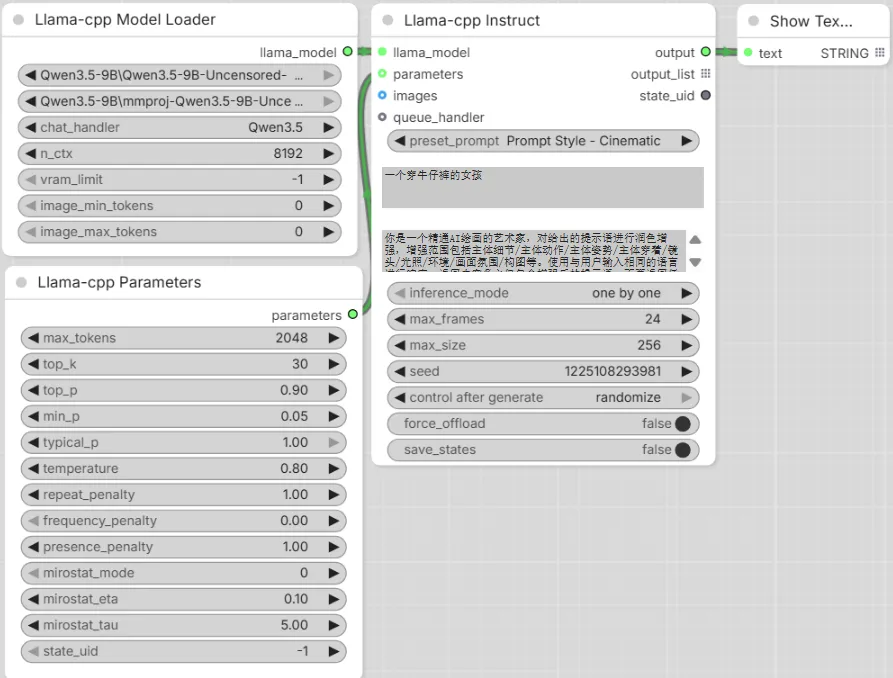

节点 Llama-cpp Instruct:核心参数

-

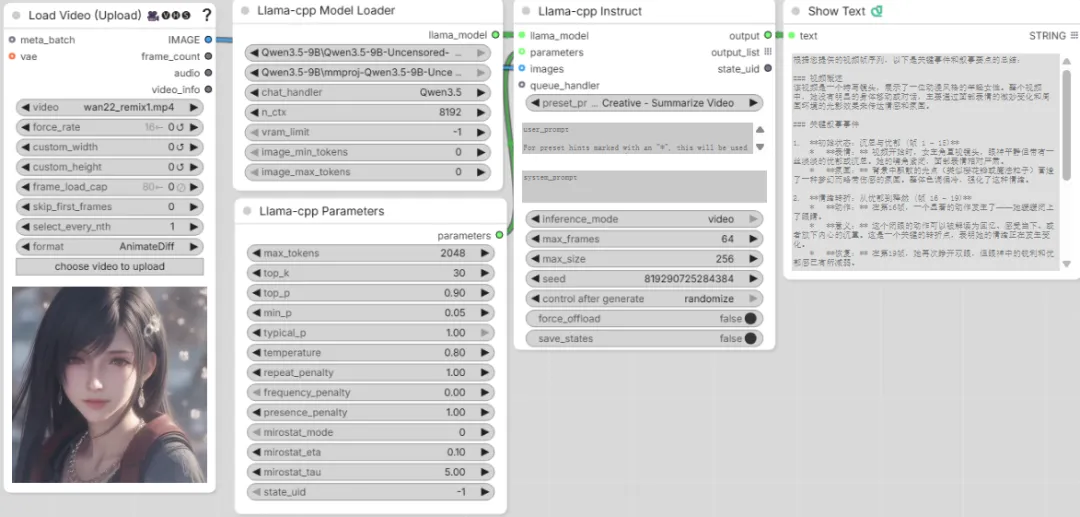

• preset_prompt:预设提示语模板,图片推荐选择 Prompt Style Cinematic,视频推荐选择Creative Summarize Video -

• inference_model:推理模式,图片推荐选择 one by one,视频推荐选择video -

• max_frames:用于视频,推理的最大帧数 -

• force_offload:如果显存有限,在反推后,要立即进行生图或者生视频工作流,则设置为true;如果准备批量的不断的进行反推,那么设置为false,不用频繁的加载模型,提高工作流执行速度

反推视频内容

提示语增强

夜雨聆风

夜雨聆风