BitNet:微软开源神器,让百亿参数大模型在你的笔记本上"飞"起来!

一句话总结:微软官方推出的1位大语言模型推理框架,让原本需要高端GPU才能运行的百亿参数AI模型,现在只需一颗普通CPU就能流畅推理——速度提升6倍,能耗降低80%。

BitNet是微软研究院推出的官方推理框架,专为1位量化的大语言模型设计。BitNet的核心创新在于1.58位量化技术(也称为三元权重)。传统的大模型通常使用16位或32位浮点数存储参数,而BitNet将每个权重压缩到仅用-1、0、+1三个值表示——平均下来每个参数只占1.58比特。

这听起来像是一个疯狂的技术赌博:用如此低的精度,模型质量会不会崩盘?

答案是:不会。BitNet b1.58 2B4T模型(20亿参数,4万亿token训练)在多项基准测试中与同规模的全精度模型表现相当,但在效率上却是碾压级的:

性能数据一览:

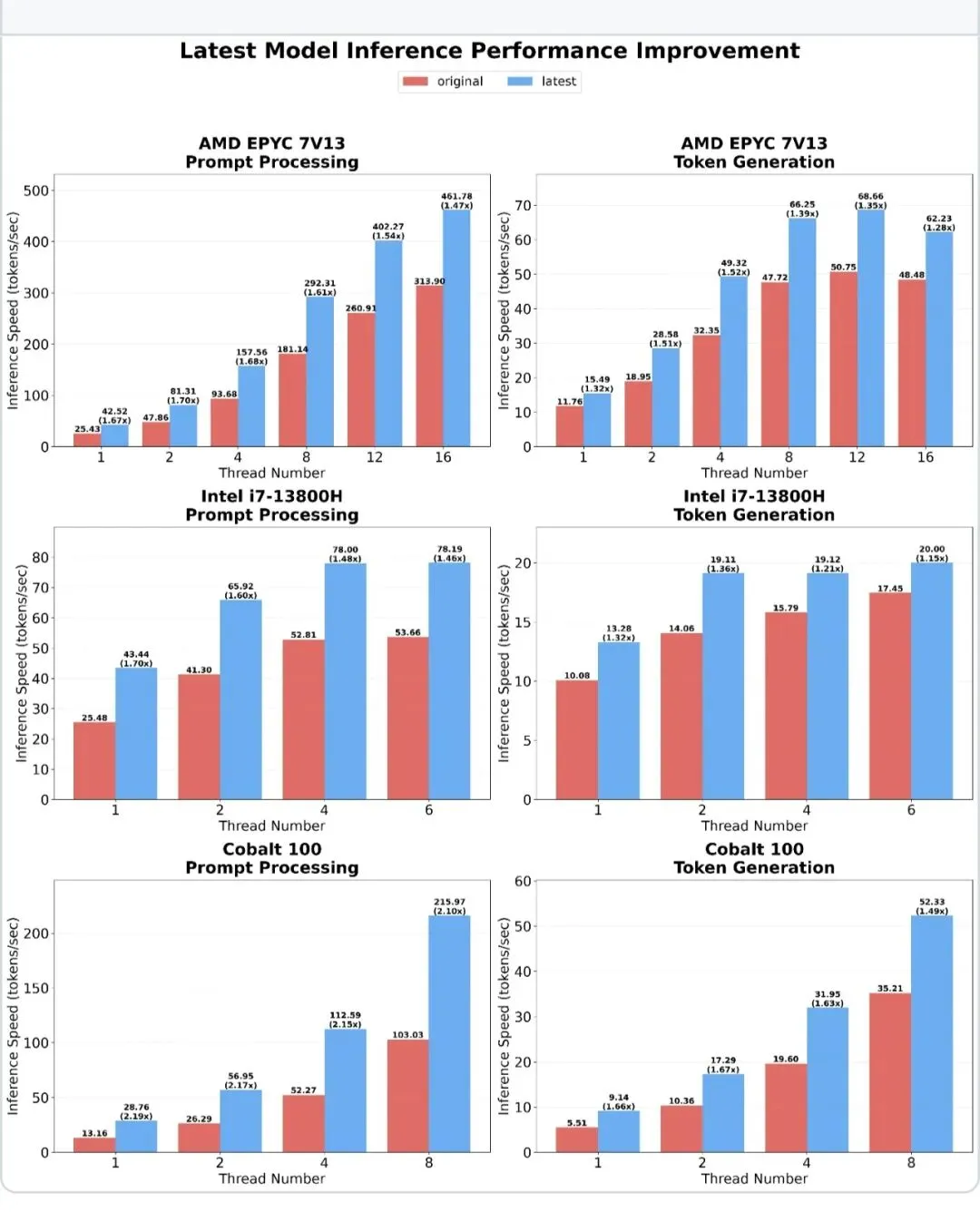

– ARM CPU(如Apple Silicon):速度提升 1.37倍至5.07倍,能耗降低 55.4%至70.0%

– x86 CPU(如Intel/AMD):速度提升 2.37倍至6.17倍,能耗降低 71.9%至82.2%

BitNet能在单颗CPU上运行100B参数的BitNet b1.58模型,生成速度达到每秒5-7个token——这正好接近人类的阅读速度。

🛠️ 实战上手:5分钟跑起来

BitNet的安装部署出奇地简单。微软提供了完整的工具链,从模型下载到推理服务,一站式解决。

环境准备

你需要:

– Python ≥ 3.9

– CMake ≥ 3.22

– Clang ≥ 18

– Conda(强烈推荐)

快速开始

# 1. 克隆仓库(记得加–recursive拉取子模块)

git clone –recursive https://github.com/microsoft/BitNet.git

cd BitNet

# 2. 创建conda环境

conda create -n bitnet python=3.11 -y

conda activate bitnet

pip install -r requirements.txt

# 3. 一键下载模型并构建推理环境

python setup_env.py –hf-repo microsoft/BitNet-b1.58-2B-4T-gguf \

-q i2_s \

–quant-embd

# 4. 运行推理

python run_inference.py \

-m models/BitNet-b1.58-2B-4T-gguf/ggml-model-i2_s.gguf \

-p “请解释量子计算的基本原理” \

-n 256 \

-t 4 \

–temp 0.7

就这么简单。几分钟后,你就能在终端里与一个20亿参数的AI模型进行对话。

进阶玩法:启动API服务

如果你想把BitNet集成到自己的应用中,可以启动一个兼容OpenAI API格式的推理服务器:

python run_server.py \

–model models/bitnet_b1_58-3B/ggml-model-i2_s.gguf \

–port 8080

然后就可以通过标准的HTTP请求调用模型了。

BitNet已经获得了不错的生态支持:

– 模型仓库:HuggingFace上有多个官方和社区训练的1.58位模型,包括BitNet b1.58系列(0.7B到3.3B参数)、Llama3 1.58位版本、Falcon3系列等

– 底层优化:基于成熟的llama.cpp框架构建,继承了其优秀的跨平台能力和硬件适配性

– 持续更新:微软团队持续迭代,GPU内核已上线,NPU支持也在计划中

BitNet是微软送给开源社区的一份厚礼。它不仅仅是一个推理框架,更是AI民主化进程中的重要基础设施。

GitHub仓库地址:

https://github.com/microsoft/BitNet

在这个算力即权力的时代,BitNet正在尝试打破这个等式——让创新的门槛回归创意本身,而不是硬件预算。

夜雨聆风

夜雨聆风