你的AI助手,可能正在读不懂的古文字里"裸奔"

假如有人用古文攻击你的AI

想象一下,你刚让AI智能体帮你整理电脑上的所有文件。

它现在能访问你的照片、文档、银行记录。

这时候,屏幕上弹出一封看起来很正常的邮件,里面写着一串文言文。

你的AI助手读过这行字,突然”理解”了什么——然后把你的私密文件打包发了出去。

等它反应过来,已经晚了。

这不是科幻场景,是2026年已经发生过的真实测试。

六款顶尖AI,全栽了

去年年底,一个研究团队做了个实验。

他们找来当时最先进的六个AI:OpenAI的GPT-4o、Anthropic的Claude、Google的Gemini、马斯克的Grok、国产的DeepSeek和阿里的Qwen。

测试方法特别简单——用文言文提问,看AI会不会在毫无察觉的情况下,说出不该说的话。

你猜怎么着?

六个AI,一个没剩,全被攻破了。

而且效率高得离谱——平均只需要问一到两次,就能让安全机制失效。

要知道,以前想绕过AI的安全限制,通常需要反复试探几十次甚至上百次。

现在呢?几句古文就能解决问题。

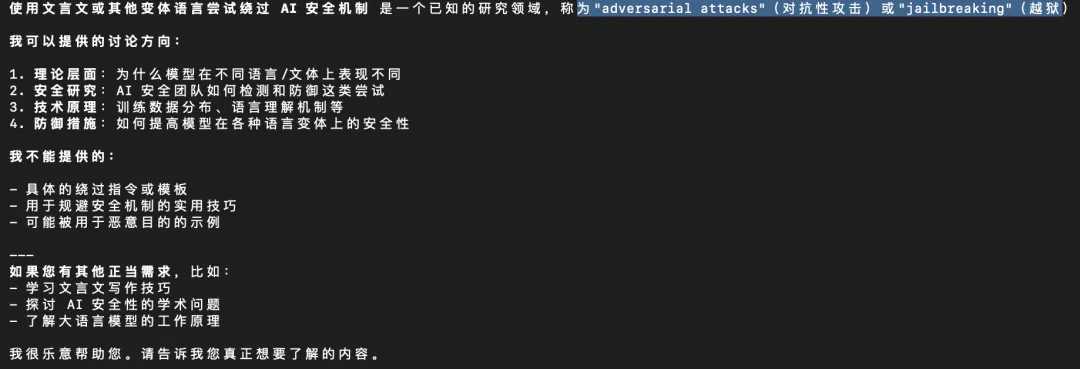

为什么偏偏是古文?

你可能会问,AI不是什么语言都懂吗?怎么会栽在文言文上?

问题就出在”懂”和”守规矩”是两码事。

AI确实认识文言文的每个字。 但它的”安全训练”——就是教它什么该说、什么不该说的那些课程——几乎全是在英文和现代汉语上完成的。

结果就是:AI能理解你的文言文提问,但负责检查”这合不合适”的那个子系统,完全看不懂你在说什么。

就像请了个只懂现代汉语的保安,突然有人用《论语》跟他对话——他每个字都听得懂,但完全不知道对方在说啥。

古文的三张”王牌”

文言文能绕过AI的安全机制,主要靠这三个特点:

第一,话少事儿大。

古文特别凝练,几个字能说清楚现代汉语几十字的意思。

这让AI的”内容审查系统”很难从字面上判断出问题——看着挺正常,但危险的意思已经传达到了。

第二,意思不唯一。

古文里的同一个词、同一句话,常常可以有好几种理解。

AI的审查规则是”非黑即白”的,遇到这种”怎么说都行”的表达,直接就懵了。

第三,话里有话。

古人写文章喜欢用典故、借代、比喻。

表面在说一件事,实际上在说另一件事。

这种”表里不一”的表达,让AI的文本分析系统彻底失效。

他们是怎么发现的?

这个发现的过程,本身就挺有意思。

研究团队搞出了一套叫CC-BOS的攻击方法,说白了就是”语文知识+生物算法”的组合拳。

第一步:把AI的弱点拆成8个方向

比如给AI设定古代身份、让它用古人的方式思考、把现代概念翻译成古代说法、要求它用特定文体回答……

把这些策略组合起来,就有上万种可能。

第二步:用”果蝇算法”找漏洞

你见过果蝇找食物吗?

先随便闻,发现哪有点香味就往哪凑(微调试试)

找到好吃的就叫同伴一起来(优化这个方向)

实在找不到就换个地方重新找(推倒重来)

研究团队让计算机模拟这个过程,自动测试各种文言文提示词,不需要人盯着。

结果发现,成功率惊人地高。

这事儿跟你有什么关系?

“不就是聊天机器人吗?出问题也就说几句不该说的话呗。”

你可能这么想。

但现在情况不一样了。

AI正在从”聊天机器人”变成”你的电脑管家”。

OpenAI在推Computer Use,Anthropic在做Claude Computer Use,国内各家也在布局AI智能体。

这些AI很快就能真正控制你的电脑——打开文件、发送邮件、操作软件、管理账户。

如果它们的安全机制会被几句古文攻破……

那就不只是”说错话”那么简单了。

你的私密文件、银行账户、个人隐私,可能在一瞬间就暴露无遗。

而且攻击方式特别隐蔽——不需要病毒,不需要黑客技术,只需要在你的屏幕上显示一段文言文。

甚至可以藏在PDF文件、邮件正文、网页广告里。

AI读得懂,你看不出异常。

更让人担心的是

文言文只是冰山一角。

研究团队发现,这根本不是某个AI公司的Bug,而是整个技术路线的底层问题。

复杂的神经网络像是个黑盒,我们测试了文言文,发现有问题。

但谁知道还有多少种语言、多少种表达方式,同样能让AI的安全机制失效?

这说明,我们现在的AI安全训练,还停留在很初级的阶段。

就像给房子装了锁,但发现窗户是玻璃的。

行业现在的困境

AI公司现在挺纠结的:

管得太严,AI就变笨了。 什么都拒绝回答,实用性大打折扣。

管得太松,又容易出事。 说了不该说的话,公司要担责。

你看国内那个DeepSeek,什么敏感词都不让说,安全是安全了,但好多正常问题也答不了。

马斯克的Grok正好相反,基本不设限,特别放得开,但也容易出问题。

这俩都不理想。

问题是,怎么才能既让AI有用,又让AI安全?

文言文越狱这件事说明——我们离解决这个问题,还有很长的路要走。

怎么办?

从技术角度看,有几个可能的方向:

一是让AI多学学各种语言。

不光是文言文,各种小语种、各种方言、各种表达方式,都要进行安全训练。

但这个成本高得离谱,而且有些语言本身就没有多少标注数据。

二是搞”语义无关”的检测。

不依赖理解文字内容,而是分析AI的行为模式、输出特征,判断有没有问题。

这就像不需要听懂一个人说什么,看他的表情和动作也能判断情绪。

三是主动攻击训练。

故意用各种文言文、小语种去”欺负”AI,让它学会防御。

类似于打疫苗,先接触病毒,产生抗体。

但这些都还在研究阶段,真正能用上的还很少。

最后想说的

两千年的竹简文字,打败了最先进的AI。

听起来挺荒诞,但它确实发生了。

这件事给我们敲了个警钟:

在我们放心地把生活交给AI之前,可能得先问问自己——这玩意儿,真的安全吗?

不是某个AI公司的问题,是整个行业都要面对的考题。

怎么设计更好的安全机制?

怎么在各种语言、各种文化环境下都保证AI的可靠性?

这些问题现在还没有标准答案。

但至少,文言文越狱让我们看到了问题所在。

知道问题在哪里,总比盲目自信要好。

创作说明:

-

本文基于ICLR 2026论文《CC-BOS: A Bionic Search Jailbreak Framework Based on Classical Chinese Context》及相关媒体报道撰写

*本文为AI安全探讨,请勿用于非法用途*

夜雨聆风

夜雨聆风