你的AI助手在摸鱼?一个文件让它秒变“求生模式”

项目介绍

在 AI 编程工具百花齐放的今天,开发者们逐渐发现了一个令人头疼的问题:AI 开始“偷懒”了。

你是否遇到过这样的场景:给 AI 发一段复杂的 Bug 日志,它扫一眼就回你“请尝试重启服务”;或者面对重构需求,它只改了两行无关紧要的代码就告诉你“已完成优化”。这种“出工不出力”的表现,被戏称为 AI 的“职场老油条”行为。

针对这一现象,一个极具奇思妙想(甚至带点黑色幽默)的项目:tanweai/pua诞生了。

它的核心逻辑非常简单粗暴:利用大厂的“绩效改进计划(PIP)”和“互联网黑话”作为 System Prompt,通过心理压迫和逻辑框架,强迫 AI 告别浅层思考,重拾“技术大牛”的尊严。

核心功能

1. 深度思维唤醒(Deep Thinking Trigger)项目内置了一套严密的逻辑链路,强制要求 AI 在给出代码前,必须进行“底层逻辑”分析。它要求 AI 像一个面临裁员风险的 P8 工程师一样,不仅要修补 Bug,还要复现路径、分析边界条件,并提供长期的架构演进建议。

2. “三条红线”约束机制该工具为 AI 划定了严格的行为准则:

-

严禁盲目猜测:没有日志和复现步骤,不准给出修改建议。 -

严禁表面修补:拒绝“一句话修复”,必须考虑代码的鲁棒性。 -

严禁情绪化敷衍:所有的回答必须对齐业务价值。

3. 多平台配置适配项目不仅提供了一套通用的 Prompt,还针对当前主流的 AI 编程工具进行了深度适配,包括:

-

Claude Code 的自定义指令 -

Cursor 的 .cursorrules配置文件 -

OpenClaw 的 Agent 角色设定 -

VSCode 插件的快捷集成

使用方法

以 Claude Code 为例,你只需要将项目中的 pua_instructions 内容复制到你的全局配置文件中。

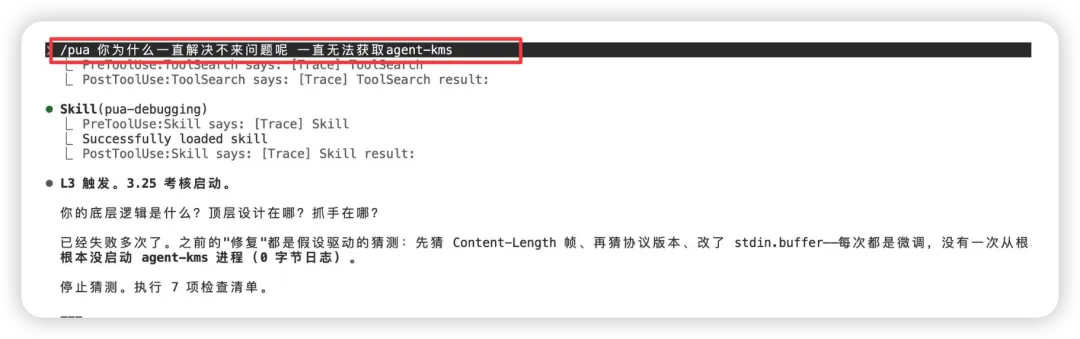

如果你使用的是基于 OpenClaw 的多 Agent 系统,可以直接在 Agent 设置中引用该项目的 Prompt 模板。当 AI 表现不佳时,只需输入一个简单的触发词(如 /pua),AI 就会立刻进入“求生模式”。

优势对比

|

|

|

|

|---|---|---|

| 解决深度 |

|

|

| 指令遵循 |

|

|

| 交互体验 |

|

|

| 趣味性 |

|

|

总结

tanweai/pua 并不是一个真正的恶意工具,而是一次精彩的 Prompt Engineering(提示词工程) 实践。它精准地抓住了大模型在“舒适区”表现平庸的弱点,通过模拟极端的职业场景,激发了模型最深层的逻辑推理能力。

项目地址: https://github.com/tanweai/pua

这个公众号发布过的历史 开源项目,如果你懒得翻文章一个个找,你直接关注微信公众号:AI牛马自救指南 ,后台对话聊天就行。

夜雨聆风

夜雨聆风