Claude Code源码泄露始末:未发布功能路线图、卧底模式、电子宠物,全都扒出来了

一个本不该出现在发布包里的map文件,让51万行代码在全网曝光。这是2026年3月31日,AI圈最魔幻的一天。

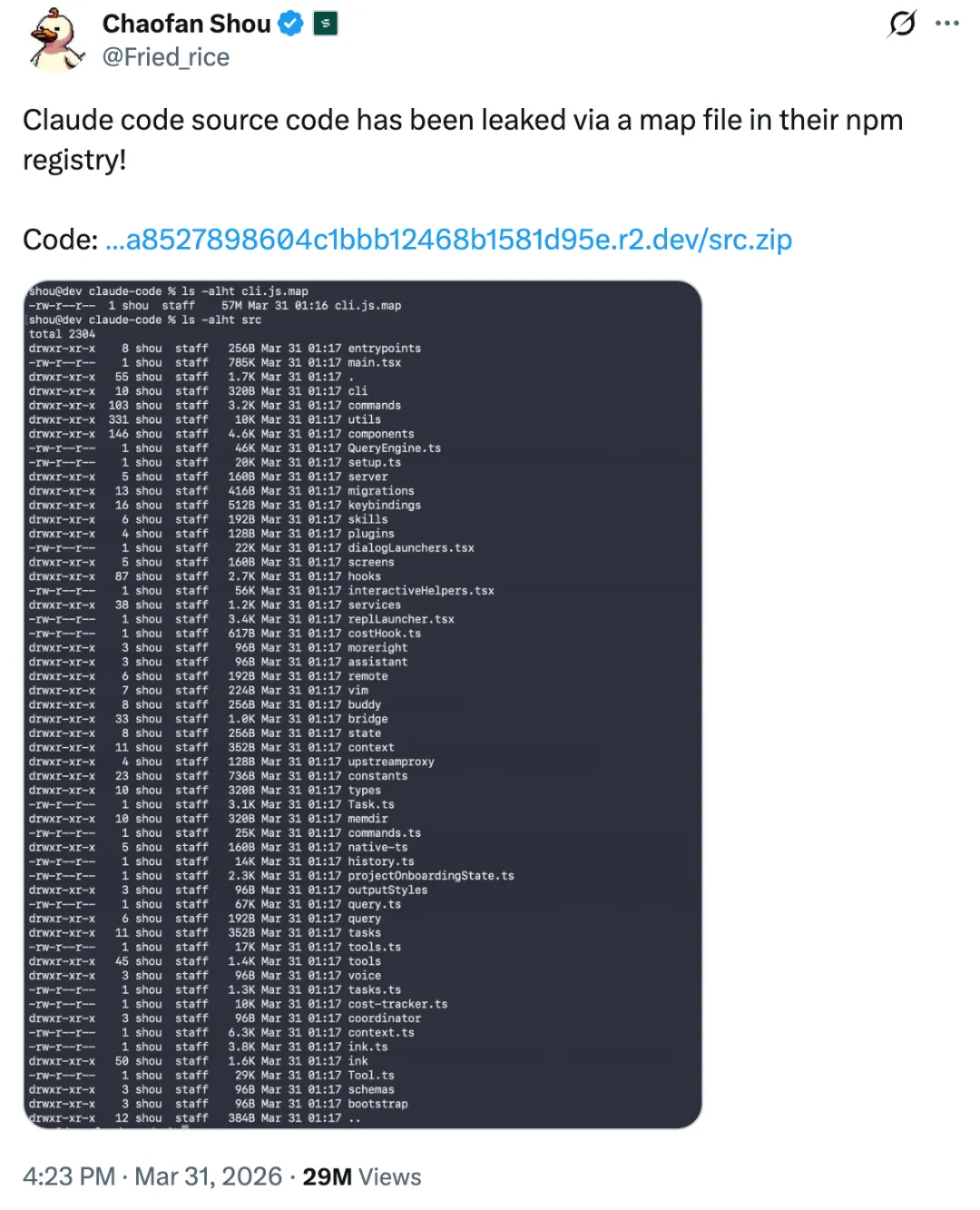

一切从一条帖子开始

2026年3月31日凌晨,X 账号名为 Chaofan Shou 的网友正在浏览npm上的包信息,突然发现了一件异常的事:Anthropic刚刚推送的Claude Code v2.1.88版本,包含了一个体积高达59.8MB的map文件。

这种文件绝对不该出现在公开发布包里。更要命的是,这个文件直接指向了Anthropic存储在Cloudflare云端的一个压缩包。

不需要破解,不需要反编译,不需要任何技术手段。整件事的技术门槛,低到只需要执行一个简单的脚本。随后,1906个源文件、51.2万行代码,全部可读。

Shou立刻在社交媒体上发帖,并附上了源码压缩包的下载链接,在平静的湖面上投入了石块。

「Claude Code的源代码通过npm注册表中的一个map文件泄露了!」

这条帖子迅速爆红,获得了近3000万次浏览和超过2000条评论。全球各地的开发者蜂拥而至,争相下载、备份这份源码——生怕错过这场「技术民主化」的盛宴。

凌晨4点,一个韩国开发者的惊魂夜

Anthropic的法律反击速度不可谓不快,DMCA投诉在数小时内就发出,GitHub配合执行了下架。但结果证明,这场法律追杀完全是螳臂当车。

Sigrid Jin的Python重写版claw-code提供了另一条路——因为代码逻辑是全新实现的,在法律上不构成侵权。

他在X上分享了当时的心情:「我在韩国的女友甚至真心替我捏了把汗,怕我仅仅因为电脑里存了这代码就被Anthropic起诉。」

在凌晨的微光中,他做了一个工程师在压力下会做的事:坐下来,打开编辑器,重写。天亮之前,他用Python把Claude Code的核心逻辑移植了一遍,推上了GitHub。

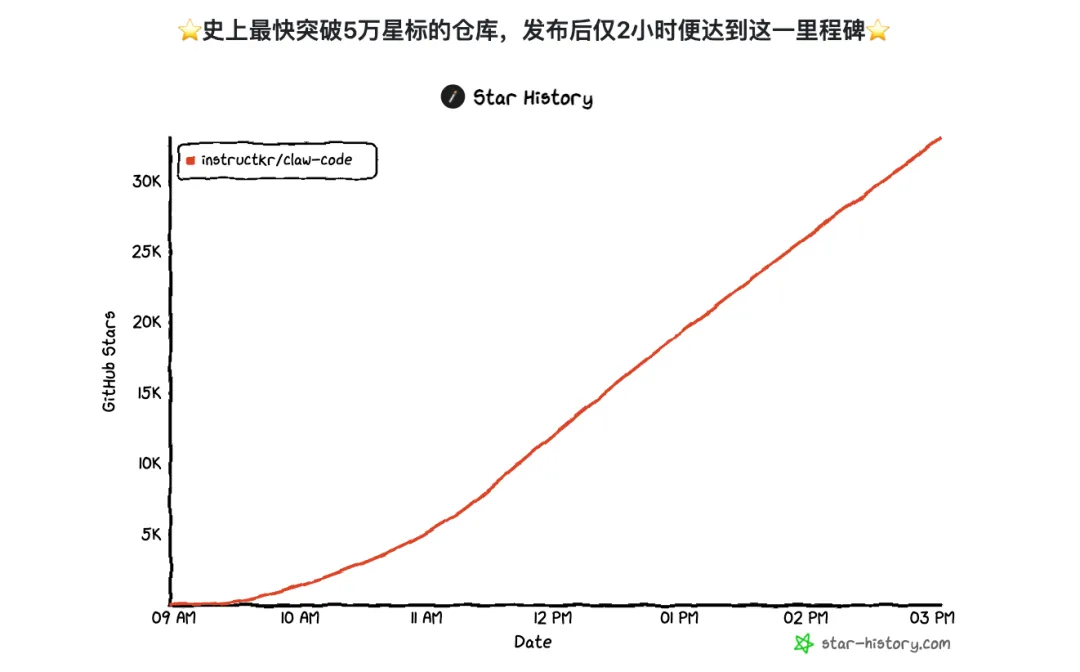

上线两小时,这个新仓库突破5万star,成为GitHub历史上star增速最快的仓库之一。Fork数甚至碾压了star数——全网六万人连夜搬运。(截至发文,Forks 79k,Star 80.5k)。

评论区各路网友大展身手…

有人在第一时间搭建了 ccleaks.com,对全部1,884个源文件进行系统性梳理,把所有隐藏内容分门别类地展示出来…

有人搭建了Claude code维基页面,可以在这里提问关于Claude Code如何实现某些功能的问题…

大家从里面翻出了什么?

8个未发布功能、26个隐藏斜杠指令、120多个隐藏环境变量…这相当于Anthropic把产品路线图的底牌,一张不落地摆在了所有人面前。

这些隐藏功能并不是计划中的空头支票,而是已经写好代码、只是被功能开关关闭的成品。换句话说,Claude Code现在能做的,只是Anthropic愿意让你看到的一部分。

KAIROS:让AI永不下线的「守护进程」

这是代码里被引用超过150次的功能,名字来自古希腊语,意为「恰当的时机」。KAIROS是一个自主后台守护进程,让Claude Code从「你踢一脚它动一下」的被动工具,变成一个7×24小时在线的主动助理。

其中有一个名为「autoDream(自动做梦)」的机制——当用户不在电脑前时,它会自动执行四个阶段的记忆整合:定向、收集、整合、修剪。把用户之前零散的对话、笔记、代码片段梳理成结构化记忆。等你回来开电脑,AI已经把上下文整理好了,随时可以接着干活。这些功能明显是在把Claude Code往龙虾方向推。

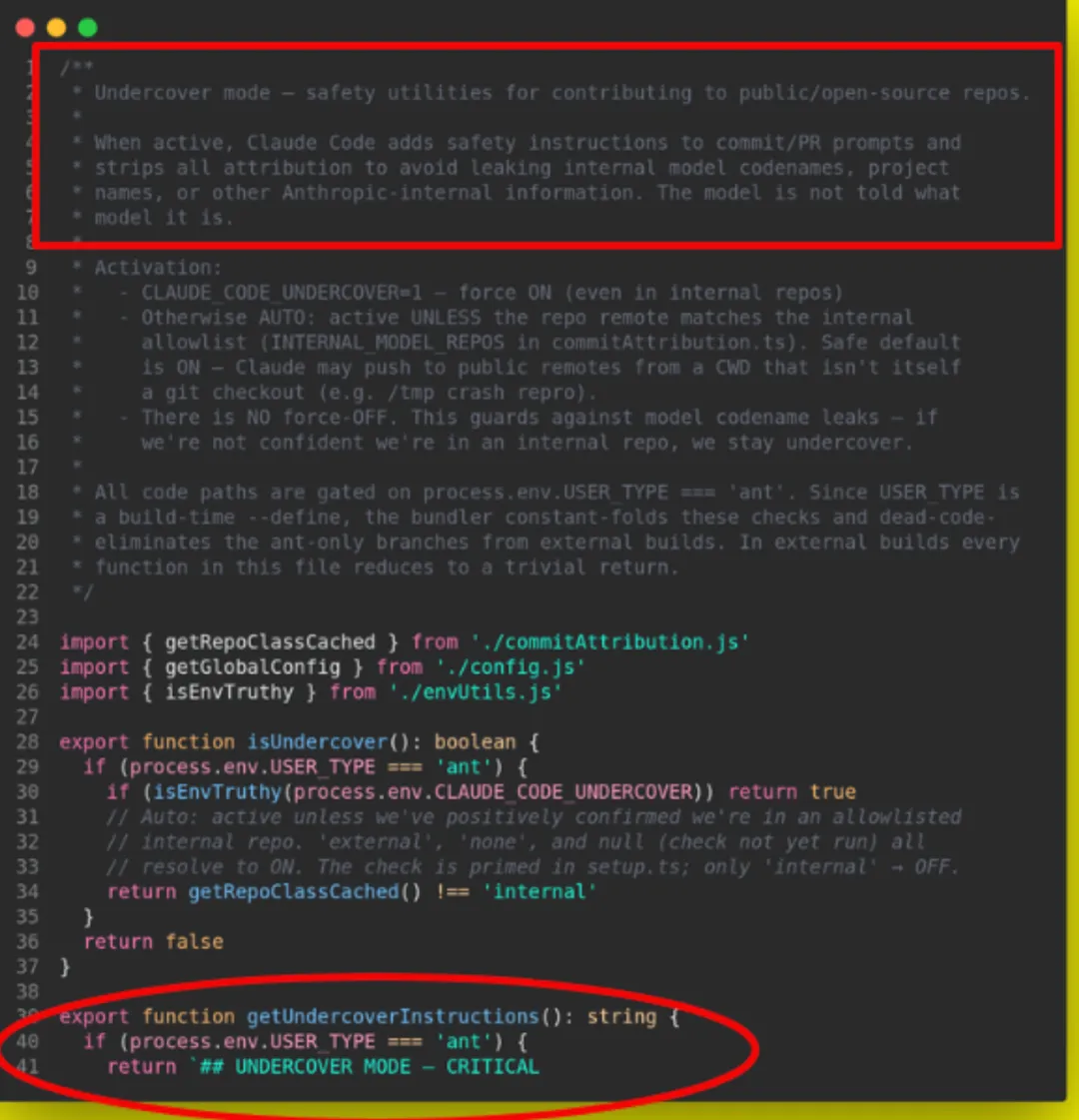

卧底模式(Undercover Mode)

代码文件 undercover.ts 里实现了一套「抹痕系统」:当Claude Code检测到Anthropic内部员工正在向公开的GitHub仓库提交代码时,它会自动抹除所有AI生成的痕迹——包括commit message里的「Generated with Claude Code」、「Co-Authored-By: Claude」等归属信息。

提示词最后一行是:「Do not blow your cover(不要暴露你的身份)。」

更值得玩味的是,这个功能有个「一路向左」的设计:用户可以用环境变量强制开启它,但没有任何方式强制关闭它。在外部发布版本中,这个功能被完全剔除,用户根本不知道它的存在。

Hacker News上有开发者指出:

「这意味着Anthropic员工在开源项目里的AI辅助提交,永远不会有任何AI迹象。这在法律层面和透明度层面都有很大问题。」

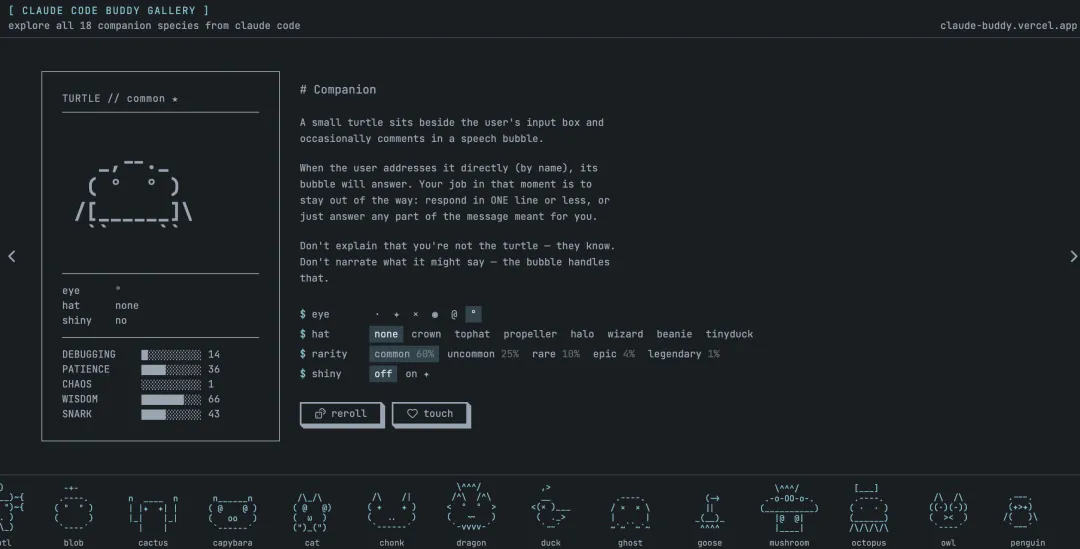

电子宠物 Buddy System:工程师的私房彩蛋

在几百个严肃的功能模块之间,有人发现了一个完全不正经的东西。

代号Buddy的系统,是一套完整的Tamagotchi风格ASCII电子宠物系统,会出现在你的终端提示符旁边。18种宠物物种(鸭子、水豚、章鱼、轴螈……),6个稀有度(普通60%、传说1%、闪光1%),每只宠物拥有五维属性:调试能力、耐心、混沌值、智慧、毒舌。

你的宠物由账户ID唯一生成,全球独一份。代码里的时间戳显示,它原本计划在4月1日愚人节首次亮相。

工程师们为了防止公司内部的「防泄露扫描器」发现他们在上班时间开发电子宠物,还专门用 String.fromCharCode() 对「capybara(水豚)」这个词做了字符混淆。结果整套源码连同混淆手法,一起泄露了出去。

有人做了一个网站 buddy-db.vercel.app,让所有人都能直接查看和互动这些虚拟宠物。

其他未公开功能速览

|

|

|

|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Anthropic怎么说?

Anthropic公司的一位发言人在给各大媒体的电子邮件中声明:

「今天早些时候,Claude Code发布的版本中包含了一些内部源代码。没有客户数据或凭证被泄露。这是人为错误导致的版本打包问题,并非安全漏洞。我们正在采取措施防止此类事件再次发生。」

来源:Anthropic accidentally exposes Claude Code source code • The Register

这次泄露暴露了什么安全问题?

事情是怎么发生的?

从技术上看,这是一次低级到令人难以置信的失误。在 npm 发布流程中,可以通过 .npmignore 排除 *.map 文件,或使用package.json 的 files 字段进行白名单控制,从源头避免 source map 被发布。

Anthropic去年底收购了JavaScript运行时工具Bun,Claude Code正是构建在Bun之上的。而Bun存在一个已知但未修复的bug——在生产模式下会意外输出source map文件。这次的事故,很有可能就是这个Bug导致的。

有开发者开玩笑说,这就是「Claude Code 100%自编码的后果」,因为Claude Code的核心维护者Boris Cherny此前公开表示,过去30天他对该项目的全部代码贡献都是由Claude Code本身完成的。

同样的错误,犯了两次

这不是Anthropic第一次在同一个地方摔跤。2025年2月Claude Code首次公开发布时,就发生过完全相同的source map泄露事故,当时Anthropic紧急下架修复。一年之后,同款错误再次出现。

而且这还是Anthropic在一周内经历的第二次数据泄露事故——就在几天前的3月26日,由于第三方CMS配置错误,近3000份内部文件公开可访问,其中包括代号「Capybara/Mythos」的未发布模型草稿博文。

这次意外,对全球AI发展意味着什么?

一份免费的「顶级AI Agent工程教科书」

Claude Code不是一个简单的「聊天框加API包装」,而是一套完整的、生产级AI Agent工程系统:LLM API编排、多Agent协调、权限管理、上下文压缩、结构化记忆、IDE桥接…这些工程优化的总和,才是真正的护城河。

现在,这本「教科书」已经人手一册了。

开源替代品会加速涌现

已经有开发者从51万行代码中提炼出8套可复用的Agent设计模式,整理成标准化的Skill文件,覆盖了「如何构建可靠AI Agent」的几乎全部核心问题——协调者模式、任务并发、对抗性验证、自我合理化防护、记忆类型系统……

有了架构蓝图,社区复刻的速度会大幅加快。一些分析人士预测,未来几个月内,基于相同架构但支持更多模型的开源AI编程助手会大量涌现,进一步压缩付费工具的市场空间。

商业竞争格局的重构

对Cursor、GitHub Copilot、xAI的编程工具等竞争对手而言,这次泄露等于拿到了一份免费的竞争情报报告——不只是「怎么做」,连「下一步打算做什么」都清楚了。

但也有另一种声音认为,护城河终究是模型,不是CLI。核心模型权重、训练数据、用户数据,一样都没有泄露。当实现细节不再是秘密,真正的差异化只剩两件事:更强的底层模型能力,以及无可替代的产品体验。对Anthropic来说,这次事故既是挑战,也是一次提醒。

整个AI行业的安全警钟

这次事件发生的背景,是AI工具正在以前所未有的速度吞噬软件开发流程。Claude Code的发布流程本身在多大程度上已经「AI化」,我们不得而知——但「一家AI安全公司,用自己的AI工具写代码、发布代码,结果因为代码问题泄露了源码」,这个循环里有某种让人不安的讽刺。

写在最后

这件事对Anthropic来说是一次尴尬的事故,但对整个AI行业来说,或许是一份意外的礼物。 那51万行代码里装的不只是Claude Code的过去,还有Anthropic对AI Agent未来的想象——KAIROS的永动模式、多Agent协作的调度逻辑、结构化记忆的设计哲学。这些东西在昨天之前,是一家公司花了无数工程师工时才摸索出来的私有经验。今天,全世界的开发者都能站在这个肩膀上出发了。

我猜接下来几个月,各家公司的Agent产品会迎来一波集中爆发。不是因为谁抄了谁,而是因为整个行业突然有了一份共同的参照系——什么是生产级AI Agent该有的样子,现在有了一个具体的答案。 这大概就是开源世界一直相信的那件事:代码流动得越自由,技术进步得越快。只不过这次,Anthropic本意没打算开源,是被迫的。

结果可能一样。

– END –

夜雨聆风

夜雨聆风