Claude Code 源码泄漏事件深度分析

Claude Code 源码泄漏事件分析

一次低级的配置失误,让全球顶级 AI 公司的核心技术全网公开。这究竟是行业的灾难,还是开发者的福音?

开篇:一组震撼数据

金句:在 AI 行业,最贵的不是代码,而是信任。一次失误,足以让数年建立的技术壁垒瞬间透明化。

一、事件回顾:一场本可避免的”意外”

时间线还原

泄露原因:一个”低级”的失误

通俗解释:Source map 就像是一本”密码本”,能把编译后的代码还原成原始源码。想象一下,这就像是一家银行金库的设计图纸,被无意中贴在了银行大门上。

二、泄露了什么?AI 行业的”技术底牌”被看光了

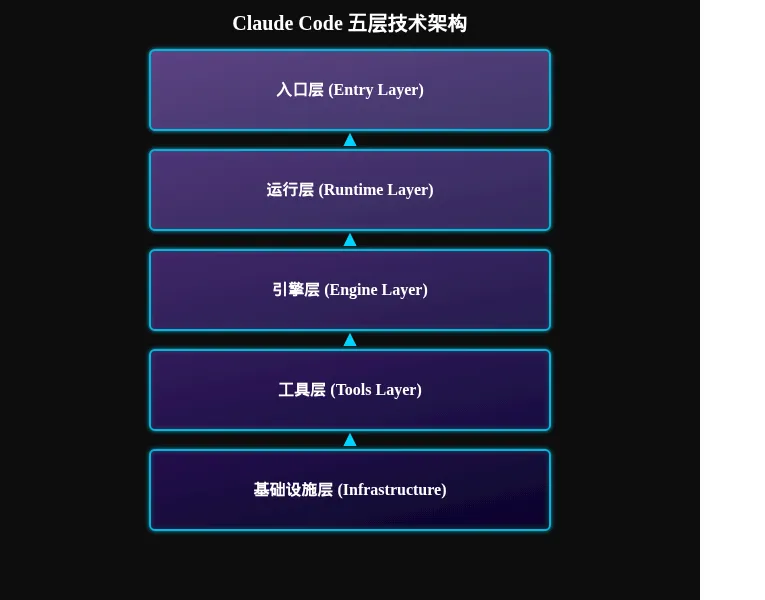

1. 完整五层架构曝光

关键点:这套架构是 Anthropic 数年研发的核心成果,如今完全公开。

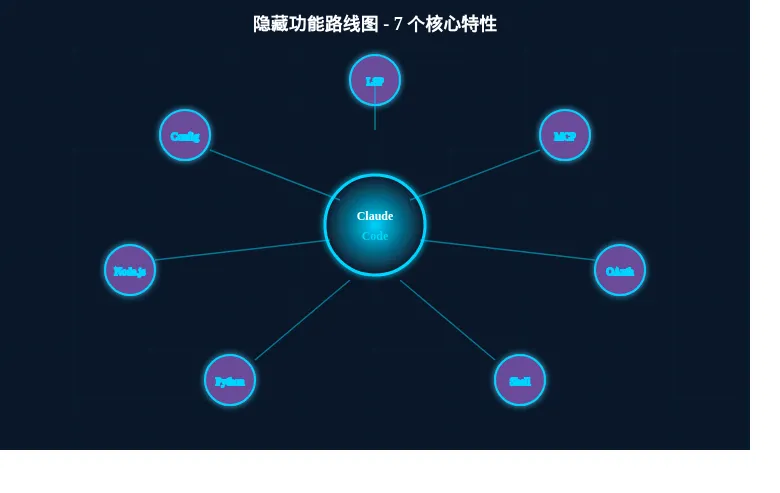

2. 未发布功能路线图:提前剧透半年

|

|

|

|

|---|---|---|

| KAIROS |

|

|

| Buddy System |

|

|

| Undercover Mode |

|

|

| Ultraplan |

|

|

| VOICE_MODE |

|

|

| Auto Mode |

|

|

| Coordinator Mode |

|

|

金句:在 AI 行业,最大的秘密不是”现在有什么”,而是”未来要做什么”。而这次,Anthropic 把未来都剧透了。

3. 安全机制:防御体系透明化

-

每次工具调用需经过 6 层权限验证 -

包含 25+ 个 bash 安全验证器 -

路径遍历、Unicode、注入攻击防护一应俱全

-

注入假工具定义到系统提示 -

使用加密签名摘要,防止竞争对手通过 API 流量学习

4. 代码质量:引发社区争议

-

单个文件最大达 803,924 字节(4,683 行 TypeScript) -

460 个eslint-disable 注释(关闭代码检查) -

50+ 个 标记为已弃用但仍在使用中的函数 -

多个超过 4,000 行的巨型文件

启示:完美主义是交付的敌人。有时候,”够用就好”比”完美无缺”更重要。

三、为什么重要?一场影响深远的”技术地震”

对 Anthropic:技术优势被削弱

|

|

|

|

|---|---|---|

| 品牌声誉 |

|

|

| 技术优势 |

|

|

| 产品路线 |

|

|

| IPO 进程 |

|

|

| 法律风险 |

|

|

“此次事件未涉及或暴露任何敏感的客户数据或凭证。这是由于人为错误导致的发布打包问题,而非安全漏洞。”

金句:在 AI 竞赛中,代码是武器,架构是战术。武器可以复制,战术一旦公开,优势就不复存在。

对竞争对手:免费获得技术蓝图

“对 Anthropic 而言,这不仅是安全疏失,更是战略性的知识产权失血。泄露让竞争对手获得了一份免费的技术蓝图。”

“这次泄露对 AI 生态的首要影响,是能够帮助其他 Agent 团队提升产品水准。对于原本在 AI Agent 方面能力一般的开发者而言,这毫无疑问是一次’抄作业’的机会,产品水平快速拉齐。”

-

OpenAI:正在开发同类编码工具,此次泄露加速研发进程 -

Google:获得免费架构参考,可缩短 6-12 个月研发周期 -

xAI:可借鉴多 Agent 编排和权限系统设计 -

国内大厂(阿里/腾讯/字节/华为):可直接参考顶级 Harness 实现

对开发者:机遇与风险并存

-

免费获得顶级 AI Agent 实现参考 -

可学习先进的 Agent 架构设计 -

降低 AI 编程工具研发门槛

-

使用泄露代码存在版权风险 -

源码中可能隐藏未公开漏洞 -

供应链攻击风险增加

“此次事件更适合界定为 source map 误披露导致部分源代码可被还原,而非权利人主动授权公开源代码。下载相关代码后将其用于复制、改写、嵌入自有产品,可能触发著作权、商业秘密、乃至不正当竞争层面的复合风险。”

通俗解释:就像你在街上捡到一份机密文件,看看可以,但拿去用就可能惹上麻烦。

四、深度分析:AI 行业的竞争壁垒到底是什么?

一个核心发现

金句:LLM 本身日益商品化,真正的竞争优势在于编排层。

长程自主性:下一个战场

-

在后台持续运行 -

自动记忆和整合信息 -

长时间自主执行复杂任务

金句:未来的 AI,不是”你问它答”,而是”它主动帮你做完”。

反蒸馏:新的安全课题

️ 五、安全启示:给开发者和企业的建议

发布流程安全:三条铁律

Bun 构建时禁用 source map bunbuild–sourcemap=none # 或在.npmignore 中明确排除 *.map !.npmignore

金句:一次失误是意外,两次失误是疏忽,三次失误是文化问题。

供应链安全:立即检查

“在源码泄露的同一时间窗口内,npm 上的 axios 包遭到了独立的供应链攻击。如果通过 npm 安装或更新了 Claude Code,可能无意中引入了含有远程访问木马 (RAT) 的恶意版本。”

-

检查并更新 axios 依赖(避免恶意版本 1.14.1 或 0.30.4) -

轮换 SSH 密钥和 Git Token -

审查 npm 包发布流程 -

实施自动化发布守卫

企业用户:关注数据隐私

-

自动更新器 -

错误报告 -

负载大小遥测

-

错误报告可能泄露项目路径信息 -

遥测系统收集使用数据 -

自动更新器可被远程控制

六、结尾:一场意外引发的行业思考

三个关键问题

1. 开源 vs 闭源的边界在哪里?

2. 真正的护城河是什么?

金句:代码可以泄露,架构可以模仿,但工程文化、发布流程、安全守卫——这些软性能力,才是难以复制的护城河。

3. 开发者该如何应对?

-

学习架构思想,而非直接复制代码 -

注意法律风险,避免商业用途 -

强化自身安全,避免重蹈覆辙

核心观点:在 AI 行业,最大的风险不是技术被模仿,而是停止创新。

️ 互动话题

-

你会研究这份泄露代码吗?为什么? -

你认为 Anthropic 应该如何应对? -

AI 公司的真正护城河到底是什么?

-

VentureBeat: Claude Code’s source code appears to have leaked -

Fortune: Anthropic mistakenly leaks its own AI coding tool’s source code -

The Register: Claude Code’s source reveals extent of system access -

36 氪:Claude Code 源码泄露 7 小时:8 大新功能/26 个隐藏指令/6 级安全架构

夜雨聆风

夜雨聆风