揪出 Claude Code 源码泄露的人,竟然是个自嘲「门外汉」的华人小哥

导语

AI安全领域的”优等生”Anthropic,最近经历了一场堪称教科书级别的尴尬。旗下核心产品 Claude Code 的近2000份文件、超50万行TypeScript源码,像被风吹散的保密档案,一夜之间铺满了整个互联网。

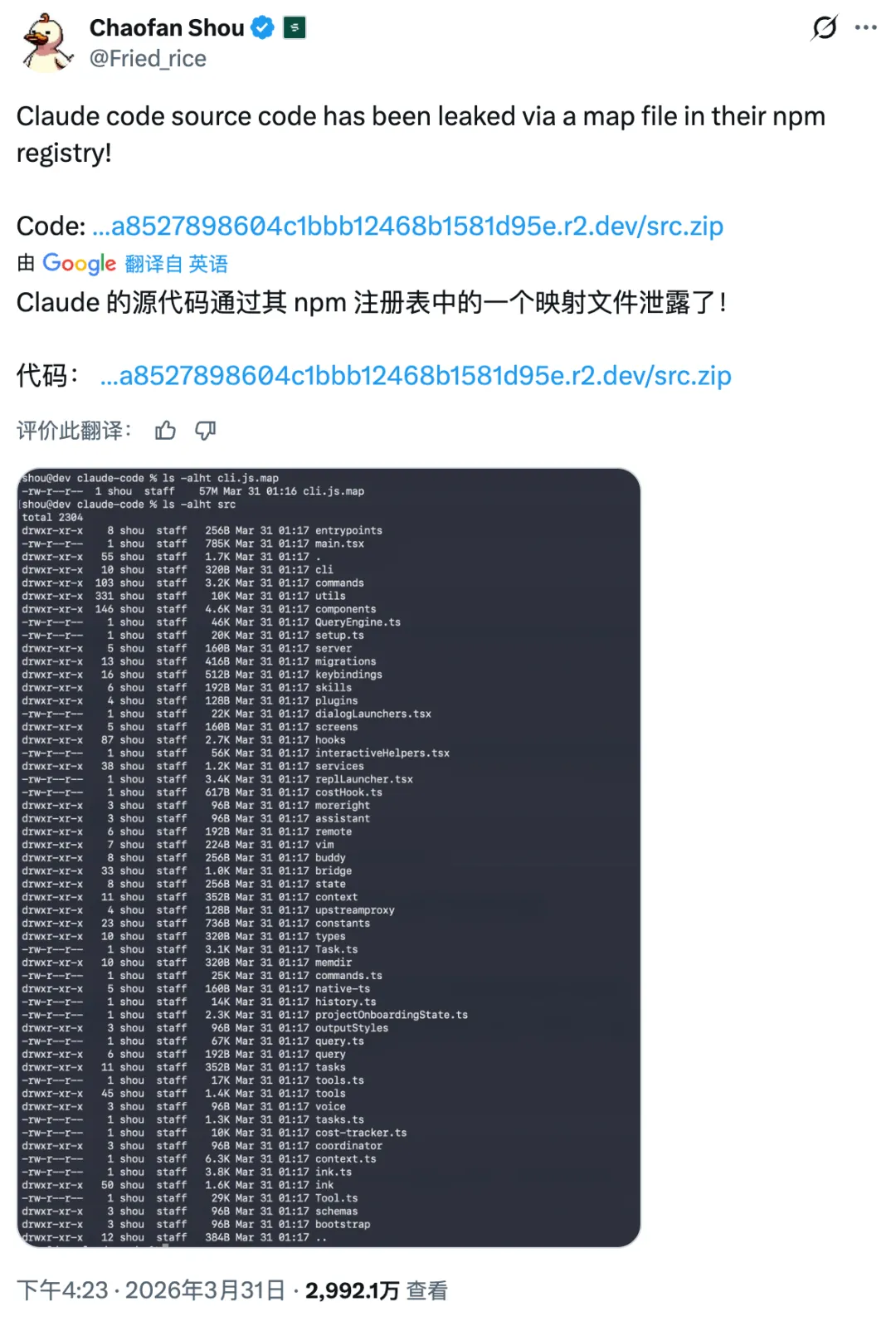

这不是电影里的黑客攻防战,而是一场由”配置失误”引发的源码裸奔。而揭开这层遮羞布的,竟是一位在GitHub主页自嘲为“高级脚本小子(senior script kiddie)”的95后华人工程师——寿超璠(Chaofan Shou)。

1. 事件核心:50万行代码是如何”意外开源”的?

如果把软件发布比作交付一座精装房,Anthropic这次犯的错误,相当于把建筑结构蓝图、水电管线图和保险箱密码一起装进了交房礼包,还贴心地标注了”请随意查阅”。

问题的根源在于Source Map(源码映射)。现代前端开发通常会将人类可读的TypeScript源码”编译”成机器优化的JavaScript(类似把设计图纸变成实体建筑)。Source Map就是连接这两者的”罗塞塔石碑”——它记录了压缩后的代码每一行对应着原始源码的哪个位置。

Anthropic在某次版本发布中,误将这些调试用的Source Map文件打包进了公开发布的软件包。这就像在藏宝图背面印上了宝藏的GPS坐标,外界可以直接顺藤摸瓜,从Anthropic的云存储中下载原始源码压缩包。

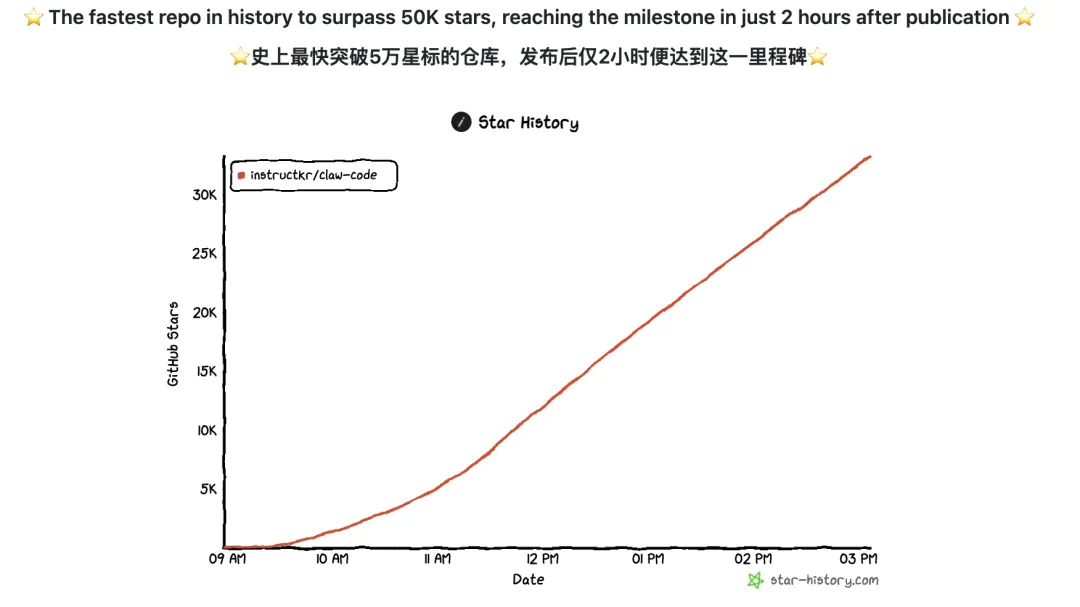

开发者@realsigridjin眼疾手快,第一时间将泄露的源码备份至GitHub仓库instructkr/claude-code,标注为”Claude Code Snapshot for Research”。该仓库上线仅两小时,Star数便突破五万,创下GitHub历史上最快达成这一里程碑的纪录。

2. 发现者画像:4.0绩点退学的”扫地僧”

发现这次泄露的寿超璠(GitHub: shouc,X: @shoucccc),履历堪称”非典型天才”的标准模板。

2019年进入加州大学圣塔芭芭拉分校(UCSB)攻读计算机本科,他仅用约2年时间便以满绩点4.0提前毕业。在LinkedIn学历栏的备注里,他轻描淡写地写下两个字:“too easy”。有网友算过,这相当于连续六个学期保持”高考冲刺模式”,门门课程拿最高分。

本科毕业后进入加州大学伯克利分校攻读计算机博士,师从程序分析领域知名教授Koushik Sen。然而这段学术生涯的终点同样充满戏剧性——他选择退学创业,在LinkedIn上留下备注:“dropped out lol(退学了,哈哈)”。

2023年,他联合创立Web3安全公司Fuzzland并担任CTO,主导开发智能合约自动化测试工具。该公司协助追回了超过3000万美元的被盗链上资产,目前保护资产规模超50亿美元。他在GitHub上的开源项目ityfuzz(智能合约模糊测试工具)已获超1100个Star。

在漏洞赏金领域,他从2016年起就已活跃,累计获得赏金约190万美元,披露过的漏洞覆盖Twitter、Etherscan、Devin.ai、Google Nest等知名平台。

最耐人寻味的是他在GitHub主页的自我定位——“senior script kiddie”。在黑客文化中,”script kiddie(脚本小子)”通常是嘲讽那些不懂原理、只会照搬工具的技术门外汉。而将这个标签贴在主页最显眼位置,既是对技术圈等级森严文化的调侃,也透露出一种”重剑无锋,大巧不工”的自信。

3. 余波与反思:当”安全洁癖”遭遇现实冲击

Anthropic官方迅速回应,将此次事件定性为“打包环节的人为失误”,强调并非安全入侵,且无任何用户数据或凭证遭到泄露。Claude Code之父Boris Cherny也在X上简短留言,确认这只是”开发者的操作失误”。

马斯克也没错过这场热闹,转发网友调侃Anthropic”现在比OpenAI更开放”的帖子,并留下一句”太绝了😂”。

讽刺的是,Anthropic一直将自己包装为”最在乎安全的AI公司”,强调闭源是为了防止技术滥用。然而这次事件暴露了一个残酷现实:供应链安全(Supply Chain Security)的漏洞,往往比模型对齐(Alignment)问题更难防范。再严密的AI安全策略,也可能败给一个错误的CI/CD配置。

深度点评:透明化时代的安全悖论

这次泄露事件对AI行业的影响是深远的,它像一面镜子,照出了当前AI安全体系的结构性矛盾。

首先,”安全 through obscurity(通过隐匿实现安全)”的策略正在失效。Anthropic、OpenAI等头部公司坚持闭源,理由是防止恶意行为者利用模型。

然而,源码的意外泄露证明,闭源并不能阻止技术扩散,反而可能因缺乏足够的白帽子审查而积累系统性风险。这次泄露后,Claude Code的架构、Prompt工程技巧、安全过滤机制都将暴露在聚光灯下,这对依赖”保密”构建护城河的商业模型是沉重打击。

其次,AI公司的工程文化面临重构。 当企业花费数十亿美元训练模型、构建安全护栏时,却可能在最基础的软件发布流程(Release Engineering)上翻车。这提醒我们,AI安全不仅是算法问题,更是软件工程问题。随着AI系统权限越来越高(如Claude Code能直接操作开发者环境),其供应链的单点故障风险也在指数级上升。

最后,独立安全研究员的价值被重新定义。 寿超璠这类兼具学术背景、实战能力和”黑客精神”的研究者,正在成为AI时代的事实监管者。他们没有官方头衔,却能用一次随意的技术检查撬动市值数十亿公司的安全基座。这预示着未来AI安全的竞争,将是开源社区与闭源巨头之间动态博弈的持久战。

长远来看,这次泄露可能会加速”透明性即安全”范式的崛起。 正如密码学从”算法保密”发展到”密钥保密”的Kerckhoffs原则,AI系统或许也需要接受:真正的安全不应依赖源码的隐匿,而应建立在架构本身的鲁棒性之上。对于开发者而言,这50万行代码反而可能成为研究顶级AI Agent架构的珍贵教材,推动整个行业向更开放、更安全的方向演进。

💡 互动提问

如果AI公司必须在”完全闭源但可能隐藏严重漏洞”与”完全开源但可能被恶意利用”之间做选择,你认为是否存在第三条道路——比如”向 verified 白帽子有条件开放”的机制?这种折中方案在现实操作中最大的技术难点会是什么?欢迎在评论区分享你的观点。

夜雨聆风

夜雨聆风