【MATLAB源码-第413期】基于MATLAB的强化学习的无人机辅助边缘计算任务卸载系统仿真,对比不同的方案.

MATLAB 2024a

1、算法描述

摘要

随着移动互联网、物联网和智能终端应用的持续发展,终端侧业务逐渐呈现出高计算量、强实时性和动态分布等特征。传统仅依赖本地设备处理任务的方式,往往难以同时满足时延、能耗和服务稳定性的要求。移动边缘计算通过将计算能力下沉到网络边缘,为时延敏感型业务提供了新的实现路径;而无人机具备部署灵活、视距链路条件较好、可快速靠近热点区域等特点,使其成为移动边缘计算的重要补充平台。在无人机辅助移动边缘计算场景中,用户设备既可以在本地执行任务,也可以将部分任务卸载至无人机侧处理,因此如何根据通信状态与任务负载动态确定卸载比例,成为影响系统性能的关键问题。现有研究表明,该类问题通常同时涉及通信、计算与资源约束,具有明显的非凸性和动态耦合特征,采用传统静态优化方法虽然能够在特定条件下获得较优解,但在环境变化频繁时往往面临实时性不足和重复求解开销较高的问题。

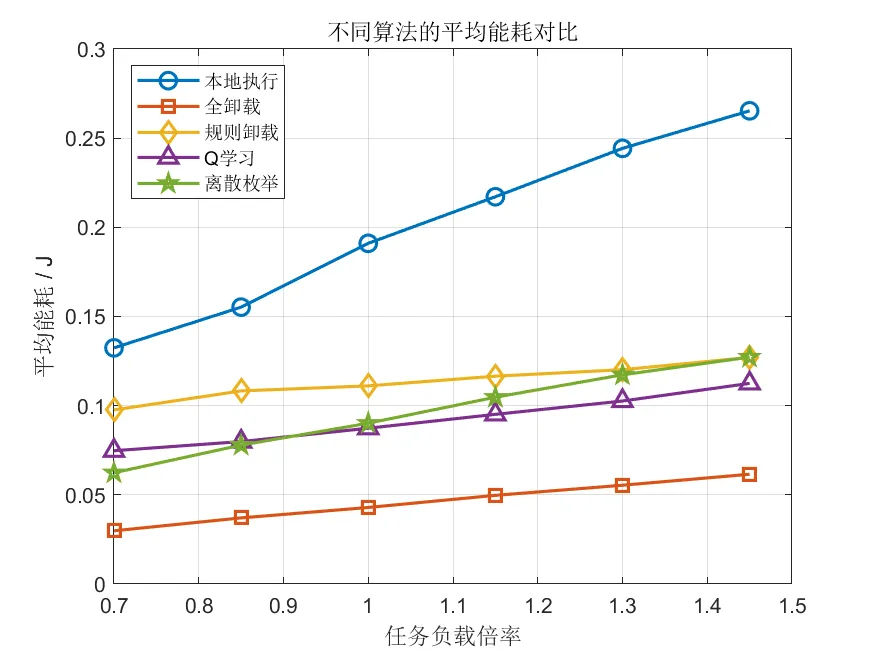

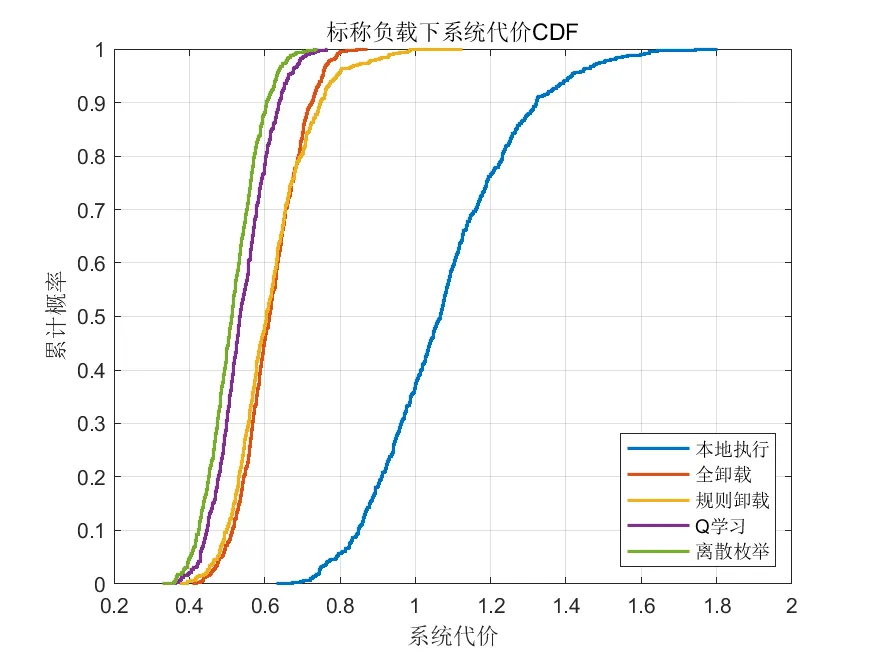

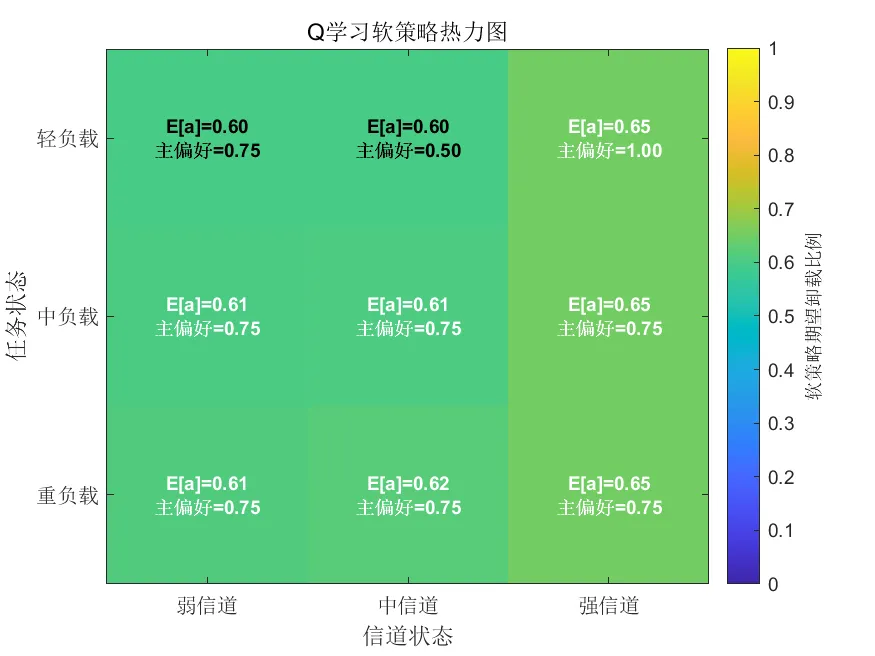

针对上述问题,本文面向无人机辅助移动边缘计算系统,构建了由无人机与多个用户设备组成的任务卸载模型,综合考虑任务处理时延与系统能耗,建立系统代价评价机制,并设计了基于强化学习的任务卸载方法。该方法将信道状态与任务负载作为环境状态,将离散卸载比例作为智能体动作,通过交互学习获得近似最优的卸载策略。在 MATLAB 2024a 平台上,本文构建了本地执行、全卸载、规则卸载、强化学习卸载和离散枚举等多种对比方案,对训练过程、平均系统代价、平均时延、平均能耗、代价分布以及策略映射进行了分析。仿真结果表明,所提出的方法能够在保持较低能耗水平的同时显著改善系统综合代价,并在时延控制方面优于传统固定策略,表现出较好的自适应优化能力。

关键词: 无人机;移动边缘计算;任务卸载;强化学习;系统代价;时延能耗优化

1 引言

移动边缘计算的核心目标,是将计算和存储能力从远端云中心下沉到更靠近用户的位置,以降低业务处理时延并减轻终端计算负担。对于视频感知、应急通信、巡检监测、智能终端协同等场景而言,仅依靠固定地面边缘节点并不能始终保证连续覆盖和快速响应。无人机平台因其机动性强、部署周期短、覆盖位置可调和空地链路灵活等优势,被广泛引入边缘计算网络之中。相关研究指出,无人机与边缘计算结合后,既可以扩展原有地面基础设施的服务范围,也可以在山区、灾害区域、临时热点区域等复杂场景中为用户提供更加敏捷的计算卸载服务。

然而,无人机辅助边缘计算并不只是简单地把计算资源搬到空中。由于无人机的载荷、电池容量、机载处理能力和无线链路条件均受到限制,用户设备在进行任务卸载时必须在本地计算与边缘卸载之间进行权衡。若卸载比例过低,则终端本地计算压力过大,系统时延上升;若卸载比例过高,则可能因传输开销和边缘侧排队负担增加而削弱整体收益。因此,任务卸载问题本质上体现为通信资源、计算资源和能量资源之间的耦合优化问题。已有文献围绕该问题开展了大量研究,包括基于博弈论的建模方法、基于凸优化或分解思想的联合求解方法,以及将轨迹规划、资源分配和任务拆分统一纳入优化框架的研究路径。

从方法演进来看,早期研究多强调在静态或准静态场景下获得解析性较强的次优解。例如,针对多服务提供方环境,有研究将任务卸载建模为层次博弈并引入强化学习机制处理长期收益;也有研究关注用户代理式卸载和联合资源分配问题,通过优化任务比例、带宽和位置等变量改善系统性能。随着场景复杂度提升,研究者开始进一步考虑完成时间、能耗、多用户竞争、服务器部署和轨迹耦合等因素,使问题逐步由单一变量优化扩展为多目标、多约束、动态决策问题。

近年来,强化学习尤其是深度强化学习被越来越多地应用于边缘计算卸载决策中。其主要原因在于,无人机辅助边缘计算环境往往具有时变信道、动态业务到达、资源状态变化以及动作与长期收益之间存在延迟关联等特点,而强化学习能够通过与环境交互逐步学习策略,在难以建立精确解析模型或实时精确求解代价过高时,提供较强的在线适应能力。相关研究已在多无人机任务卸载、大规模调度、轨迹控制以及多目标时延能耗权衡等方面验证了强化学习方法的有效性。

基于上述背景,本文围绕“无人机辅助边缘计算任务卸载方法研究”这一主题,构建适合通信专业本科层次开展系统仿真与性能分析的研究框架。本文并不追求过度复杂的连续控制建模,而是从工程可实现性与方法可解释性出发,采用离散卸载比例与强化学习相结合的方式开展研究。通过对本地执行、全卸载、规则卸载、强化学习和离散枚举等多种方法进行对比,分析强化学习在综合系统代价优化中的作用,从而为无人机辅助边缘计算场景下的任务调度研究提供一套较为完整且具有可扩展性的实现思路。

2 系统场景与问题分析

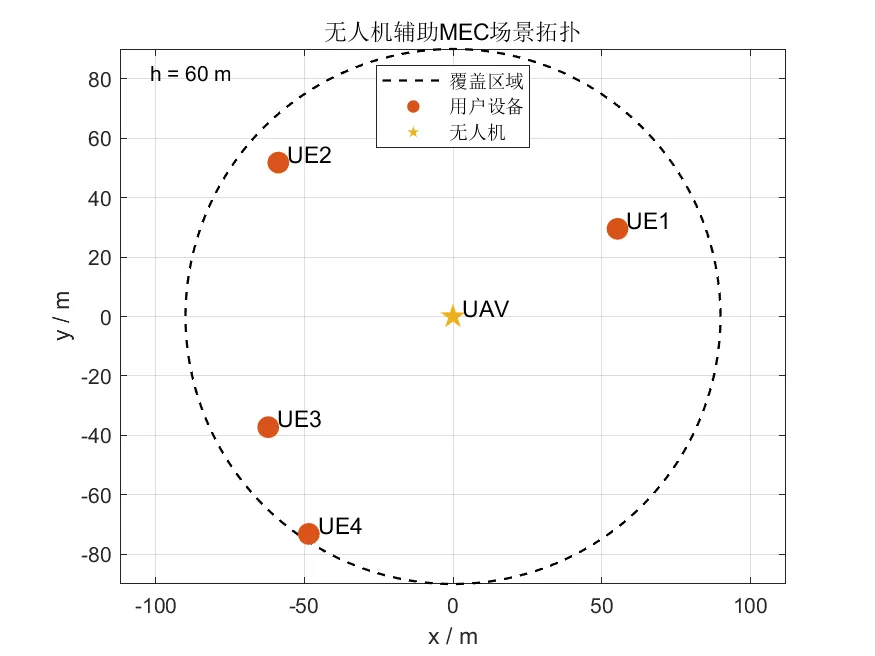

本文考虑的系统由一架搭载计算资源的无人机和多个地面用户设备组成。无人机悬停在服务区域上方,为覆盖范围内的用户提供计算卸载能力。各用户设备在任意时刻均存在一定规模的计算任务,任务既可以在本地处理,也可以按一定比例传输至无人机侧处理。为突出任务卸载机制本身,本文将用户位置视为已知,重点关注信道状态、任务负载和卸载比例对系统性能的影响。

在该系统中,用户执行任务通常面临三个方面的约束。第一是终端本地计算能力有限,当任务负载较高时,本地执行容易导致处理时延明显增加。第二是无线传输存在成本,若在较差信道条件下盲目提高卸载比例,会造成额外的传输时延与发射能耗。第三是无人机侧虽然具备边缘处理能力,但资源仍然有限,不可能无限承载所有用户任务。因此,合理的任务卸载策略不应被理解为“尽量多卸载”,而应根据任务量、链路条件及系统权衡关系动态选择适合的卸载比例。

从优化目标看,本文采用综合系统代价作为核心评价指标。该指标并非单纯追求最小时延,也不单纯追求最低能耗,而是对任务完成时延与资源消耗进行统一刻画。其好处在于,更符合实际通信系统设计中的综合性能需求。以本地执行为例,其传输负担较小,但本地处理时间往往较长;以全卸载为例,用户端能耗可能较低,但无线链路与边缘处理等待带来的时延开销未必理想;而部分卸载则为两者之间提供了折中空间。由此可见,任务卸载问题本质上是一类时延与能耗之间的平衡决策问题。

进一步分析可知,该问题具有明显的非凸性和离散化特征。一方面,通信速率、处理时间和能量消耗之间存在非线性关系;另一方面,若将卸载比例、资源分配和用户状态联立考虑,便会形成混合决策结构。对于此类问题,若完全依赖穷举搜索,虽然能够在小规模情况下得到较优基准结果,但复杂度会随着状态规模增长而快速上升。若直接采用固定规则,则易于实现,却难以在动态环境中持续保持较优表现。因此,引入能够根据环境状态不断修正决策的强化学习机制,具有较强的工程合理性。

3 基于强化学习的任务卸载方法设计

本文采用强化学习中的离散决策思想构建任务卸载模型。将系统运行过程视为智能体与环境持续交互的过程,其中用户侧任务状态和空地链路状态共同构成环境状态,离散化后的卸载比例构成动作集合,而每次决策后的系统代价则用于反馈策略优劣。通过不断试错与更新,智能体可以逐步学得在不同状态下应采取的更优卸载动作。

在状态设计上,本文从工程简化角度出发,将任务负载划分为轻负载、中负载和重负载三个等级,将链路条件划分为弱信道、中信道和强信道三个等级。这样做的主要目的,是在保持模型可解释性的同时降低状态空间规模,使强化学习训练过程更加稳定,也便于对所得策略进行可视化分析。虽然这种处理无法完全覆盖连续状态空间的全部细节,但对于本科层次的系统建模与原理验证而言,能够较好地平衡复杂度与表达效果。

在动作设计上,本文不采用连续卸载比例,而是选取若干具有代表性的离散动作,例如低比例卸载、中等比例卸载和高比例卸载等。与连续控制相比,离散动作的优点在于实现清晰、训练稳定、便于与规则方法及枚举基准进行对照。智能体在不同状态下从动作集合中选择一个卸载比例,并据此将计算任务划分为本地执行部分和无人机执行部分,再计算相应的时延、能耗和综合系统代价。

在奖励设计上,本文将系统代价的相反数作为奖励信号。这样一来,代价越低,对应奖励越高,强化学习的目标便转化为最大化长期平均奖励。为了避免智能体仅偏向某一项性能指标,本文将时延与能耗同时纳入代价评价中,使得学习过程能够围绕综合性能而不是单一指标展开。这种设计与现有文献中关于多目标卸载优化的基本思想是一致的,即并非追求绝对最小时延或绝对最低能耗,而是在约束条件下寻找综合效益更好的方案。

在学习机制上,本文采用值函数更新方式,通过训练回合不断修正状态—动作价值估计。训练初期,智能体以较高概率进行探索,以尽可能接触不同状态动作组合;随着训练推进,策略逐渐从探索转向利用,从而形成更稳定的卸载决策。该方法的核心优点在于,它不依赖对复杂非凸问题的实时精确求解,而是将大量计算压力前移至训练阶段,在在线决策时只需查找当前状态下的较优动作即可。对于时变环境中的实时卸载问题,这种策略具有较好的应用潜力。已有研究在层次强化学习、多智能体强化学习以及多目标强化学习等方向上也表明,强化学习能够有效提升无人机辅助边缘计算中的决策效率与系统收益。

4 仿真方案与结果分析

本文在 MATLAB 2024a 平台上构建无人机辅助移动边缘计算仿真系统,以便对不同卸载策略进行统一比较。仿真中设置一架无人机位于服务区域中心上方,多个用户设备分布于其覆盖范围内。为评价所提方法的性能,本文设置了五类对比方案,分别为本地执行、全卸载、规则卸载、强化学习卸载和离散枚举基准。其中,本地执行与全卸载分别代表两类极端策略,规则卸载表示依据经验阈值进行决策的方法,离散枚举则可视为小规模状态下的近似最优参照,而强化学习方法是本文重点研究对象。

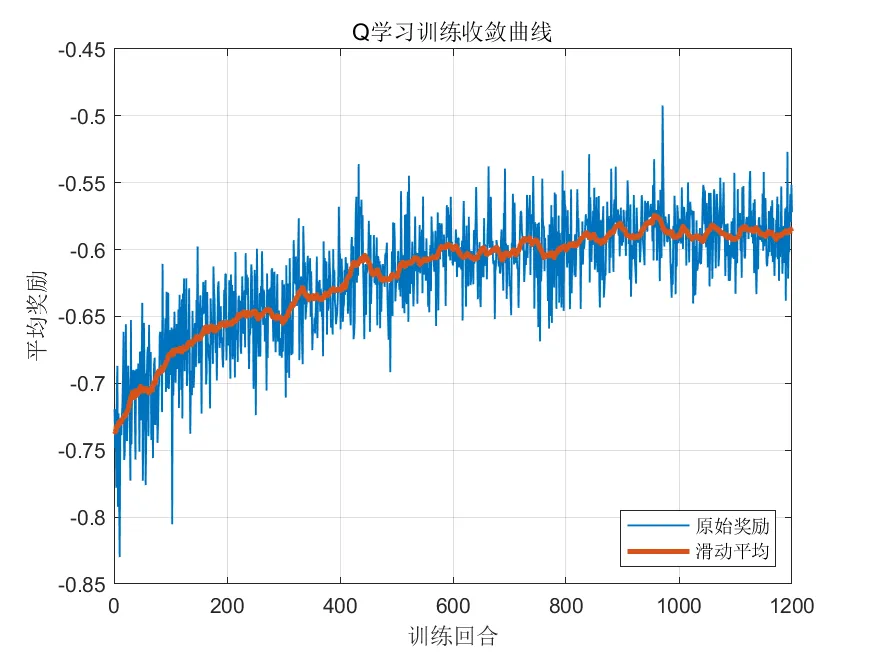

从训练过程来看,平均奖励曲线随训练回合增加而整体上升,说明智能体在不断交互中逐步学会了更优的卸载行为。尽管原始奖励存在一定波动,但滑动平均曲线呈现出较清晰的收敛趋势,表明该方法已经从初始的随机探索阶段过渡到较为稳定的策略学习阶段。这一现象符合强化学习在离散状态决策问题中的一般规律,也说明本文的状态划分和奖励设计能够为训练提供有效的方向性引导。

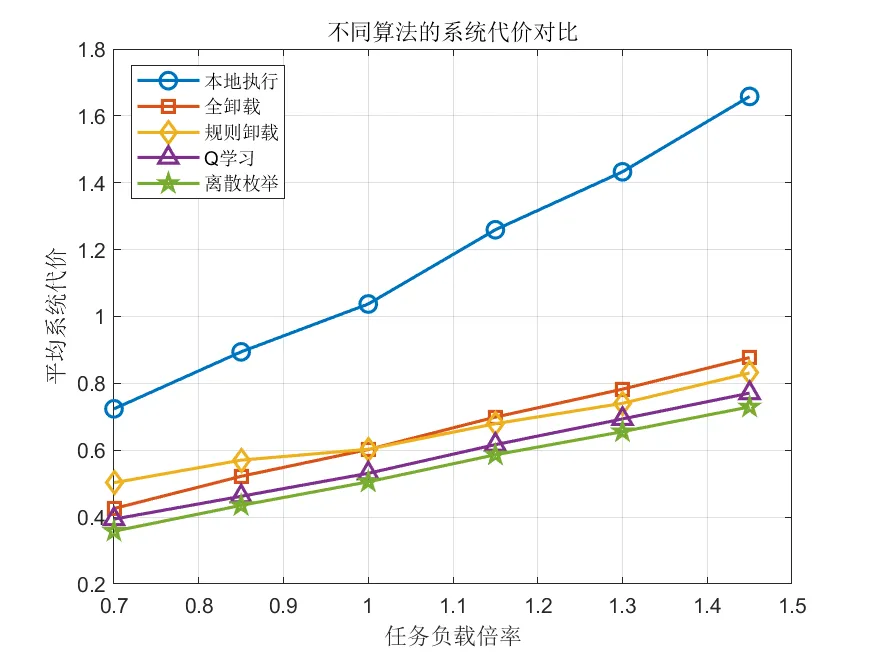

从平均系统代价的对比结果来看,随着任务负载增加,各种方法的系统代价均呈现上升趋势,这与计算任务变重、资源压力增大的物理含义一致。在所有方法中,本地执行的系统代价始终最高,说明仅依赖终端本地处理难以满足较高负载下的综合性能要求。全卸载方法虽然明显优于本地执行,但在综合代价上仍不及强化学习和离散枚举方案。这说明简单地把任务全部交给无人机处理,并不能自动获得最优结果。规则卸载方法能够在一定程度上降低系统代价,但相较于强化学习方法仍存在差距。强化学习方法在各个负载点上均表现出更低的综合代价,并且整体接近离散枚举基准,这表明该方法能够较好地逼近小规模离散搜索下的较优决策。

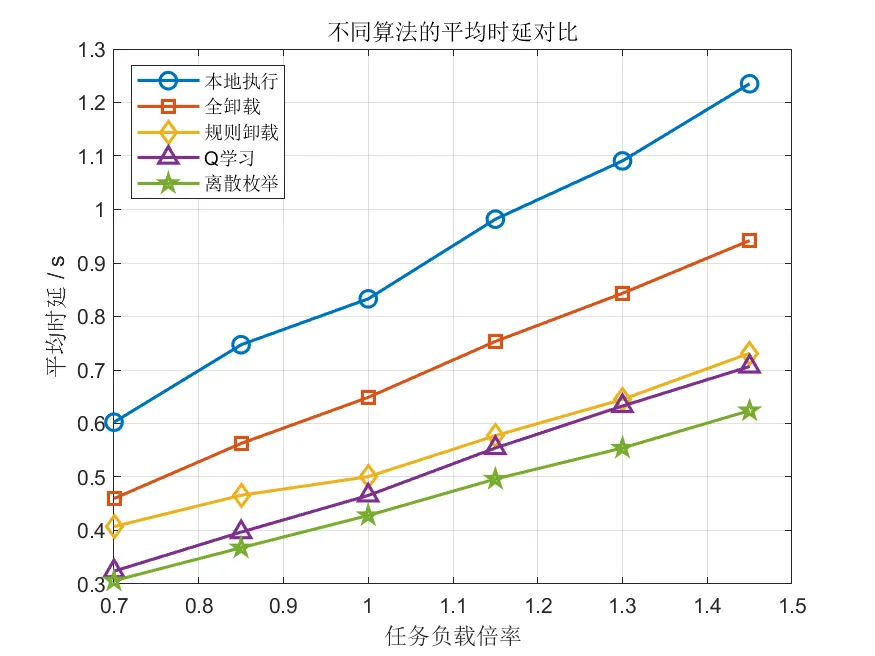

从平均时延结果看,本地执行方案由于完全依赖终端本地计算,其处理时间最长;全卸载方案虽然转移了部分计算压力,但受传输与边缘处理影响,时延改善有限;规则卸载能够在部分场景中取得折中效果;强化学习方法则表现出更优的时延控制能力,并且在大多数负载水平下接近离散枚举基准。这一结果说明,强化学习并不是简单增加卸载比例,而是在当前信道和任务条件下选择更适合的分配方式,因此能够更有效地缩短任务完成时间。

从平均能耗结果看,全卸载方案通常表现出最低的终端侧能耗,这是因为用户侧减少了本地处理负担,更多计算任务被转移到无人机侧完成。但能耗最低并不意味着综合性能最佳,因为系统还需要同时考虑时延因素。相比之下,强化学习方法虽然在能耗上略高于全卸载,但明显低于本地执行,并且在综合代价上优于全卸载,这说明其能够在时延与能耗之间取得更合理的平衡。离散枚举基准在综合代价上仍然最优,但强化学习方法已经表现出较强的接近能力,这也证明了其作为近似智能决策方法的有效性。

从系统代价的累计分布结果来看,强化学习方法对应的曲线整体位于规则卸载和全卸载的左侧,意味着在大量随机样本下,其取得较低系统代价的概率更高;离散枚举曲线则进一步左移,体现了其基准优势。本地执行曲线明显位于最右侧,说明在大多数情况下其代价都偏高。该分布层面的结果与平均值对比结果保持一致,进一步增强了结论的可信度。

从策略映射角度分析,强化学习得到的卸载策略整体呈现出随任务负载升高而增大卸载比例的趋势,并且在较好信道条件下更倾向于采用较高的卸载动作。这说明训练得到的策略并非简单固定不变,而是能够根据状态变化进行一定程度的自适应调整。动作分布结果也表明,中高卸载比例在综合代价优化中具有较强代表性,反映出本文场景下“部分卸载优于两种极端策略”的基本结论。

综合以上结果可以看出,本文所构建的强化学习卸载方法在系统综合代价和任务处理时延两个关键维度上均表现出明显优势。与规则卸载相比,强化学习方法能够减少经验阈值所带来的机械性决策缺陷;与全卸载相比,强化学习方法避免了在所有场景中盲目加大传输负担;与本地执行相比,强化学习方法有效利用了无人机侧计算资源;与离散枚举相比,强化学习方法虽略有差距,但在无需高复杂度搜索的前提下取得了较接近的性能。对于通信专业本科课题而言,这样的结果已经较好地体现了无人机辅助边缘计算与智能卸载结合的研究价值。

5 结论

本文围绕无人机辅助移动边缘计算任务卸载问题,分析了用户设备本地执行与边缘卸载之间的权衡关系,构建了以综合系统代价最小化为目标的任务卸载模型,并提出了基于强化学习的卸载决策方法。该方法以任务负载和信道状态为环境状态,以离散卸载比例为动作,通过训练获得适应不同运行场景的卸载策略。仿真分析表明,强化学习方法在系统代价和时延控制方面优于本地执行、全卸载和规则卸载,并能够在较低复杂度下逼近离散枚举基准性能;在能耗层面,该方法也表现出较好的折中能力。

总体来看,无人机辅助边缘计算为复杂环境中的任务处理提供了更灵活的资源支撑,而强化学习则为动态任务卸载提供了可行的智能决策框架。未来可在多无人机协同、连续动作控制、轨迹与卸载联合优化、用户移动性建模以及多智能体协同学习等方向进一步扩展,以增强系统模型的真实性和方法的工程适用性。

参考文献

[1] Asheralieva A, Niyato D. Hierarchical Game-Theoretic and Reinforcement Learning Framework for Computational Offloading in UAV-Enabled Mobile Edge Computing Networks with Multiple Service Providers[J]. IEEE Internet of Things Journal, 2019, 6(5): 8753-8769. DOI: 10.1109/JIOT.2019.2923702.

[2] Yu Z, Gong Y, Gong S, et al. Joint Task Offloading and Resource Allocation in UAV-Enabled Mobile Edge Computing[J]. IEEE Internet of Things Journal, 2020, 7(4): 3147-3159. DOI: 10.1109/JIOT.2020.2965898.

[3] Wang R, Cao Y, Noor A, et al. Agent-enabled Task Offloading in UAV-Aided Mobile Edge Computing[J]. Computer Communications, 2020, 149: 324-331. DOI: 10.1016/j.comcom.2019.10.021.

[4] Zhan C, Hu H, Sui X, et al. Completion Time and Energy Optimization in the UAV-Enabled Mobile-Edge Computing System[J]. IEEE Internet of Things Journal, 2020, 7(8): 7808-7822. DOI: 10.1109/JIOT.2020.2993260.

[5] Zhang K, Gui X, Ren D, et al. Energy-Latency Tradeoff for Computation Offloading in UAV-Assisted Multiaccess Edge Computing System[J]. IEEE Internet of Things Journal, 2021, 8(8): 6709-6719. DOI: 10.1109/JIOT.2020.2999063.

[6] Sun C, Ni W, Wang X. Joint Computation Offloading and Trajectory Planning for UAV-Assisted Edge Computing[J]. IEEE Transactions on Wireless Communications, 2021, 20(8): 5343-5358. DOI: 10.1109/TWC.2021.3067163.

[7] Ren T, Niu J, Dai B, et al. Enabling Efficient Scheduling in Large-Scale UAV-Assisted Mobile-Edge Computing via Hierarchical Reinforcement Learning[J]. IEEE Internet of Things Journal, 2022, 9(10): 7095-7109. DOI: 10.1109/JIOT.2021.3071531.

[8] Zhao N, Ye Z, Pei Y, et al. Multi-Agent Deep Reinforcement Learning for Task Offloading in UAV-Assisted Mobile Edge Computing[J]. IEEE Transactions on Wireless Communications, 2022, 21(9): 6949-6960. DOI: 10.1109/TWC.2022.3153316.

[9] Huda S M A, Moh S. Survey on Computation Offloading in UAV-Enabled Mobile Edge Computing[J]. Journal of Network and Computer Applications, 2022, 201: 103341. DOI: 10.1016/j.jnca.2022.103341.

[10] Liu X, Chai Z Y, Li Y L, et al. Multi-Objective Deep Reinforcement Learning for Computation Offloading in UAV-Assisted Multi-Access Edge Computing[J]. Information Sciences, 2023, 647: 119154. DOI: 10.1016/j.ins.2023.119154.

2、仿真结果演示

3、关键代码展示

略

当下时代学习怎么用AI是每个人已经之路,给大家推荐几本书:学习AI相关使用技巧!!! 抓住时代红利!!!

4、MATLAB 源码获取

途径一:点击文章中蓝色字体阅读原文

途径二:复制以下网址到浏览器中打开麦完单品

https://www.maiwan8.com/#/dynamicDetail/0/a4fdb967327bafa8a0e80035e04dd8bc/index?yqm=5FCPU

途径三:复制网址打开麦完店铺搜索该篇文章标题即可

https://www.maiwan8.com/#/packageA/userDynamicCenter/userDynamicCenter?user_id=1261511

途径四:如果以上方式均失效请通过QQ,邮箱或者微信公众号联系我

(点击上方↑↑↑↑↑蓝色字体跳转)

夜雨聆风

夜雨聆风