Burp Suite AI 插件:burp-ai-agent

项目地址:https://github.com/six2dez/burp-ai-agent

核心功能三句话:内置 MCP 服务器(53+ 个工具),让 Claude / Cursor 等 AI 客户端直接操控 Burp;支持 9 种 AI 后端(Ollama、Gemini CLI、Claude CLI 等本地都能跑);被动 + 主动双扫描器,覆盖 62 类漏洞。

核心功能

MCP 服务器层:AI 变成 Burp 的操控台

插件在 Burp 内部启动了一个 SSE MCP 服务器,默认监听 localhost:9876。任何支持 MCP 协议的客户端连上来之后,就能拿到 53 个工具,覆盖 Burp 里几乎所有有价值的操作。

工具按功能分成这几类:

|

|

|

|---|---|

|

|

proxy_http_history

proxy_http_history_regex(支持正则过滤 + 分页) |

|

|

http1_request

http2_request |

|

|

|

|

|

|

|

|

|

|

|

|

Claude Desktop 目前只支持 Stdio,不支持 SSE,所以需要通过 npx supergateway 做一层协议桥接:

Claude Desktop (Stdio) → supergateway (桥接) → burp-ai-agent (SSE, localhost:9876)注意这跟 PortSwigger 官方的 mcp-server 插件不同——官方那个要你自己装 Java + 跑 mcp-proxy JAR;这个直接在 Burp 里装好扩展就有了,Node.js 18+ 跑 supergateway 就够。

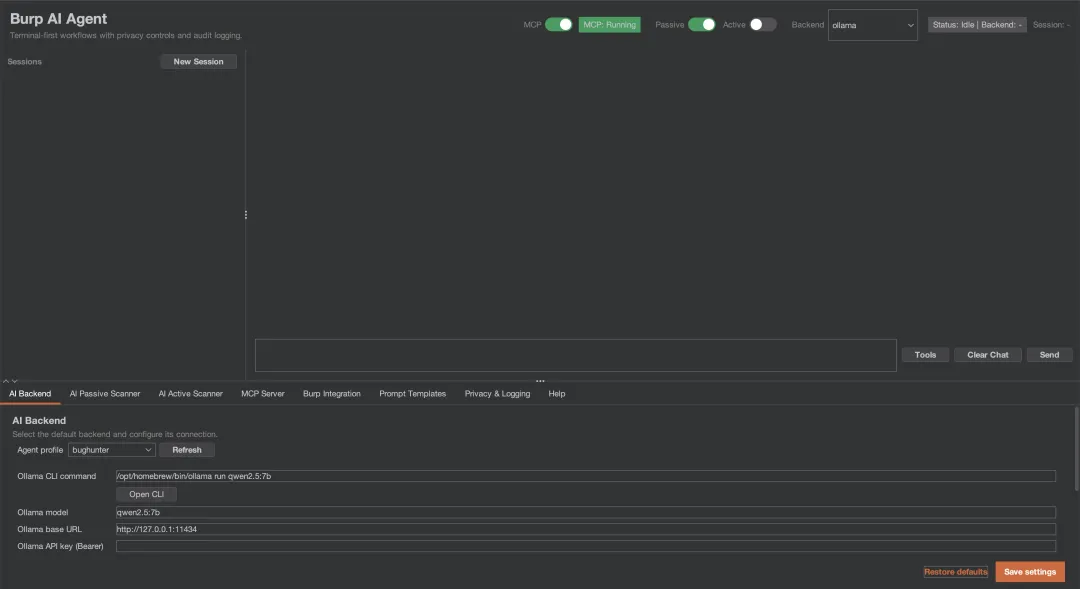

AI 后端层:本地 / 云端

插件这边内置了和 AI 后端的对话逻辑,支持 9 种接入方式,在实际使用中择一即可:

|

|

|

|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

对隐私比较在意的话,有三档隐私模式可选:STRICT(强制脱敏 Cookie、Authorization 头、参数值)/ BALANCED(选择性脱敏)/ OFF(原始数据)。所有对外请求都会走 JSONL 格式的审计日志,每条有 SHA-256 完整性签名。

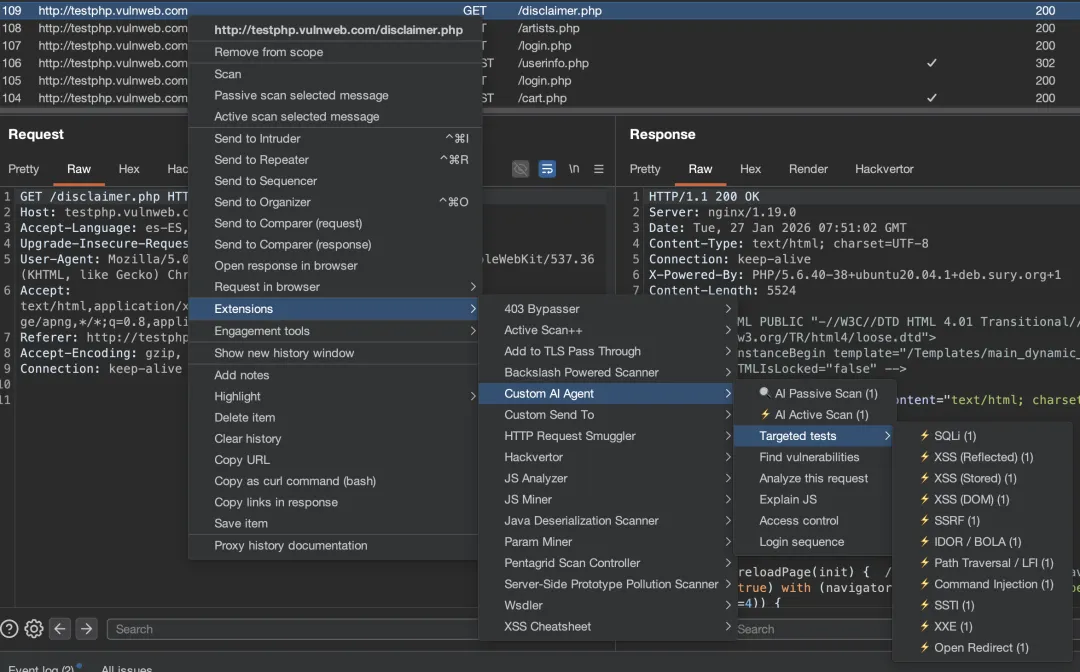

双扫描器

被动扫描器:流量经过 Proxy 时自动分析,不发额外请求,识别 Missing Headers、信息泄露、不安全配置等问题。

主动扫描器:主动构造 payload 攻击,覆盖 62 类漏洞——SQL 注入、SSTI、SSRF、XXE、路径穿越、GraphQL 注入等等,payload 库里有 200+ 条内置数据。

两个扫描器同时跑,不互相阻塞,也不打断你的手动测试。

安装

1. 下载 JAR

去 Releases 页拿最新的 JAR(当前最新 v0.5.0,2026 年 4 月 2 日发布):

https://github.com/six2dez/burp-ai-agent/releases

或者自己编译(需要 Java 21):

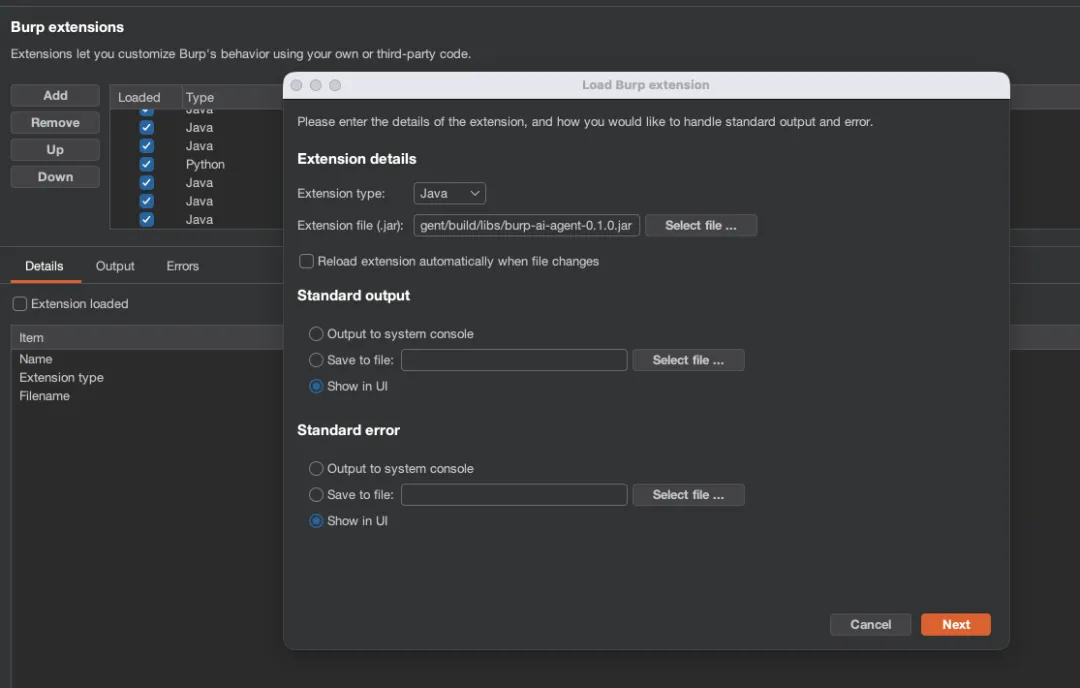

git clone https://github.com/six2dez/burp-ai-agent.gitcd burp-ai-agentJAVA_HOME=/path/to/jdk-21 ./gradlew clean shadowJar# 输出在 build/libs/Burp-AI-Agent-<version>.jar2. 装进 Burp

Burp Suite Community 或 Professional 都可以(2023.12 以上版本)。

打开 Extensions → Installed → Add,选 Java 类型,加载 JAR,Burp 顶部出现 AI Agent 标签页就说明装好了。

3. 配置 AI 后端

点 AI Agent 标签 → Settings → 选后端。以 Ollama 本地为例:

ollama serveollama pull llama3.1然后插件里填:

-

Backend: Ollama -

Base URL: http://localhost:11434 -

Model: llama3.1

如果用 NVIDIA NIM:

Backend: NVIDIA NIMBase URL: https://integrate.api.nvidia.comModel: moonshotai/kimi-k2.5API Key: <nvapi token>4. 接入 Claude Desktop(MCP 模式)

Settings → MCP Server → 勾选 Enable。然后编辑 Claude Desktop 配置文件:

macOS:~/Library/Application Support/Claude/claude_desktop_config.json

{"mcpServers": {"burp-ai-agent": {"command": "npx","args": ["-y","supergateway","--sse","http://127.0.0.1:9876/sse" ] } }}需要 Node.js 18+,重启 Claude Desktop 就行。如果开了 External Access,MCP 客户端每个请求要带 Authorization: Bearer <token> 头。

实战场景

场景一:让 Claude 帮你翻历史流量找 IDOR

正常测试期间流量都过 Burp,测完让 Claude 来审:

“帮我扫一下 Proxy 历史,找所有带数字 ID 参数的接口,分析有没有 IDOR 风险”

Claude 会调用 proxy_http_history + proxy_http_history_regex 分页拉取,自己筛选、自己构造 payload(ID+1、ID-1、0、-1),再用 http1_request 发包对比响应差异,发现问题后用 issue_create 记录。

技术要点:历史记录按 count + offset 分页,每页默认 100 条,AI 自己控制翻页节奏;响应体超 5000 字符会自动截断,防止 context 溢出。

场景二:从终端直接跑 Burp 扫描(burp-scan skill)

这个功能比较有意思——它把怎么用 MCP 做完整扫描这件事,写成了一个 Skill 文件放在仓库里(skills/burp-scan/SKILL.md),任何支持 context 文件或 system prompt 的 AI 都能用。

装到 Claude Code 只需要:

# 全局安装(所有项目可用)cp -r skills/burp-scan ~/.claude/skills/burp-scan之后在 Claude Code 里输入 /burp-scan,或者提到”Burp 扫描”它会自动触发。Skill 本身包含:53 个 MCP 工具使用索引、被动分析协议、200+ 个主动测试 payload、端到端扫描工作流(scope → 被动 → 主动 → OOB → 报告),以及漏洞报告格式规范。

这个设计思路很实用:插件里的内置 AI 走后台自动扫,burp-scan skill 走终端 AI 做交互式、有引导的深度分析,两者互补。

场景三:OOB 外带测试全自动化

测 SSRF 或盲注时通常要同时盯 Collaborator 和请求发送——现在可以全交给 Claude:

“用 Collaborator 测一下这个接口的 SSRF,帮我完整跑一遍”

Claude 会依次:

-

generate_collaborator_payload— 拿到 payload URL 和 ID -

http1_request— 把 payload 注入参数发出去 -

get_collaborator_interactions— 轮询外带回调

三步自动串起来,不需要你切标签。注意:Collaborator 相关 API 只有 Burp Suite Professional 才有,社区版跑不了这个场景。

Agent Profiles:给 AI 换业务场景的”性格”

插件第一次运行会把内置 Profiles 解压到 ~/.burp-ai-agent/AGENTS/ 目录,每个 Profile 是一个 Markdown 文件,定义了 AI 在这个任务下应该如何思考、用哪些工具、按什么顺序分析。

想加自定义 Profile 只要往 ~/.burp-ai-agent/AGENTS/ 里扔 .md 文件就行,不用重启 Burp。

完整文档在:https://burp-ai-agent.six2dez.com

和 PortSwigger 官方出的 mcp-server 比,这个插件的定位更重——官方那个更干净、工具更少、专注 MCP 接入;这个明显更”all-in”,内置 AI 对话、双扫描器、9 种后端、隐私控制,适合想一个插件全部解决的人。

往期推荐 📚

java-audit-skills:让 Claude 帮你做 Java 代码安全审计

欢迎关注“攻防录”✨

夜雨聆风

夜雨聆风