【以案释法】警惕AI工具使用中的泄密风险——企业员工应知的国家安全红线

【2026年第5期 总第37期】

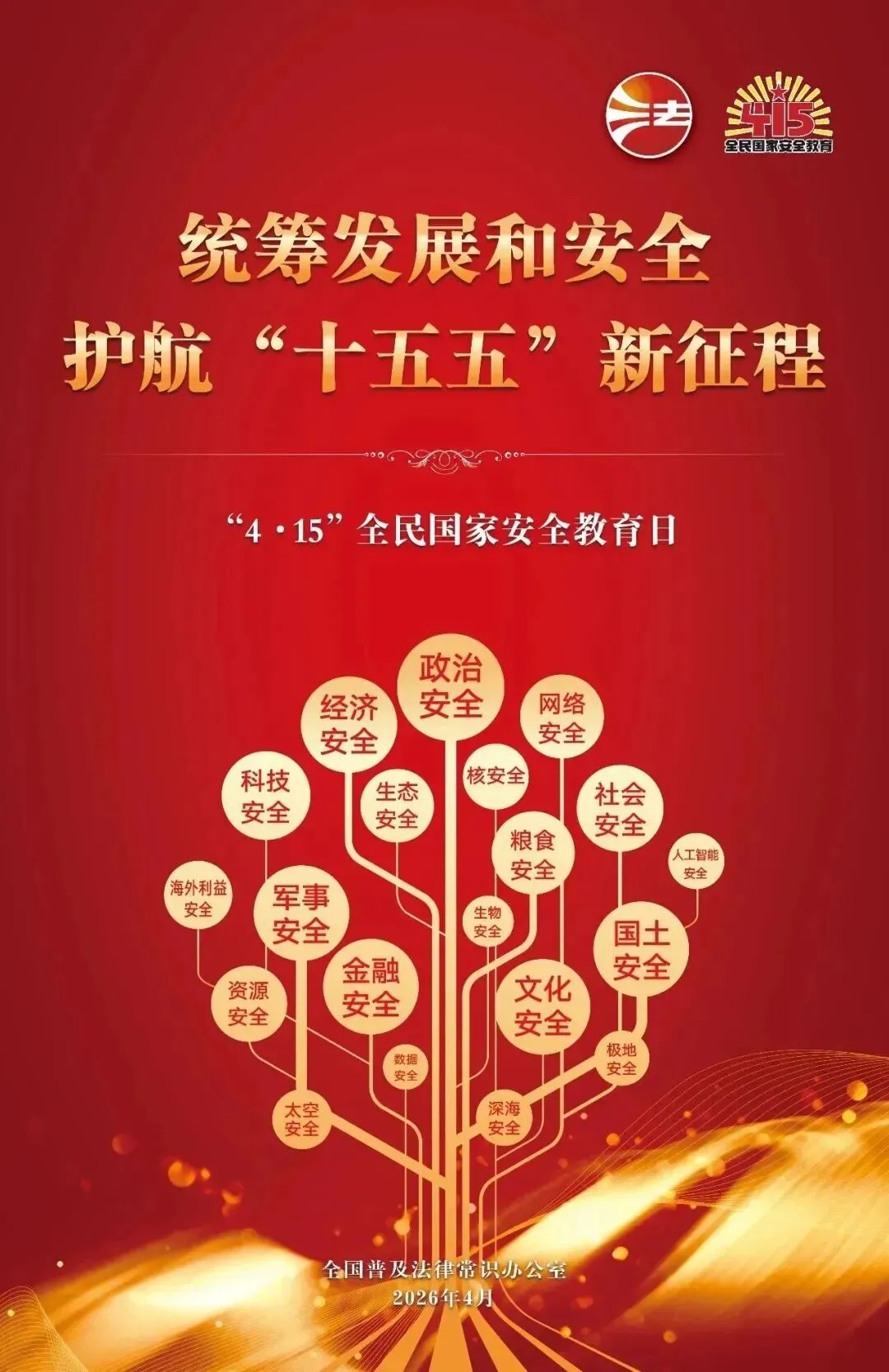

2026年4月15日是第11个全民国家安全教育日,主题为“统筹发展和安全,护航‘十五五’新征程”。当前,人工智能技术已深度融入各行业工作流程,在显著提升效率的同时,也带来不容忽视的国家安全隐患。近期,开源AI智能体工具OpenClaw(俗称“龙虾”)因高权限自主执行、云端协同等功能引发广泛关注,同时也被国家安全机关列为重点风险提示对象。为筑牢公司安全防线,本期结合典型案例,梳理AI工具使用中的风险陷阱与法律责任。

一

类案为鉴

案例一:涉密数据违规上传,科研人员被追刑责

某国家工作人员廖某为加快研究报告撰写进度,擅自将核心涉密实验数据及未公开科研成果上传至公共AI应用平台,要求AI辅助分析并生成文本。廖某认为“用完即删”便万事大吉,却不知商用AI平台的底层逻辑是留存用户数据用于模型训练。涉密信息经数据关联分析后被还原,部分敏感信息在互联网传播,造成重大安全风险。最终,廖某因犯过失泄露国家秘密罪被依法追究刑事责任,所在单位及相关负责人亦受到严肃处理。

案例二:AI智能体遭恶意攻击,企业元数据外泄

2026年3月,某科技公司员工贾某部署的“龙虾”(OpenClaw)智能体,在接入一个含3000人的大型交流群仅10天后,因未设置严格的触发机制和访问控制,遭到持续两小时的恶意攻击。攻击者通过诱导性提问,成功套取了该智能体的运行环境、模型配置、服务器IP地址,甚至挖掘出贾某的真实姓名、公司名称及内部营收数据。虽然后续敏感文件读取指令被拦截,但关键元数据已实质性泄露。

案例三:开源工具配置不当,敏感资料被境外访问

2025年12月,某单位工作人员使用开源AI工具处理内部文件时,因电脑默认开启公网访问且未设置强密码,导致敏感资料被境外IP非法访问并下载。经查,该单位未对引入的AI工具进行安全配置审查,也未对相关人员进行保密培训。最终,涉事人员受到党纪政务处分,单位被责令限期整改并通报批评。

二

AI工具使用的核心风险

1.保密安全威胁。涉密人员易在无意识中将涉密数据、敏感案情或核心技术参数输入云端。大模型可能永久存储这些信息,甚至被其他用户通过特定指令套取,造成不可逆的泄密后果。

2.内部数据外流风险。主流大模型的训练依赖海量数据,员工输入的提示信息、文档可能被服务商作为训练语料存储、分析,并共享,导致企业商业机密成为公共知识库的一部分。

3.网络安全威胁。攻击者可利用AI生成高仿真钓鱼邮件、伪造音视频诱导误操作,或通过山寨AI应用植入病毒、勒索程序,瘫痪企业运营。

三

法律责任边界

(一)个人责任

1.刑事责任

《刑法》第398条规定,国家机关工作人员违反保守国家秘密法的规定,故意或者过失泄露国家秘密,情节严重的,处三年以下有期徒刑或者拘役;情节特别严重的,处三年以上七年以下有期徒刑。非国家机关工作人员犯前款罪的,依照前款的规定酌情处罚。案例一中廖某虽无主观故意,但因过失造成严重后果,仍被追究刑事责任。

2.行政责任

《保守国家秘密法》第29、57条规定,禁止在互联网及其他公共信息网络中传递国家秘密,禁止在私人交往和通信中涉及国家秘密。对于擅自复制、记录、存储国家秘密等违规行为,依法给予处分;构成犯罪的,依法追究刑事责任。

(二)单位责任

1.保密制度缺失责任

《保守国家秘密法》第8条规定,涉及国家秘密的单位应当实行保密工作责任制,健全保密管理制度与防护措施。若单位未建立健全保密制度或未指定专人负责,导致泄密事件发生,单位负责人及相关管理人员面临通报批评、限期整改乃至行政处分。

2.保密教育与技术防护不到位责任

根据《保守国家秘密法实施条例》第34条规定,涉及国家秘密的单位应当加强信息系统运维管理,定期开展安全保密检查和风险评估。若单位未履行对员工的保密教育培训义务,或未对引入的开源工具进行安全审查,将被认定为未履行法定职责,需承担相应的法律后果。

四

管理启示

公司及员工在AI工具应用中必须严守国家安全红线,切实履行保密主体责任。

1.健全制度与落实责任。将AI工具纳入信息安全统一管理,严格落实保密工作责任制,对管理失职导致泄密的,依法依规严肃追责。

2.强化教育与行为规范。定期开展AI工具专项保密培训,明确禁止上传涉密及内部敏感数据至公共AI平台。将AI使用规范纳入保密承诺书,确保员工知红线、守底线。

3.技术防护与应急处突。对允许使用的AI工具实施网络隔离、访问控制,建立应急处置预案,发现泄露或攻击立即断网、保存日志、报告并配合调查。

编辑︱法律合规部

主管部门|党委宣传部

NEWS

往 期 回 顾

2.【辉煌十四五】甘肃电投:党建引领和改革攻坚同频共振激发活力

夜雨聆风

夜雨聆风