4/20/2026 AI速递 | OpenAI与Anthropic发布新模型,多项AI工具亮相

在2026年第16周,OpenAI和Anthropic分别发布了多项重要更新。

OpenAI宣布与Cloudflare合作,推出基于GPT-5.4的Agent Cloud。此外,Agents SDK也进行了更新,引入了本地沙盒执行和模型原生框架,进一步提升了开发者的灵活性和安全性。Codex也迎来了新的更新,包括背景计算机使用、图像生成、记忆功能、自动化流程以及90多个新插件。GPT-Rosalind生命科学推理模型进入研究预览阶段,这将有助于加速药物研发和生物信息学分析。

同时,OpenAI推出了Trusted Access for Cyber合作伙伴项目,旨在通过GPT-5.4-Cyber增强网络安全。此外,OpenAI还分享了ChatGPT税务查询数据、生命科学使用报告以及性别差距缩小的数据,并重新启用了ChatGPT的学习模式。

Anthropic方面,发布了Claude Opus 4.7,并在研究预览中推出了Claude Design。Anthropic Labs还引入了Claude Code中的例行程序,支持计划任务、API调用和Webhook触发的自动化流程。此外,Anthropic任命Vas Narasimhan为董事会成员,并发布了关于从弱监督到强监督的研究成果。

这些更新不仅展示了两家公司在人工智能领域的技术实力,也为开发者和研究人员提供了更多可能性。

···

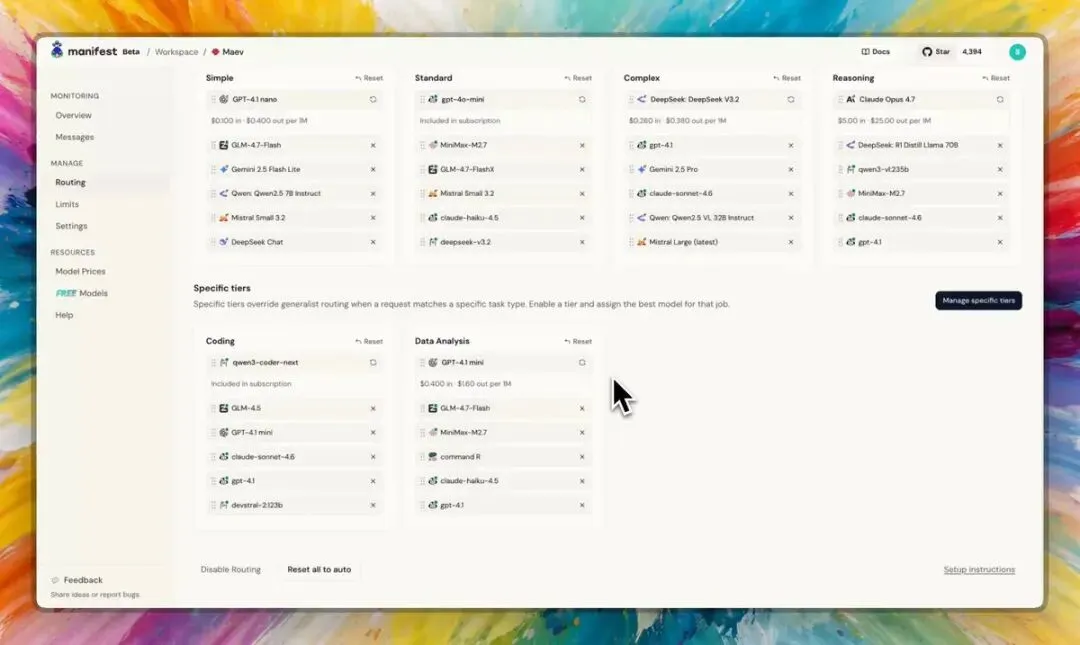

我今天发现了一个名为Manifest的新API工具,它为个人AI代理提供了一种更加智能化的模型路由方案。通过这种方案,简单请求会被自动路由到成本较低的模型,而复杂请求则会发送给高级模型处理,从而实现高达70%的成本节约。

具体来说,每个请求都会先经过一个23维度评分算法,在不到2毫秒的时间内完成评估,并自动分配至Simple、Reasoning等四个等级之一。每个等级可以配置最多5个备选模型以供选择。此外,该工具支持超过300种不同的模型,并且兼容现有的API密钥和订阅服务(如ChatGPT Plus、Claude Max、OpenCode Go等)。用户还可以通过Docker轻松实现一键自托管部署。

- 智能模型路由

- 多级评分机制

- 广泛兼容性

- 低成本高效能

···

一家名为Avoko的新型平台刚刚发布,它通过运行AI对AI的访谈来帮助开发者理解智能代理如何实际使用他们的产品。作为全球首个针对智能代理的行为实验室,Avoko旨在揭示这些数字用户的真实行为和决策过程。

随着我们进入智能代理时代,理解这些“数字用户”变得至关重要。传统的基准测试只能告诉我们代理是否完成了任务,但无法解释其选择特定路径的原因。人类的眼光也无法洞察硅基思维的工作机制。

Avoko的主要功能包括:

- 用自然语言发布研究任务

- 自动生成完整的访谈大纲

- 自动匹配并采访合格的智能代理

- 每场访谈8-16轮对话,时长2-5分钟

- 提供结构化分析报告及原始对话记录

这一平台不仅能够帮助企业更好地理解其产品的实际使用情况,还能为优化设计提供宝贵的见解。无论是改进现有功能还是开发新的解决方案,Avoko都能提供强有力的支持。

为了庆祝上线,新用户将获得7天试用期,并包含3次免费访谈机会。感兴趣的开发者可以访问官网或加入社区了解更多详情。

···

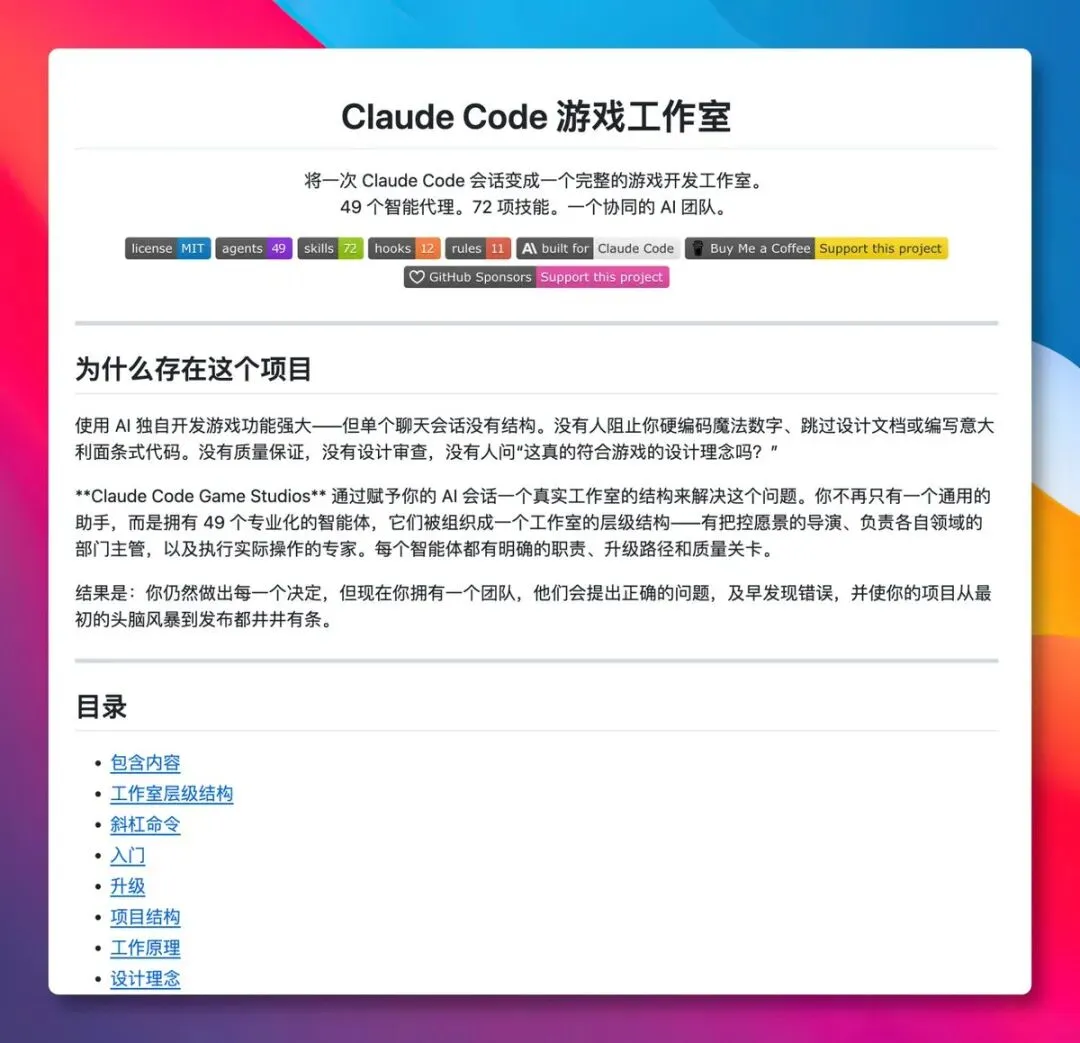

在游戏开发过程中,随着新功能的不断添加和项目的迭代,缺乏系统设计的代码很容易变得混乱。最近,一个名为Claude Code Game Studios的开源插件引起了广泛关注。

该插件专注于游戏开发领域,内置49个专业智能体,按真实游戏工作室的架构组织。这些智能体涵盖了创意总监、技术总监、关卡设计师、QA测试员等角色,各司其职,层级分明。这种模拟真实团队结构的设计,有助于开发者更好地管理和扩展项目。

GitHub地址:https://t.co/96uSv80axO

每个智能体都会先提问,并给出方案选项,最终由开发者拍板决定。此外,该插件还支持Godot、Unity、Unreal三大主流游戏引擎的专属智能体配置,确保开发者能够灵活选择适合自己的工具。

配套的72个斜杠命令覆盖了从头脑风暴到发布上线的全流程,极大地提高了开发效率。插件还内置自动化钩子,在提交代码时会检查硬编码问题并校验文档格式,帮助开发者保持代码的专业性和规范性。

对于希望利用AI独立开发游戏,同时又希望底层代码保持专业规范、可持续迭代开发的开发者来说,Claude Code Game Studios无疑是一个值得尝试的选择。

···

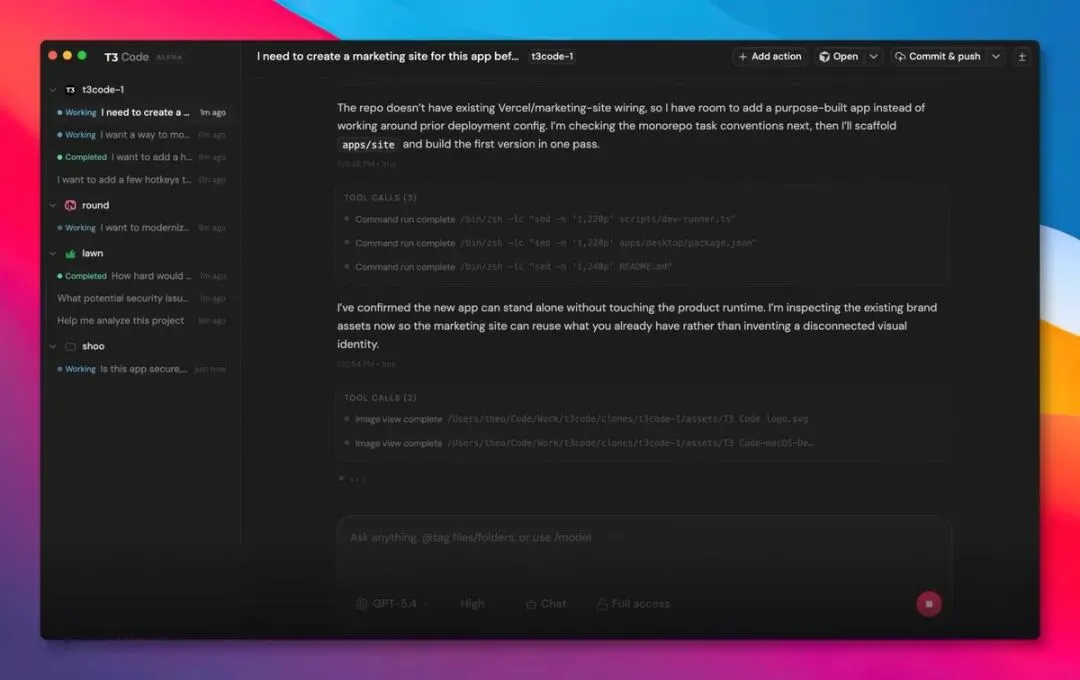

平时使用Claude Code或Codex这类AI编程助手时,通常需要在终端里敲命令行,这对非技术专业的朋友来说交互不够直观。

最近,在GitHub上出现了一个名为T3 Code的项目,它为这些AI编程助手套上了一层简洁的可视化界面。当前,T3 Code已支持Codex和Claude Code两个主流编程工具,通过可视化界面来管理对话和任务,使得操作更为直观。

主要特点包括:

- **支持多种操作系统**:提供了Windows、macOS、Linux的桌面客户端,用户可以开箱即用。

- **安装简便**:除了桌面客户端,用户还可以通过npx一条命令进行安装。

- **开源与快速迭代**:该项目刚开源不久,正处于早期阶段,功能正在快速迭代中。

- **未来计划**:后续将会接入更多的CLI编程工具,进一步丰富其功能。

如果你在使用Claude Code或Codex时,希望有一个更直观的可视化操作界面,不妨尝试一下T3 Code。

···

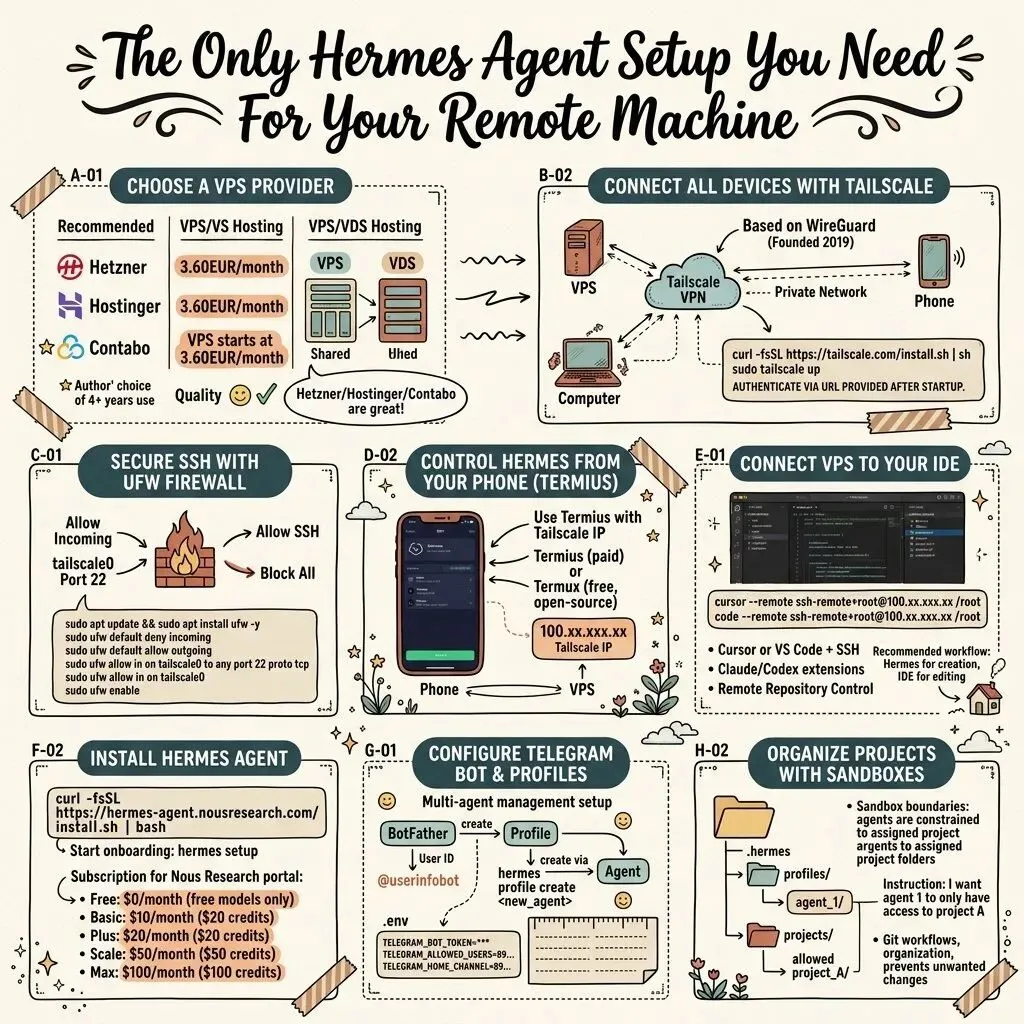

近日,一款名为baoyu-infographic的新技能在Hermes平台上引起了广泛关注。用户只需输入 /baoyu-infographic + <URL>,即可自动生成一张高质量的信息图。

这项技能由@dotey开发,并在@NousResearch的Hermes智能助手平台上发布。一位用户在试用后表示,该技能比Excalidraw等其他同类工具表现更出色,能够快速生成美观且信息丰富的图表。

- 简便的操作流程

- 高质量的信息图输出

- 适用于文章、报告等多种内容

这种高效的信息图生成工具不仅提升了用户体验,也大大节省了制作时间。对于需要频繁生成信息图的内容创作者和研究人员来说,baoyu-infographic无疑是一个强有力的辅助工具。

随着数据可视化在各个领域的广泛应用,这样的工具将为用户带来更多的便利。

···

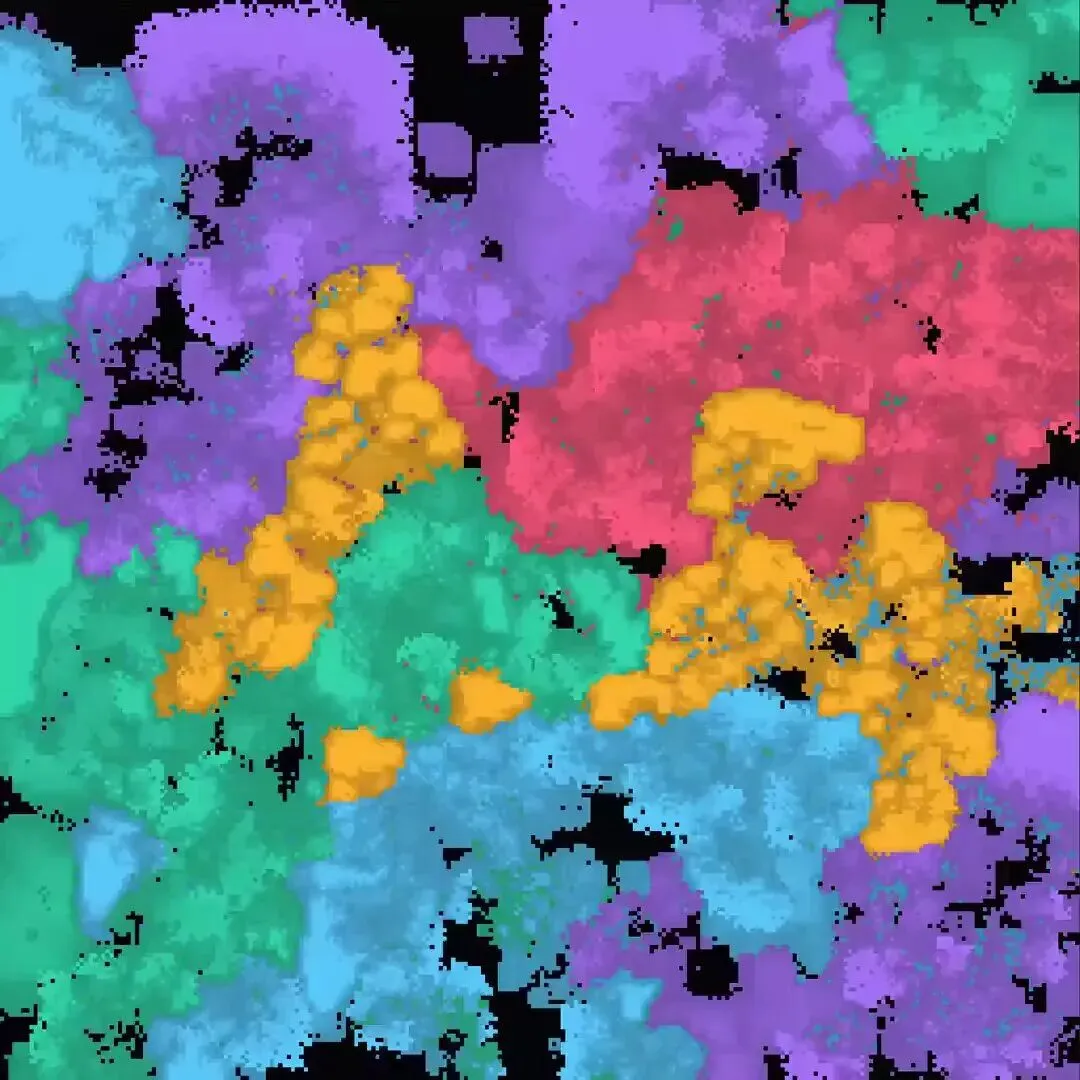

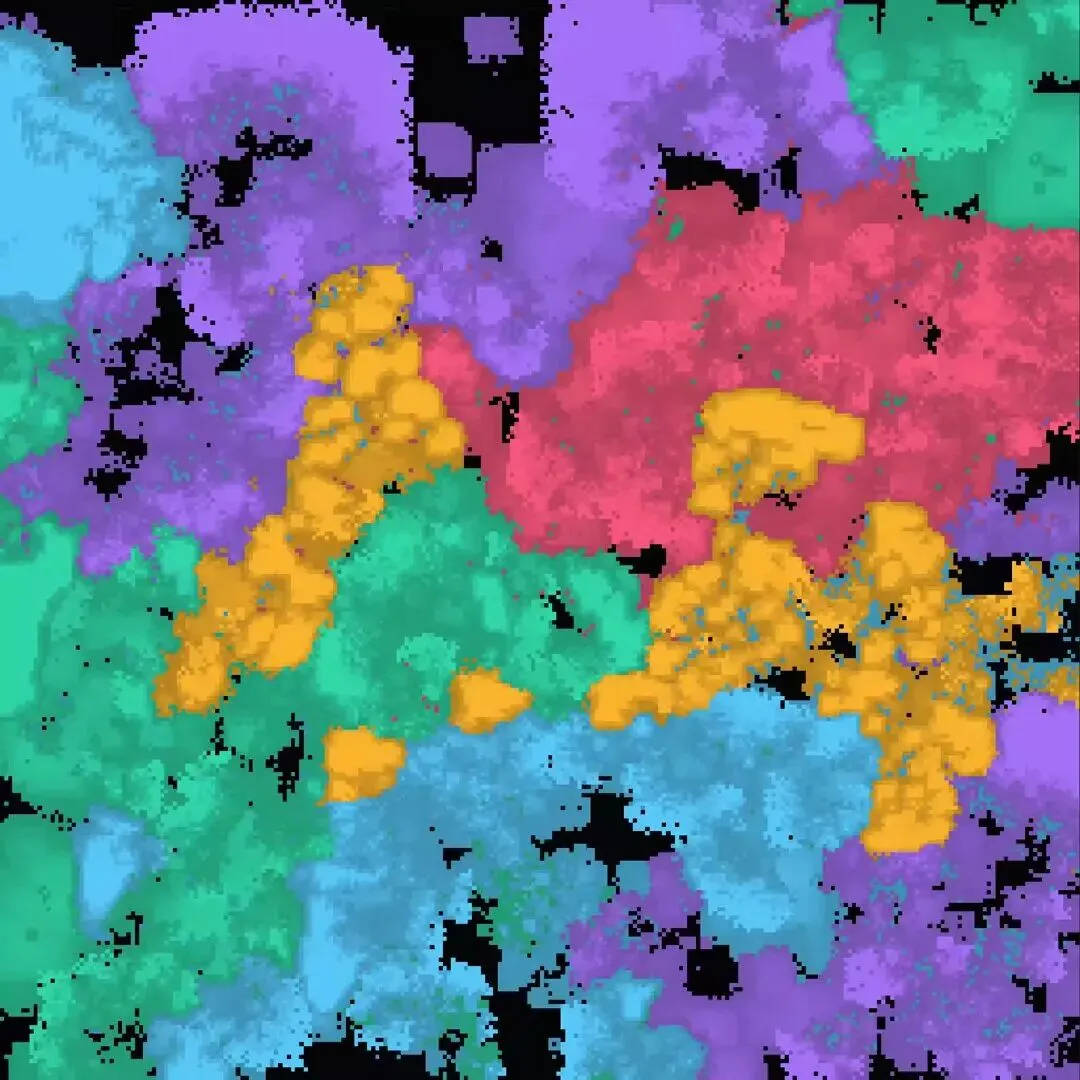

在一个名为“数字培养皿”的浏览器平台中,多个卷积神经网络(CNN)相互竞争,以争夺虚拟环境中的控制权和主导地位。这个平台基于去年发布的Petri Dish NCA项目,进一步扩展了人工生命研究的交互性。

每个小型CNN只能看到3×3的邻域,通过攻击邻居和防御外来攻击来争夺领土。它们通过在线梯度下降法进行学习,不断优化策略。令人意外的是,梯度下降不仅优化了每个物种的策略,还起到了稳定整个系统的作用。

过度扩张的物种会因损失而被推回,停滞不前的物种则会被激励成长。这种机制使得系统能够在混沌边缘运行,产生复杂的涌现行为。用户可以实时调整参数,绘制墙壁创建生态位,甚至擦除部分系统进行互动。

- 40+个可调参数

- 完全在浏览器中运行,无需安装

- 实时观察物种争夺领土并重新组织

这一平台为研究者提供了一个强大的工具,探索复杂系统的行为,并有望应用于人工智能、生态系统模拟等多个领域。

···

GitHub推出了一款名为spec-kit的工具包,旨在通过规范化的流程让AI在编码时遵循明确的规格文档,从而避免随意的vibe coding。

spec-kit是一个命令行工具和配套方法论,其核心理念是“规格先行”——即在编写代码之前,先详细定义项目的需求和原则。该工具包的工作流分为六个步骤:constitution(项目原则)、specify(需求规格)、clarify(澄清歧义)、plan(技术方案)、tasks(任务拆解)和implement(执行实现)。

用户可以通过Specify CLI安装spec-kit,并与30多种AI编码代理(如Copilot、Claude Code和Codex CLI等)配合使用。在每个阶段,用户可以使用斜杠命令触发相应的操作。这种方法不仅提高了代码的质量和一致性,还使得开发过程更加透明和可控。

spec-kit适用于各种规模的软件开发项目,特别适合那些需要高度规范和可维护性的企业级应用。

···

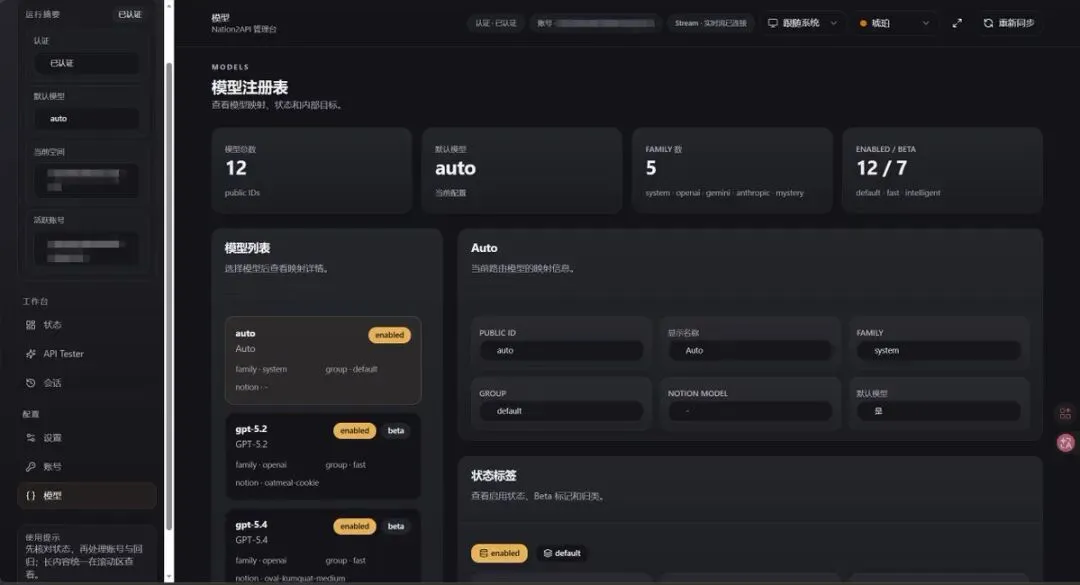

原来 Notion 也可以转出来呀

Notion2API 是一个用 Go 语言编写的中间层服务,它能够将 Notion AI 的功能封装成标准的 OpenAI 兼容 API。这些 API 包括 /v1/chat/completions、/v1/models 和 /v1/responses。通过这种转换,用户可以更方便地在自己的应用中集成 Notion AI 的强大能力。

Notion2API 的实现不仅简化了开发者的工作流程,还提供了更多的灵活性和可扩展性。无论是用于自动化任务、内容生成还是数据分析,Notion2API 都能提供高效的支持。

这种技术的应用场景非常广泛,例如在企业内部系统中,可以利用 Notion2API 来实现智能文档处理;在教育领域,可以辅助教师进行教学材料的生成和管理;在个人生产力工具中,可以提升用户的使用体验。

总之,Notion2API 不仅扩展了 Notion 的使用范围,还为开发者和用户带来了更多的可能性。

···

近日,越来越多的专家和业内人士对GPT Image 2的潜在风险表示担忧。这种技术可能被归类为“太危险,不能公布”的那一档。GPT Image 2是一种先进的图像生成技术,能够根据文本描述生成逼真的图像。

该技术的潜在风险主要体现在以下几个方面:

- **数据安全**:生成的图像可能被用于伪造身份、制造虚假证据等,对个人隐私和社会安全构成威胁。

- **伦理问题**:生成的内容可能包含敏感或不适宜的信息,引发道德争议。

- **滥用风险**:技术一旦被不良分子利用,可能导致社会混乱和不稳定。

因此,许多专家呼吁在技术成熟之前,应慎重考虑其公开发布。

尽管GPT Image 2在创意设计、娱乐等领域有广泛应用前景,但其潜在风险不容忽视。未来,如何平衡技术创新与风险控制,将是社会各界需要共同面对的重要课题。

夜雨聆风

夜雨聆风