OpenGame:首个开源 AI 端到端网页游戏生成框架 – (附系列深度研究报告)

你用过 AI 写游戏代码吗?

大概率有过。输入”用 Phaser 写一个太空射击游戏”,AI 会给你一堆看起来很合理的代码,语法没问题,逻辑好像也通,顺手点个运行——

然后黑屏。或者报错。或者飞船能动了但子弹穿过敌人没反应。

这是 AI 写游戏最常见的结果:代码看起来是对的,游戏是玩不了的。

现在,有人认真解决了这个问题。

不是”看起来能玩”,是真的能玩

这个项目叫 OpenGame,4月21日刚在 GitHub 上线,论文挂在 arXiv,技术报告有几十页那么长。核心结论只有一句话:

它在 150 个游戏测试集上,让 AI 从”生成看起来对的代码”进化到”交付真的能跑的游戏”,成功率从 25% 拉到了 65%。

这是什么意思?

之前,你让 AI 写一个 Flappy Bird,它可能给你一个看起来完整的代码文件——但你打开,鸟不会飞,柱子不显示,游戏循环根本不起动。现在,OpenGame 生成的游戏,85% 可以端到端跑完,从打开到游戏结束,是一个完整的体验。

这个差距,不是代码质量的问题,是整个做事情的方式变了。

它怎么做到的

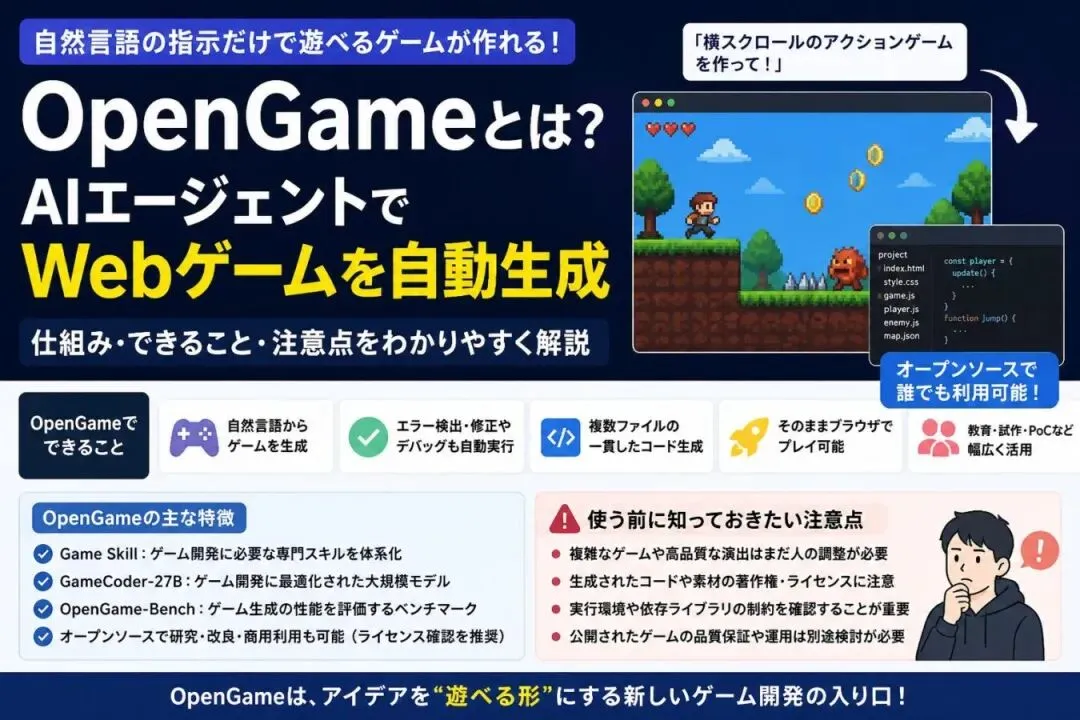

OpenGame 有三个核心组件,理解了它们,你就理解了这件事的真正价值。

第一个:Game Skill。

你可以把它理解成”游戏开发的套路库”。它把成熟的开发经验——怎么搭项目结构、怎么组织游戏循环、怎么写碰撞检测——变成 AI 可以直接调用的技能模块。

就像一个有十年经验的老开发者坐在旁边告诉你”这里应该这样搭”,但 AI 不会累,不会忘,随时都在。

第二个:GameCoder-27B。

这是一个专门训练过的模型,参数规模 270 亿。专到什么程度?它学的内容全跟游戏开发相关:引擎文档、开源游戏项目、Phaser 怎么用、Three.js 怎么搭、物理引擎的坑在哪里。

然后它经过三轮训练:先灌游戏开发知识,再做监督微调(看成熟的游戏是怎么从零搭起来的),最后用”以玩定学”的方式做强化学习——也就是说,AI 生成一个游戏,跑出来能玩才给它高分,跑不出来就扣分。

这个训练方式很关键。它不是”代码看起来对不对”,而是”游戏能不能玩”。

第三个:OpenGame-Bench。

这是最难的部分,也是最有意思的部分。

怎么让 AI 自动判断一个游戏”好不好玩”?传统的代码测试可以跑单元测试,但游戏没有单元测试,游戏只有”你玩的时候感觉对不对”。

OpenGame 的做法是:用无头浏览器跑生成的游戏,然后用视觉语言模型(VLM)去看截图,判断画面有没有正确渲染、控制有没有响应、状态有没有正常推进。

简单说:它让 AI 看 AI 做出来的游戏,判断”这玩意儿是不是真的能玩”。

这个思路本身就挺有意思的。

一个数字背后的问题

测试集里有个关键对比数字:

传统方案:端到端可运行率约 40%,单次生成成功率约 25%。 OpenGame:可运行率约 85%,单次生成成功率约 65%,平均修复轮次 2.3 轮。

翻了一倍多。

但更有意思的是”平均修复轮次 2.3 次”这个数字。它意味着即使这一次没完全做对,AI 还有能力自己发现问题、自己修、然后再试一次。基本上跑两三轮,就能把一个”看起来像游戏但不能玩”的东西修成”真的能玩”的游戏。

这是传统 AI 代码工具根本没有的能力。大多数 AI 生成代码,你不给它明确的反馈,它就停在那个错误的状态不动了。

独立开发者真正的机会

说这些技术细节,是因为它们决定了这件事对谁真正有价值。

答案是:独立开发者,或者想做独立游戏但不会写代码的人。

OpenGame 目前的定位是网页游戏,生成的是 HTML + JavaScript 文件,打开浏览器就能玩。不需要买服务器,不需要懂部署,输入一行指令,等几分钟,一个游戏就出来了。

这不是”AI 帮你写代码”——这是”AI 帮你做产品”。

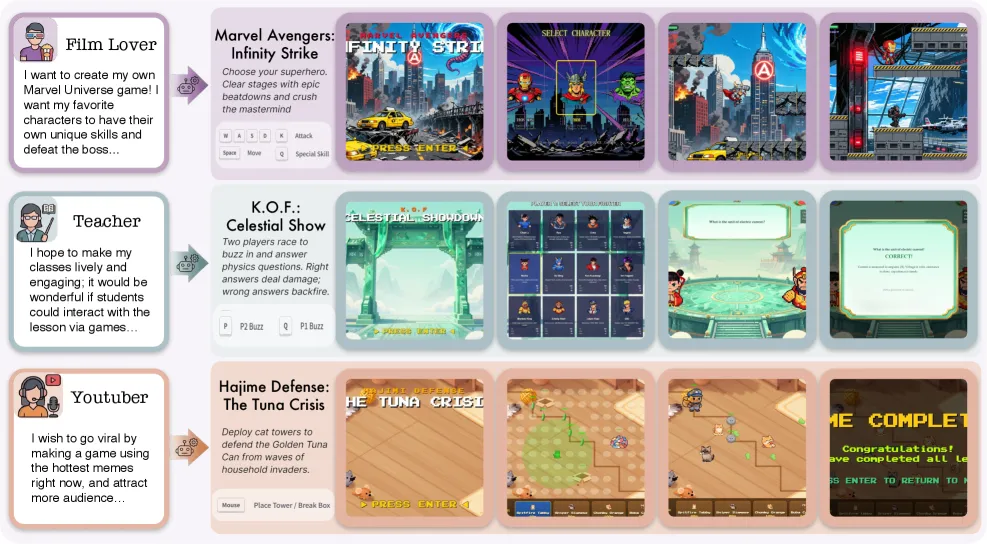

你告诉它”做一个俄罗斯方块,要求双人对战,加分系统,难度递增”,它给你一个完整的、可运行的文件,双人俄罗斯方块,可以跑。你告诉它”做一个步行模拟器,主角在城市里行走,路人会跟主角打招呼”,它给你一个完整的模拟器。

这才是这件事真正让创作者兴奋的地方。

不是”代码写得好看了”,是”想法到产品的距离,短了一大截”。

当然,这个阶段也有它的问题

OpenGame 现在能做的,主要是 2D 游戏、网页游戏,复杂度有上限。它解决的是”能不能跑”,不是”跑得好不好玩”——游戏性这个维度,AI 现在帮不了你。

还有一个问题是:GameCoder-27B 需要 GPU 环境才能跑,本地部署的门槛不低。当然也可以调用 API,但那是另一套成本计算。

但这些是”现在的局限”,不是”这件事做错了”。

回到开头那个问题:AI 写游戏为什么一直差点意思?

因为游戏的”可运行”标准,不是代码对不对,而是体验完不完整。传统 AI 工具在”代码对不对”上已经很厉害了,但在”游戏能不能玩”这个维度上,一直交不出合格的答卷。

OpenGame 做的事情,本质上是把”能不能玩”变成一个可以自动评估、自动修复、自动迭代的过程。

这条路走通了,意义不只是”AI 能做游戏了”。

是”AI 做出来的东西,终于和用户实际用到的产品对上了”。

关于该项目我们收集了很多可以进一步分享的资料和工具链。如果感兴趣可以在留言区评论说“想了解下”。我们会投递发给您。

主编:珊珊 & 小玫

夜雨聆风

夜雨聆风