ABCE 框架:如何开发一份测中学生 AI 素养的问卷

很多国家和地区的中小学开始把 AI 课程放入课表,已经是这两三年的事。

问题随之而来:一个学期上完,老师怎么判断学生到底”学到了什么”?是会用 Teachable Machine 训练一个识别模型就算?还是能说出”机器学习”和”深度学习”的区别就算?再或者,能在小组里和同学一起做完一个 AI 项目就算?

过去几年发表在 AI 教育领域的问卷不少,但能扛住严格心理计量学验证、又是针对中学生设计的,其实不多。

Davy Ng(吴子杰)和团队 2024 年发在 British Journal of Educational Technology 上的这篇论文,做的就是补上这个工具空缺。他们提出了一个叫 ABCE 的四维框架,并据此开发并验证了一份 32 题的 AI 素养问卷(AILQ),用来测量香港中学生的 AI 素养发展。

下面把这套框架和量表是怎么回事讲清楚——它由哪些维度组成、每个维度具体在测什么、是在什么样的课程里测出来的,以及一线教师可以怎么参考使用。

文末附完整机翻中译量表

一、ABCE 框架:从”会用 AI”到”AI 素养”

Davy Ng 团队的基本判断是:过去大多数 AI 素养问卷的问题,在于把 AI 素养窄化成了”认知”和”伦理”两块,没有把学生的态度和行为算进去。但参照数字素养几十年的研究积累,研究者早就明白:能用一项技术,不等于具备这项技术的素养。

一个会刷短视频的人哪怕也会拍短视频,他不一定有媒介素养;同理,一个会用 ChatGPT 写作业的学生哪怕会做ChatBot,也不一定具备 AI 素养。

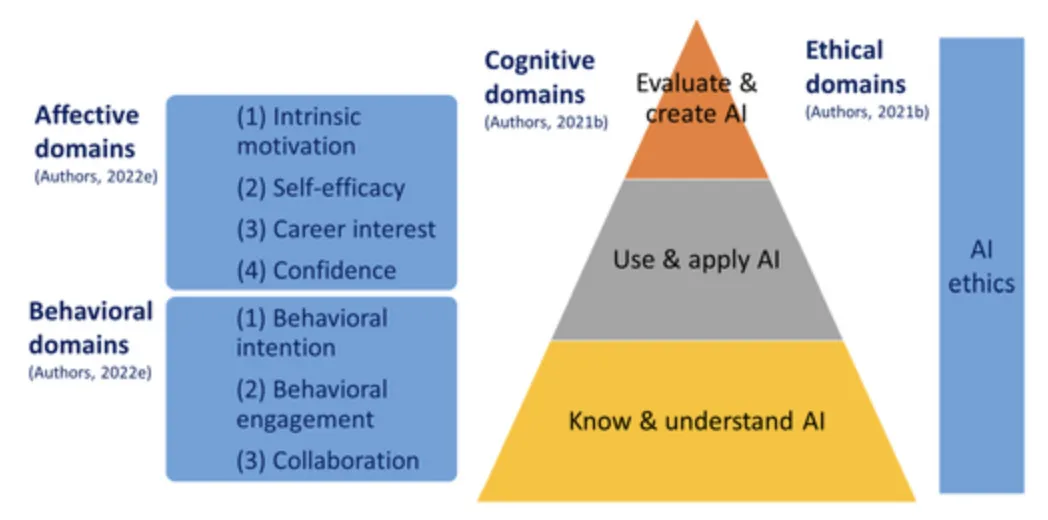

所以他们把 AI 素养拆成了四个维度,首字母拼起来就是 ABCE:

A(Affective,情感维度)——学生对 AI 学习的内在动机、自我效能感和信心。说人话就是:学生愿不愿意学 AI、相不相信自己学得会、有没有兴趣继续往下钻。最初的设计里还包括”职业兴趣”,但后来在验证过程中被剔除了,原因是中一中二的孩子对未来职业的想象本来就还很模糊,问出来的数据信号太弱。

B(Behavioural,行为维度)——学生在 AI 学习中的实际行为表现,主要是行为投入和小组协作。最初这部分有”行为意图”和”行为投入”两个子维度,但学生填问卷时分不清楚两者,最后合并成了一个”行为承诺(behavioural commitment)”。

C(Cognitive,认知维度)——学生对 AI 知识的掌握,从低阶到高阶分两层:一层是”知道并理解 AI”(知道什么是机器学习、AI 怎么感知世界、社会影响等),另一层是”应用、评估并创造 AI”(用 AI 工具解决具体问题、判断不同 AI 方案的优劣、自己做出 AI 驱动的解决方案)。原本设计里还有中间一层”使用与应用”,但实测数据显示学生很难把”使用”和”创造”分开——做项目的时候这两件事是同时发生的——所以这一层在验证后被合并掉了。

E(Ethical,伦理维度)——学生对 AI 伦理的认知,覆盖可靠性、安全、隐私、责任、透明度、意识、社会效益等方面。

研究者把这套框架画成了一个金字塔加两根柱子的图:底座是”知道与理解 AI”的低阶认知,往上是”应用、评估与创造 AI”的高阶认知,左右两侧分别是情感和行为维度,伦理则贯穿整个结构。这样的结构意味着:一个有 AI 素养的学生,不只是个技术使用者,还应该是个有信心、能合作、会思考、有责任感的学习者。

二、量表是怎么造出来的:四步走

光提出一个框架还不够,要让它真的能被研究者和教师用起来,得有一份经过严格验证的问卷。研究团队的开发流程走了四步:

第一步:专家判断。 邀请六位专家——三位学者加三位教师——审查初版条目。他们的反馈意见之一是:在认知维度里,”使用与应用 AI”和”评估与创造 AI”的题目对中学生来说差别太微妙,学生很难分辨。这条意见被采纳了,相关条目做了合并。

第二步:学生访谈。 中一到中三的学生被请来逐题作答,并解释自己理解到了什么。学生们的反馈和教师的判断高度一致——确实分不清”使用”和”创造”。同时,伦理维度的题目需要更多解释才能让学生明白。

第三步:试测(pilot study)。 47 名中一中二学生先上了 10 节 AI 课,再填问卷。这一步的关键作用是检验:经过课程之后,学生在 ABCE 各维度上的得分是不是确实有所提升?结果除了”职业兴趣”和”小组协作”两项之外,其他维度都有显著提升——这反过来又支持了把”职业兴趣”剔除的决定。

第四步:大样本验证性因子分析(CFA)。 363 名来自香港两所中学的学生(年龄 12-17 岁,男女几乎各半)参加了为期三个月的 AI 课程并完成问卷。研究者用 CFA 来检验 ABCE 的四因子结构是不是真的成立。

最终的统计结果显示:模型拟合各项指标都达到了可接受的标准,四个一阶因子之上还存在一个更高阶的”AI 素养”因子。换句话说,ABCE 这四个维度既各自独立可测,又共同指向一个统一的 AI 素养建构。这套量表最终从 60 题精简到了 32 题,覆盖四个维度、保留了关键的子维度。

三、这套问卷是在什么样的课程里测出来的

这一步对一线教师特别重要。一份问卷的得分高低有意义,前提是学生上过的课程能真正激发对应的学习。如果学生只是听老师讲了几节”什么是 AI”,那再好的量表也测不出”评估与创造 AI”的能力。所以这个研究的另一半其实是教学设计。

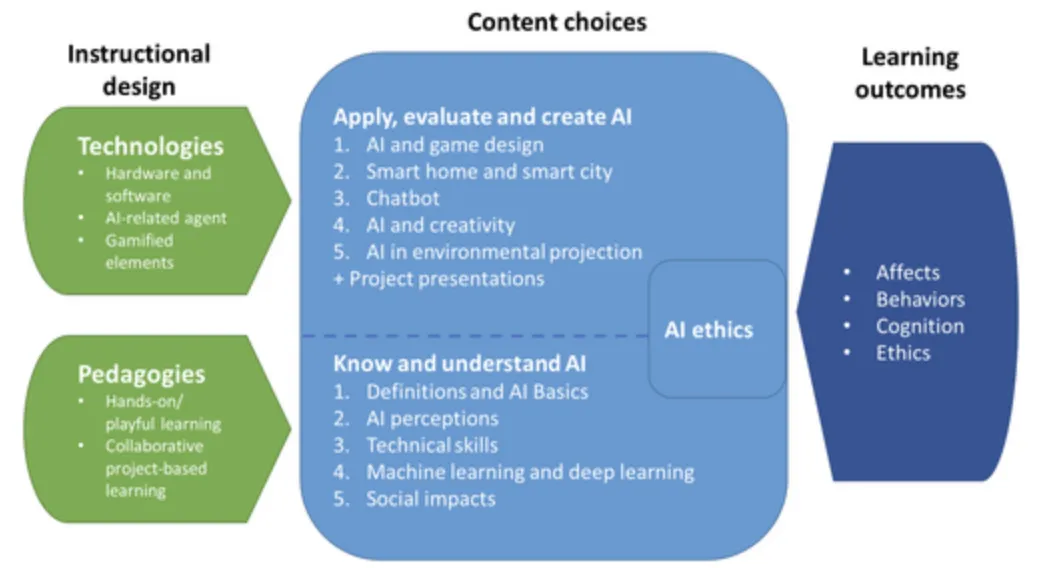

研究团队设计的是一个12 节课的 AI 素养课程,前 10 节每节聚焦一个主题,最后两节用于学生项目展示。课程分两层认知目标:

-

低阶层面(”知道与理解 AI”)的五个主题包括:AI 的定义和基础、AI 感知、技术技能、机器学习与深度学习、社会影响。

-

高阶层面(”应用、评估与创造 AI”)的五个主题包括:AI 与游戏设计、智能家居和智慧城市、聊天机器人、AI 与创意、AI 在环境项目中的应用。

教学方法上,团队采用项目式协作学习——学生五人一组,被要求自己去发现一个社会问题,然后用 AI 设计解决方案。

可用的工具包括 Teachable Machine(一个网页端的机器学习训练工具,不需要写代码)、Scratch AI(图形化编程语言)、Huskeylen(AI 视觉模块)、无人机等等。学生先用 Teachable Machine 收集数据样本、训练模型、测试分类效果,然后把模型导出,用 Scratch 搭一个游戏或应用。整个项目过程中,”AI 伦理”作为贯穿的主题——学生要在做项目的同时考虑 AI 的可靠性、安全、隐私、责任、透明度等问题。

这套教学设计本身是基于修订版 TPACK 框架和布鲁姆分类学构建的,由研究者、教育学教授、AI 专家和教师共同验证。这套课程的存在很关键——它意味着 AILQ 不是一个可以脱离课程任意使用的”通用”问卷,而是一份在有相应教学支持的前提下测量学生 AI 素养发展的工具。

四、32 题问卷的最终结构

经过四步验证后,正式版 AILQ 的结构如下:

情感维度包含两个子因子。一是”内在动机”,问的是学生对学习 AI 的兴趣和投入意愿。二是”自我效能与信心”——这两个原本是分开的,但 HTMT 指数显示重叠太严重(0.88),最后合并了。

行为维度也包含两个子因子。一是”行为承诺”,覆盖学生愿不愿意持续学习、愿不愿意主动参与 AI 相关活动;二是”协作”,问的是学生在小组项目中和同伴的合作质量。

认知维度包含两个子因子。一是”知道并理解 AI”,对应低阶认知;二是”应用、评估并创造 AI”,对应高阶认知。中间那层”使用与应用”在验证过程中因为和上下两层都重叠太严重,被整体移除了。

伦理维度保留为单一因子,最终从 16 题精简到 8 题,覆盖学生对 AI 可靠性、安全、隐私、责任、透明度、意识、社会效益等方面的认知。

所有题目用 5 点李克特量表回答,从”非常不同意”(1)到”非常同意”(5)。

为了公众号文章的可读性,量表放最后

五、一线教师可以怎么用

研究者明确指出,这份问卷的设计目的是供研究者和实践者使用,用来评估学生在 AI 课程中的素养发展。具体到一线教师的使用场景,从论文里可以读出几个直接的应用方向:

作为前后测工具。在开始 AI 课程前发一次,结束后再发一次,看看学生在 ABCE 四个维度上分别有什么变化。研究者自己就是这样用的——pilot study 里通过配对样本 t 检验,发现学生在大部分维度上都有显著提升。

作为诊断工具。即使不做完整的前后测,老师也可以用这套问卷在课程中段做一次小调查,看看学生在哪个维度上反馈较弱。比如如果学生在”协作”维度得分明显偏低,可能说明小组分工或学习管理系统的设计需要调整;如果”伦理”维度得分低,可能说明伦理内容在课程中嵌入得还不够深入。

作为课程设计的参考框架。即使不真的发问卷,ABCE 框架本身也可以作为老师设计 AI 课程时的检查清单:我的课有没有同时覆盖学生的情感、行为、认知和伦理四个面向?还是只停留在”教知识、教技能”的认知层面?

研究者也坦率地指出了这份问卷的几个局限。

它是基于香港特定课程情境验证的,不同地区、不同年级、不同教学条件下,学生对 AI 学习的感知可能会有差异;问卷只覆盖了 12 类 AI 素养相关的学习成果,并没有穷尽所有可能的维度,比如学习焦虑、对 AI 工具的具体使用偏好等都没有进入这个版本;此外它是自陈式问卷——学生说自己”能创造 AI 解决方案”和实际能不能做,也是两回事。

后续如果要用,最好结合学生的实际作品、项目表现、课堂观察一起判断。

这篇论文的位置

把这篇论文放回 Davy Ng 团队过去几年的研究脉络里看:2021 年他们在 Computers and Education: Artificial Intelligence 上提出 AI 素养的”四认知域”框架(知道与理解、使用与应用、评估与创造、AI 伦理),那是个纯概念性的工作。之后几年,他们用一系列教学实践和质性研究把这个框架落到具体场景里。

这篇 2024 年的 BJET 论文,是他们把概念框架工具化的关键一步——通过加入情感和行为两个维度,扩展为 ABCE,并配上一份经过严格验证的问卷。

对于关心 AI 教育评估的研究者和教师来说,这篇论文提供的不只是一份可以拿来用的量表,更重要的是一个可以借鉴的开发逻辑:先有一个有理论根基的框架,再有专家审查,再有学生访谈,再有小规模试测,最后才是大样本统计验证。每一步都有可能修改前面的设计——子维度被合并、被剔除、被重新定义。这套方法论本身,对国内正在尝试自主开发 AI 素养评估工具的团队来说,可能比量表本身更值得参考。

参考文献:Ng, D. T. K., Wu, W., Leung, J. K. L., Chiu, T. K. F., & Chu, S. K. W. (2024). Design and validation of the AI literacy questionnaire: The affective, behavioural, cognitive and ethical approach. British Journal of Educational Technology, 55, 1082–1104. https://doi.org/10.1111/bjet.13411

32 道题完整中文版

以下译文以中学生能直接读懂为目标。每题保留原始题目编号(IM = Intrinsic Motivation,SE = Self-Efficacy,CL = Confidence,BI = Behavioural Intention,EN = Engagement,SI = Social/Collaboration,KU = Know & Understand,EC = Evaluate & Create,AIE = AI Ethics),便于回溯论文。

情感维度(10 题)

(1)内在动机(4 题)

IM01 人工智能与我的日常生活(如个人生活、工作)是相关的。

IM02 学习人工智能是一件有趣的事。

IM03 学习人工智能让我的日常生活更有意义。

IM04 我对探索新的人工智能技术感到好奇。

(2)自我效能感(4 题)

SE01 我有信心自己能够在与人工智能相关的任务中表现出色。

SE02 我有信心自己能够把与人工智能相关的项目做好。

SE03 我相信自己能够掌握人工智能的知识和技能。

SE04 我相信自己能在与人工智能相关的测评中取得好成绩。

(3)信心(2 题)

CL01 我能够理解与人工智能相关的资源和工具。

CL03 我有信心自己能在与人工智能相关的任务中做得不错。

行为维度(8 题)

(1)行为承诺(5 题)

BI01 我将来会继续使用人工智能。

BI02 我会持续关注最新的人工智能技术。

BI03 我打算花时间去探索人工智能应用的新功能。

EN01 我会主动参与与人工智能相关的学习活动。

EN02 我会认真投入到与人工智能相关的学习材料中。

(2)协作(3 题)

SI01 我经常尝试向同学或朋友讲解与人工智能学习相关的内容。

SI02 我会努力和同学一起完成人工智能的学习任务和项目。

SI03 我经常在课余时间和同学讨论人工智能。

认知维度(6 题)

(1)知道与理解(3 题)

KU01 我知道什么是人工智能,并能说出它的定义。

KU02 我知道怎么使用人工智能应用(如 Siri、聊天机器人)。

KU05 我能区分不同的人工智能概念(如深度学习与机器学习)之间的差异。

(2)应用、评估与创造(3 题)

EC01 我能运用人工智能应用来解决问题。

EC03 我能创造由人工智能驱动的解决方案(如聊天机器人、机器人)来解决问题。

EC04 我能针对不同情境评估人工智能应用和概念。

伦理维度(8 题)

(1)AI 伦理(8 题)

AIE02 我理解滥用人工智能可能会给人类带来重大风险。

AIE05 我认为人工智能系统需要经过严格测试,以确保它能按预期运作。

AIE07 我认为用户有责任去关注人工智能的设计和决策过程。

AIE08 我认为人工智能系统应当惠及每一个人,不论其身体能力或性别。

AIE10 我认为应当让用户了解人工智能系统的用途、运作方式以及可能的局限性。

AIE11 我认为人在使用人工智能系统时应当承担责任。

AIE12 我认为人工智能系统应当符合伦理和法律标准。

AIE13 我认为人工智能可以用来帮助弱势群体。

夜雨聆风

夜雨聆风