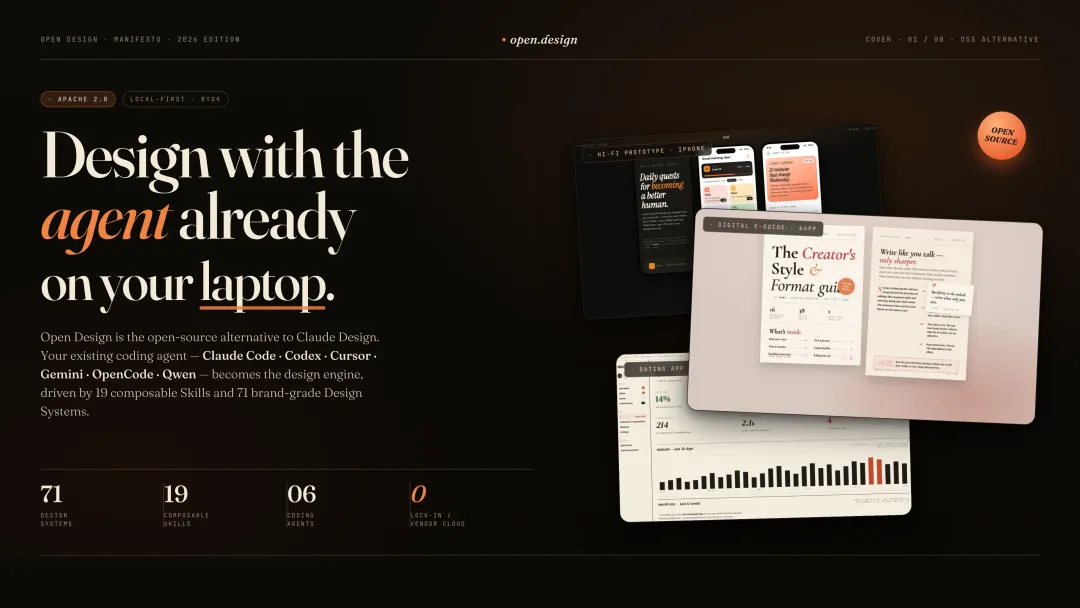

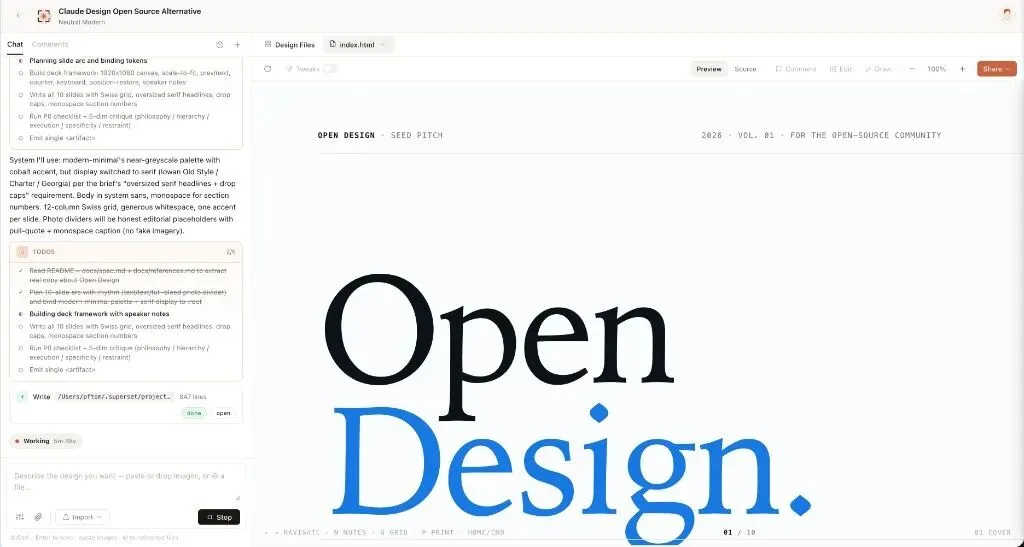

这个开源项目,把 AI 设计从“生成图片”推进到了“交付设计稿”

最近看到一个挺有意思的开源项目:

Open Design

项目地址:https://github.com/nexu-io/open-design

它的定位很直接:Claude Design 的开源替代品。

但我觉得更准确的说法是:

它不是想再做一个 AI 画图工具,而是想做一个真正能交付设计资产的 AI 设计工作台。

这件事很关键。

因为过去很多 AI 设计工具解决的是“生成一张图”的问题。

而 Open Design 想解决的是:

从需求 → 设计方向 → 设计系统 → 可预览 artifact → 可导出文件。

这已经不是简单的“画图”,而是更接近真实设计流程。

AI 设计,不应该停在“出一张好看的图”

过去我们用 AI 做设计,大概是这样:

写一句 prompt。

生成一张图。

不满意。

再改 prompt。

继续生成。

最后选一张“看起来还行”的。

这个流程很像抽卡。

但真正的设计工作不是抽卡。

真正的设计要解决的是:

-

• 需求是否清楚 -

• 视觉方向是否稳定 -

• 风格是否统一 -

• 组件是否可复用 -

• 文件是否能继续编辑 -

• 结果是否能交付

一张图,只能看。

一个 artifact,才能进入生产流程。

这就是 Open Design 有意思的地方。

它不是重新造模型,而是把现有 Agent 变成设计师

Open Design 不是自己训练一个设计模型。

它的思路是:

你电脑里已有的 coding agent,本来就很强,为什么不让它们来做设计?

它可以接入 Claude Code、Codex、Cursor Agent、Gemini CLI、OpenCode、Qwen、GitHub Copilot CLI 等工具。

换句话说,它不是把 AI 关在一个网页里。

而是让本地已有的 agent 进入一个设计工作流。

这点很重要。

因为设计不是孤立动作。

设计稿最终通常会进入代码、页面、PPT、营销物料、产品原型里。

如果 AI 设计工具本身就能和本地文件系统、代码环境、导出流程打通,它就不再只是一个“生成器”,而更像一个生产系统。

最关键的一步:先问清楚,再开始设计

很多 AI 设计失败,不是因为模型不会画。

而是因为一开始需求就不清楚。

比如你只说:

“帮我做一个产品页面。”

AI 其实不知道:

-

• 给谁看? -

• 是官网、产品页,还是融资 deck? -

• 要高级感,还是转化感? -

• 偏科技、极简、杂志,还是工具型? -

• 有没有品牌色? -

• 最终要 HTML、PDF,还是 PPT?

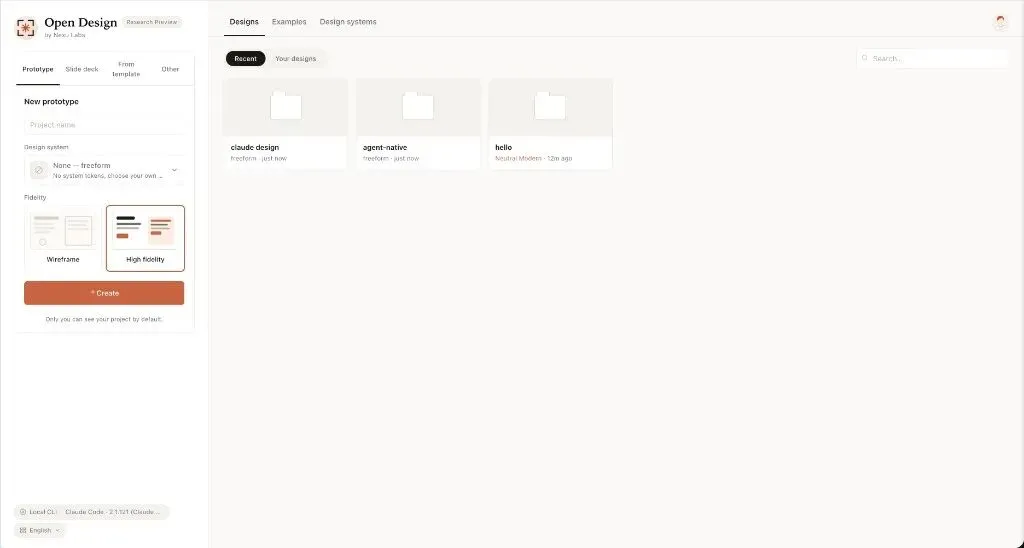

Open Design 里一个很重要的设计,是它会先通过表单把这些问题收敛掉。

不是马上生成,而是先确认 brief。

这更像真实设计师接需求的过程。

先问清楚,再动手。

AI 设计的下一步,是“收敛”,不是“自由发挥”

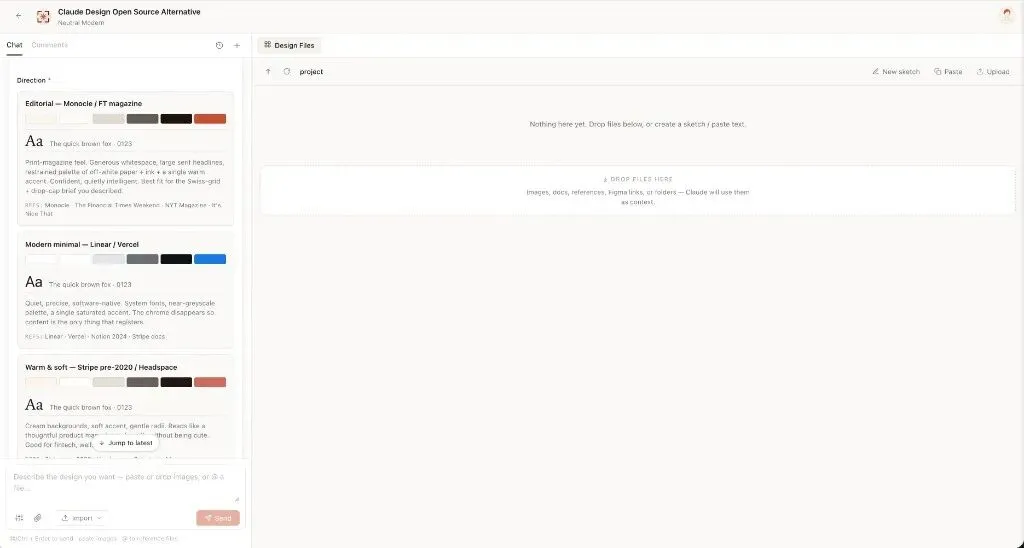

Open Design 里还有一个很有价值的设计:Visual Directions。

当你没有明确品牌风格时,它会给出几个方向,比如:

-

• Editorial -

• Modern Minimal -

• Warm Soft -

• Tech Utility -

• Brutalist

这些不是简单的风格标签。

每个方向背后都有对应的色彩、字体、版式和视觉语言。

这其实代表了 AI 设计的一种新趋势:

不是让 AI 无限自由发挥,而是给 AI 一个确定的设计边界。

听起来有点反直觉。

但真正的生产力工具,恰恰需要边界。

商业设计要的不是每次都惊喜。

商业设计更需要:

稳定。

可控。

不跑偏。

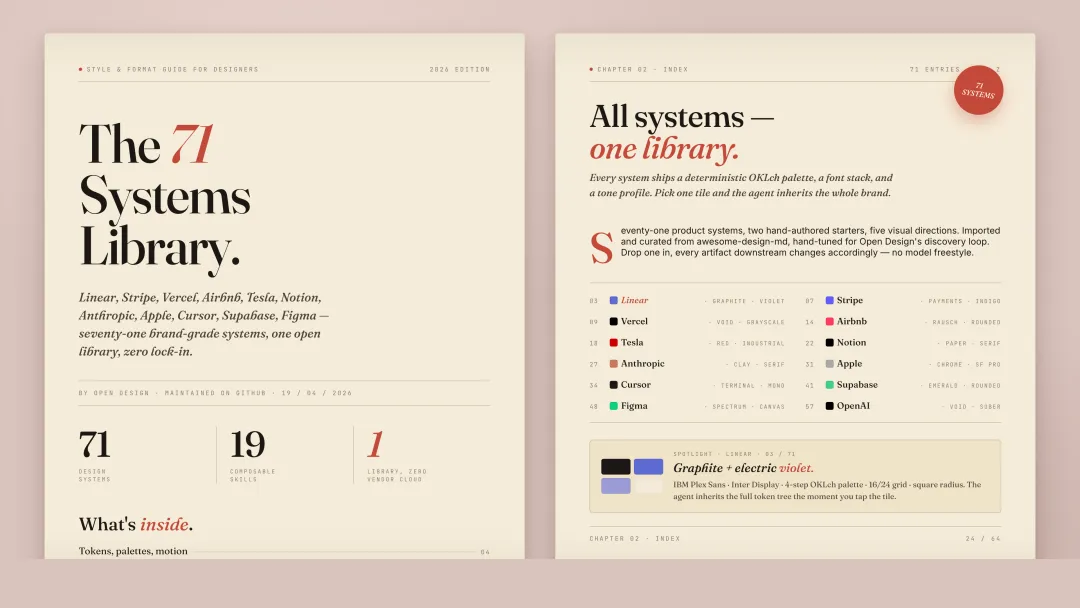

设计系统,才是 AI 设计真正的上下文

Open Design 内置了大量设计系统。

包括 Linear、Stripe、Vercel、Airbnb、Tesla、Notion、Apple、Anthropic、Cursor、Supabase、Figma、小红书等风格方向。

这个能力,比“多几个模板”更重要。

因为对 AI 来说,所谓“高级感”不能只靠一句话:

“做得高级一点。”

这太虚了。

真正有用的是直接告诉它:

-

• 用什么色彩 -

• 用什么字体层级 -

• 用什么间距规则 -

• 用什么组件结构 -

• 哪些元素可以用 -

• 哪些风格要避免

也就是说:

AI 设计的核心,不是 prompt,而是上下文资产。

谁能把设计系统变成 AI 可读取、可执行的上下文,谁就更容易得到稳定结果。

从图片到 artifact,这是一个质变

Open Design 的输出不是单纯图片。

它会生成可以在沙箱里预览的 artifact,并支持导出 HTML、PDF、PPTX、ZIP、Markdown 等格式。

这点非常关键。

因为图片是终点。

artifact 是起点。

图片只能展示。

artifact 可以继续编辑、继续导出、继续接入项目。

如果你做的是:

-

• 产品 landing page -

• 移动端原型 -

• 融资 deck -

• 运营海报 -

• 数据看板 -

• 社交媒体卡片 -

• 产品介绍页

那这个区别会非常明显。

你要的不是“AI 给我一张图”。

你要的是:

AI 给我一个能继续改、能交付、能进入工作流的东西。

它还把 gpt-image-2、视频和动效放进了同一个流程

Open Design 不只做页面和原型。

它还把媒体生成放进了同一套工作流里。

其中,gpt-image-2 可以用于生成:

-

• 海报 -

• 头像 -

• 信息图 -

• 插画地图 -

• 杂志风社交卡片 -

• 产品概念图

同时,它还接入了 Seedance 2.0 和 HyperFrames。

这意味着 Open Design 想做的不是一个单点工具。

它更像是一个 AI 内容资产工作台。

文字、页面、图片、视频、动效,都可以在同一套生产链路里完成。

这也是我觉得它值得关注的原因。

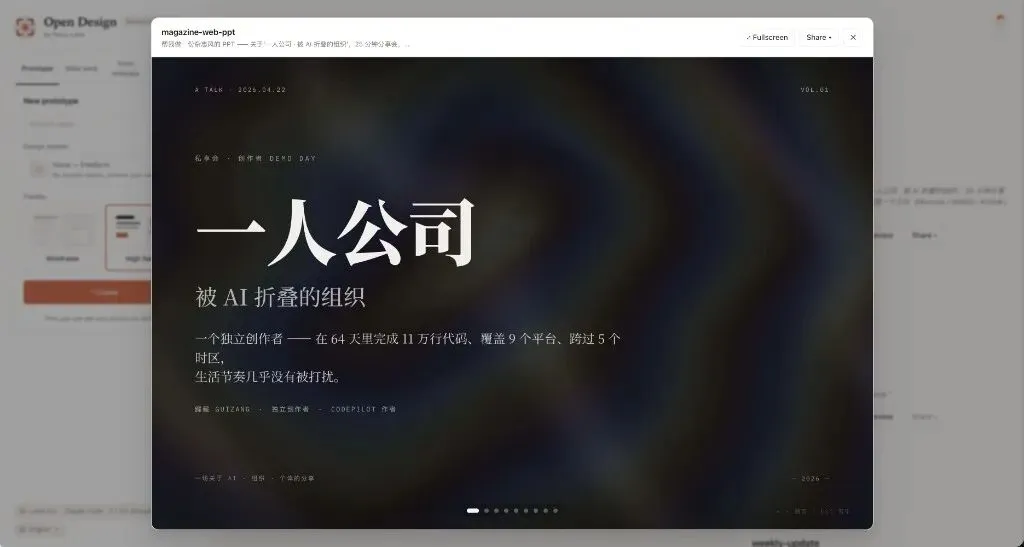

它最适合谁?

我觉得 Open Design 最适合三类人。

第一类,是独立开发者。

你可以用它快速做产品页、原型、PPT、展示页。

第二类,是做 AI 产品的人。

你可以把它理解成“本地 Agent + 设计系统 + artifact 生成器”。

第三类,是做内容自动化的人。

尤其是当 gpt-image-2、视频生成、HTML 转视频这些能力接进去之后,内容生产就不只是写文章了。

而是可以扩展成:

-

• 出图 -

• 出页面 -

• 出卡片 -

• 出视频 -

• 出动效 -

• 出 PPT

这就非常适合做自动化内容系统。

这个项目真正值得看的,不是界面,而是思路

Open Design 最值得关注的,不是它某个界面多好看。

而是它背后的产品判断:

AI 设计工具不能只追求“生成效果”,而要进入真实交付链路。

以前的 AI 设计工具,像玩具。

你输入一句话,它给你一张图。

现在的 AI 设计工具,开始变成工作台。

它要理解需求。

它要调用设计系统。

它要生成 artifact。

它要能导出。

它要能被继续编辑。

它要能和代码项目连接。

这就是从“AI 画图”到“AI 设计生产”的分界线。

最后

Open Design 这个项目给我的最大启发是:

未来的 AI 设计,不会只比谁生成得更漂亮,而是比谁更能交付。

图片生成只是第一步。

真正有价值的是:

-

• 可控 -

• 可复用 -

• 可编辑 -

• 可导出 -

• 可进入工作流

如果第一代 AI 设计工具是在比“谁更会画”。

那下一代 AI 设计工具,可能要比的是:

谁更像一个真正能交付的设计团队。

夜雨聆风

夜雨聆风