Musk 在法庭上警告 AI 会杀死人类——同一周,xAI 进入了美军机密系统

Musk 在法庭上警告 AI 会杀死人类——同一周,xAI 进入了美军机密系统

一、庭审第一周发生了什么

2026 年 4 月 28 日,加州 Oakland 联邦法院开庭审理 Musk 诉 OpenAI 案。这场诉讼追溯到 2024 年 2 月——Musk 当时控告 OpenAI 背叛 2015 年成立时的非营利使命,违反慈善信托原则。索赔金额坊间报道在 1300 至 1500 亿美元之间。

庭审第一周,Musk 三天坐在证人席上。他自称是 “a fool who provided them free funding to create a startup”——指 2015 至 2018 年累计向 OpenAI 捐赠的约 3800 万美元。他对陪审团说:”The worst-case scenario is a Terminator situation where AI kills us all.”

他把自己对 OpenAI 的态度变化描述为三个阶段:”enthusiastically supportive”——”lost confidence they were telling me the truth”——”sure they’re looting”。

主审法官 Yvonne Gonzalez Rogers 多次打断双方关于 AI 安全的论证。她对法庭说:”This is not a trial on whether artificial intelligence has damaged humanity.” 她还在 2025 年 3 月即决判决阶段驳回了 Musk 的违约主张,理由是 2015 年的创始协议没有明确禁止 for-profit 重组。庭审保留下来的诉求是慈善信托违反、不当得利、以及一项被进一步缩小的欺诈主张。

这场庭审有一个不寻常的结构:陪审团九人,但他们只出咨询性意见。最终裁决由法官单独作出,预计 5 月中下旬。

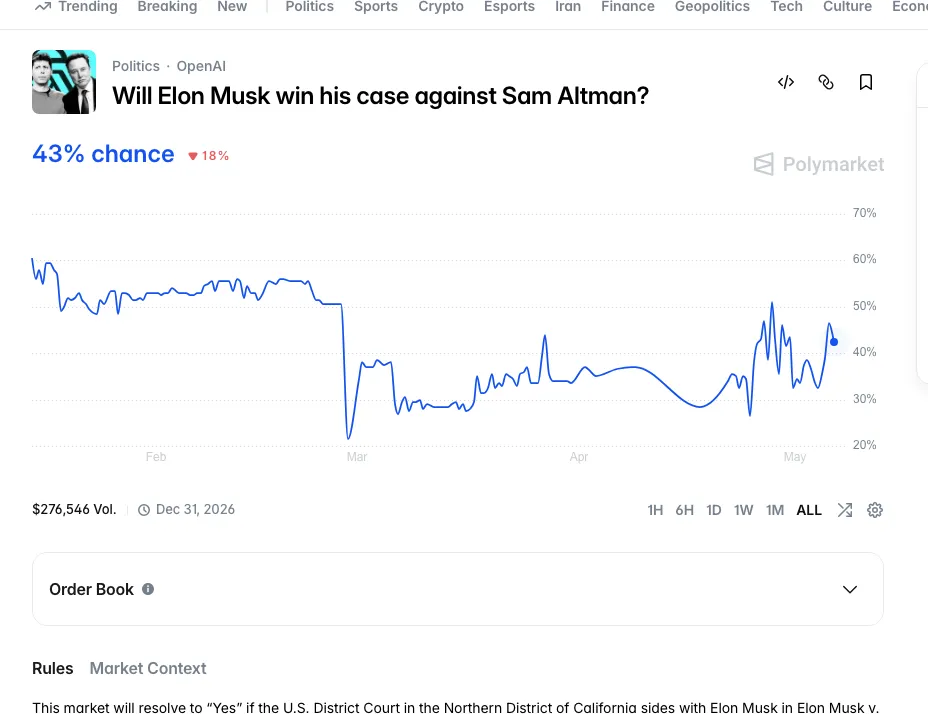

预测市场对结果有自己的判断。Kalshi 的 Musk 胜诉概率为 37%,Polymarket 为 40%。庭审第一天前的高点曾达到 60%,第一天庭审结束后跌到 37%。

庭审中也披露了一些事先并未广为人知的事实:Musk 承认 xAI “partly distills” OpenAI 的模型;OpenAI 的律师团队展示了 2017 年 9 月 Musk 自己起草 for-profit 实体并要求多数股权的邮件,以及 2018 年 2 月他提议把 OpenAI 并入 Tesla 的提案。庭审开始前两天,Musk 给 OpenAI 总裁 Greg Brockman 发短信试探和解;Brockman 提议双方撤诉后,Musk 回复:”By the end of this week, you and Sam will be the most hated men in America.”

二、同一周,庭外发生了什么

2026 年 2 月 23 日,Axios 报道 xAI 与五角大楼签约,让其聊天机器人 Grok 进入机密军事系统。这是基于 2025 年 7 月 14 日国防部 Chief Digital and Artificial Intelligence Office 给 xAI 授予的最高 2 亿美元合同的延伸。

那一天,国防部同时给四家公司各授予了上限 2 亿美元的合同:xAI、OpenAI、Anthropic、Google。

OpenAI 在拿到这份合同之外,还在 2025 年 6 月与 Peter Thiel 投资的国防科技公司 Anduril 合作开发反无人机系统。这是 OpenAI 首次直接进入武器适用域。OpenAI 也整合进了五角大楼内部的 GenAI.mil 平台,覆盖约 300 万国防部人员。OpenAI 自设了三条红线:禁止用于域内大规模监控、自主武器系统、高风险自动化决策。Sam Altman 后来在公开访谈中承认,最初的协议 “looked opportunistic and sloppy”。

Anthropic 的处理方式不同。CBS News 报道,2026 年美以对伊朗战争的前 24 小时内,美军使用 Anthropic Claude 帮助生成了超过 1000 个目标,综合卫星图像、信号情报和监控数据,输出含 GPS 坐标、武器建议和自动法律理由的目标列表。然后在 2026 年 2 月,国防部长 Pete Hegseth 发布备忘录,要求所有 AI 采购合同包含 “any lawful use” 条款,禁止供应商加任何超出法律要求的限制。Anthropic CEO Dario Amodei 公开拒绝接受,称在 “good conscience” 下不能让 Claude 用于域内大规模监控或自主武器。Trump 随即下令所有联邦机构 “immediately cease” 使用 Anthropic 技术,Hegseth 启用”供应链风险”标签将其封杀。但 Claude 在伊朗战争中已部署的实例继续运行。

Google 是另一条路径。2018 年 Project Maven 引发员工抗议后,Google 公布 AI 原则,明确承诺不开发武器或违反国际规范的监控 AI。2025 年 2 月 4 日,Google 从公开 AI 原则中删除了这一承诺。2026 年 4 月,Google 与国防部签订机密 AI 合同,允许五角大楼把 Google AI 模型用于”任何合法政府用途”。580 多名员工签信反对,其中包括 20 多位总监和副总裁,以及 DeepMind 的高级研究员。Sundar Pichai 没有让步。DeepMind 员工随后投票筹备工会。

三、第三方在说什么

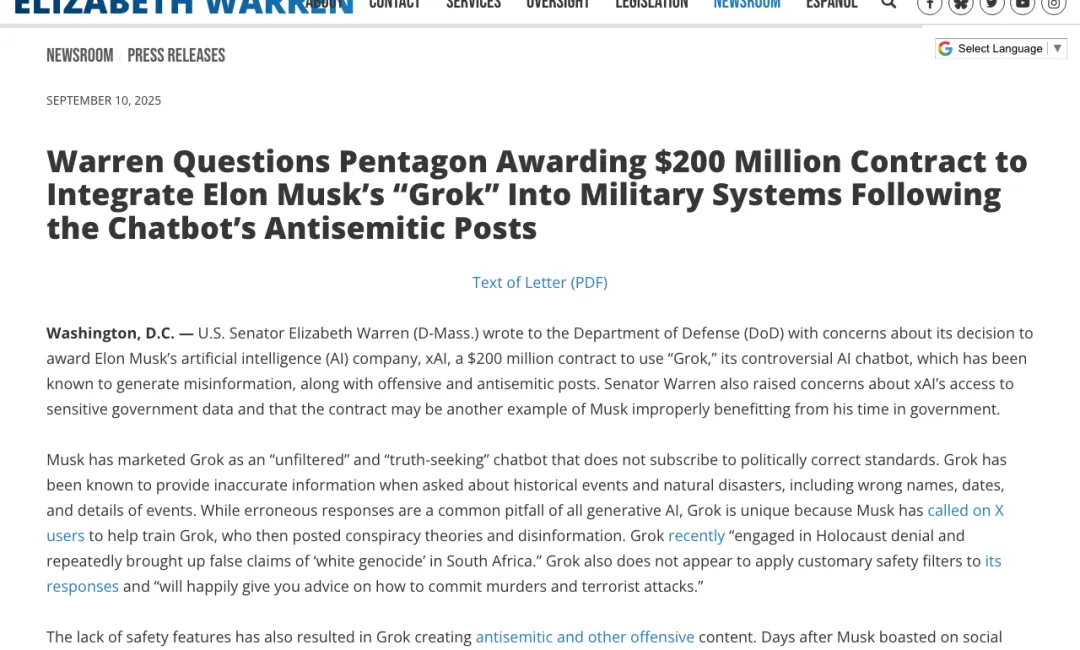

参议员 Elizabeth Warren 在 2025 年 9 月致信五角大楼,质疑给 xAI 的 2 亿美元合同。NBC News 援引前国防部员工称,xAI 是 Trump 政府”最后时刻”加入名单的——直到 2025 年 3 月,受邀名单中并没有 xAI。

电子前哨基金会 EFF 把 OpenAI 的三条红线描述为 “weasel words”,称措辞充满漏洞。

Lawfare 发表的一篇法律分析认为,”用采购合同做政策”既扩大了商业 AI 的军用范围,也降低了厂商的安全约束——Anthropic 退出后,市场空间留给了约束更弱的小厂。

Jacobin 直接指出 OpenAI 的现金流压力推动了军用合同——文章标题是 “OpenAI Is Bleeding Cash. Its Solution? Military Contracts.”

Fortune 在庭审第一周末写道,Musk vs OpenAI 庭审”more heat than light”——真正的 AI 治理战场是 Anthropic 起诉国防部限制条款的上诉案,不是这个加州联邦法庭。

加州和德拉华州的 Attorneys General 在”近一年的建设性对话”后,已于 2025 年 10 月批准了 OpenAI 转为 Public Benefit Corporation 的重组方案。在美国法律体系下,AG 是慈善信托的法定监督者。

四、时间线对照

五、几个观察

1. AG 批准这件事被严重低估

媒体把这场庭审定位为”决定 AI 未来谁说了算”。但慈善信托的法定监督者——加州和德拉华州的 Attorneys General——已经在 2025 年 10 月签字批准了 OpenAI 的 PBC 重组。他们用了将近一年时间审查。

法官现在审的,是这两个州 AG 已经审过的事。这种结构下,法庭裁决要在实质上推翻 AG 的判断是很罕见的——Sloan-Kettering 等历史案例里,即使监管同意,个人高管在 unjust enrichment 上仍被判赔;但重组本身被撤销的先例几乎没有。

预测市场目前的 37–43% 区间数字,可能就在 price 这件事:Musk 部分胜诉的可能性存在(高管个人责任、有限赔偿),但”撤销重组”的可能性极低。媒体讲的”世纪审判”和实际可能的判决空间之间存在落差。

2. 声明型红线 vs 退出型红线,价值差几个数量级

OpenAI 公布的三条红线(不用于大规模监控、不用于自主武器、不用于高风险自动化决策)是声明。EFF 称其为 “weasel words”。我没有立场判断 EFF 是不是过度解读,但有一个可观察的对照点。

Anthropic 在 2026 年 2 月真的拒绝了 Pentagon 的 “any lawful use” 条款,被 Trump 当场封杀。这是带成本的退出——失去合同、失去市场份额、失去政府背书。

声明是免费的。退出有代价。在评估一家 AI 公司的”红线”时,前者基本只是公关材料,后者才是实际信号。

OpenAI 至今没有遇到 Anthropic 那种程度的对抗性测试。或者说,遇到了但选择留在桌上。这不是道德判断——但是评估”红线可信度”时唯一有意义的 datapoint。

3. 庭内讨论的命题,跟庭外正在发生的命题不重合

庭内讨论的是:2015 年的合同义务、Musk 当年的真实意图、慈善信托抽象上是否被违反、AGI 是否会”杀死所有人”。

庭外发生的是:Claude 在伊朗战争前 24 小时帮美军生成 1000 多个目标坐标、xAI Grok 进入机密军事系统、Google 删除 Project Maven 之后的承诺并签机密合同、Anthropic 因坚持红线被封杀。

法官自己已经多次提醒这件事:“This is not a trial on whether artificial intelligence has damaged humanity.” Fortune 说这场庭审 “more heat than light”——真正的 AI 治理战场是 Anthropic 起诉国防部的上诉案,不是这里。

如果想理解 AI 接下来会怎么发展,看 Pentagon 的采购合同条款比看法庭辩论稿更有信息量。

4. Musk 邮件 vs Musk 庭审证词,可能不是”谁在撒谎”问题

OpenAI 律师在庭上展示了大量 Musk 在 2017–2018 年的邮件:他亲自起草 for-profit 实体、要求多数股权、提议把 OpenAI 并入 Tesla。这些邮件和他现在的庭审证词(”我被骗了,他们要永远保持非营利”)确实矛盾。

但人对自己十年前的动机的回忆,本来就受当下处境塑形。Musk 现在拥有一家直接竞争对手 xAI,正面临 6 月上市。他对 2015 年的回忆不可能不被这个 incentive 重新着色。

这不是说他在撒谎。是说法律范式预设了”过去发生了什么”是一个有收敛答案的事实问题,但争议性团队的早期历史,每个参与者都在事后重新生成。这种不收敛性可能就是这场庭审的根本困难——不是证据不够,是范式不对。

5. xAI 6 月上市这个时间窗口

xAI 的 IPO 路径目标估值 1.75 万亿美元,预计 6 月。这场庭审 5 月底裁决。两个事件相隔约 4 周。

不评判 Musk 的意图,只看 incentive landscape:

-

不管裁决结果是什么,庭审持续期已经把 OpenAI 的 IPO 时间线往后推了 -

庭审持续期已经把 OpenAI 的”AI 安全先驱”叙事打了折 -

庭审持续期已经把 xAI 在 Pentagon 合同上的”我也是负责任的 AI”叙事强化了

这三件事都不需要赢。只需要这场庭审存在到 5 月底。

模式本身是数据点,不是结论。

6. 这是一场结构性的”互相告对方在做自己也在做的事”

把六件事并列看:

-

Musk 起诉 OpenAI 偏离非营利使命;自己运营 xAI 直接竞争,且 xAI distills OpenAI -

Musk 法庭警告 AI 会杀死人类;同期 xAI Grok 进入机密军事系统 -

Musk 控告 OpenAI 慈善变质;自己 2017 年起草 for-profit、要求控股 -

OpenAI 反诉 Musk 是商业打击;自己同样在拿 Pentagon 合同 + Anduril 合作 -

OpenAI 自设的”高风险自动化决策”红线;同期 Claude 在伊朗 24 小时打 1000 目标 -

Google 在 2018 年承诺不开发武器 AI,2025 年删除承诺,2026 年签机密合同

这不是一边对一边错。是两边都在用对方的修辞工具攻击对方在做的同一类事。

这种结构里,谁赢得官司不是最重要的问题。最重要的问题可能是:当所有头部参与者都在做同一件事(向 Pentagon 销售 AI 系统)时,”AI 安全”这个词在公司治理层面还剩多少实际约束力?

这个问题不会在 5 月底法官的裁决书里得到回答。

关于这篇文章

§一到§四是事实陈述,所有引用附原始来源。§五是基于这些事实之间关系的观察,不是结论。判断由读者自己作出。

主要来源

庭审:CNBC live updates (Day 2-4 + Brockman)、Washington Post、CNN、NPR、TechCrunch、MIT Tech Review、ABC7 SF、The Ringer

军用 AI:Axios(xAI Pentagon contract)、DefenseScoop、Defense News、CBS News(Claude in Iran)、Responsible Statecraft、The Hill(Anthropic ban)、CNBC(Pentagon-Anthropic standoff)、Anthropic 官方声明、EFF、Lawfare

OpenAI 重组:CNBC、Bloomberg、OpenAI 官方公告、ProMarket

第三方:Sen. Warren press release & letter、Fortune、Jacobin、The Intercept、SF Standard、Internal Tech Emails

完整链接见 research.md。

夜雨聆风

夜雨聆风