现在人人都在用 AI,可很多人一上来就懵了:

到底用现成的AI助手,还是自己在电脑上跑本地大模型?

今天这篇,专门写给新手、小白、刚接触AI的朋友。

不讲复杂术语,只讲怎么选、哪个好用、哪个省心、哪个安全。

我们拿两个最典型、最火的来对比:

豆包电脑版(云端 AI)

本地运行阿里 Qwen3.5(本地大模型)

看完这篇,你再也不会被“本地模型”“云端 AI”绕晕。

一、先搞懂最核心的区别:云端vs本地

1.豆包电脑版=住在云端的AI助手

你打开软件,问题发给云端服务器,服务器算完,答案返给你。

就像:你点外卖,餐厅做好送过来。

2.本地Qwen3.5 =装在你电脑里的AI

模型文件下载到你 Mac/Windows 里,完全在你电脑上运行。

就像:你买了食材,自己在家做饭。

一句话记住:

豆包:不用管,打开就用。

本地 Qwen3.5:要下载、要设置、要折腾。

二、一张表看懂所有区别(新手直接收藏)

对比 | 豆包电脑版(云端) | 本地运行 Qwen3.5 |

要不要联网 | 必须联网 | 下好模型后可离线 |

安装难度 | 一键安装,零门槛 | 要下工具+模型,略麻烦 |

运行速度 | 快,靠云端算力 | 看你电脑配置 |

隐私安全 | 内容上传云端 | 内容只在本地,不外流 |

功能多少 | 超多:聊天、写作、生图、总结、文档、截图理解 | 基本只有文字对话 |

适合谁 | 90% 的普通用户 | 极客、隐私敏感、爱折腾的人 |

花钱吗 | 免费够用,高级功能可选付费 | 完全免费 |

简单说:

90%的人,其实只需要豆包电脑版。

三、豆包电脑版到底强在哪?(普通人的最佳选择)

如果你是下面这类人,直接用豆包,别折腾本地模型:

平时要写文案、写朋友圈、写工作总结

要改文章、润色、翻译、起标题、想思路

要截图提问、图片理解、生图、做计划

不想研究任何技术,打开就要用

豆包电脑版的优势:

1.真·开箱即用

下载安装,登录就能用,不用懂模型、参数、量化。

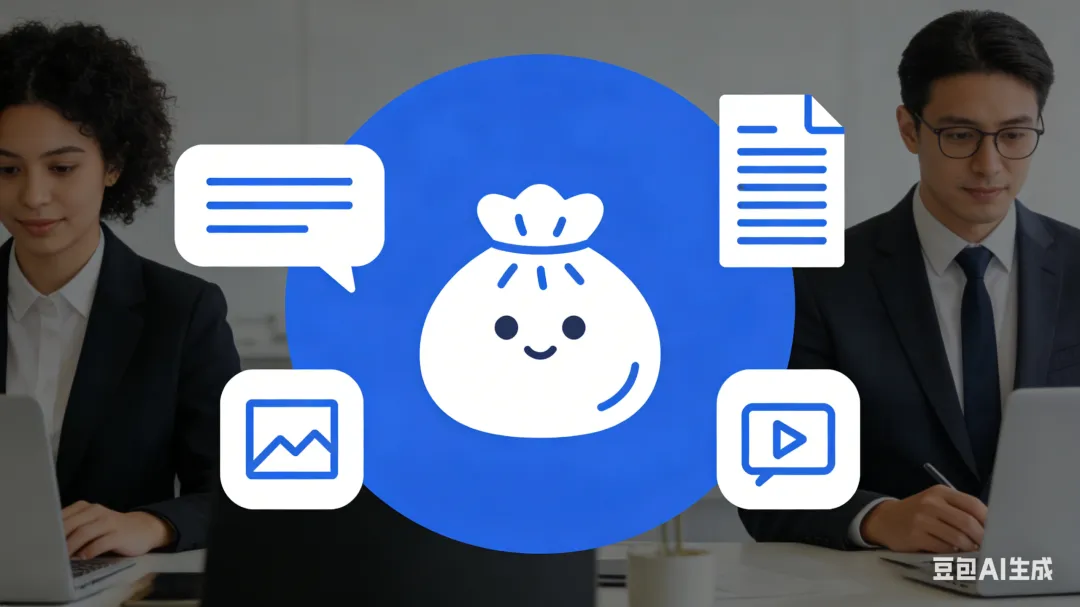

2.功能多到用不完

聊天对话

文章生成、文案、诗歌

文档总结、长文阅读

截图理解、图片识别

生图、AI 创作

本地模型目前比不了。

3.不挑电脑

你电脑再老、再慢,都不卡,因为算力在云端。

4.多端同步

手机、电脑、平板,记录随时同步。

一句话:

普通人、办公族、长辈、新手,首选豆包电脑版。

四、什么人才需要本地跑Qwen3.5?

本地大模型听起来很厉害,但真不是人人都需要。

只有满足下面任意一条,再考虑本地 Qwen3.5:

1.极度在意隐私

不想对话内容、敏感文档上传到任何云端。

2.经常没网/不想用网

飞机上、地铁里、国外、没 WiFi 也要用 AI。

3.喜欢折腾、研究技术

愿意花时间下载、安装、调参、换模型。

4.想无限免费使用

不接受任何次数限制、会员制。

本地Qwen3.5的优点:

绝对隐私

离线可用

完全免费

可自己换模型

缺点也很明显:

安装麻烦

只支持文字

吃电脑配置

没有生图、截图理解等高级功能

五、新手最终选择指南(照抄就行)

如果你是:

普通用户

办公、写作、日常问答

给家人、长辈用

不想折腾

��直接选:豆包电脑版

如果你是:

极客、技术爱好者

对隐私要求极高

有 Mac(M1/M2/M3/M4)

愿意折腾安装

��可以玩:本地Qwen3.5

最简单的判断:

不想学、只想用→豆包

想隐私、爱折腾→本地Qwen3.5

六、最后一句大实话

现在的 AI 已经分成两条路:

一条路:简单、好用、全能→ 云端 AI(豆包)

一条路:隐私、自由、折腾→ 本地大模型(Qwen3.5)

对 90% 的人来说:

能用好豆包,就已经足够吊打大部分人了。

不用追新技术、不用跟风本地模型,

适合自己、省心好用,才是最好的AI。

愿意折腾安装👉可以玩:本地 Qwen3.5

如果你是:

极客、技术爱好者

对隐私要求极高

有 Mac(M1/M2/M3/M4)

愿意折腾安装

��可以玩:本地Qwen3.5

一.苹果手机上用PocketPal AI一键部署Qwen3.5完整步骤

一、准备工作

设备:iPhone 12 以上(推荐 A17 Pro / M 系列芯片) 系统:iOS 16.0+ 空间:预留5–15GB存储(视模型大小) 网络:Wi‑Fi 下载模型(流量大)

二、安装PocketPal AI(2种方式)

三、下载并运行Qwen3.5模型

四、使用与优化

五、其他方式(可选)

二.Mac上Qwen3.5各版本本地运行对比

一、先看你的Mac能不能跑(必看)

二、方法一:LM Studio(可视化,新手首选,零代码)

4.性能优化(Mac专属)

三、方法二:Ollama(命令行极简,适合快速体验)

Bashollama --version |

Bash 7B 版本(推荐 16GB+)ollama run qwen3.5:7b# 14B 版本(推荐 32GB+)ollama run qwen3.5:14b# 0.8B 小模型(8GB 内存)ollama run qwen3.5:0.8b<o:p> |

Bash 查看已下载模型ollama list# 删除模型ollama rm qwen3.5:7b# 后台服务(开机自启)brew services start ollama<o:p> |

四、方法三:llama.cpp(深度控制,开发者/极客)

Bash 安装 Homebrew(如未装)/bin/bash -c "$(curl -fsSL https://raw.githubusercontent.com/Homebrew/install/HEAD/install.sh)"# 安装编译工具brew install cmake git<o:p> |

Bashgit clone https://github.com/ggerganov/llama.cppcd llama.cppmake cleanmake LLAMA_METAL=1 -j4 M 系列芯片用 Metal 加速<o:p> |

Bash./build/bin/llama-server -m models/qwen3.5-7b-instruct-q4_k_m.gguf -c 8192 -ngl 99 -fa --port 8080 |

五、三种方法对比(选最适合你的)

方法 | 难度 | 可视化 | GPU 加速 | 适合人群 |

LM Studio | ⭐ | ✅ | ✅ | 新手、普通用户 |

Ollama | ⭐⭐ | ❌ | ✅ | 命令行爱好者、快速体验 |

llama.cpp | ⭐⭐⭐ | ❌ | ✅ | 开发者、深度定制 |

夜雨聆风

夜雨聆风