最近几个月,OpenClaw 这个开源项目可以说是火得一塌糊涂。身边好多朋友都在问我:“这东西怎么装?能在飞书里跑起来吗?”说实话,我刚开始翻它的文档也是一脸懵——一会儿 Node.js,一会儿 Git,还要调 PowerShell 权限、配置飞书回调地址……头都大了。不过折腾几轮之后我发现,只要把坑提前踩明白,整个过程其实比想象中顺畅得多。

今天我就把自己在 Windows 10 上从零开始部署 OpenClaw,并且成功接入飞书的完整过程整理出来,全部是实操经验,连“为什么卡在这一步”的踩坑细节我都给你标清楚。就算你是第一次打开命令行的纯小白,按着步骤走也能跑起来。

先来点干货:你得准备点啥?

别急着动手,先看看你的电脑能不能满足这些基础条件:

操作系统:Windows 10 或 11(必须是 64 位),我测试用的是 Win10 专业版 22H2

内存:至少 4GB,推荐 8GB 以上(OpenClaw 跑起来会占一些内存)

磁盘空间:预留 2GB 以上的空闲空间(C 盘别塞太满)

网络:能正常访问 GitHub 和 Node.js 官网,最好有稳定的网络(国内用户下载可能需要耐心等一会儿)

除此之外,你还需要准备以下两个东西:

第一步:装好基础环境(Node.js + Git)

OpenClaw 是基于 Node.js 开发的,所以第一步必须装好它。

1. 安装 Node.js

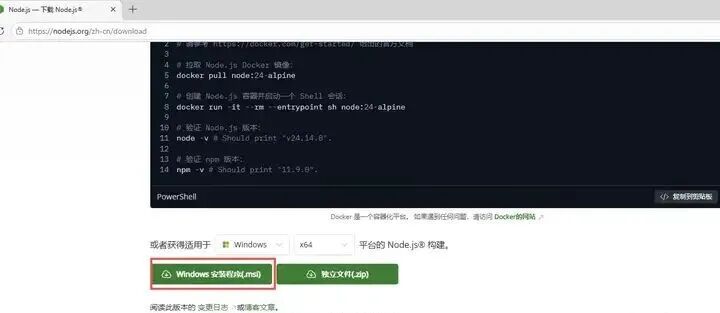

打开 Node.js 官网 1,点击绿色的 “Windows Installer (.msi)” 下载安装包(推荐 LTS 版或最新版,目前我用的是 v24.13.0)。

安装时最关键的一点:✅ 务必勾选 “Add to PATH” 和 “Automatically install the necessary tools” 这两个选项决定了后面能不能顺利运行命令。其他一路默认下一步就行。

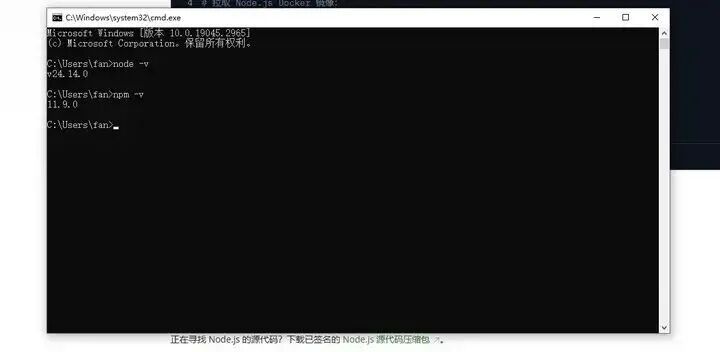

装完后,打开 PowerShell(以管理员身份运行),输入:

node-vnpm-v

如果看到类似 v24.13.0 和 10.5.0 的版本号,说明装好了。

⚠️ 注意:有些老教程说用 Node.js 18 或 20,但实测 OpenClaw 最新版(2026.3)在 Node 24 上最稳,低于 22 可能直接报错。

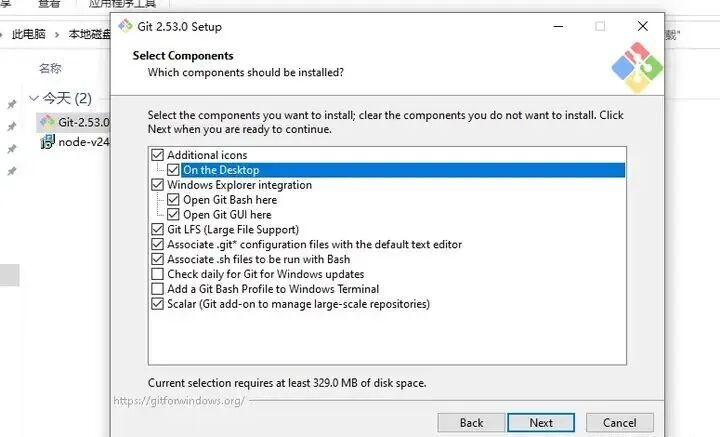

2. 安装 Git

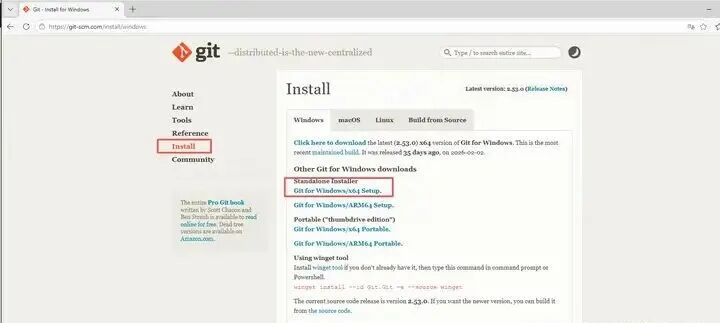

去 Git 官网 2 下载安装包。国内网速慢是常态,耐心等。

一路下一步

安装过程中,在 “Adjusting your PATH environment” 这一步,选择:

Git from the command line and also from 3rd-party software

这样 PowerShell 才能识别 git 命令。

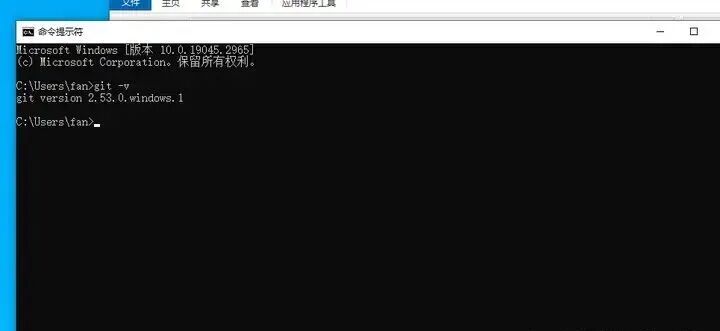

装完同样验证一下:

git--version

看到版本号就 OK。

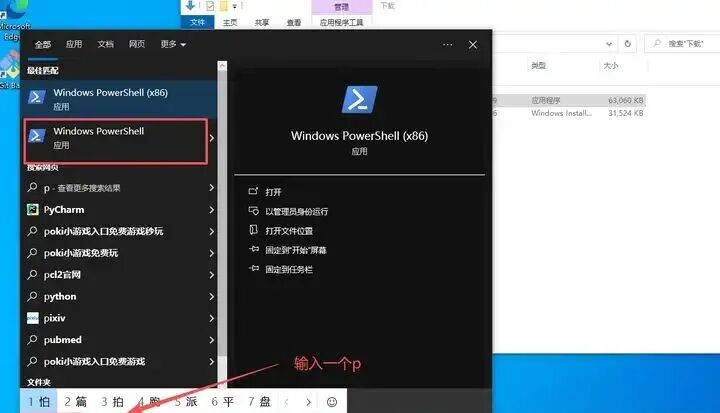

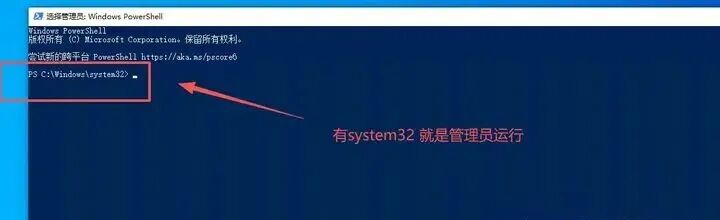

第二步:解除 PowerShell 脚本限制

Windows 默认禁止执行远程脚本,所以我们得先放行。

在 管理员权限的 PowerShell 中执行:

Set-ExecutionPolicyRemoteSigned-ScopeCurrentUserSet-ExecutionPolicy-ScopeProcess-ExecutionPolicyBypass

系统会问你是否确认,输入 Y 回车就行。

这一步做完,后面才能顺利运行安装脚本。

第三步:安装 OpenClaw

现在主角登场。

iwr -useb https://openclaw.ai/install.ps1 | iex

装完后验证:

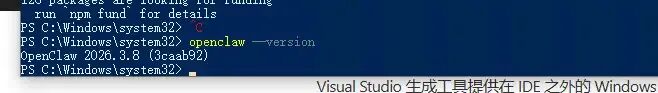

openclaw--version

看到版本号(比如 2026.3.8)就说明成功了。

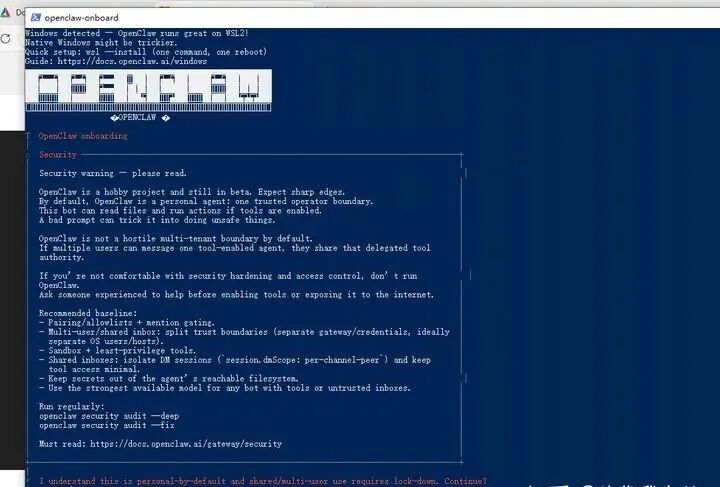

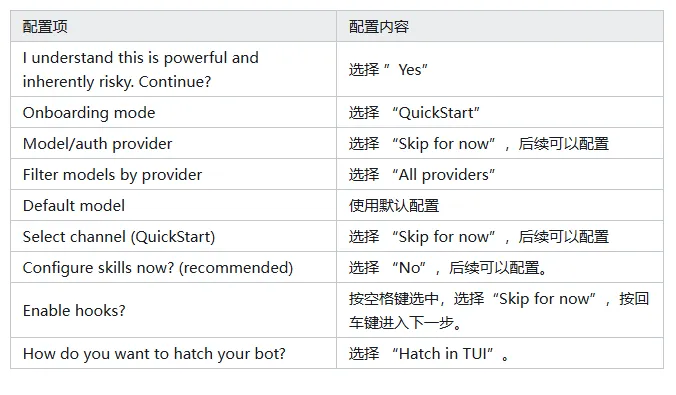

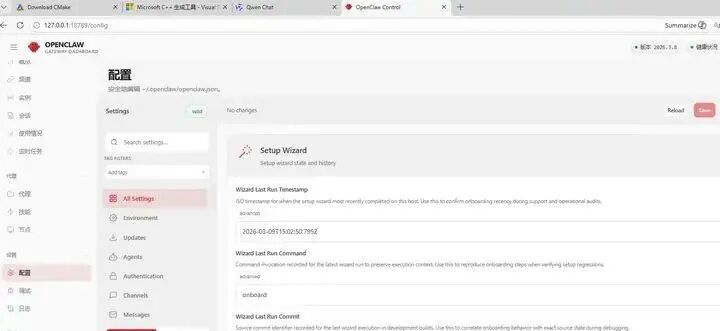

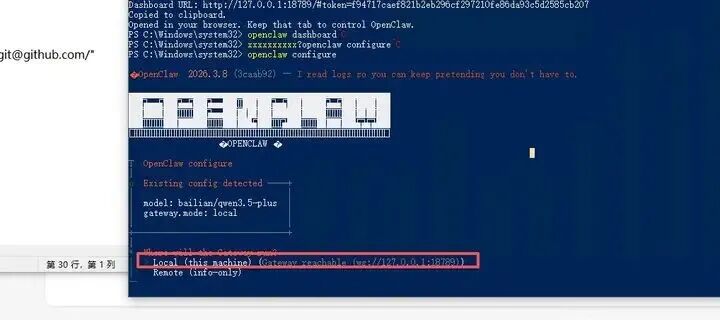

第四步:首次配置(关键!选 QuickStart)

接下来运行配置向导:

openclawonboard--install-daemon

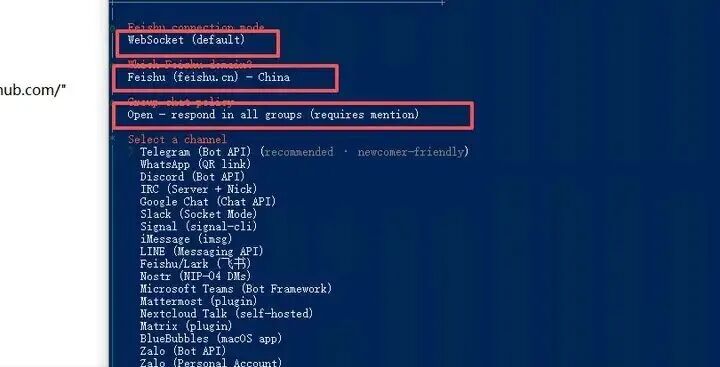

这里有几个选择,务必按我说的选,不然容易翻车:

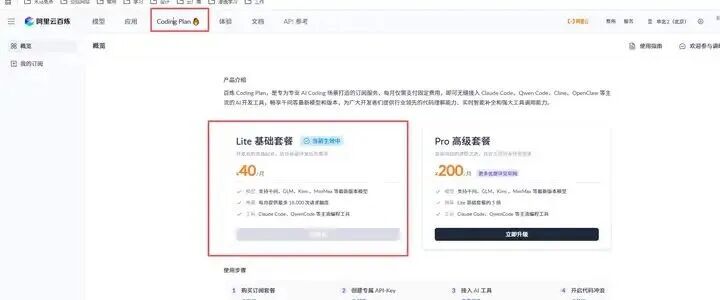

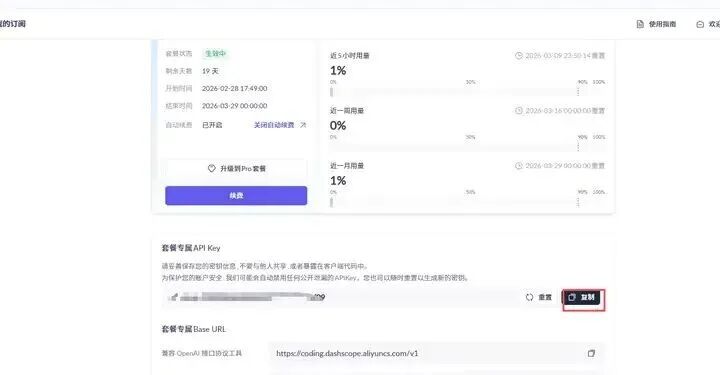

注册阿里百炼

1、打开网址:大模型服务平台百炼控制台

2、登录账号

3、订阅基础套餐,首月7块

开始配置龙虾

- 复制以下内容到Raw JSONS输入框,替换已有内容。若需保留已有配置,请勿直接全量替换,详见已有配置如何安全修改?

- 将

YOUR_API_KEY替换为Coding Plan 专属 API Key。{ "models": { "mode": "merge", "providers": { "bailian": { "baseUrl": "https://coding.dashscope.aliyuncs.com/v1", "apiKey": "YOUR_API_KEY", "api": "openai-completions", "models": [ { "id": "qwen3.5-plus", "name": "qwen3.5-plus", "reasoning": false, "input": ["text", "image"], "cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 }, "contextWindow": 1000000, "maxTokens": 65536 }, { "id": "qwen3-max-2026-01-23", "name": "qwen3-max-2026-01-23", "reasoning": false, "input": ["text"], "cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 }, "contextWindow": 262144, "maxTokens": 65536 }, { "id": "qwen3-coder-next", "name": "qwen3-coder-next", "reasoning": false, "input": ["text"], "cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 }, "contextWindow": 262144, "maxTokens": 65536 }, { "id": "qwen3-coder-plus", "name": "qwen3-coder-plus", "reasoning": false, "input": ["text"], "cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 }, "contextWindow": 1000000, "maxTokens": 65536 }, { "id": "MiniMax-M2.5", "name": "MiniMax-M2.5", "reasoning": false, "input": ["text"], "cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 }, "contextWindow": 196608, "maxTokens": 32768 }, { "id": "glm-5", "name": "glm-5", "reasoning": false, "input": ["text"], "cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 }, "contextWindow": 202752, "maxTokens": 16384 }, { "id": "glm-4.7", "name": "glm-4.7", "reasoning": false, "input": ["text"], "cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 }, "contextWindow": 202752, "maxTokens": 16384 }, { "id": "kimi-k2.5", "name": "kimi-k2.5", "reasoning": false, "input": ["text", "image"], "cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 }, "contextWindow": 262144, "maxTokens": 32768 } ] } } }, "agents": { "defaults": { "model": { "primary": "bailian/qwen3.5-plus" }, "models": { "bailian/qwen3.5-plus": {}, "bailian/qwen3-max-2026-01-23": {}, "bailian/qwen3-coder-next": {}, "bailian/qwen3-coder-plus": {}, "bailian/MiniMax-M2.5": {}, "bailian/glm-5": {}, "bailian/glm-4.7": {}, "bailian/kimi-k2.5": {} } } }, "gateway": { "mode": "local" }}

切换模型:临时换还是永久换?这里都给你讲清楚

OpenClaw 支持灵活切换大模型,你可以针对当前对话临时换一个,也可以直接改配置,以后每次新会话都默认用你喜欢的那个。我两种方法都试过,下面一个个说。

在当前会话中临时切换模型(聊完就失效)

有时候我只是想临时试一下某个模型的效果,比如从默认模型换成 qwen3-coder-next 看看代码能力怎么样。这时候不需要改任何配置文件,直接在终端里操作就行。

操作步骤:

在终端输入 openclaw tui,进入 OpenClaw 的 TUI(文本用户界面)。

然后在 TUI 里输入命令:

(把 qwen3-coder-next换成你想试的模型名称就行)

如果界面上返回提示 model set to qwen3-coder-next,那就说明切换成功了。这个会话接下来的对话都会用这个模型,但等你退出 TUI 或者新开一个会话,又会回到默认模型。

这个方法特别适合测试不同模型的表现,用完即走,不影响全局设置。

永久切换默认模型(一劳永逸)

如果你已经找到了心仪的模型,希望每次新建会话都自动用它,那就需要动一下配置文件了。

这样设置之后,不管你是新开 TUI 会话,还是通过其他方式启动,默认都会用你指定的那个模型,省得每次手动输命令。

小提示: 如果你不确定模型名称怎么写,可以在 TUI 里用 /list models 命令看看当前可用的模型列表,复制粘贴最保险。

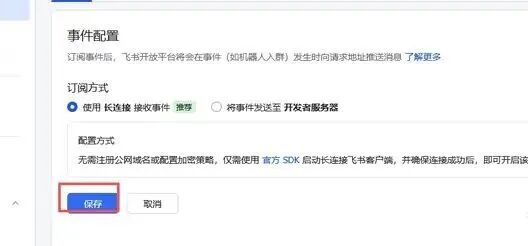

{ "agents": { "defaults": { "model": { "primary": "bailian/qwen3.5-plus" } } }}第五步:正式对接飞书(重点来了!)

现在我们来手动接入飞书。

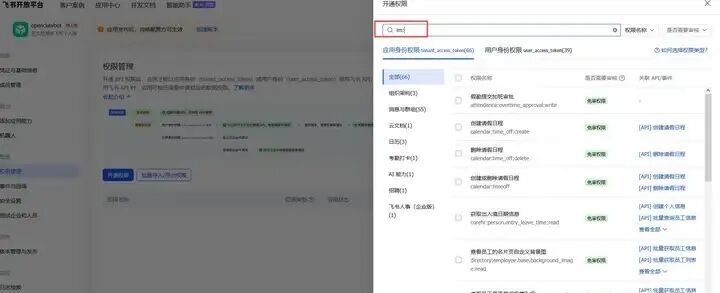

1. 在飞书开放平台创建应用

- 填写应用名称(比如 “我的 AI 助理”),上传个图标,确定

- 权限管理

im:messageim:resourcecontact:user.read

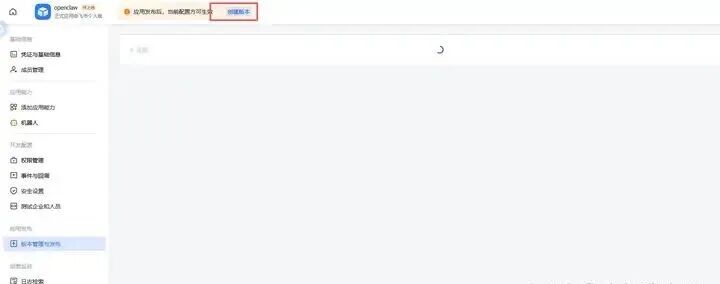

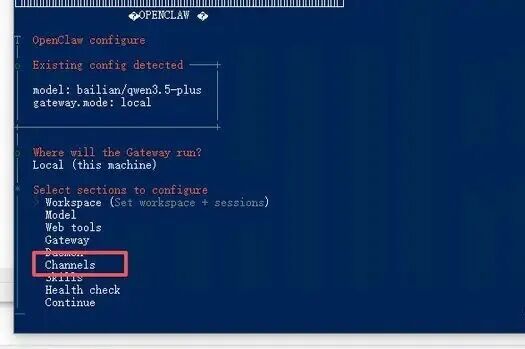

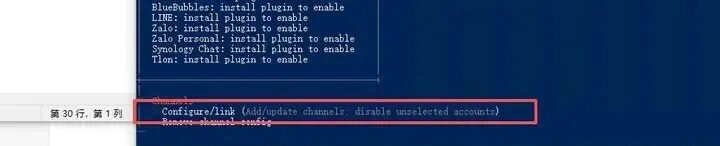

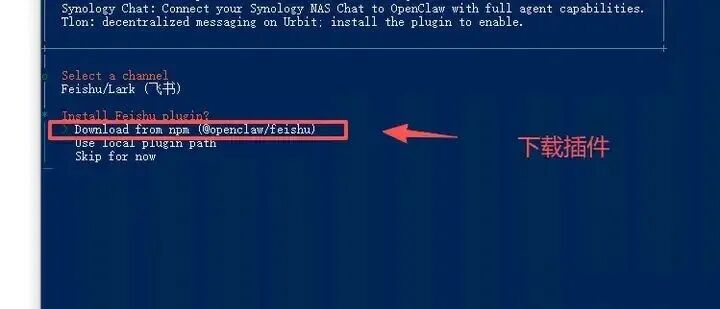

3. 在 OpenClaw 中添加飞书通道

回到 PowerShell,运行:

openclawconfigure

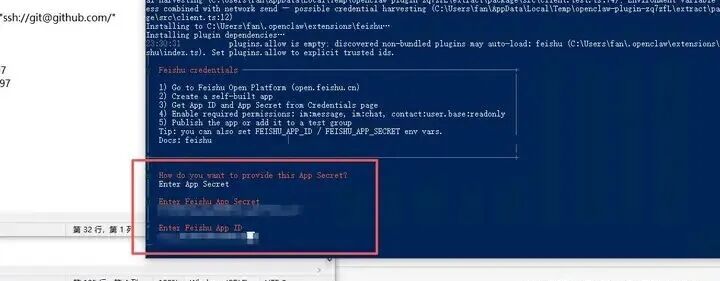

输入飞书的AppID,AppSecrect:

保存退出。

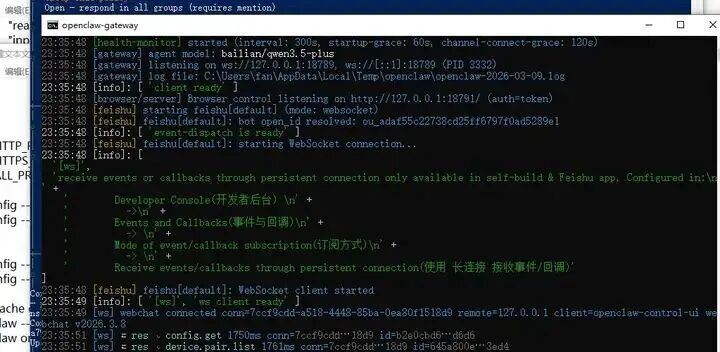

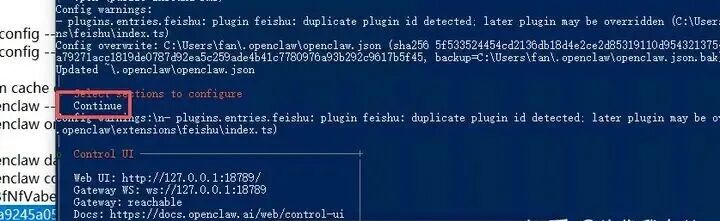

然后重启 OpenClaw 服务(或者直接关掉 Web UI 再重新运行 openclaw onboard)。

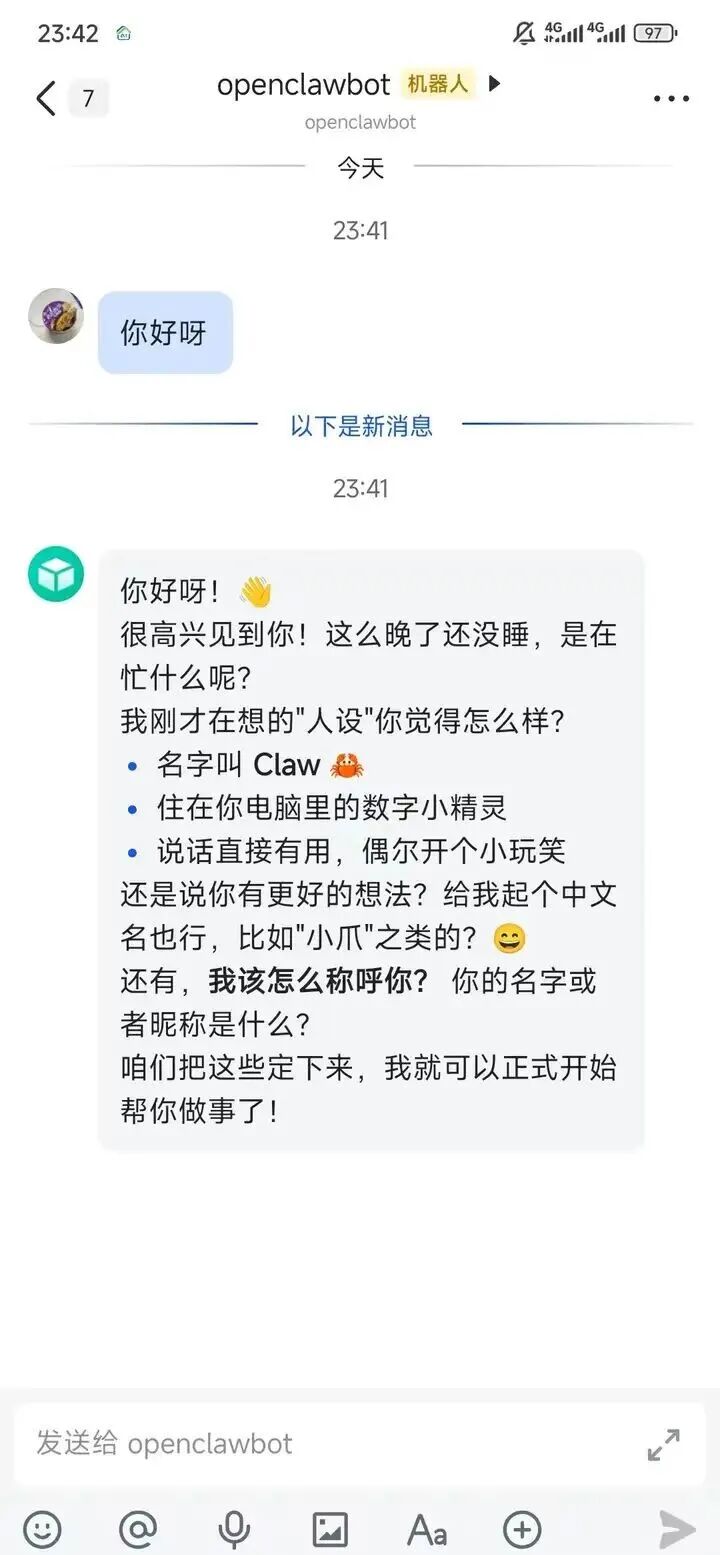

最后说两句真心话

OpenClaw 真不是个花架子,它确确实实能帮你干正事。上周我让它自动整理了过去三个月的会议纪要,粗略一算,至少省出五个小时。而且所有数据都老老实实留在你本地,不像某些云服务,指不定哪天就把你的信息“共享”出去了。

当然,它也有自己的边界——你得保持电脑开机,要依赖大模型 API(虽然便宜,但确实有点费用),而且操作电脑时需要你手动确认——这是设计上的谨慎,安全第一。但只要你心里有数,它就是你数字生活里的“贾维斯”,随叫随到。

如果你按这篇教程跑通了,别急着关,去给它装几个 Skill 玩玩,比如自动处理邮件、管理日程,玩法多着呢,绝对物超所值。

觉得这篇教程对你有帮助?别藏着掖着,转发给那个老喊“AI太难搞”的同事,让他也体验一把什么叫“一句话搞定”。

关注我,咱们一起折腾更多硬核又实用的运维/AI 工具。

股权架构设计,创始人、合伙人、核心员工、投资人分别有哪些侧重点?

本质上的诉求是控制权,所以在早期做股权架构设计的时候必须考虑到创始人控制权,有一个相对较大的股权(一般建议是合伙人平均持股比例的2-4倍)。

合伙人/联合创始人作为创始人的追随者,基于合伙理念价值观必须是高度一致。合伙人作为公司的所有者之一,希望在公司有一定的参与权和话语权。所以,早期必须拿出一部分股权来均分(这部分股权基本上占到8%-15%)。

他们的诉求是分红权,核心员工在公司高速发展阶段起到至关重要的作用,在早期做股权架构设计的时候需要把这部分股权预留出来,等公司处于快速发展阶段的期权就能真正意义派上用场(通常建议初次分配完之后同比例稀释预留10%-25%)。

投资人追求高净值回报,对于优质项目他们的诉求是快速进入和快速退出,所以在一定程度上说,投资人要求的优先清算权和优先认购权是非常合理的诉求,创始团队在面临这些诉求的时候,一定程度上还是需要理解。

股权是多种股东权利的集合体(投票权、分红权、知情权、经营决策权、选举权、优先受让权、优先认购权、转让权等),其中,表现最为重要的是股票权和分红权。

在人力资本驱动的创业时代,我们要思考的不仅仅是股权比例的问题,而是围绕着股权做体系化设计。

夜雨聆风

夜雨聆风