核心结论:当前最顶尖的大模型已经能在奥林匹克竞赛题、医学考试、法律资格测试中取得令人咋舌的高分。然而,在真实企业文档推理任务上,准确率不足 45%。面对最难的一批问题,准确率更跌破 25%。

学术基准 ≠ 企业就绪。OfficeQA 是 Databricks 专门设计的一个聚焦「接地气」推理(Grounded Reasoning)的开源基准测试。

https://github.com/databricks/officeqa

Databricks 采用美国财政部公报作为测试语料库,这批文档完美复刻了企业私有文档库的各类麻烦:

•跨越数十年的历史档案,早期版本为纸质扫描件

•包含大量复杂嵌套表格、合并单元格和非标准格式

•数据密集,包含超过 2,600 万个数值

•既有非结构化文本,又有大量表格数字,混合程度高

•公开可获取,确保评测透明、可复现

与此同时,Databricks 过滤掉了所有大模型依靠「自身记忆」或网络搜索就能回答的问题——必须真正检索文档,才能得到正确答案。

OfficeQA 的题目设计有三条核心原则:

•不考验专业壁垒(无需博士级别领域知识),而是考验精准度与细心度

•每题只有唯一正确答案,可被程序自动验证,无需人工判卷

•真实反映企业日常任务:文档检索 → 信息聚合 → 数值计算

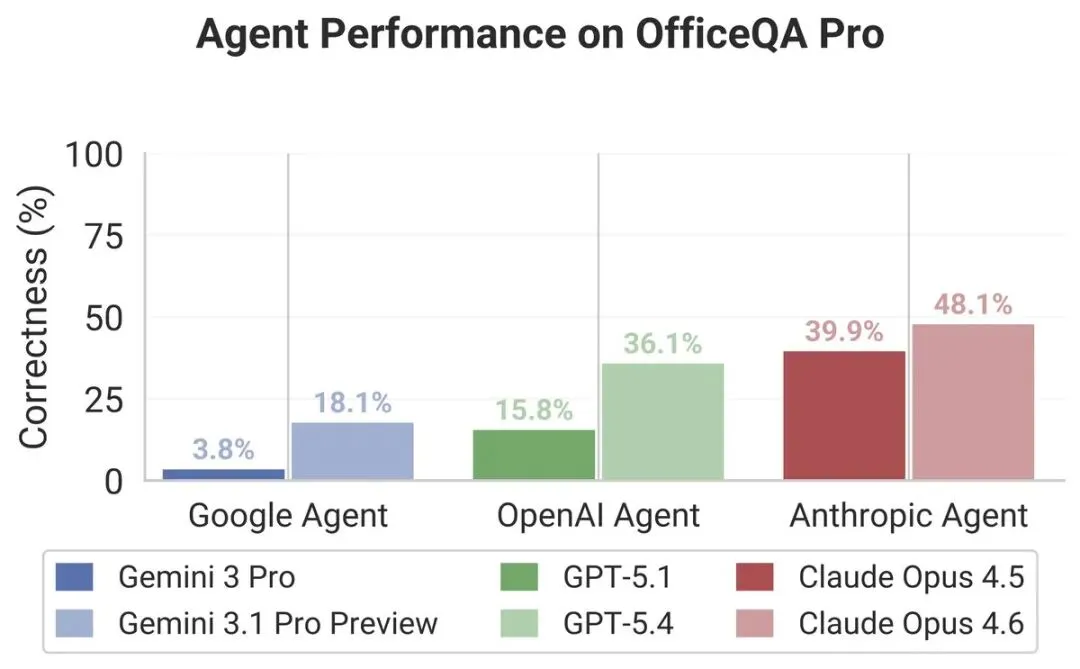

基准测试成绩总览

测试对象 | 全题准确率 | Hard 难度准确率 |

无文档(纯参数记忆) | ~2% | ~2% |

GPT-5.1 Agent(File Search) | 43.5% | <25% |

Claude Opus 4.5 Agent(SDK) | 37.4% | <25% |

加入 ai_parse_document 后(最强) | <70% | ~40% |

一句话总结:即便是当前最强的 Agent + 最顶尖的文档解析工具,面对这份基准仍然在 30%+ 的题目上答错。

Databricks 在评测过程中归纳了几类典型的 AI 失败模式:

•PDF 解析错误:复杂表格的合并单元格、嵌套列头会导致数值「串行」,被归到错误的列

•检索时间粒度混淆:将「财年」数据错当「日历年」数据,一个搞错,后续所有计算全部崩溃

•答案歧义处理不当:财务文档中同一数字有时存在不同口径的修订版本

•图表推理能力缺失:约 3% 的题目需要解读图表,几乎所有 Agent 都在此类题目上完全失败

这个测试对 AI 从业者的启示:

1. 学术基准高分 ≠ 业务价值

这是 OfficeQA 最直接的警示。企业在选型 AI 系统时,不能只看模型在 MMLU、HumanEval 等学术榜单上的排名,而应当用贴近自身业务场景的测试来验证实际能力。

2. 文档解析仍是 AI 落地的关键瓶颈

评测数据显示,当加入专业文档解析工具(ai_parse_document)后,准确率有显著提升。这意味着「从 PDF 中正确提取信息」本身就是一个尚未被充分解决的工程问题,而不是 LLM 推理层面的问题。

3. 可验证答案是 RL 训练的金矿

OfficeQA 的题目设计(唯一数字答案、自动评分)使其天然适合用于强化学习训练数据。这与 DeepMind 用棋局胜负、OpenAI 用代码执行结果来训练模型的思路一脉相承。

4. 图表理解是下一个主战场

3% 的题目因涉及图表而让所有 Agent 全军覆没——比例虽小,但在真实企业场景中,数据可视化无处不在。这是一个被严重低估的能力缺口。

总结

OfficeQA 的意义不仅在于「又一个AI 基准」,而在于它戳破了一个普遍存在的幻觉:AI 能考高分,不代表 AI 能干活。

Databricks 用这份开源基准告诉行业:

•真实企业文档中的推理,远比我们想象的更难

•文档解析质量是当前 AI 落地的主要瓶颈之一

•可验证的评测机制,是推动 AI 进步的重要基础设施

夜雨聆风

夜雨聆风