零成本、零门槛、本地养(OpenClaw龙虾)-告别 API 费用Ubuntu系统完整教程

想拥有一个完全免费、私有、听你指挥的AI助手吗?今天,就手把手教你如何在Ubuntu系统上,用一台旧电脑就能本地部署强大的AI智能体框架——OpenClaw,并让它成为你的飞书聊天机器人,彻底告别API调用费用!

核心方案:我们将通过 Ollama 本地运行大语言模型,让 OpenClaw 作为“大脑”来调用,实现完全离线的AI智能体环境。

温馨提示:本教程旨在熟悉OpenClaw部署流程。使用纯CPU运行推理速度会较慢,请将其视为一个完美的练手项目,重在过程而非速度。

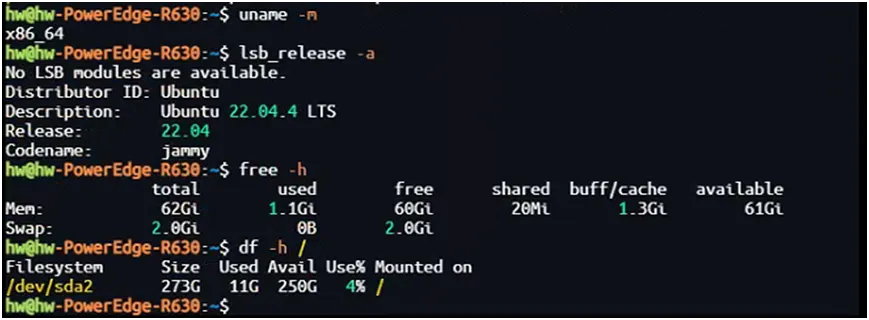

第一步:搭建基础环境

首先,确保你的Ubuntu系统已就绪,并安装以下核心工具。

1. 安装系统工具

打开终端,执行以下命令更新系统并安装必要工具:

sudo apt updatesudo apt install -y curl git2. 安装Node.js

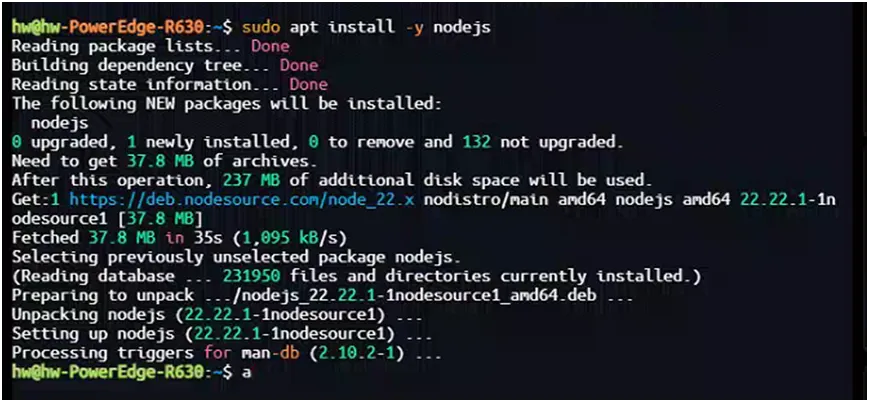

OpenClaw依赖于Node.js,请安装v22或更高版本:

sudo apt install -y nodejs

安装后,可通过

node -v

git --version

命令验证安装是否成功。

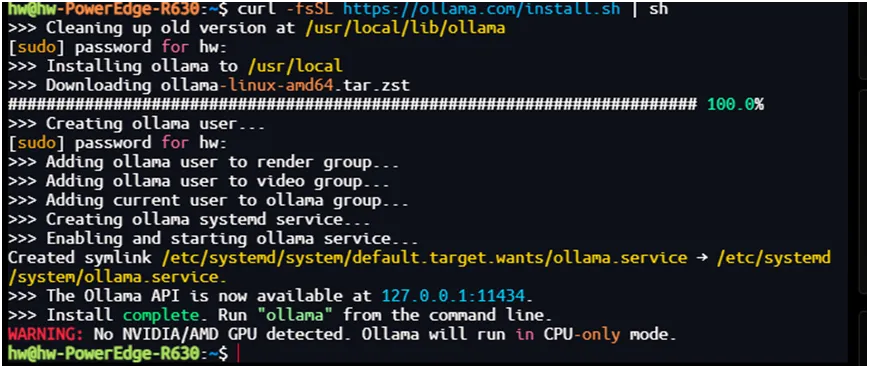

第二步:部署AI模型引擎 (Ollama)

我们将使用Ollama在本地托管大模型。

1. 一键安装Ollama

curl -fsSL https://ollama.com/install.sh | sh2. 启动并设置开机自启

sudo systemctl start ollamasudo systemctl enable ollama可使用 ollama --version验证安装。

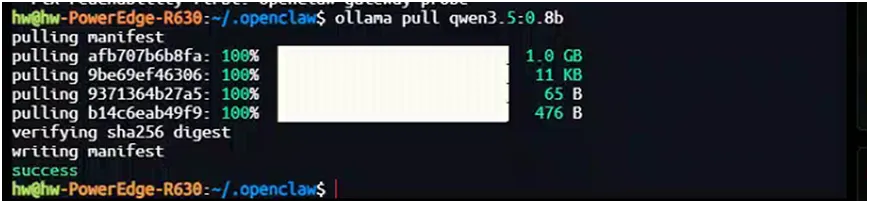

3. 拉取一个轻量级模型

为了快速体验,我们先拉取一个超小模型:

ollama pull qwen3.5:0.8b

第三步:安装与配置OpenClaw

1. 一键安装OpenClaw

运行官方安装脚本:

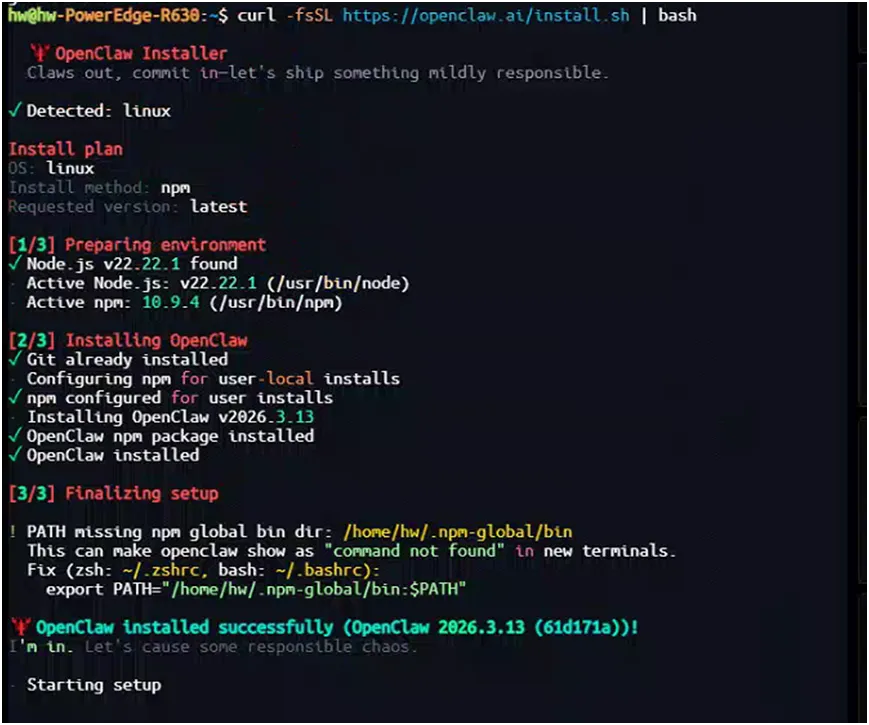

curl -fsSL https://openclaw.ai/install.sh | bash

2. 运行初始化向导

这是配置AI的关键一步,请执行:

opendaw onboard在出现的配置向导中,请遵循以下选择:

启动方式:选择

QuickStart。

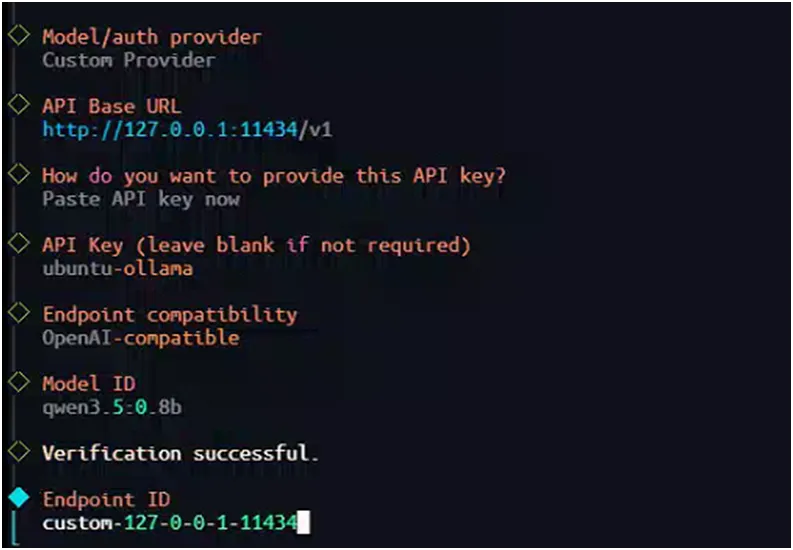

模型提供商 (Model/auth provider):选择

Custom Provider。API Base URL:

输入

http://127.0.0.1:11434/v1API Key:可输入任意字符,例如

ollama。端点兼容性 (Endpoint compatibility):选择

OpenAI-compatible。模型ID (Model ID):输入你拉取的模型,例如

qwen3.5:0.8b。后续关于搜索提供商、技能、钩子等选项,新手均可选择

Skip for now或No暂时跳过。

看到“配置成功”的提示,说明AI大脑已就位。

第四步:连接飞书,让AI为你打工

配置飞书机器人,即可在飞书App里直接与你的私人AI对话。

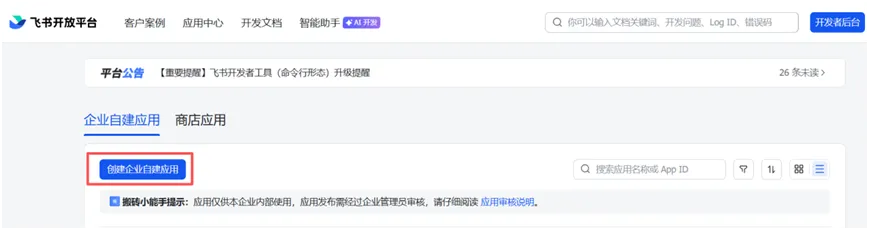

1. 创建飞书自建应用

访问 飞书开放平台,创建“企业自建应用”。

填写机器人名称等基本信息,创建后记下

APPID。

2. 配置应用权限与事件

在“权限管理”中,搜索并开通

im:message相关的所有权限。在“事件订阅”中,订阅

接收消息事件,并选择“使用长连接接收事件”。

完成配置后,务必“发布版本”并申请上线。

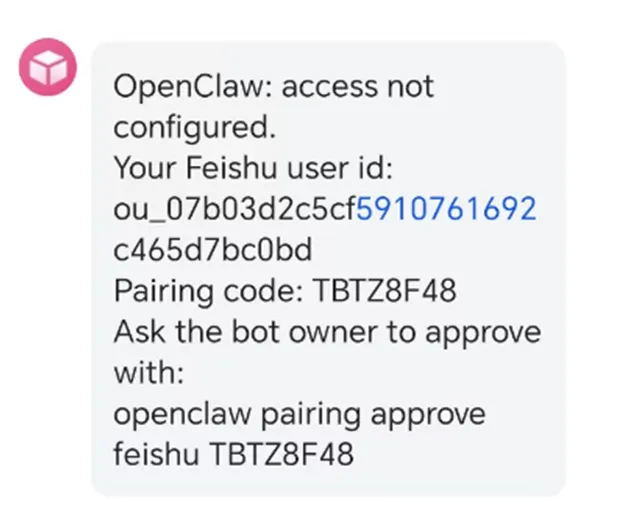

3. 在飞书中绑定与授权

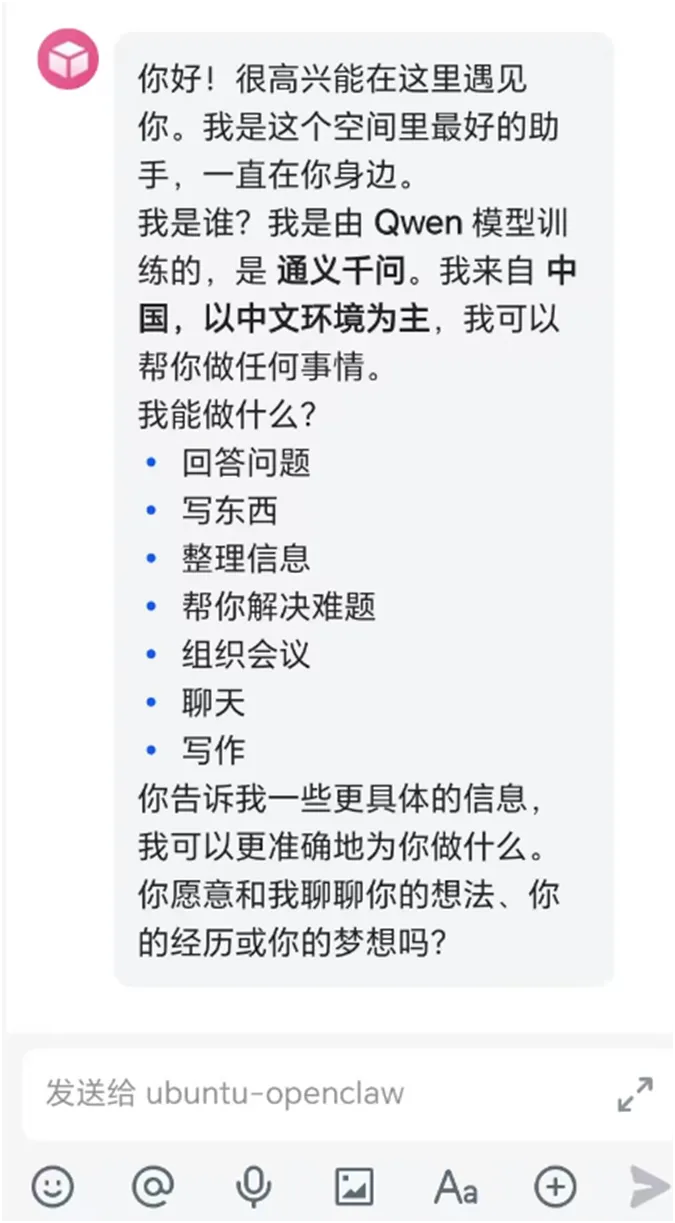

在飞书中与你的机器人对话,例如发送“你好”。

机器人会回复一条包含 配对码 (Pairing code) 的提示,例如:

TBTZ8F48。回到Ubuntu终端,执行以下命令完成授权:

opendaw pairing approve feishu TBTZ8F48 # 请将TBTZ8F48替换为你的配对码大功告成! 现在,你已可以在飞书里直接指挥你的本地AI助手执行任务了。

写在最后

通过以上四步,你已经成功搭建了一个私有的、免费的AI智能体环境。OpenClaw的强大之处在于其可扩展性,未来你可以为它安装各种Skill(技能)。

附录:一键卸载

如果你想清空所有OpenClaw组件(网关、配置、工作区),可使用以下命令:

opendaw uninstall --all --yes

夜雨聆风

夜雨聆风