最近总有人问我:「你那个 AI 助手到底是怎么搞的?每天自动给你推信息摘要,还能帮你写文章、管选题?」朋友圈刷到别人用 Agent 自动化了整个工作流,你连 Agent 是什么都不太确定。这种「别人都在用了,就我还不知道」的焦虑感,有个专门的名字——FOMO(Fear of Missing Out,错失恐惧)。2026 年了,做技术的谁没有点 FOMO?

所以今天这篇文章,我不讲概念、不画大饼,就老老实实记录一下:过去 30 天,我是怎么让一个 AI Agent 一步步接管我的日常工作的。踩了哪些坑、得到了什么结果、有哪些你可以直接复用的经验——全部摊开讲。这也是「AI 实操」系列的第一篇,后续还会有更多真实场景的拆解。

我也一样。作为一个程序员,我的 FOMO 甚至更严重——AI 前沿、系统架构、技术管理,每天几十个信息源涌进来几百条新内容。那个未读数字简直是精神污染,越积越多,越多越焦虑,越焦虑越不想打开。更让人崩溃的是,我明明知道怎么解决:写个脚本自动抓取、做个推送、搞个定时任务——每一步都不难,对吧?但你猜怎么着?我从来没真正做到过。

写了一天脚本,接了 RSS 解析、做了内容筛选,然后想到后面还得搞定时任务、弄推送渠道、处理各种边界 case……算了吧,关掉编辑器,假装这事儿没发生过。这就是自动化悖论:你明明知道怎么做,但做这件事的成本比手动干还高。不管你是程序员想写个脚本,还是运营想搭个自动化流程,又或者只是想让 AI 帮你每天盯着几个信息源——想法都很好,但真正落地的寥寥无几。

直到有一天,我遇到了 OpenClaw——然后我发现,最好的自动化,可能根本不需要你写代码。

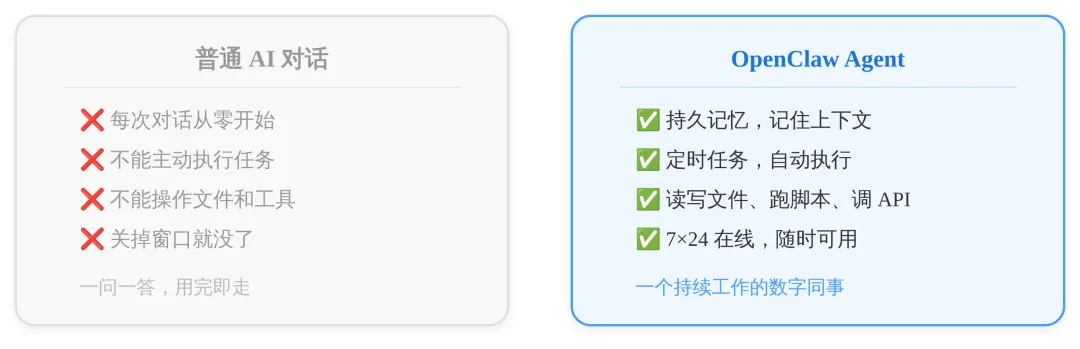

OpenClaw 是一个开源的 AI Agent 框架。我知道你可能会想:"又一个 AI 工具?跟 ChatGPT 有啥区别?"说实话,这俩的差别就像"打电话问一个专家"和"雇一个全职员工"的区别。ChatGPT 你问一句它答一句,关掉窗口啥都没了;OpenClaw 不一样,它是真的住在你服务器上的:

· 有记忆——你上周跟它说过的事儿,今天它还记得,不用每次从头解释一遍背景

· 能主动干活——你可以给它安排定时任务,它自己执行完了给你发报告,不用你盯着

· 能操作工具——读写文件、跑脚本、调 API,不是只会动嘴皮子

· 随时在线——部署在服务器上 7×24 小时运行,你睡觉它还在干活

说白了,它不是一个你去找它聊天的窗口,而是一个可以替你持续工作的数字同事。

而且最关键的是——它自带记忆系统和定时任务框架。这意味着什么?意味着那些我以前"写了一半就放弃"的自动化想法,现在只需要用大白话告诉它,剩下的它自己搞定。需要写代码?它自己写。需要调试?它自己调。你只管提需求,它负责从想法到落地的全部过程。

我用 OpenClaw 做的第一件事特别简单:把我 RSS 阅读器里的订阅列表(就一个 OPML 文件)直接丢给它,然后跟它说——"这是我关注的方向:AI 前沿、系统架构、技术管理、个人成长。帮我把这些信息管起来。"

我当时想的是,它最多帮我定时抓取一下、做个汇总推送就不错了。但接下来发生的事让我直接惊了——它不仅接手了我的订阅列表,还自己去搜了一圈,帮我发现了大量我压根没覆盖到的高质量信息源。Netflix 的技术博客、Cloudflare 的工程日志、Stripe 的架构分享、Berkeley AI Lab 的研究动态……它按质量标了推荐等级(强烈推荐/推荐/可选),把我原来的 23 个源直接扩充到了 62 个,整整齐齐分成 9 个分类。甚至还加上了阮一峰的周刊和少数派这些中文源——你说它是不是比我自己还了解我需要什么?

整个过程,我没写一行代码,甚至没多打几个字。好的工具不会让你觉得"我在配置一个系统",而是让你觉得"我在跟一个靠谱的人交代事情"。

RSS 源搞定后,我随口跟它说了一句:"每半小时帮我抓一遍新文章,做个中文摘要推过来。"就这么一句话,它自己写了 Python 抓取脚本(用 feedparser),搭了一套已读管理系统(基于文章指纹去重,自动清理 30 天前的旧数据),然后按文章价值分成三档推送给我:

推过来的内容大概长这样:

📰 资讯速递 | 2026-03-14

🔥 今日看点 OpenAI 发布 GPT-5 Turbo,上下文窗口扩展到 1M tokens,推理速度提升 40%……

🔬 AI Research & Engineering 📌 伯克利团队提出新的 RLHF 替代方案 — 用 Constitutional AI 思路替代人工标注……

💡 ProductHunt: 又一个 AI 写作工具,支持多语言

全中文,不用翻译,开会前扫一眼就知道今天技术圈发生了什么。高价值的内容给你 100 多字的详细摘要,中等价值的浓缩成一两句核心信息,一般的就一句话带过。这种信息密度,手动做的话你得花一两个小时翻几十个网站——现在 3 分钟搞定。

说实话,第一版摘要做得不太行——信息密度太低,"读了又好像没读",那种感觉你懂吧?我就跟它说:"摘要太水了,重要的文章要多给点细节,不重要的别占那么大篇幅。"然后它就自己把摘要结构从简单的列表升级成了三层架构:今日看点(同一事件的多源报道自动合并)→ 分类速读(带具体数据和核心论点)→ 快速扫描。

中间还修了一些我都没注意到的 bug:有些 RSS 源的文章链接藏在 externalURL 字段而不是 url 里,导致点进去是错的页面;还有部分英文文章忘了翻译就直接推过来了。这些问题我只说了一句"这里好像不对",它就自己去查数据库结构、改抓取脚本、跑测试验证。Debug 这件事,从"我来排查"变成了"我来反馈"。

现在我彻底没有 RSS 阅读焦虑了。每天花 3 分钟扫一遍推送,就知道我关注的所有领域发生了什么。遇到想深读的文章,丢给另一个专门的阅读 Agent,帮我拆解要点、关联到我当前的工作上下文。所有对话历史都留着,想搜之前读过的某篇文章直接搜就行。最重要的是——信息流入、阅读、讨论全在同一个地方,不用在五六个 App 之间来回跳。

真正解决信息过载的方式不是"少看",而是让信息主动找到你,以你消化得了的密度。(关于 RSS 信息流的具体配置方法和 prompt 调优技巧,后续会单独写一篇详细教程。)

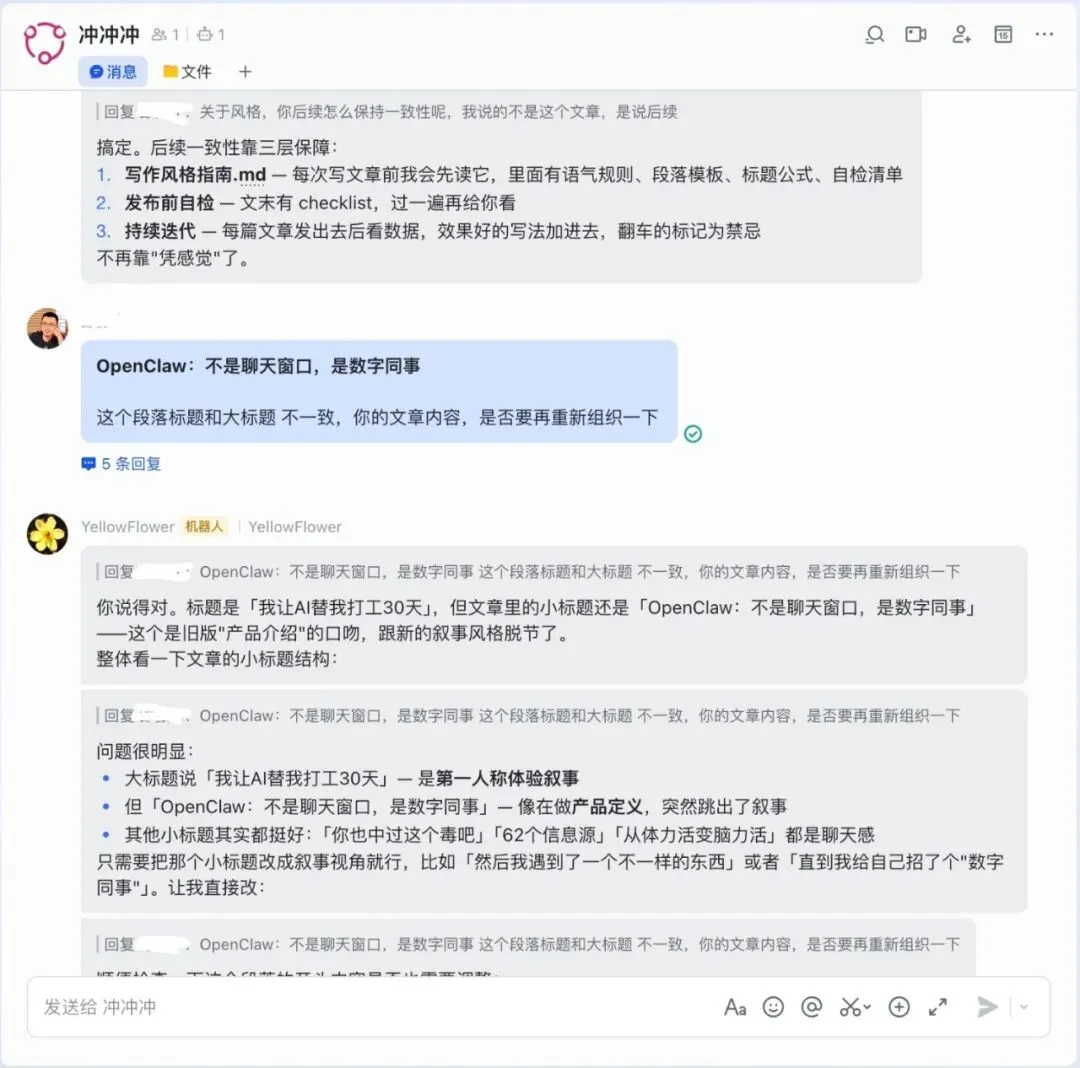

说起来你可能不信,以前写一篇公众号文章有多折腾——先是想到一个选题,赶紧记在手机备忘录里(还经常忘记记),然后翻收藏夹找素材、搜文章、整理笔记,接着写初稿、跑数据、做配图、反反复复改三四遍,最后发出去看看数据……但看完数据然后呢?也没有系统性的复盘,下一篇又是从零开始的循环。一篇文章花大半天,产出效率低得令人发指。

现在 OpenClaw 帮我接管了大部分运营工作,真正让我从体力劳动中解放出来:

选题管理——以前灵感来了就慌忙记在各种地方,最后哪儿也找不到。现在我有想法就随口跟它说一句,它自动帮我归档分类、评估可行性。过几天问它"最近有啥能写的",它能立马列出来,还会根据历史数据表现给你建议哪个选题更有爆款潜力。再也不用维护什么选题 Excel 表格了。

方向把控——这个是真让我服气了。它帮我分析了所有已发文章的数据,直接发现了一个关键规律:实操性强、标题具体的 AI 工具类文章,数据远好于纯认知/思维类内容。就这一个洞察,直接改变了我后续的选题策略。你看,这种数据挖掘我自己也能做,但我就是一直没做——不是不会,是没有一个"人"推着你做。

内容生产——配图不用自己 P 了,审稿把关也交给它。它甚至帮我写了你正在读的这篇文章的初稿(没错,这很 meta)。我现在的角色从"从头到尾自己干"变成了"把关方向、打磨文字"——说白了,运营从灵感驱动变成了数据+体系驱动,从体力活变成了脑力活。(关于 AI 辅助写公众号的完整工作流,包括怎么让 AI 写出"有人味"的文章,下一篇会详细拆解。)

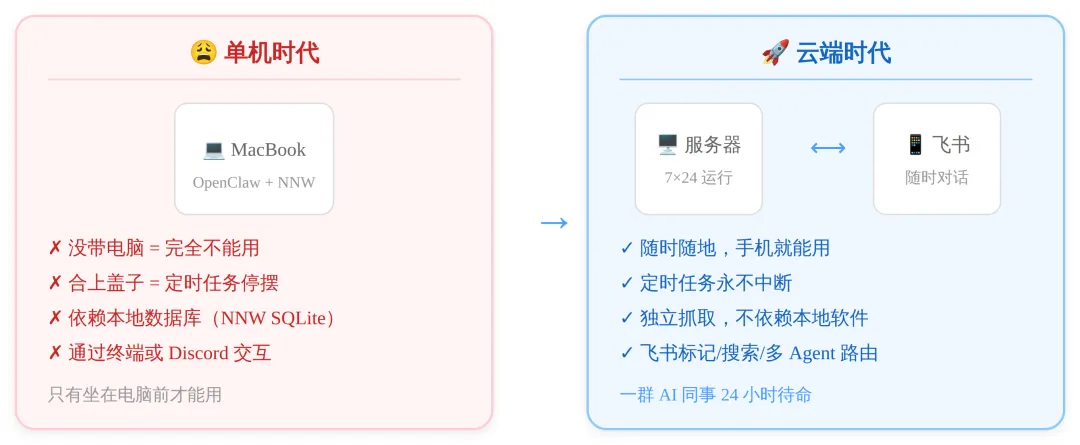

最早 OpenClaw 跑在我的 MacBook 上。坐在书桌前用着挺好,但很快两个致命问题就来了——第一,周末出门想到一个点子想跟它聊聊?不好意思,电脑没带。在外面看到一篇好文章想让它帮我分析?也不行。第二,更离谱的是,笔记本一合上盖子,所有定时任务全部停摆。RSS 摘要没了,提醒没了,那个"24 小时在线的数字同事"瞬间变成了"只在工位上班的临时工"。我当时就知道,这事儿不能这么干下去了。

解决方案很粗暴:买一台云服务器,把 OpenClaw 部署上去。迁移过程中最大的挑战是脱离本地依赖——原来的 RSS 抓取依赖 Mac 上 NetNewsWire 的本地 SQLite 数据库,现在服务器上没这个软件了怎么办?你猜怎么着,我跟 OpenClaw 说了一句"现在没有 NetNewsWire 了,你得自己抓",它就自己用 feedparser 重写了抓取脚本、迁移了订阅列表、搭建了新的已读管理机制。整个过程它自己搞定,我就在旁边看着,偶尔回答几个确认性的问题。让 AI 帮你做迁移,可能是它最被低估的能力。

服务器搞定后,下一个问题是:怎么跟它沟通?最早用的是网页终端,后来试过 Discord,最终定了飞书。选飞书不是因为什么技术信仰,纯粹是因为它最实用:

· 随时可用——手机上打开飞书就能跟 Agent 对话,不用开电脑连 SSH

· 消息管理——飞书有标记、收藏、搜索,比在终端里翻历史记录方便一万倍

· 多 Agent 路由——我有好几个 Agent(RSS 助手、阅读助理、公众号搭档等),每个绑一个飞书群,互不打扰

· 历史存档——所有聊天记录自动存在服务器上,随时可搜

现在我的状态是什么?我有一群 AI 同事在飞书里 7×24 小时待命。RSS 助手每半小时给我推信息摘要,阅读助理帮我深度拆解文章,公众号搭档帮我管选题和审稿。不管我在地铁上、在咖啡馆里、还是躺在床上——打开飞书就能找它们聊。工具应该适应你的生活节奏,而不是反过来。

用了几周下来,最大的感受不是"省了多少时间"——虽然确实省了很多。更深层的变化是:整个工作流变了。

第一,AI Agent 不是万能的,但它恰好擅长你最不擅长的事。那些重复的、有规则的、需要日复一日坚持执行的任务——说白了就是人类最容易偷懒放弃的事——恰好是 Agent 最擅长的。它不会忘记抓取、不会嫌烦、不会"今天心情不好就不做了"。你把这些事交给它,自己去做真正需要创造力的部分,这才是人机协作该有的样子。

第二,最好的自动化,是你不用写代码的自动化。作为程序员,我以前总觉得"自己写个脚本"是最高效的解决方案。但 OpenClaw 让我意识到——写代码本身只是 10% 的成本,后面还有部署、监控、异常处理、版本迭代这些"脚本之外的事"。当 Agent 能帮你处理这一切的时候,你才真正从重复劳动中解放出来。

第三,工具的终极形态是"你感觉不到它的存在"。现在我每天早上打开飞书,信息摘要已经躺在那里了;想到一个选题,随口一说就被记住了;要写文章,素材和大纲早就准备好了。整个过程毫无摩擦,就像有个靠谱的同事一直在默默帮你干活。而这,可能才是 AI Agent 最有魅力的地方。

这篇文章只是一个开头。接下来我会持续分享更多 AI Agent 的实操经验:

· RSS 信息流配置详解——怎么调出最适合你的摘要格式和推送节奏

· AI 写公众号的完整工作流——从选题到发布,怎么让 AI 写出"有人味"的文章

· 多 Agent 协作实录——我是怎么让 5 个 Agent 分工合作的

· 零基础部署教程——不写代码,从零搭建你自己的 AI 数字同事

关注「小郎碎碎念」,后续每一篇都是可以直接复用的实操干货,不讲概念不画大饼。

想现在就动手试试?

GitHub:https://github.com/openclaw/openclaw

文档:https://docs.openclaw.ai

夜雨聆风

夜雨聆风