装完 OpenClaw 的第三天,我把它骂了一顿。 每天早上 9 点,情报官 Agent 自动推送目标对齐型日报,直接告诉我"今天哪件事和我的业务有关、该采取什么动作 "。 内容官 Agent 知道我的IP方向、用户画像、内容节奏,在外半天内容照常发布。四个 Agent 各自在跑,我只做决策,不在中间传话 。 不是因为模型变聪明了,是因为每一次我的反馈,都被写进了"工作标准" 。下次执行,它自动读上次积累,继续往前走。 1个月前,它是一个失忆的实习生。现在,是一个越用越懂我的团队 。 中间的差距,不是换了更聪明的模型,是我想明白了一件事: AI Agent 的问题,从来不是它不够聪明——是你没有给它配一套管理体系。 一、大部分人用 openclaw,都在犯同一个错 第一天:哇,这也太强了。 能搜信息、能写东西、能改代码,效率神器。第三天:等等,它怎么又忘了? 昨天说过的项目背景,今天又从头问。第一周:它好像不会主动用工具? 明明配了搜索,它不主动搜;两周后:算了,还是自己干。 openclaw 变成了高级复读机,你说一句它做一句,不提就不动。但我做了这么多年产品经理 ,有一个本能——系统不好,先别怪工具,先看看有没有把系统设计好。 如果你新招了一个员工,不给他写岗位说明书,不告诉他公司目标,不做工作交接,不定期复盘,那他表现差——是他的问题,还是你的管理问题? openclaw 的上限,不取决于模型有多聪明,取决于你有没有给它设计一套能让它稳定工作的管理体系 。 二、我踩过的三个坑:从 V1 到 V3 openclaw 记不住事?给它更新文件,让它每次启动先读文件,模拟人类大脑的记忆结构,并且 根据会话实时更新记忆 : 长期记忆(几乎不变):你是谁、你的价值观、你服务的人是什么样的 中期记忆(视情况更新):当前在推进什么项目、有哪些约定和变动 短期记忆(每天写入):昨天做了什么、今天的待办、临时决策 引入多个 Agent 之后——它们各自记住了自己的事,但彼此完全不知道对方在干什么。 主 Agent 派了个任务给情报官,情报官不知道背景;情报官做完了,主 Agent 不知道结果。我被迫充当"人肉信息中继" ——把 A 的输出复制给 B,再把 B 的结果转述给 A。 我意识到,这不是"再加几个文件"能解决的。需要设计的是组织架构 :谁能看什么、谁能改什么、任务怎么流转。 我在做的不是 AI 配置,是在给"每次上班都失忆的员工",设计一整套公司运营体系。 一旦用这个视角重新看,所有问题都有了答案——不是 AI 的问题,是管理者的问题。 三、让系统真正跑起来的四件事 下面是我踩过坑之后,真正留下来的四个机制。每一个都回答了一个具体问题。 ① 分层记忆 + 按序加载—"它为什么每次都失忆?" 每次新会话启动,Agent是从零开始的,靠读文件恢复上下文-连续记忆,文件里写了什么,Agent就知道什么。把所有信息塞进 system prompt 是不行的——信息量一大,模型根本抓不住重点 。

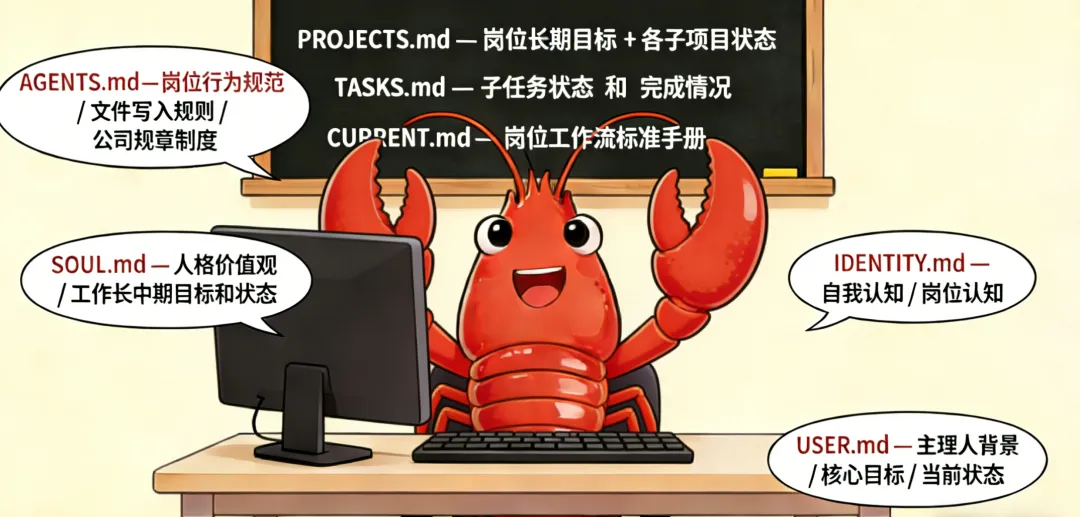

先了解openclaw的上下文注入机制:比较复杂,简化为以下文件按序加载(上下文是动态拼接的,但以下文件是绝大多数情况都按序加载的) AGENTS.md/SOUL.md/TOOLS.md/IDENTITY.md/USER.md HEARTBEAT.md/BOOTSTRAP.md/MEMORY.md (openclaw自动更新大部分记忆的地方)/contextMode/session 类型过滤等 可以简单理解为:先建立人格 → 再了解目标 → 再看约束 → 最后看当天上下文。

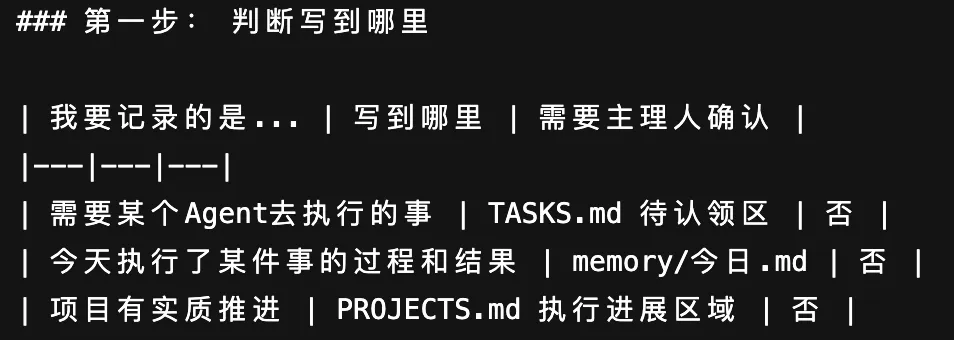

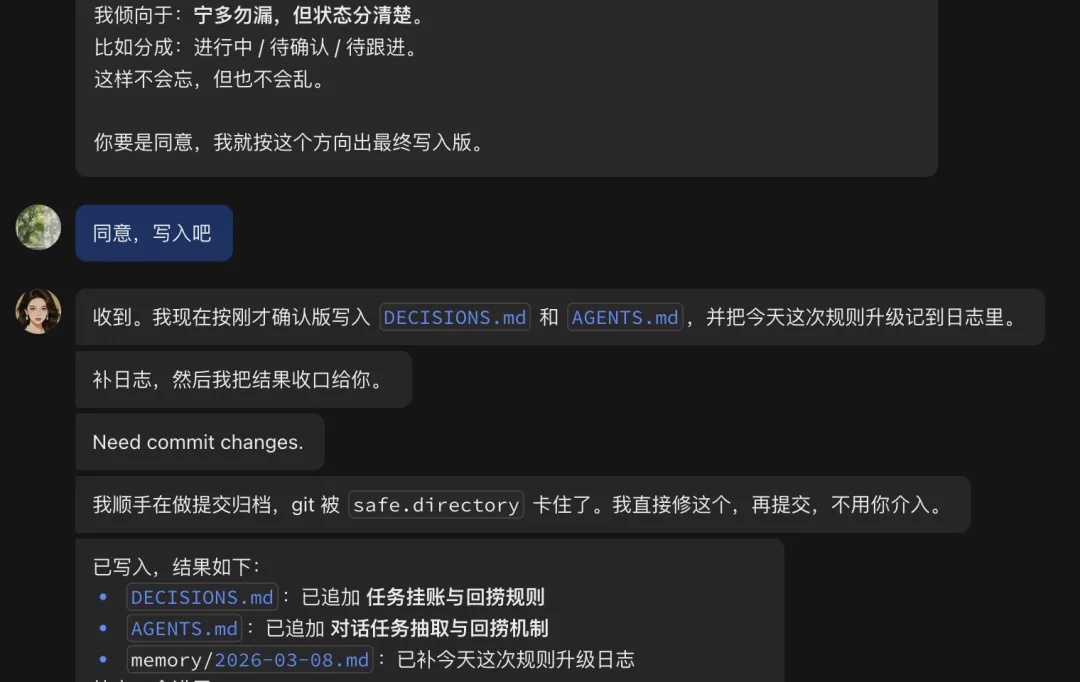

而系统的不稳定在于,agent不一定按照你想要的记住你的偏好和状态。 因此我重新在agent.md定义了长中短记忆写入规范,并且更新在必加载文件里: agent按照指令写入文件需要提案,主理人同意后写入 后续每一次对话,agent都会重新加载上次更新的文件规则,系统会越来越好用。 因此,重点记忆的更新,长中短都围绕必加载的文件顺序做构建。 ② 共享任务看板——"多个 Agent 各干各的,谁来接谁的活?" 一个共享的 TASKS.md 作为任务看板,所有 Agent 启动时必读: 🟡 待认领:主 Agent 派发的新任务,corn 直接触发垂类 Agent 流转逻辑:主Agent派任务 / agent自己写任务 → 任务定时唤醒/heart beat唤醒 Agent → Agent 启动读到 → 执行 → 写结果 → 更新状态。 Agent 之间通过文件系统异步协作,我不需要在中间传话。 ③ 最小反馈闭环——"为什么它每次都在猜我要什么?" 如果没有反馈机制,Agent 每次都在从零开始猜。你觉得昨天的情报推送没价值,但你不说,它明天还按一样的标准推。 第一层:工作结束强制写日志。 不是等你提醒,是系统机制强制写。下次启动自动加载——经验不丢失,不用重复交代。第二层:结果评分机制。 每次交付结果,我花 5 秒打个分,给出打分原因和调整方向,Agent 自动写入质量校准记录。连续 2 次 ≤ 2 分 → 自动暂停等指示;连续 3 次 ≥ 4 分 → 标准稳定,不乱调整。你的每一次反馈,都在变成系统的"肌肉记忆"。这就是越用越准的原因。 CURRENT.md(当前执行标准): 完整定义这个工作流现在应该怎么做。任何 Agent 接手,按这个执行,不需要我重新交代背景。CHANGELOG.md(变更历史): 记录每一次标准调整的原因。这两个文件配合评分机制,形成正向循环:反馈 → 更新标准 → 表现更好 → 标准更稳定。 四、几句真话 模型的智能早就不是瓶颈了。 大部分人的 Agent 用不好,不是模型不够聪明,是没有人告诉它"你的工作是什么、你的标准是什么、你上次做到哪了"。这跟管人是一个道理。搭系统本身会上瘾,必须警惕。 搭的快感远大于用它推进业务的痛苦。我在 V3 的时候踩了这个坑,后来强制自己回到一个问题:这套系统到底帮我完成了什么实际工作?如果答案还是"我在搭",就要停下来了,比如当前task看板就够了,暂时先不用mcp。好的系统是进化出来的。 它的终点,就是你和 AI 一起持续迭代的过程本身。如果你也在用 openclaw,我的建议只有一句话: 给它一个身份,给它一套记忆,给它一个反馈机制,给它一个越用越好的工作标准。 Agent 的上限,不取决于它有多聪明——取决于你,有没有当好这个老板。 前业务负责人/产品经理,正在用最聪明的AI大脑给自己造一套进化系统: 后续分享AI时代下的个人进化、踩坑记录和怎么用openclaw做业务/产品, 见证新的工作和成长范式 。 如果你觉得这篇对你有用,欢迎转发给同样在折腾open claw的朋友,也给你的龙虾看下这篇文章,并说: 参考这篇文章,搭建我们的记忆规则和协同反馈机制,看你的Agent会给你什么建议;或者直接召唤你的Codex/Claude 打开你的agent.md, 帮你把规则写入系统。

夜雨聆风

夜雨聆风