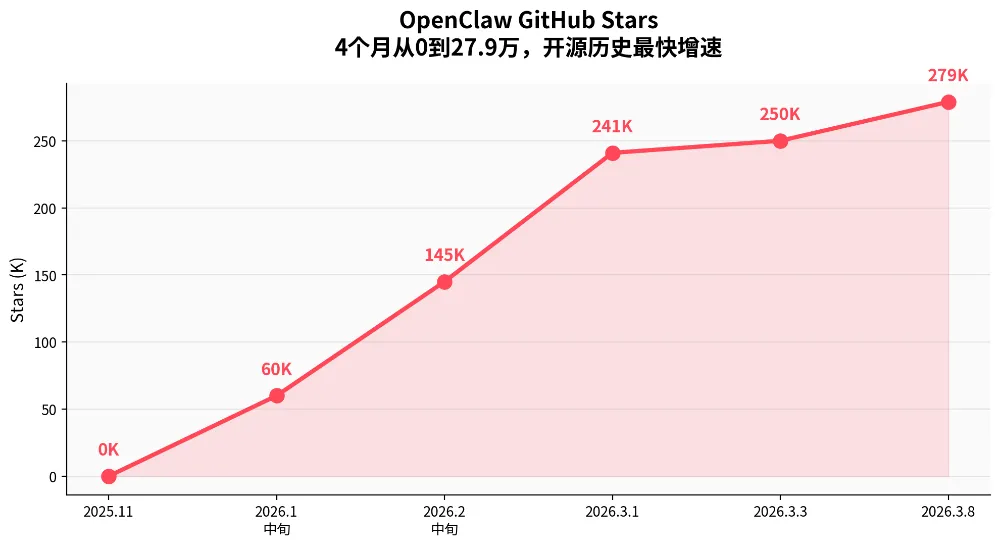

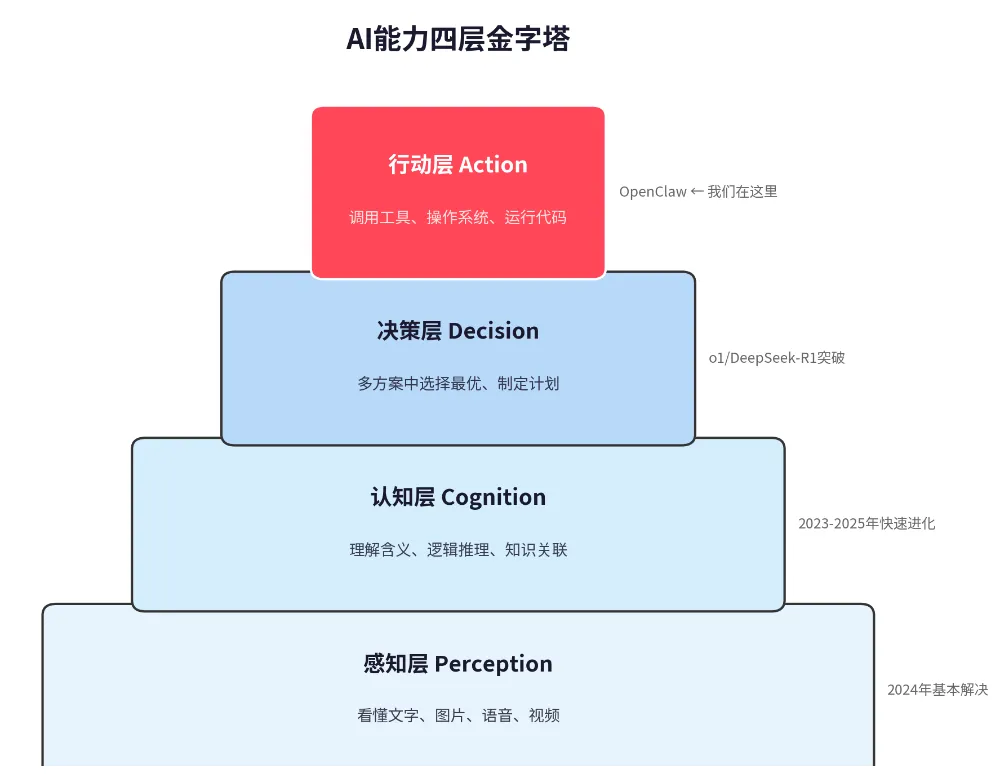

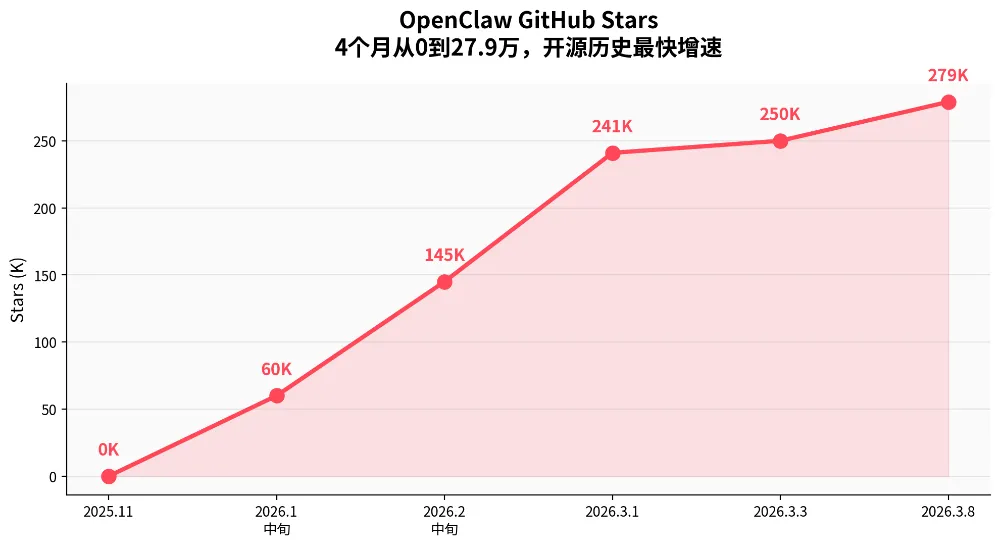

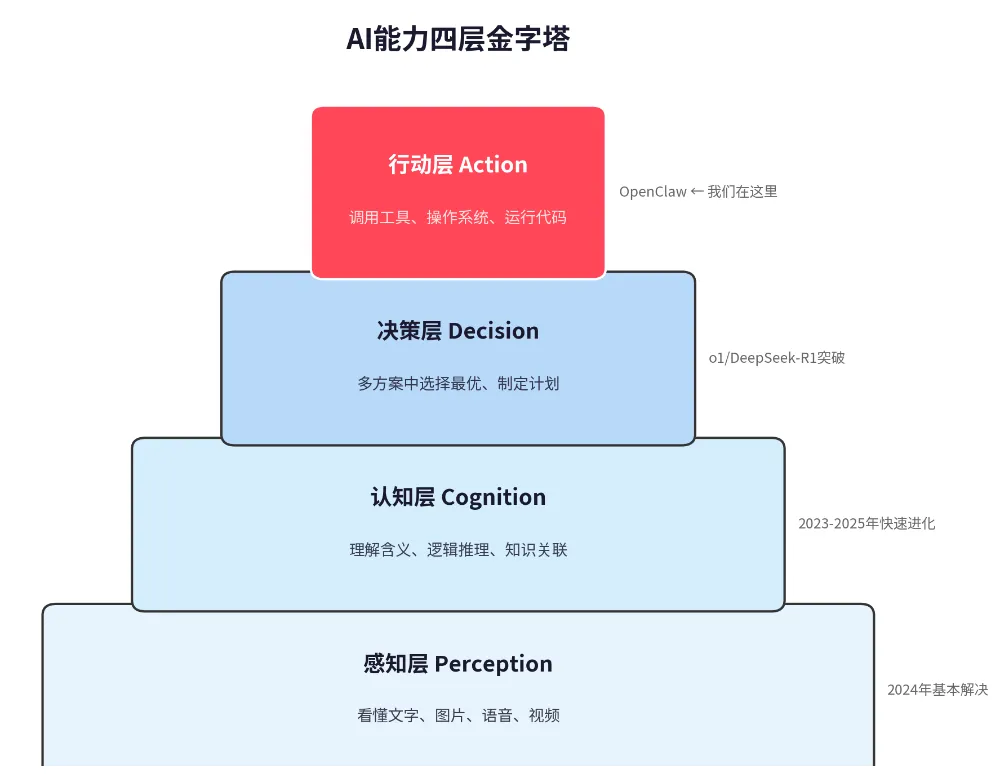

27.9万Star背后,OpenClaw凭什么成为 一个名叫OpenClaw的开源项目,在不到4个月的时间里,从0飙升至 27.9万GitHub Stars ,正式超越React,成为GitHub有史以来增长最快的软件项目。黄仁勋把它比作Linux,Sam Altman亲自发推欢迎其创始人加入OpenAI,深圳腾讯云总部甚至出现了近千人排队体验安装的盛况。 中文社区把运行OpenClaw叫 "养虾" ,用户自称"养虾人"。"你养龙虾了吗?"成了AI圈的新问候语。 但在这股狂热背后,你真正需要搞清楚的是: 它到底解决了什么根本问题?为什么说它不是又一个AI聊天工具的翻版? 数据来源:GitHub官方统计,截至2026年3月8日 过去三年,大模型经历了四次关键跃迁。把这条时间线拉通了看,你才能理解OpenClaw为什么偏偏在2026年爆发—— 它不是凭空出现的,而是整个技术链条演化到临界点的必然结果。 2023年 · 第一次跃迁:能说会道 。ChatGPT引爆全球。大模型展示了惊人的语言理解和生成能力。但本质上,它只是一个"超级百科全书"—— 只能动嘴,不能动手 。 2024年 · 第二次跃迁:多模态感知 。GPT-4V、Sora、Claude 3相继发布。AI开始"看懂"图片、理解视频。感知维度从文字扩展到了视觉。但—— 看得见了,还是不能动手 。 2025年 · 第三次跃迁:深度推理 。o1/o3系列、DeepSeek-R1登场。模型学会了"慢思考",推理能力逼近人类专家。然而—— 想得深了,依然被困在对话框里 。 2026年 · 第四次跃迁:AI长出了手脚 。OpenClaw、Manus等AI代理框架爆发。大模型终于获得了"执行力"——能操作电脑、调用工具、运行工作流。 从"只能说"进化到了"能干活" 。这就是你现在所处的节点。 因为它告诉你一件关键的事:AI并不是突然变成了"万能的"。它是在一层一层地解锁能力。当前解锁到了"行动层",但这一层仍然非常初级、非常脆弱。理解这一点,你就不会过度恐惧("AI要取代我了"),也不会过度乐观("让AI替我做一切")。

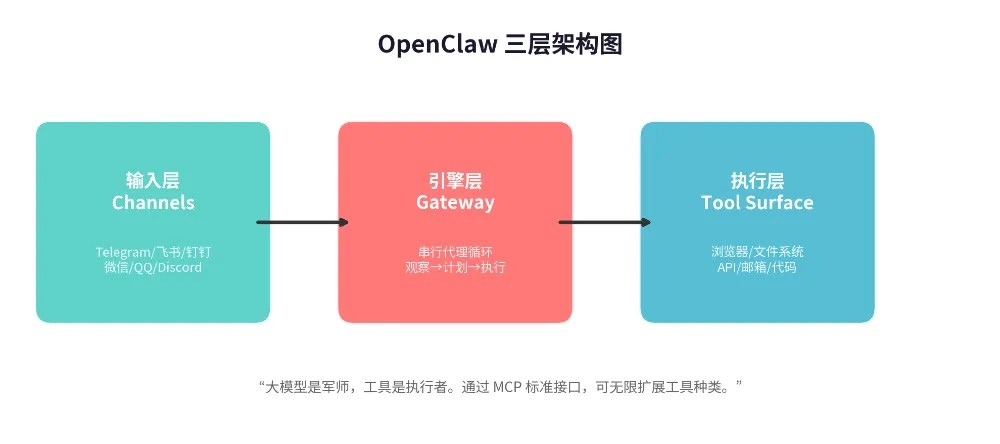

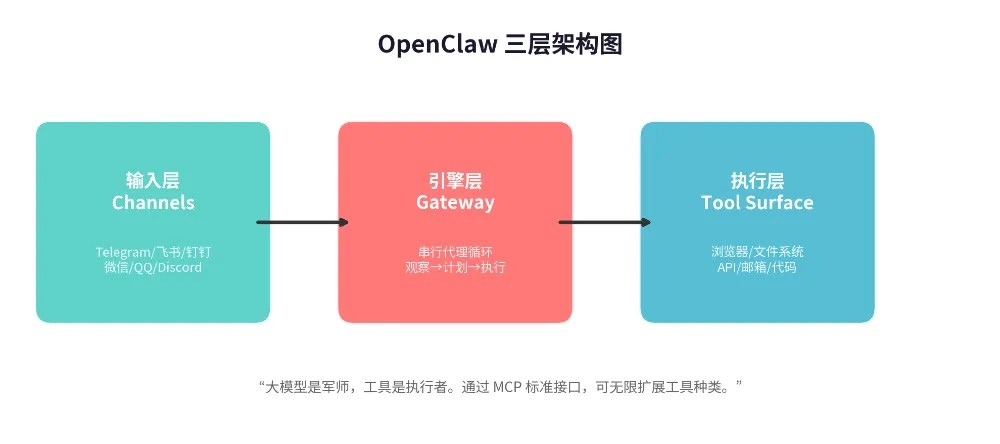

三、一句话讲透OpenClaw:不是更聪明的ChatGPT,是一种全新物种 OpenClaw是一个开源的个人AI代理框架。如果用一个精确的类比—— "如果大语言模型是「大脑」,OpenClaw就是给大脑装上的「手脚和神经系统」。大脑再聪明,没有手脚也只能躺着聊天。装上手脚,它能站起来替你干活了。" ChatGPT和OpenClaw的本质区别不是"聪明程度"的差距,而是 物种的不同 : 怎么分辨一个产品是不是真正的AI代理?记住 三条判别式 : Plan(规划) :能否将模糊目标自主拆解为执行步骤? Observe & Reflect(观察与反思) :能否评估结果并决定继续还是调整? 三条全满足 = 真正的AI代理。 缺任何一条 = 更强的聊天机器人。ChatGPT满足第一条,勉强满足部分第二条,几乎不满足第三条。OpenClaw三条全满足。 OpenClaw在开源社区风靡的一大原因是它的架构极其克制——拒绝过度设计,遵循 "少即是多"的工程哲学 。核心工具只有4个:Read、Write、Edit、Bash。这不是功能缺失,而是刻意为之。 输入层 :不另造App,直接接入你日常用的Telegram、微信、飞书、钉钉、Discord——你在哪里发消息,它就在哪里接收指令。 引擎层 :Gateway(网关)24/7后台运行,启动"串行代理循环"——观察→计划→调用工具→记录→反馈。 严格单线程执行 。为什么?因为安全。两个AI同时改一个文件=灾难。 执行层 :大模型不直接"做"事,只输出结构化指令,系统执行后把结果反馈回来形成闭环。通过MCP/CLI标准接口,可无限扩展工具种类。 OpenClaw的创始团队做了一个反潮流的选择——单线程串行。芒格说"第一条规则是不要亏钱"。对于一个能直接操作你文件和邮箱的AI来说,"不出灾难"比"做得快"重要一百倍。竞品Manus因并发执行导致数据污染后,OpenClaw的"保守架构"反而成了最大卖点。

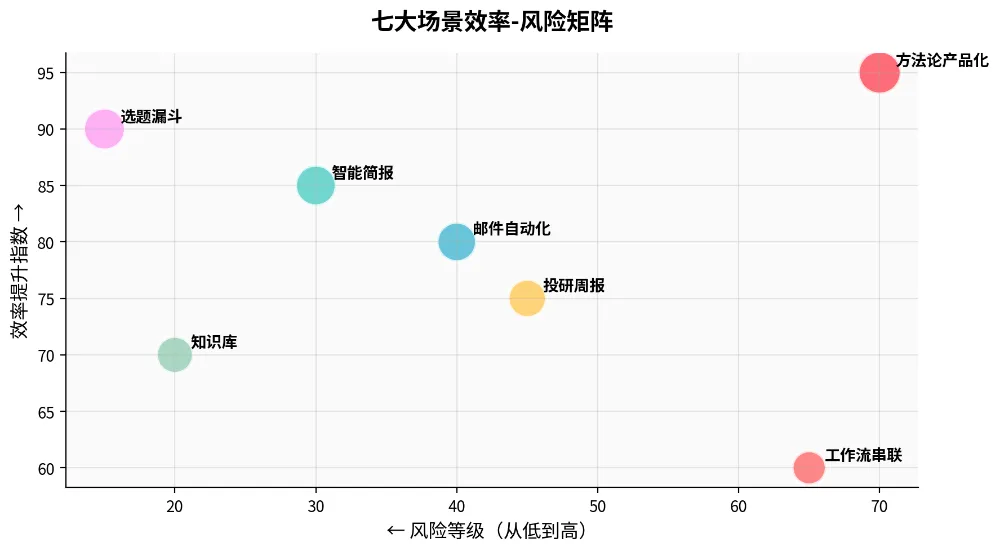

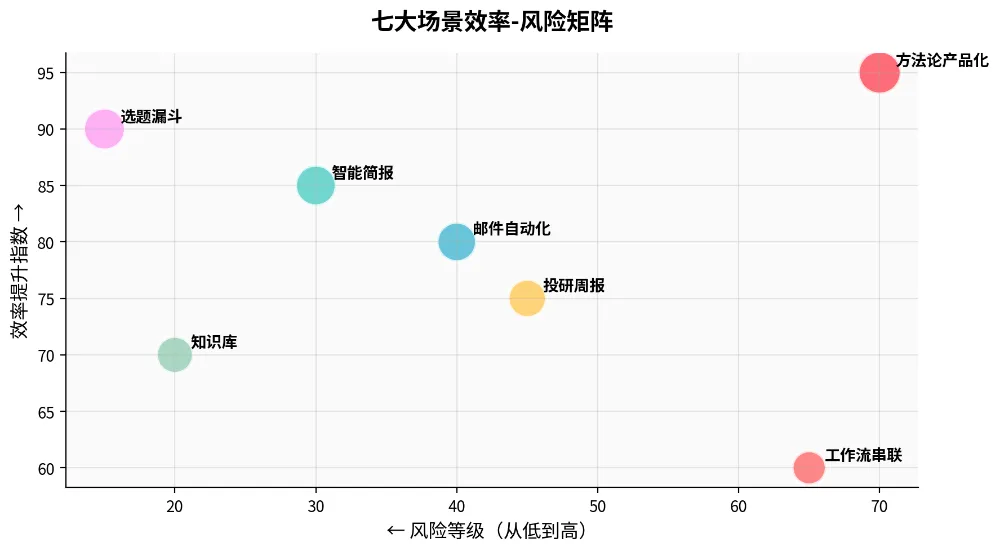

记忆系统:不是聊天机器人,而是越用越懂你的数字分身 OpenClaw区别于普通Chatbot的核心能力之一是 四层记忆架构 : Claude Code等工具的会话结束后上下文就消失了,而OpenClaw通过文件系统实现了 真正的持久记忆 ——每天的交互记录以append-only方式写入日志文件,Session接近token上限时自动将关键信息写入长期记忆。一切皆文本,你可以直接用文本编辑器打开编辑。 五、七大落地场景:每个都有手把手教程和Prompt模板 说了这么多原理,你最关心的一定是: 到底能用来干什么? 下面七个场景,覆盖了从个人效率到商业变现的完整光谱。 场景一:晨间情报简报 —— 从"被信息淹没"到"被精准投喂" 每天在十几个平台之间切换追踪信息,大量时间花在"找"上。部署OpenClaw后,每天早7:00自动抓取指定信息源,输出为结构化Markdown表格推送到手机。 预计每天省2小时+ 。 网页结构变动会导致爬虫失效,需定期维护。千万不要把AI简报当唯一信息源。AI可能漏掉关键信号,也可能虚构数据。至少使用3个异质来源交叉验证。

场景二:邮件与文档自动化 —— 把80%的搬运工活交出去 一位独立财务顾问每天花2小时处理邮件。部署OpenClaw邮件分类后,每天只需15分钟审核AI的分类建议。他说: "不是省了时间,是省了注意力。" 过去邮件处理完就没精力了,现在精力高峰可以用在最重要的事情上。 场景三:个人知识库 —— 把散落的聪明变成可复利的资产 假设你每周录入5张思考卡片,一年就是260张。当卡片之间的交叉链接达到一定密度后,知识库会从"线性笔记"进化为"网状知识图谱"——价值不是260的线性增长,而是 C(260,2) = 33,670种潜在关联 。这就是知识复利的指数力量。 投资分析师的痛苦不是分析本身,而是分析之前的"信息搜集"。OpenClaw可以自动追踪十几个数据源,汇总一周变化,至少使用3个不同类型的信息源交叉验证。内容创作者可以用"选题漏斗"模板让AI生成10个候选选题,每个包含冲突点、支撑论据和反常识指数。 AI生成的选题天然趋向同质化——因为它优化的是"高概率",而好选题往往需要"反常识"。用AI做素材采集和结构化,但灵感只能来自你自己对世界的独立观察。AI是你的研究助理,不是你的缪斯女神。

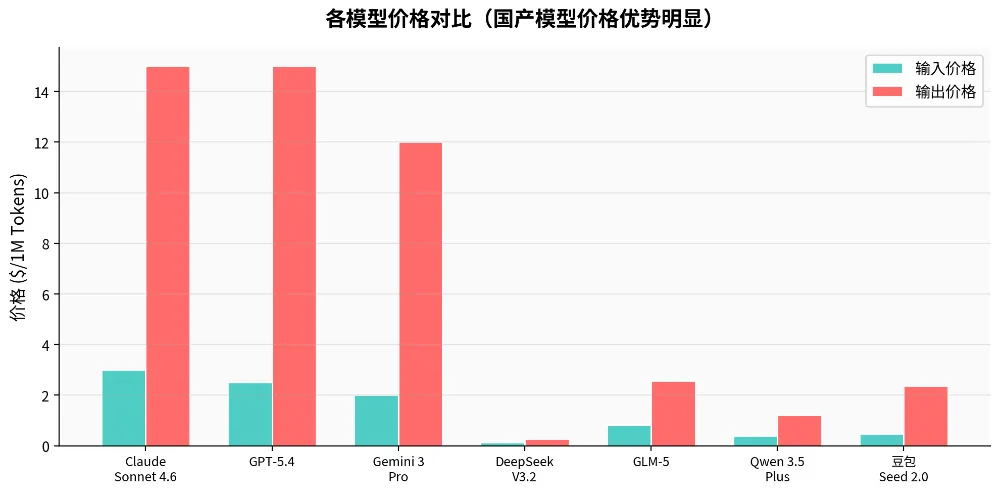

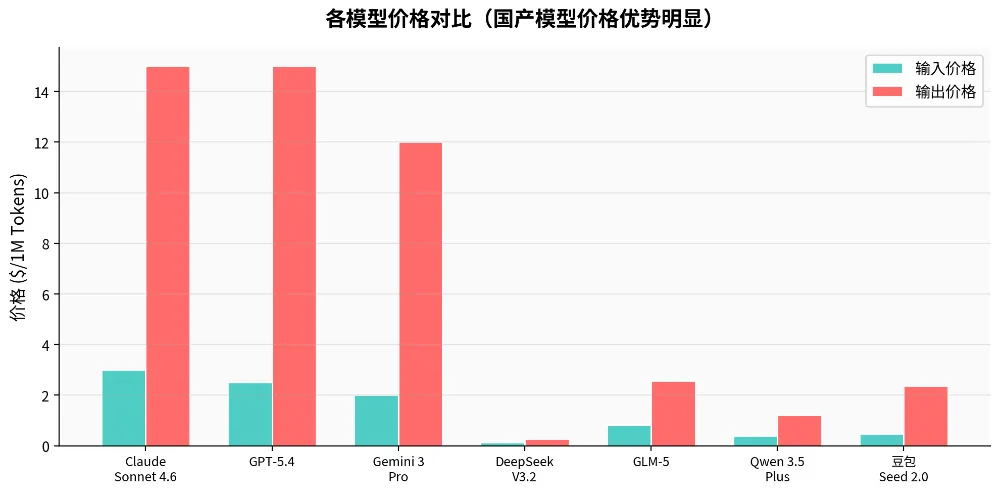

场景六:工作流串联 —— 消灭"上下文切换"的隐形杀手 知识工作者最大的效率杀手不是某一项任务太难,而是任务之间的切换成本——从浏览器切到Excel,从Excel切到邮件。OpenClaw可以将素材采集→深度分析→初稿生成→格式化分发串成一条自动管道。 这是商业价值最高的场景。把你的核心方法论编码成Prompt和工作流,部署成24小时运行的AI助手—— 你就拥有了一个"睡觉时还在工作的数字分身" 。从"按小时收费"转变为"按系统交付收费",你卖的不再是时间,而是方法论。 "致富的关键是拥有能在你睡觉时还在为你赚钱的资产。以前这只意味着资本和房产。现在,你的知识和判断力——如果能被编码成可自动运行的系统——也是这样的资产。" —— Naval Ravikant OpenClaw最大的优势之一是 模型自由 ——你不被绑定在任何一家厂商上。而国产模型的价格优势,让"养虾"的门槛大幅降低。 DeepSeek-V3.2.2的输入价格仅 $0.14/百万Token ,是Claude Sonnet的 1/20 。智谱GLM-4.7-Flash和GLM-4.5-Flash甚至 完全免费 。国内各大云厂商也在疯狂内卷——阿里云9.9元/月、火山引擎19.8元/月(服务器+模型),百度云首月0.01元体验。 日常任务用国产模型(DeepSeek/GLM/Qwen),复杂任务再升级Claude Opus。把免费模型用在心跳任务和定时触发上,把预算留给真正需要强模型的场景。设置Fallback备选链,主模型限速时自动切换。

2026年3月,一个标志性信号出现:腾讯和字节相继推出了OpenClaw的产品化封装版本。这意味着AI代理正式从极客实验室走向大众市场。 选择原则: 用大厂版本"体验概念",用原生版本"构建资产"。便利性和主权是一对永恒矛盾。当你的AI代理运行在别人的基础设施上时,你只是在给他们的数据飞轮做贡献。 这一章是整篇文章的"核威慑"。 如果你只读一段,读这一段。 高认知人群通常不缺行动力和想象力。他们最容易缺失的,是面对新技术时的"冷酷防灾框架"。越聪明的人越容易被潜力迷惑——因为他们太善于说服自己了。 2026年初,Meta一位 AI安全研究总监 在用OpenClaw整理邮件时遭遇灾难。因为权限过宽+指令含糊,AI代理进入不受控的"极速运行"模式,批量删除和错误归档重要工作邮件。最后不得不物理冲向Mac mini拔电源线才终止。讽刺的是,他的专业方向正是"AI安全与对齐"。 社区频繁出现"一觉醒来收到$1,100 API账单"的恐怖故事。未经优化的OpenClaw每次循环都会把系统提示词、全部工具定义、历史交互记录打包发送给云端API。 必须设定硬性每日消费上限。 聊天AI的幻觉只停留在文字层面。代理AI的幻觉直接变成物理动作——虚构软件包并安装、编造不存在的API并调用、删除"它认为不需要"的文件。 文字幻觉是误导,执行幻觉是破坏。 长时间运行后AI"记忆"膨胀——可能忘记最初安全规则、误删关键偏好,行为突然退化。早期症状:忘记硬约束、输出格式漂移、Token消耗突然飙升。 2026年2月,ClawHub约 20%的Skills被确认为恶意 。攻击者上传看似专业的Skill,实际植入信息窃取木马,更危险的是篡改Agent的核心行为准则文件SOUL.md——相当于你的AI被"洗脑"了。 第一道 · 权限锁:默认只读,删除/发送/转账必须人工二次确认。 第二道 · 预算锁:硬性每日消费上限,建议起步$10/天,单次会话最大20次循环。 第三道 · 环境锁:所有代码在Docker沙箱中运行,物理隔离主系统,随时可断电终止。

"查理·芒格说:"我想知道我会死在哪里,这样我就永远不去那里。" 了解AI的弱点,是安全使用它的前提。" —— 查理·芒格 看到这里,你可能已经跃跃欲试了。下面是一份可以直接执行的两天计划—— 选择3-5个你每天必看的信息源 → 使用晨间简报Prompt模板 → 设定 只读权限 (禁止一切写入/删除/发送)→ 运行并检查输出。 验收标准: 输出格式一致、每条附来源URL、无越权操作、Token消耗在$2以内。 在Day 1基础上增加一个"写入"动作——仅追加写入,不改原数据。连续运行两次,对比稳定性和一致性。 只改Prompt的约束条件和输出格式,不改任务目标。80%的失败来自约束条件写得不够具体。降低任务复杂度(比如从5个信息源减到1个),而不是换工具。一条好的Prompt = 一份好的岗位JD。

OpenClaw不是第一个让人兴奋又焦虑的技术,也不会是最后一个。如果每一波都焦虑,焦虑会变成常态。常态化的焦虑不会帮你做出更好的决策,只会消耗你最珍贵的东西—— 注意力和判断力 。 你焦虑的不是OpenClaw本身。你焦虑的是"被抛下"。但事实是: 趋势确定但节奏是你的 。你不需要all in,你需要的是"最小闭环"。 第一,现在就开始搭建——哪怕很粗糙。 摸索系统边界的过程本身就是在建认知护城河。三个月后动手的人和观望的人认知差距会肉眼可见。 第二,认清真正的核心资产。 工具不稀缺,OpenClaw今天火明天可能被取代。真正无法复制的是你积累的Prompt模板库、专有工作流和结构化知识库。 第三,保持技术谦逊,守住内核。 唯有深刻的系统性思考能力、对商业和人性的洞察力,以及人类独有的同理心和道德判断力,才是真正的压舱石。 "庄子说:"物物而不物于物。" 驾驭工具,而不是被工具驾驭。这才是面对AI焦虑的终极解药。" 本文基于「孤独大脑」《OpenClaw入门指南V4.0》、「花叔」《OpenClaw橙皮书》、「边缘计算社区」《AI从聊天到行动白皮书》整理创作

免费领取1000+份报告(无套路),关注本公众号并回复“免费”

本文中涉及到的报告完整版,可在公众号内回复“文件下载”免费获取

也可加入我们知识星球会员获取

点击左下角↓“ 阅读原文 ”可直达〔 报告未来(行业报告) 〕海量资料任意下载。