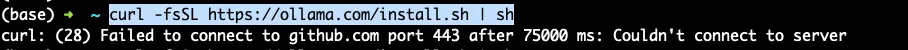

curl -fsSL https://ollama.com/install.sh | sh

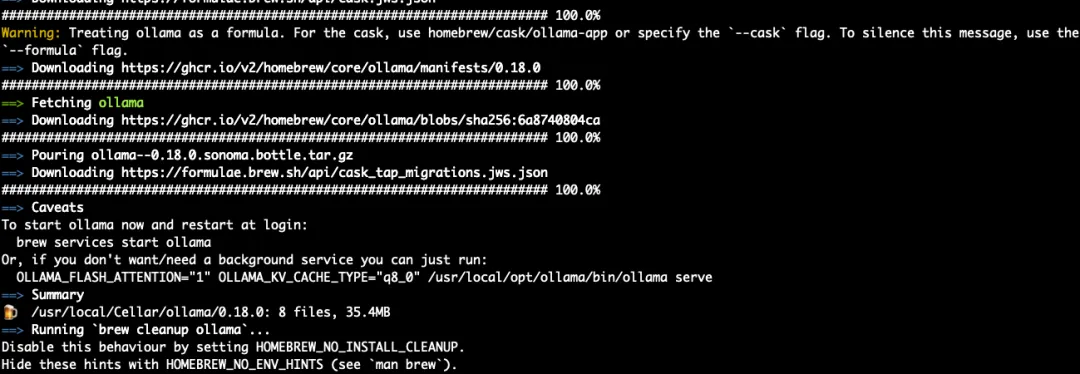

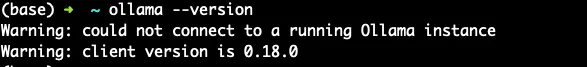

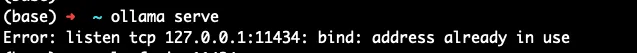

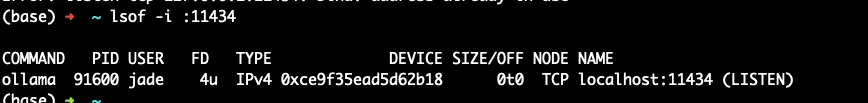

报错了,说连接不上服务器,可能是因为我本地VPN的原因,浏览器都是可以正常打开的,不纠结,使用brew来安装出来版本号了,但是仍提示未连接上Ollama,那么输入命令行启动服务提示其实也是ollama的一个服务占用了,将这个进程杀掉,再启动ollama服务lsof -ti:11434 | xargs kill -9

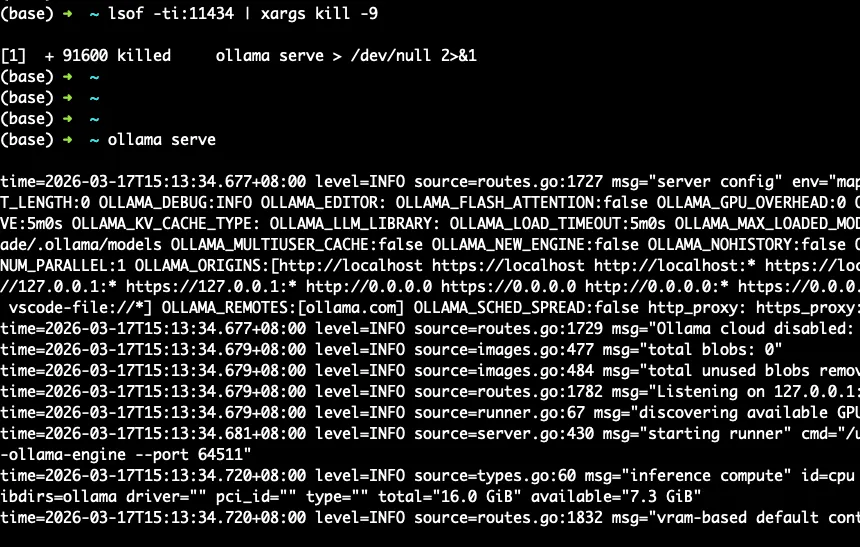

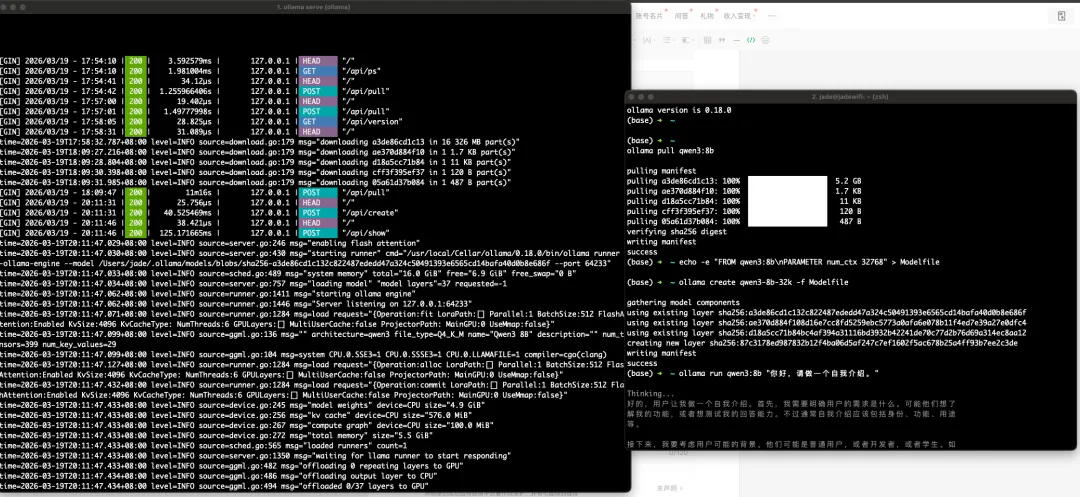

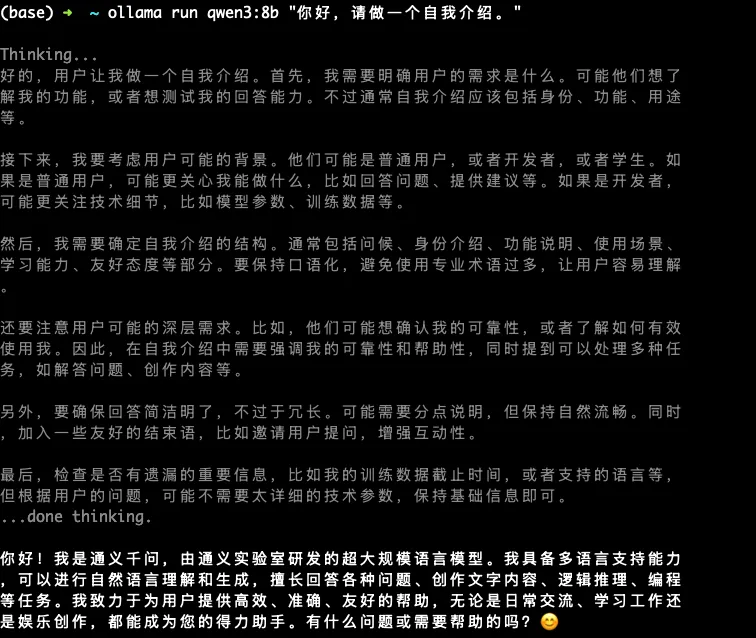

接下来使用ollama拉取千问7b的模型到本地,我拉取的时候报错,无法链接,官方应该没有这个文件了,换8b左侧是ollama server运行情况,看到可以正常处理命令行操作,拉取成功,问个问题让它回答一下:ollama run qwen3:8b "你好,请做一个自我介绍。"

有回应了,但是真的非常慢,会把自己逗笑,因为我的电脑也比较久了,磁盘马上要占满。打开~/.openclaw/openclaw.json文件,在providers下面增加ollama配置如下:"ollama": { "baseUrl": "http://127.0.0.1:11434/v1", "apiKey": "ollama-local", "api": "openai-completions", "models": [ { "id": "qwen3-8b-32k", "name": "Qwen3 8B (Local)", "reasoning": false, "input": [ "text" ], "cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 }, "contextWindow": 32768, "maxTokens": 32768 } ] }

"agents": { "defaults": { "model": { "primary": "ollama/qwen3:8b" }, ……

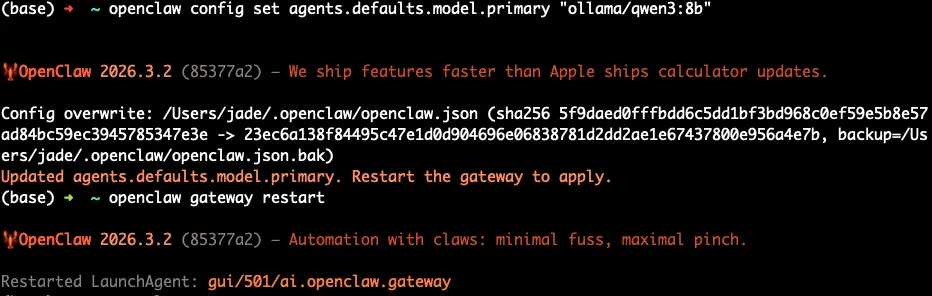

openclaw config set agents.defaults.model.primary "ollama/qwen3:8b"

但是我在网页上验证,真的巨卡,出不来结果,Mac mini呜呜转,我电脑内存不够用了。。

夜雨聆风

夜雨聆风