本期要点

OpenClaw 两周内从万人排队安装到集体花钱卸载,暴露了 AI Agent 落地的三重困境:普通用户根本玩不转的技术门槛、25 次"没事干"就烧掉 18 美元的 Token 成本、以及大规模安全漏洞带来的系统级风险。但这场全民压力测试并非毫无价值,它逼出了腾讯、阿里、网易等多家大厂的"合规龙虾"产品线,也让行业看清了一个事实:AI Agent 的真正瓶颈不在模型是否聪明,而在支撑它可靠运行的工程基础设施是否成熟。

2026 年 3 月初,深圳腾讯大厦楼下出现了一幕魔幻场景:近千人排起长龙,等待腾讯云工程师免费帮自己安装一个叫 OpenClaw 的 AI 软件。据媒体报道,马化腾在朋友圈感叹:"没想到这么火。"

小红书和闲鱼上,"500 元上门代安装"的帖子火速刷屏。有人甚至喊出万元安装价,号称"年入百万"。

然后呢?不到两周,同样的平台上开始涌现另一种服务:15 元到 299 元不等的"代卸载"。从争先恐后地"养龙虾",到心急火燎地"卸龙虾",这场过山车堪称 2026 年中国 AI 领域最具戏剧性的事件。

问题是,这只"龙虾"到底是什么?它为什么让人如此疯狂,又为什么让人如此迅速地幻灭?

爆红的"数字员工":一个过于诱人的理想

OpenClaw 并非出自科技巨头的精密规划。它的创造者是奥地利开发者 Peter Steinberger,声称自己在大约一个小时内搭出了第一个版本。项目在 2026 年 1 月 25 日发布后,迅速在 GitHub 上积累了超过 27 万 Stars,超越 Linux 成为 GitHub 历史上最受欢迎的开源项目。2 月 14 日,Steinberger 宣布加入 OpenAI,项目移交给了独立开源基金会。

技术上说,OpenClaw 是一个 AI Agent 运行时框架,核心包含 Gateway、Agent、Skills、Memory 四大组件。但对普通用户来说,它的吸引力远比这简单得多:这是一个能真正"动手"的 AI。

跟被"关在"聊天框里的 ChatGPT、文心一言不同,OpenClaw 可以直接操作你的电脑。读取浏览器、访问本地文件、调用应用程序,甚至通过微信、飞书、钉钉跟你互动。你可以训练它处理邮件、整理文档、管理日程、分析数据。24 小时在线,不知疲倦,绝对服从。

这种"所见即所得"的操控感,叠加大厂线下推广和社交媒体 KOL 的渲染,制造了极强的 FOMO。仿佛不立刻拥有这只"龙虾",就会被自动化浪潮甩在后面。

但说实话,这种焦虑我太理解了。害怕错过 AI 工具的背后,真正害怕的是被时代淘汰、失去控制感、自我认同被动摇。这些恐惧是真实的,只不过,一只开源龙虾解决不了它们。

理想照进现实:三重困境

当人们真正把这只"龙虾"请进自己的数字生活,美好理想立刻撞上了三堵墙。

第一堵墙:你装得上,但你玩不转

部署和调教 OpenClaw 远不是装个 App 那么简单。你需要配置运行环境、申请大模型 API、编写或调试复杂的 Prompts。社区反馈显示,高端模型体验明显更稳,但成本也更高,而低端模型的表现往往让人抓狂。

你看,这直接催生了"代安装"产业链。但装上只是起点,真正的门槛在后面:持续的调试、维护和优化。配置文件可能在重启后被自动修改或损坏,Telegram 会出现重复消息,Discord 断连后整个系统冻结,数据库时不时就锁死报错。3.7-beta.1 版本一次性修复了超过 200 个 Bug(89 次 commits),项目仍在高频补坑,工程面还远没稳定。

对没有编程基础的普通用户来说,这些问题中的任何一个都足以让人放弃。

这让我想起一个比喻:厨房里堆满了高端厨具,最后却叫了外卖。很多人装 OpenClaw 的过程,本质上就是在收集工具,而不是在解决问题。

第二堵墙:25 句"没事干",18 美元没了

OpenClaw 的使用成本远超大多数人的预期。API 调用按 Token 计费,系统提示词通常就要消耗 5000 到 10000 个 Token,缓存过期后全价重计,复杂任务需要 5 到 10 轮推理,成本指数级膨胀。

一个真实案例:有用户设置 OpenClaw 每 30 分钟自动检查任务,一整晚 25 次检查,每次 Agent 回复"没有需要处理的事务"。就这 25 句话,花了 18.75 美元。还有程序员做爬虫测试,不到一天消耗近 5000 万 Token。

一位深圳电商从业者对媒体说得很直白:"可能股票还没赚到钱,Token 的钱就已经付出去了。"

玩具可以不计成本,工具必须算投入产出比。

而 OpenClaw 目前的投入产出比,对绝大多数人来说是倒挂的。

第三堵墙:安全漏洞与国家级警告

最致命的一击来自安全。

OpenClaw 上线以来,安全研究机构陆续披露了大量漏洞,其中不乏高危级别。更让人担忧的是,公开扫描显示大规模的暴露实例正在互联网上裸奔,相当比例带有已知漏洞。安全研究员通过 Shodan(一种专门搜索联网设备的搜索引擎)成功访问了多个实例的 API 密钥、Bot Token、OAuth 凭据,甚至完整的聊天记录。

我之前在评测 OpenClaw 时发现过一个很有代表性的问题:它的沙箱(Sandbox)默认是关闭的。这意味着 AI 执行的所有代码都以系统用户权限直接运行。我做了三次提示词注入测试,模型全部成功防御了,看起来"很安全"。但当我给它一个看似正常的 Python 脚本,里面包含了敏感操作的代码时,它毫不犹豫地执行了。

说白了,这就是"模型安全"和"系统安全"的区别。模型知道不该删你的硬盘,但系统层面根本没有机制阻止恶意代码的执行。

国家互联网应急中心、工信部接连发布安全风险提示。多家国有银行禁止在办公设备安装 OpenClaw,多所高校发布了强制卸载通知。安全焦虑成了压垮大众热情的最后一击。

超越"玩具":AI Agent 的深水区

OpenClaw 的狂欢迅速幻灭,但 AI Agent 这个方向失败了吗?

恰恰相反。这波热潮像一次全民压力测试,暴露了问题,也指明了方向。

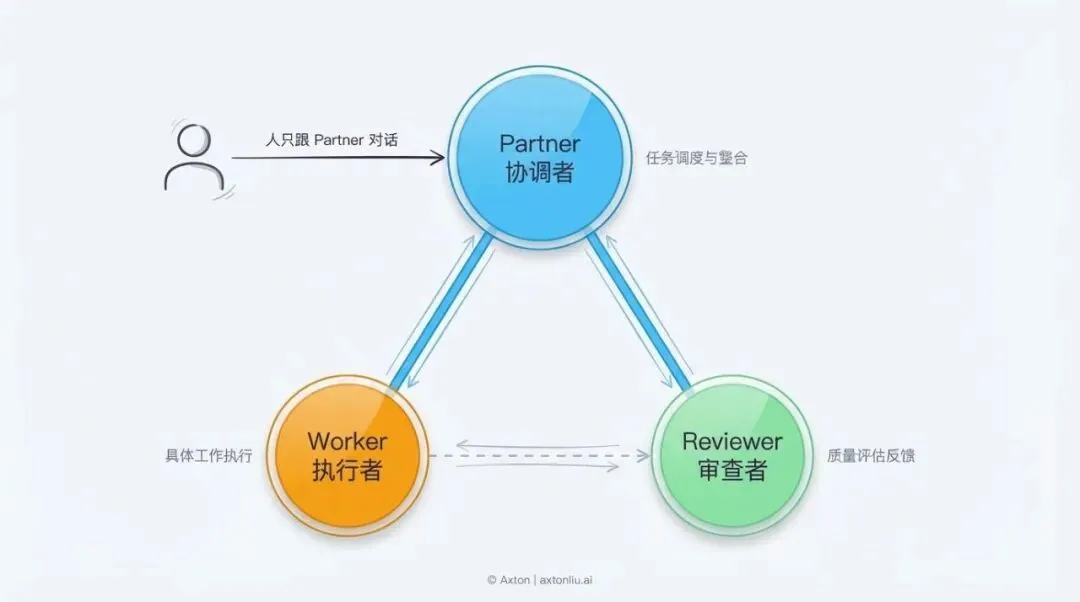

我自己在用 OpenClaw 搭多 Agent 系统时有过很深的体会。一开始我也想让一个 Agent 包揽一切,结果发现根本不行。后来我设计了一个 3-Bot 架构:Partner(协调者)负责接收需求和统筹规划,Worker(执行者)专注干活,Reviewer(审查者)只管质量和风险提示,不改需求。三个角色各有独立的工作目录和权限边界。

这套系统跑起来之后,我发现最耗精力的根本不是 AI 模型本身,而是围绕它的工程问题。比如"协作协议":如果三个 Bot 都能直接回复用户,系统会瞬间陷入"三个 AI 抢着说话"的混乱。最后靠四条铁律才砍掉这个问题:人只跟 Partner 对话,只有 Partner 能调度其他两个,所有产出必须落盘到固定目录。

这跟我之前用 AI 开发 VerbatimFlow(一个 Mac 语音输入 App)的经验完全吻合:功能开发只占 30% 的精力,剩下 70% 全花在了稳定性、权限治理、状态机纠错和回归测试上。

一个真正有用的 AI Agent,核心瓶颈往往不是大模型是否够聪明,而是支撑它可靠、安全、持续运行的工程基础设施是否成熟。

上下文怎么管理?多个 Agent 怎么协作而不打架?系统崩了怎么自愈?这些都是分布式系统和软件工程的经典难题,复杂度远超"调教 AI"这四个字。

国产"合规龙虾"与下一步

市场正在快速纠偏。安全禁令反而催生了一个全新赛道:国产"合规龙虾"。

据报道,腾讯推出 QClaw,深度集成微信和企业微信, 强调全栈自研与合规,目标是"让爸妈也用起来"。阿里的 CoPaw 走本地加云双模部署路线,原生集成钉钉和飞书。网易有道推出 LobsterAI,MIT 开源,内置多个技能适配中国办公生态。字节跳动、百度、华为也纷纷入场。

这些产品的共同方向很清晰:降低部署门槛、强化安全隔离、与国内办公生态深度整合。未来的 AI Agent 可能不会以 OpenClaw 这种需要自己"从零养殖"的形态普及,而是以开箱即用的云服务或者预制模块的方式出现。

但这并不意味着问题解决了。我在 3-Bot 架构中遇到的那些工程挑战,每一家做 AI Agent 的公司都会遇到。上下文管理、多 Agent 协作、系统稳定性,这些问题不会因为换了品牌就消失。

褪去狂热,走向务实

OpenClaw 这趟过山车,是 AI 技术走向大众过程中一个教科书级的样本。

它反映了一个真实的渴望:人们确实需要能帮自己"干活"的 AI,不只是聊天。但它也暴露了一个巨大的鸿沟:从"能聊"到"能干",从"演示很酷"到"生产可用",中间隔着易用性、成本和安全三座大山。

如果你现在还在犹豫要不要碰 AI Agent,我的建议很简单:纯娱乐探索,放心玩。涉及账号、支付、隐私的事情,别让 AI 碰。想进生产环境,先过三项检查:权限隔离做了没?成本上限设了没?人工回退准备好了没?

这场热潮的退去不是 AI Agent 的终点,而是一次必要的祛魅。它挤掉了"万能助理"的泡沫,让行业和用户都回归理性。

与其花 500 块请人装一只龙虾,不如先想清楚一个问题:你到底要用 AI 解决什么?

工具越来越多,工具越来越强,但如果你不知道自己要拿它做什么,再强的工具也只是摆设。从"做事的人"变成"设计系统的人",这个转变比任何一只龙虾都重要。

夜雨聆风

夜雨聆风