点击上方“小妖同学学AI”,选择“星标”公众号

超级无敌干货,第一时间送达!!!

EdgeClaw 完全解析:边缘-云协同的隐私安全 AI 代理

项目介绍:当 AI 代理学会“边界感”

在当前的 AI 代理架构中,几乎所有数据和任务都被一股脑地推送到云端,导致隐私泄露风险持续累积,边缘设备的计算能力却被白白浪费。如何让 AI 代理既拥有云端的强大能力,又能保护用户的敏感信息?EdgeClaw 给出了一个优雅的答案。

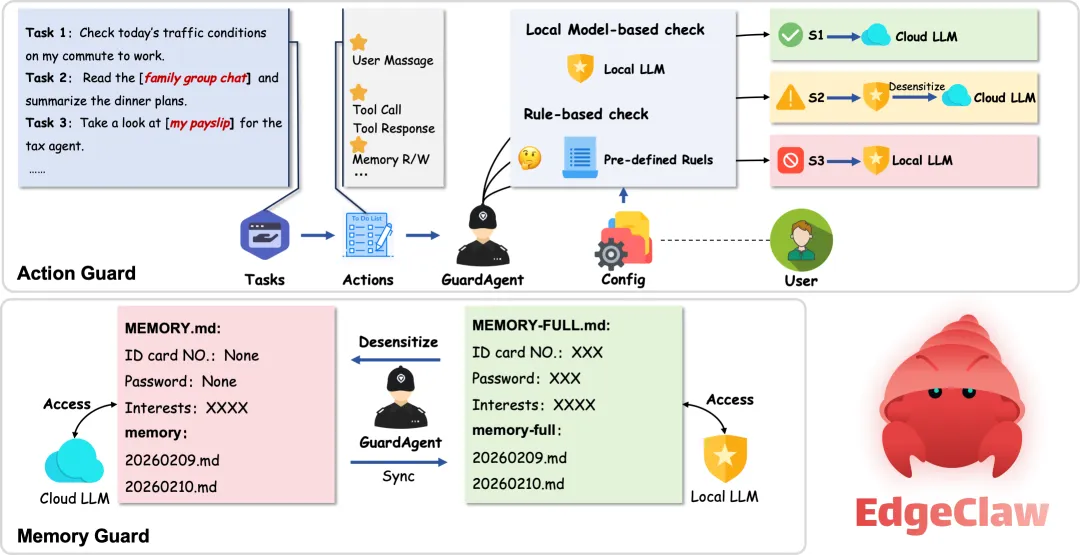

EdgeClaw 是由清华大学 THUNLP、中国人民大学、AI9Stars、ModelBest 和 OpenBMB 联合开发的开源项目,基于 OpenClaw 构建,旨在重新激活边缘计算的价值。它通过一套可定制的三层安全系统(S1 直通 / S2 脱敏 / S3 本地),实时分类每条请求的敏感度和复杂度,并通过可组合的管道将请求路由到最隐私安全、最经济的处理路径上。开发者无需修改任何业务逻辑,即可实现“公开数据上云、敏感数据脱敏、私密数据本地处理”的智能分流。

核心特性:三层安全协作 + 成本感知路由

三层安全分级,数据永不越界

EdgeClaw 为每条用户消息、工具调用和工具结果进行实时分级:

S1(安全):直接发送到云端模型(如“写一首关于春天的诗”)。 S2(敏感):在设备端脱敏后再转发到云端(如地址、电话号码、邮箱)。 S3(私密):完全在本地处理,云端只保留上下文连续性(如工资单、密码、SSH 密钥)。 分级通过双检测引擎实现:

规则检测器(~0ms):关键词 + 正则匹配(如 API key、PEM 密钥头)。 本地 LLM 检测器(~1–2s):语义理解,识别“帮我分析这张工资单”等深层敏感内容。 S2 脱敏流程示例

用户消息(含手机号)

│

▼

本地 LLM 检测 → S2

│

▼

本地 LLM 提取 PII → JSON 数组

│

▼

程序化替换 → [REDACTED:PHONE]

│

▼

隐私代理(localhost:8403)

├── 去除标记

├── 转发到云端模型

└── 流式返回(支持 SSE)成本感知协作,大幅降低 Token 费用

EdgeClaw 使用本地小模型(如 MiniCPM-4.1)作为 LLM 裁判,对任务复杂度进行分类:

SIMPLE:简单查询、翻译、问候 → 路由到便宜模型(如 gpt-4o-mini) MEDIUM:代码生成、单文件编辑 → gpt-4o COMPLEX:系统设计、多文件重构 → claude-sonnet-4.6 REASONING:数学证明、逻辑推理 → o4-mini 在典型工作流中,60%–80% 的请求可被路由到低成本模型,显著节省云端 token 开销。同时,通过 SHA-256 哈希缓存(TTL 5 分钟)避免重复判断,进一步降低延迟。

即插即用,零代码改动

EdgeClaw 通过 Hook 机制自动拦截和路由,无需修改任何业务逻辑,可作为 OpenClaw 的直接替换。它覆盖了 AI 代理的完整生命周期,包括

before_model_resolve、before_prompt_build、before_tool_call、after_tool_call等 10 个 Hook 点。双轨记忆与双轨会话

记忆文件: MEMORY.md(云端可见,自动脱敏)与MEMORY-FULL.md(本地完整数据)。会话历史: sessions/full/(完整记录)与sessions/clean/(云端消费版本)。云端模型永远不会接触到 S3 级别的原始数据,实现严格的隐私隔离。

安装与快速开始

从源码安装(推荐)

git clone https://github.com/openbmb/edgeclaw.git

cd edgeclaw

pnpm install

pnpm build

pnpm ui:build

pnpm openclaw onboard --install-daemon配置本地 LLM 环境(推荐 Ollama)

# 安装 Ollama

brew install ollama # macOS

curl -fsSL https://ollama.ai/install.sh | sh # Linux

# 拉取推荐模型

ollama pull openbmb/minicpm4.1

ollama serve启用 GuardClaw 插件

在

openclaw.json中添加:{

"plugins": {

"entries": {

"GuardClaw": {

"enabled": true,

"config": {

"privacy": {

"enabled": true,

"localModel": {

"enabled": true,

"provider": "ollama",

"model": "openbmb/minicpm4.1",

"endpoint": "http://localhost:11434"

},

"guardAgent": {

"id": "guard",

"workspace": "~/.openclaw/workspace-guard",

"model": "ollama/openbmb/minicpm4.1"

}

}

}

}

}

}

}启动网关

pnpm openclaw gateway run看到 GuardClaw 插件加载日志,即表示安装成功。此后所有请求将自动经过安全分级和智能路由。

优势对比:EdgeClaw 与 OpenClaw

对比维度 EdgeClaw OpenClaw 安全机制 三层分级(S1/S2/S3)+ 双检测引擎 基础 DM 配对 隐私保护 敏感数据脱敏转发,私密数据本地处理 数据自托管,但无主动分级 成本优化 任务复杂度路由,节省 60-80% 云端费用 无 边缘-云协同 智能分配任务,兼顾隐私与能力 全部上云或全部本地 检测延迟 规则检测 ~0ms,LLM 检测 ~1-2s 无 代码侵入 零改动,Hook 自动拦截 需手动集成安全逻辑 记忆与会话 双轨存储,云端与本地隔离 单一存储 核心优势:

隐私安全:通过形式化定理保证 S2/S3 数据的云端不可见性。 成本效益:智能路由大幅降低 API 开销,尤其适合高频使用场景。 边缘价值:充分利用本地算力,减少对云端的依赖。 无缝迁移:作为 OpenClaw 的直接替代,无需修改现有代码。 总结:迈向隐私优先的 AI 代理新时代

EdgeClaw 将“边缘-云协同”的理念真正落地,为 AI 代理构建了一道智能的隐私防线。它不再盲目地将所有数据推向云端,而是让边缘设备学会识别、保护和分流,既保障了用户的数据主权,又保留了云端强大的计算能力。其即插即用的设计和丰富的定制选项,让开发者可以轻松构建安全、经济、高效的智能体应用。

如果你正在使用 OpenClaw,或希望为 AI 代理增加隐私保护和成本控制能力,EdgeClaw 是值得一试的升级选择。现在就克隆项目,体验边缘-云协同带来的全新体验吧!

项目地址:https://github.com/Openbmb/edgeclaw

夜雨聆风

夜雨聆风