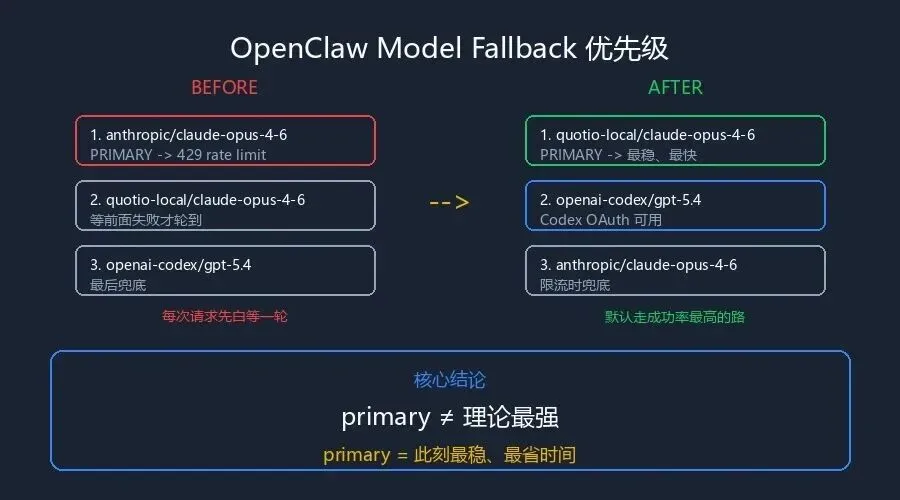

OpenClaw 支持多 provider + fallback,但如果把 anthropic/claude-opus-4-6 放在 primary,每次请求可能都要先白等一轮 rate limit。本文记录一次真实排障:为什么 openai/gpt-5.4 不能用、为什么 openai-codex/gpt-5.4 可以用,以及最终该怎样排 quotio-local、openai-codex、anthropic 的优先级。

如果你的 OpenClaw 现在这样配:

{"primary":"anthropic/claude-opus-4-6","fallbacks":["quotio-local/claude-opus-4-6","openai-codex/gpt-5.4"]}那你很可能已经在默默交一笔延迟税。

表面上看,这套配置没毛病。主模型是官方 Anthropic。挂了再切本地代理。还留了一个 GPT-5.4 兜底。

真跑起来不是这么回事。

Anthropic 一旦撞上 rate limit,请求不会立刻成功切走。它会先失败一轮。你先白等一次,然后才轮到真正稳定的 quotio-local 出场。

这时候,fallback 还在工作,但体验已经输了。

我是 AI灵感闪现,使用 OpenClaw 小龙虾 让 AI 自主管理工作和生活上的问题;使用 Claude Code + BMAD AI 驱动敏捷开发框架,让 AI 自主开发和交付软件来表达想法和灵感。是 MoneyMind 省钱思维 App 和 HeartPetBond 心宠纽带 App 开发者。正在实践和分享让 AI 自主解决健康、生活、投资和等方面的问题。我尽可能让 AI 自己完成从目标到交付以及演进的闭环,以最少的人为交互与监督,让 AI 自己跑流程。我只给 AI 想法或目标,全程不陪跑,让 AI 自主运行类似 Tesla FSD 自动驾驶。

真问题不是没有 fallback,而是 primary 放错了

2026 年 3 月 21 日这轮排障里,最值钱的结论不是"又多接了一个模型"。

真正的结论是:

在多 provider 网关里,primary 不该代表"理论上最强",而该代表"此刻最稳、最省时间"。

原来的请求路径是这样的:

anthropic/claude-opus-4-6 -> rate_limit -> failover -> quotio-local/claude-opus-4-6 -> success也就是说,每次成功前,都可能先走一段明知大概率会失败的路。

这不叫容灾,这叫先绕远路。

这次排障里,四个模型路径要分清

别看名字像,背后的 provider 和认证方式完全不是一回事。

1. anthropic/claude-opus-4-6

官方 Anthropic provider。

优点是"正统"。问题也很直接:当前环境里会碰 rate limit。

如果它放在 primary,每次请求都可能先卡一下。

2. quotio-local/claude-opus-4-6

同样是 Claude Opus,但走的是本地代理:

http://127.0.0.1:8317这条链路在这次排障里是稳定可用的,而且延迟更低。

说白了,真正干活最多的是它。

3. openai-codex/gpt-5.4

这个可以用。

原因不是"你有 ChatGPT Plus",而是它走的是 Codex 内置 OAuth,认证链路和普通 OpenAI API 不是一套。

这点很关键。

4. openai/gpt-5.4

这个反而不能用。

很多人第一次都会踩这个坑。我也一样。看到 GPT-5.4,直觉就是直接上 openai/gpt-5.4。

结果不行。

因为 ChatGPT Plus 不等于 OpenAI API 权限。Plus 是 ChatGPT 产品订阅,不会顺手送你 API 的 api.model.read 之类权限。

所以这条路在这次配置里必须删掉。

一个很容易搞混的点:openai 和 openai-codex 不是一回事

名字只差一截,后果差很多。

这两个 provider 的区别,可以直接记成下面这句:

openai:走 API Key 体系openai-codex:走 Codex OAuth 体系

如果你现在靠的是 Codex 授权,那能用的是 openai-codex/gpt-5.4,不是 openai/gpt-5.4。

这不是字符串小细节,是路由和认证能不能打通的分界线。

最后定下来的配置

这次最终采用的顺序是:

{"primary":"quotio-local/claude-opus-4-6","fallbacks":["openai-codex/gpt-5.4","anthropic/claude-opus-4-6"]}顺序从高到低是:

quotio-local/claude-opus-4-6openai-codex/gpt-5.4anthropic/claude-opus-4-6

为什么这样排?

很简单。

本地代理最稳,就让它先接 Codex 的 GPT-5.4 可用,就放第二层 Anthropic 还会撞限流,就留在最后兜底

这样一来,请求默认走成功率最高、等待时间最少的路。

这才像一个正常的 primary。

配置改哪里

主配置文件在:

~/.openclaw/openclaw.json模型优先级路径在:

agents.defaults.model这次相关的几个关键位置:

主模型配置: agents.defaults.modelprovider 配置: models.providers认证配置: auth.profiles审计日志: ~/.openclaw/logs/config-audit.jsonl

如果你用的是自定义 provider,还要确认:

{"models":{"mode":"merge"}}没有这个,自定义 provider 的模型可能压根不会进可用列表。

为什么"直接把 Anthropic 换掉"不是这次最好的说法

这次其实讨论过三个方案。

方案 A:直接把本地代理设成默认模型

最省事。

问题是说法太粗。它更像"换默认模型",没有把 fallback 顺序这个根因讲清楚。

方案 B:把稳定链路排到 Anthropic 前面

这次最终选的就是这个。

因为它保留了 fallback 结构,也把真实成功路径放到了前面。

配置逻辑更干净。

方案 C:做更聪明的 circuit breaker

比如检测到 429 之后,短时间内自动跳过 Anthropic。

这个方向当然更高级。

问题也很现实:复杂度上去了,收益不一定比"把顺序先排对"更高。

很多时候,工程上最好的方案不是最花哨的那个,是先把最蠢的浪费拿掉。

什么时候该把"最强模型"放到后面

这件事值得单独说。

很多人配模型时会本能地把"最贵、最强、最官方"的那个放在第一位。听上去有道理。

但网关配置不是选秀。

你要看的不是品牌,而是这三个问题:

这条链路今天稳不稳? 它会不会让每次请求都先空转一轮? 它失败之后,切走要不要付明显的时间成本?

只要答案不理想,它就不该放 primary。

至少不该在你当前这套工作流里放 primary。

常见坑

1. 报 model not allowed

这次改路由时,还碰到过一条报错:

GatewayRequestError: model not allowed: quotio-local/gpt-5.4这类问题通常不是模型真的不存在,而是网关还没按你以为的方式重新解析 provider。

先检查名字是不是写对了。

再检查 provider 和 model 的组合是不是本来就存在。

还不对,就重启 gateway。

2. 配置改了,但行为没变

热加载不一定每次都老实。

尤其是你动了 provider、auth profile、模型路由这几块之后,重启一次 gateway 往往比盯着旧状态猜半天更省时间。

3. 以为 ChatGPT Plus 可以直接顶 OpenAI API

不行。

这次最容易误判的点就是这个。

如果你想走 openai/gpt-5.4,要的是 API key 和对应权限,不是 ChatGPT Plus 订阅。

一个更实用的日常思路

如果你现在也在跑多 provider,我建议按下面这个顺序想:

日常主力链路

选你最稳定、最快、最少报错的那条。

别先谈情怀,先谈成功率。

第二层兜底

放认证明确、调用稳定、质量也够用的模型。

这次就是 openai-codex/gpt-5.4。

最后一层兜底

放你知道"能救命,但不适合每次先上"的那条。

这次就是 Anthropic 官方。

这么排完之后,整套系统会顺很多。

不是模型更强了,是少浪费了。

一句话记住这次排障

fallback 的价值,不在于你写了几个候选项,而在于默认请求是不是先走了那条最容易成功的路。

如果官方 provider 现在老是先把你拖慢一轮,就别让它站在第一位。

把稳定的放前面。把容易限流的放后面。配置立刻就会诚实很多。

参考链接

OpenClaw 配置文件: ~/.openclaw/openclaw.json配置审计日志: ~/.openclaw/logs/config-audit.jsonl

全网首发?第一款 GLM 4.7 + Claude Code AI 自主开发的心宠纽带 App 首次通过 App Store 审核并上架发布

智谱 GLM 4.7 模型 AI 自主开发 HeartBetBond 心宠纽带 App,从想法到提交 App Store 仅用 12 天

实战测评:用 Claude Code + BMAD + GLM-4.7 打造 HeartPetBond App (心宠纽带)

加入 AI灵感闪现 微信群

长按下图二维码进入 AI灵感闪现 微信群

长按下图二维码添加微信好友 VibeSparking 加群

关注 AI灵感闪现 微信公众号

夜雨聆风

夜雨聆风