高昂token的优化策略

前言

OpenClaw是一款开源AI智能体工具,其图标设计为红色龙虾,因此在技术社区中被昵称为"龙虾" 。作为一个开源的AI智能体平台,OpenClaw具备自主执行任务、承担流程操作、持续学习成长的能力,被业界视为"数字员工"的典型代表。

从技术架构层面分析,OpenClaw的核心价值在于将大语言模型的推理能力转化为本地系统操作,实现自动化任务处理。它能够接入大语言模型进行思考和指令理解,并实际操作计算机上的软件系统,适用于办公自动化、软件开发、数据处理等多种场景。

OpenClaw这么好,为什么月薪两万都养不起龙虾?

OpenClaw的成本并不在软件本身,而在背后的模型调用。它天生就是一个“Token黑洞”,每执行一个任务,都要消耗大量Token与后端大模型交互,一旦任务链拉长、工具调用增多、记忆开启,消耗会迅速抬升。

普通Chatbot聊一个来回只需几百Token;而OpenClaw执行同样的任务,可能需要几百万Token。有用户反映,搜索信息、写一篇2000字文档可烧掉700万Token;运行一个简单爬虫测试竟耗费2900万Token;单日烧掉5000万Token的案例屡见不鲜。

更隐蔽的是OpenClaw内置的“心跳机制”——即便在无实际产出的情况下,系统每天仍会自动消耗约145元的调用费,折算下来月均损耗超5000元

Token是什么?

Token是OpenClaw使用过程中最核心的持续开销,被用作AI处理、生成信息的"计价单位" 。Token被比喻为AI智能体处理任务时使用的"通用燃料" 。每一次输入、输出、调用工具、处理任务、读取历史消息、记忆维护、心跳检查等操作都会消耗Token。OpenClaw以"开源免费"的标签吸引大量用户,但实际使用中,用户面临着持续且高昂的Token消耗成本 。这一矛盾就充分体现了"开源不等于免费"的核心问题。

Token这么烧钱,可以优化吗?

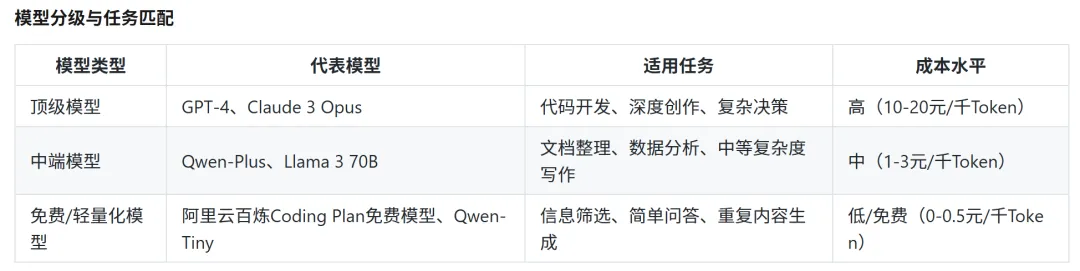

1、Token优化的核心原则在于理解Token的消耗去向,并让"对的模型干对的事" 。这一原则体现了精细化管理的思想,要求用户深入分析自身的使用场景和需求,针对性地选择优化策略。

2、模型分级策略:不同任务匹配不同模型,拒绝”一刀切”。

3、上下文管理优化

包括:定期清理历史对话,限制上下文长度,禁用非必要上下文继承。

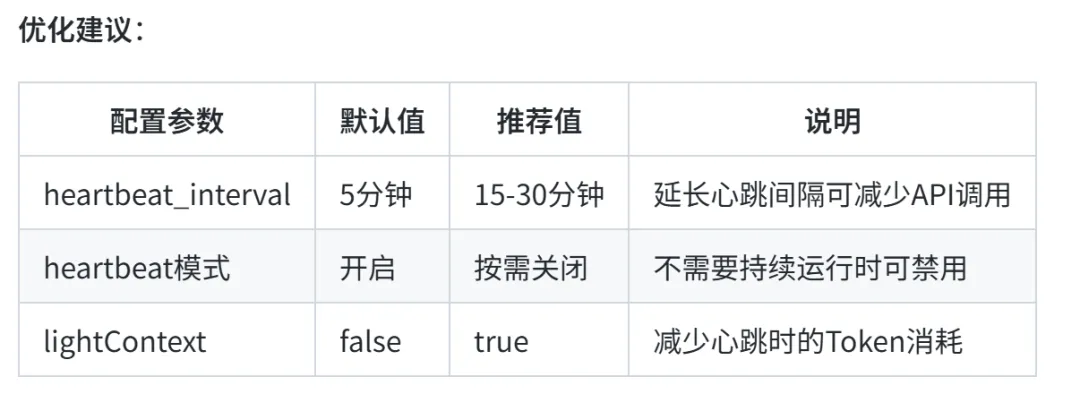

4、心跳机制调优

延长心跳间隔:将默认的五分钟调用间隔调整为三十分钟甚至一小时;

配置文件设置:在配置文件中将heartbeat_interval设置为更高值(如300000毫秒即5分钟,建议更长;

禁用不必要功能:关闭邮件/日历检查等不必要的默认功能;禁用默认的"Thinking"模式,仅在必要时开启。

使用轻量上下文:启用 lightcontext:true减少心跳时的Token消耗;

5、套餐选择

考虑"次数包月"套餐,避免按Token计费的不确定性。

选择按调用次数计费而非Token计费的套餐。

6、提示词精简

删除冗余或不必要的系统提示词(System Prompt),减少每次调用的固定开销。

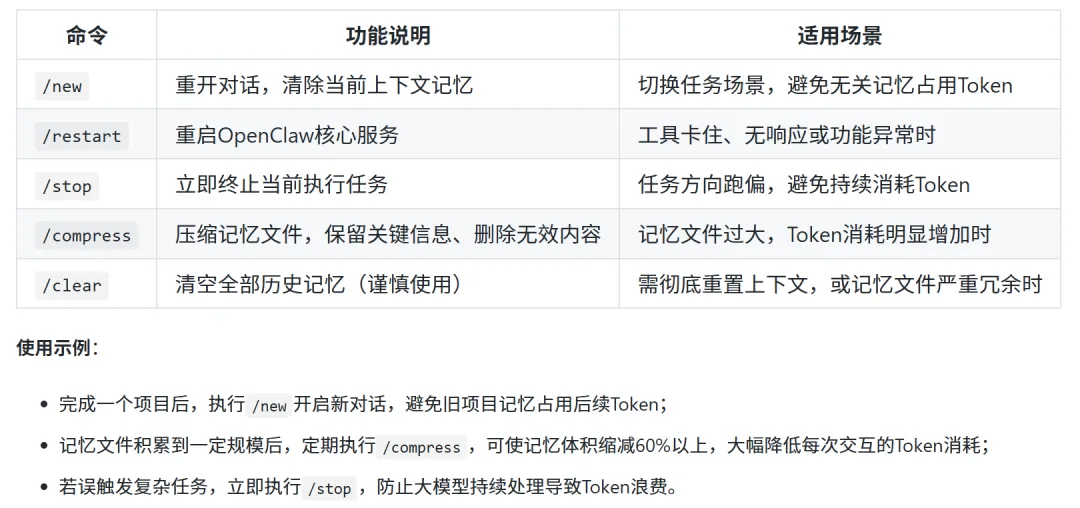

7、善用斜杠命令:绕过大模型,零Token消耗

OpenClaw内置多个特殊斜杠命令,这些命令直接与程序底层交互,无需经过大模型处理,因此不消耗任何Token,是控制成本的基础技巧,建议熟练掌

握:

8、本地部署

持续调整和优化

Token优化不是一次性工作,而是需要根据使用情况持续调整和优化的过程。

如果你还有好的Token优化建议,请在评论区留言,相互交流,共同成长!

让我们一起,从社区AI课堂开始,拥抱人工智能。

夜雨聆风

夜雨聆风