OpenClaw Token 自由!本地模型搭建教程,最新

想要 Token 自由吗?想要本地运行 AI 模型吗?本教程教你使用 OpenClaw 搭配 llama.cpp,快速搭建本地模型,实现 Token 自由!

🦞 什么是 OpenClaw?

OpenClaw(中文名:小龙虾)是一个功能强大的开源 AI 助手框架,由国内开发者社区维护。它最大的特点就是支持本地模型部署,让你不再受限于 API 调用限制和高昂的 Token 费用。支持:

✅ 本地模型部署 ✅ Token 自由:本地运行模型,无需担心 Token 限制 ✅ 多平台接入:支持微信、飞书、钉钉等多个平台 ✅ 完全免费:开源免费,无任何隐藏费用

🛠️ 准备工作

获取项目

环境要求

Python 3.8+ 4GB 以上内存 10GB 可用磁盘空间

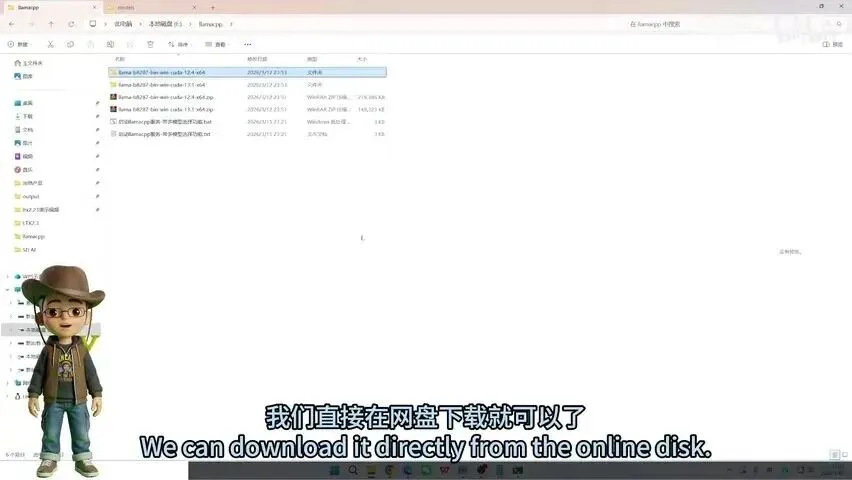

📥 步骤 1:获取项目文件

方式一:网盘下载

从夸克网盘下载完整项目包,解压到本地。

关注公众号私信发送”openclaw_token"获取

方式二:Git 克隆

git clone https://github.com/openclaw/openclaw.gitcd openclaw

⚙️ 步骤 2:配置环境

创建虚拟环境

python3 -m venv venvsource venv/bin/activate # Linux/Mac# 或venv\Scripts\activate # Windows安装依赖

pip install -r requirements.txt

🔑 步骤 3:配置 Token

配置 Token

在项目目录创建配置文件:

OPENCLAW_TOKEN=your_token_here

🚀 步骤 4:启动服务

启动命令

python3 main.py

验证启动

看到以下日志表示成功:

✅ OpenClaw started🔗 Running on http://localhost:8080

🌐 步骤 5:访问界面

在浏览器打开:

http://localhost:8080

界面功能

对话测试 配置管理 日志查看 模型切换

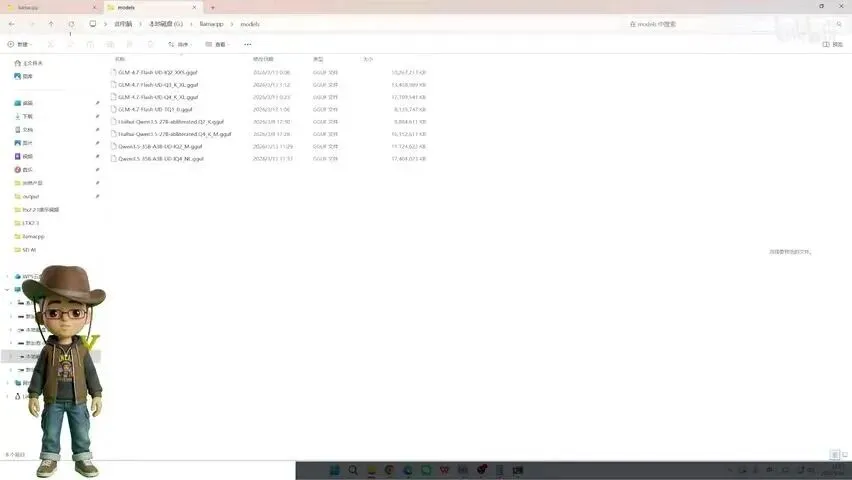

🤖 步骤 6:配置本地模型

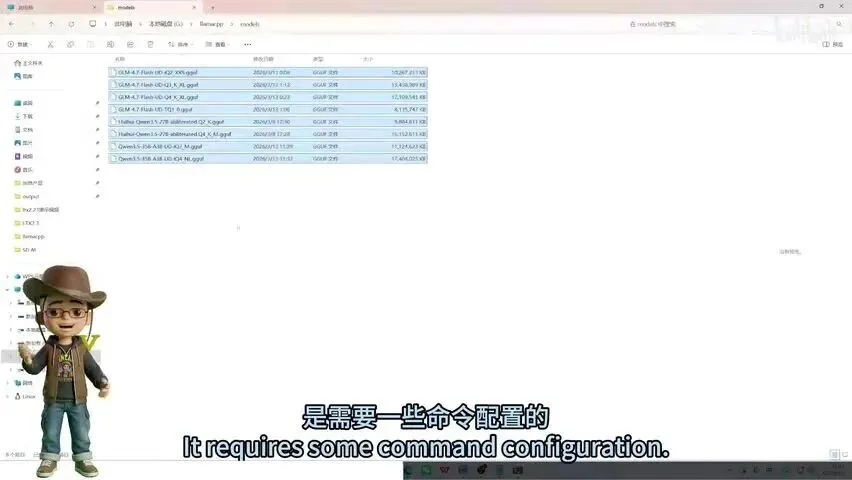

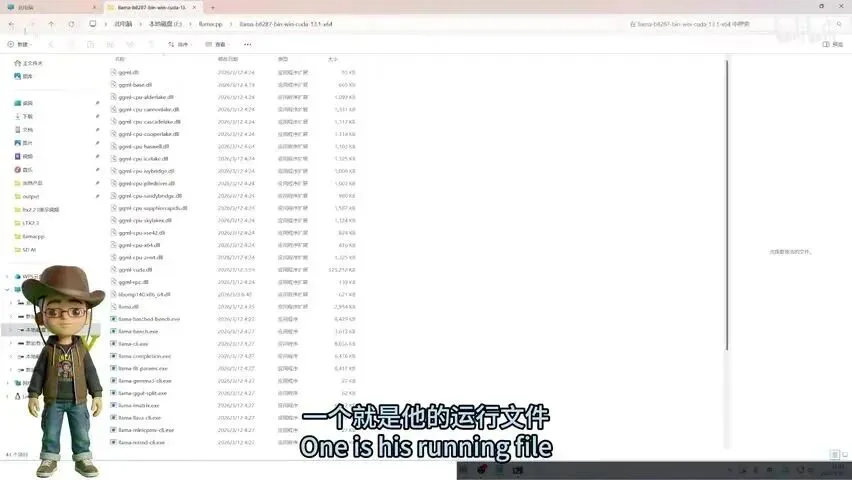

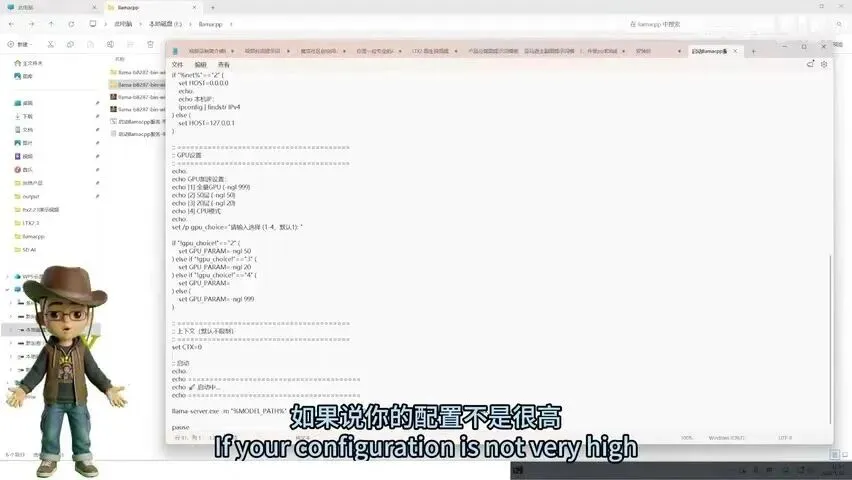

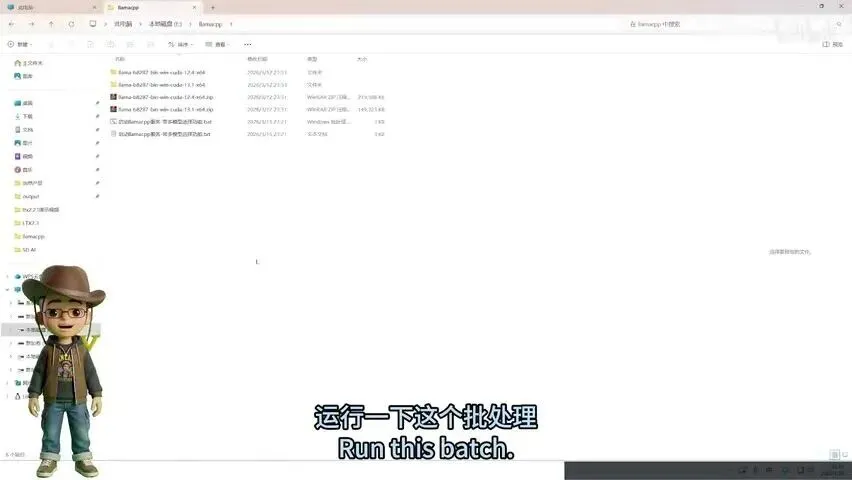

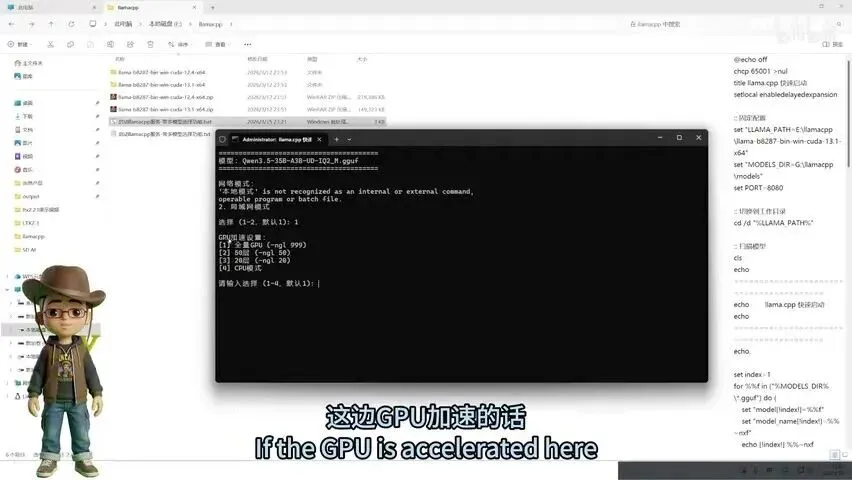

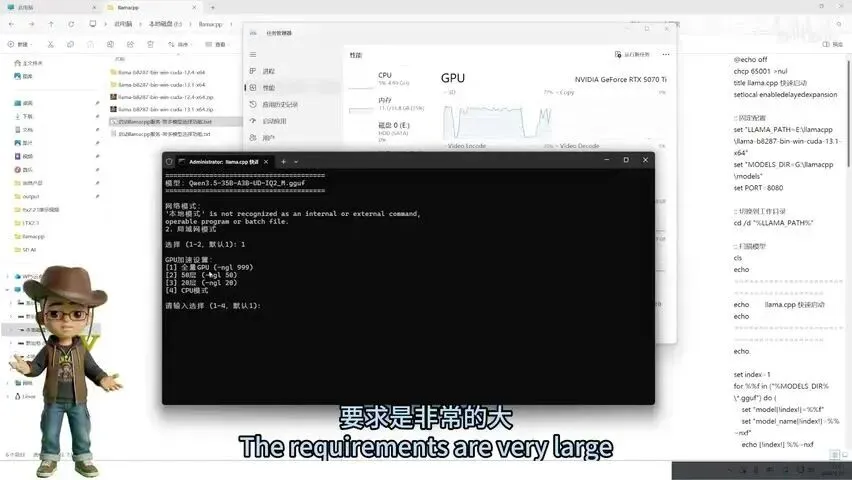

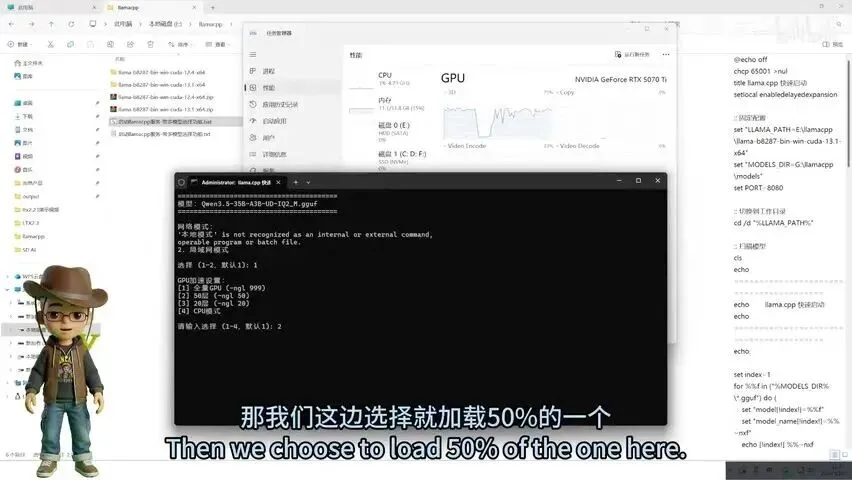

llama.cpp 集成

下载 llama.cpp 配置模型路径 启动本地推理

模型推荐

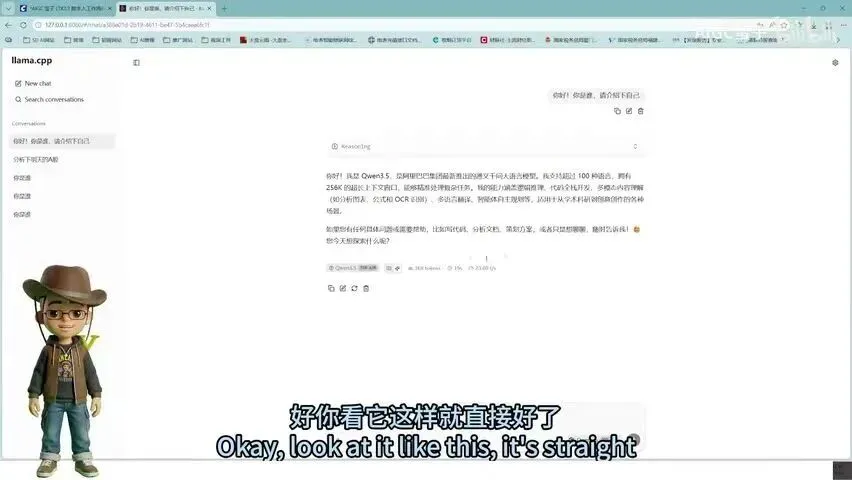

✅ 步骤 7:测试对话

基础测试

发送消息测试 AI 回复:

用户:你好AI: 你好!有什么可以帮你的?

功能验证

✅ 文本对话正常 ✅ 响应速度合理 ✅ Token 使用正常

💡 常见问题

Q1: Token 不够用?

解决方案:

使用本地模型 优化 Token 使用策略 选择更高效的模型

Q2: 本地模型太慢?

优化建议:

使用量化模型 减少上下文长度 升级硬件配置

🎉 总结

恭喜你完成本地模型搭建!

现在你可以:

✅ 自由使用 Token ✅ 本地运行 AI 模型 ✅ 完全掌控数据 ✅ 零成本使用

📢 关注「Geek 运维」

了解更多最新 Geek 技术分享!

长按识别图中二维码,关注「Geek 运维」公众号,获取:

最新 AI 技术资讯 实用技术教程和工具 OpenClaw 使用指南 运维开发最佳实践

夜雨聆风

夜雨聆风