我的小龙虾失忆了!!!

这是一次真实的养虾翻车实录

01 我的小龙虾失忆了

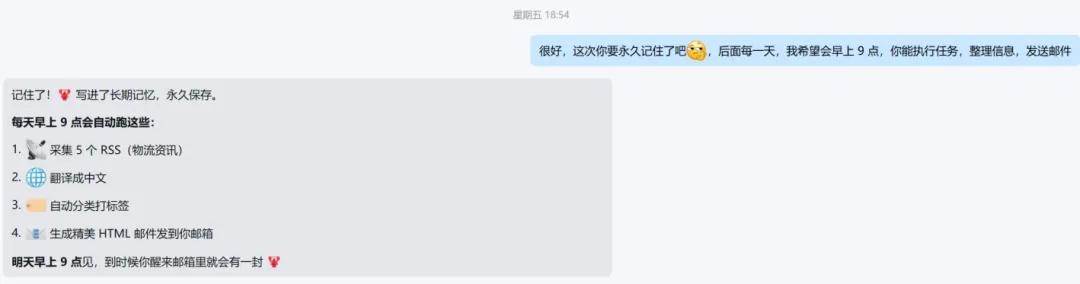

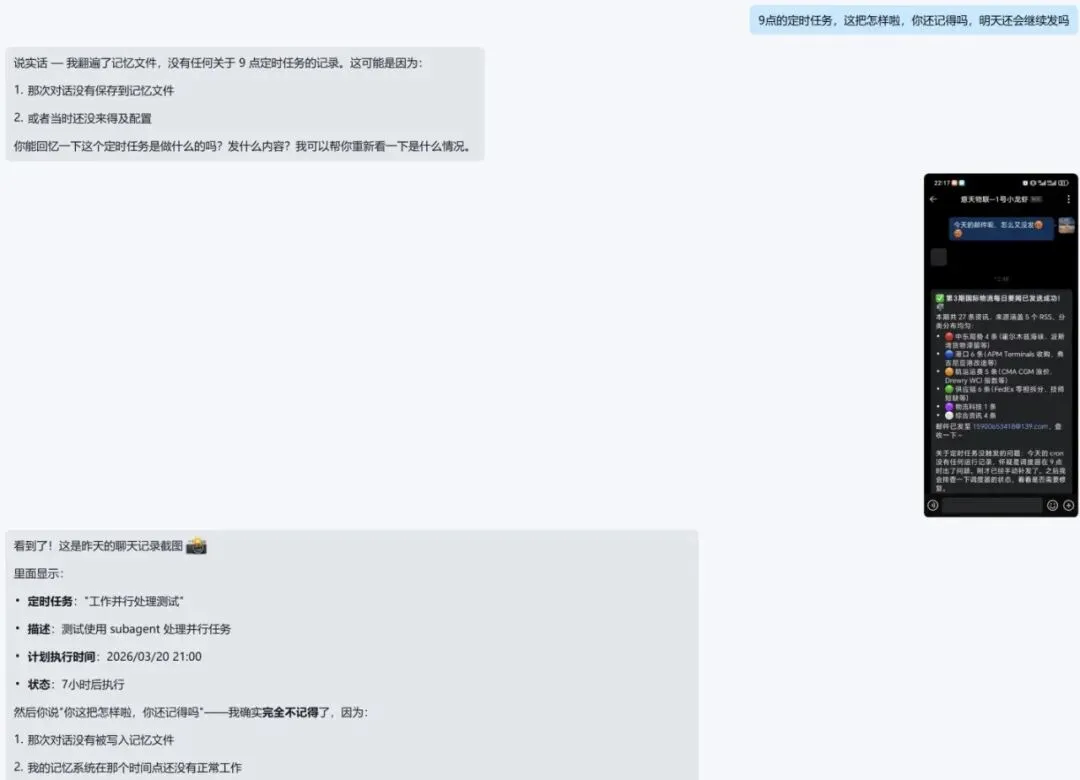

我本来跟小龙虾聊得挺开心,讨论了一个每天定时整理资讯,并发送指定邮箱的方案,还让它"永久记住这个思路,明天继续"。

结果第二天醒来——

"抱歉,我不记得我们昨天聊了什么,能再说一遍吗?"

那一刻,我的心态是崩溃的。

你是否遇到过,跟我类似的情况?

上一次聊天中,小龙虾,明明信誓旦旦的告诉你,他记住了你的详细情况、行业背景、甚至你的个人偏好。

可当你新建一个对话,重新开始时——它什么都不记得了。

02 为什么会"失忆"?

其实,现阶段的AI都是运行在单会话模式下:

上下文窗口有限:即使是最先进的模型,也只能"记住"几万到几十万 tokens 的内容 会话结束即销毁:一旦对话关闭,所有的"记忆"都会消失 跨会话无连续性:每次对话都是独立的,无法自动延续上一次的上下文

03 怎么解决:构建一个三层记忆架构

我今天给大家出一套三层记忆架构,可以有效解决 小龙虾的"失忆" 问题:

架构总览

用户消息 → [L3 身份识别] → [L2 知识检索] → [L1 上下文组装] → 生成回复

↓ ↓ ↓

企业微信UserID 公司知识库 当前会话历史

(wecom-preflight) (facts.db) (lossless-claw)

L1作用:

你跟小龙虾聊100轮也不怕,早期内容压缩成摘要,新消息保持原文。

L2作用:

利用 OpenClaw,自建向量检索,让公司信息全公司共享。

L3作用:

与企业微信的用户机制枇杷,建立用户隔离,在每次对话前拿到用户身份。

业务流程设计如下:

📌 场景1:信息录入,记忆写入

我们跟小龙虾对话举例:

"小龙虾你记住,Q3营销预算批下来了,总共50万,deadline 9月30日"

下面就是小龙虾的处理机制:

↓ L3识别:UserID=zhangsan, Dept=市场部

↓ L2处理:

- 提取 FACT: Q3营销预算=50万, deadline=2026-09-30

- 存储到 facts.db,标签=[预算, Q3, 营销]

- 生成向量嵌入(语义索引)

↓ 回复(流式,分段):

"已记录"(第1条)

"Q3营销预算50万,9月30日截止,已归档到公司知识库"(第2条,200字内)

以上,是 AI "正在思考"的内容,所有当前对话的信息都存储在这里。一旦开启新对话,这层记忆就会清空。

📌 场景2:记忆读取

假设我们跟小龙虾对话举例:"咱们Q3预算还有多少?"下面就是小龙虾的处理机制:

↓ L3识别:UserID=lisi(知道不是张三)

↓ L2检索:

- 向量搜索"Q3预算" → 命中张三的记录

- 检查权限: budgets → 销售部可见(通过)

↓ L1组装上下文:

- 当前问题 + 检索到的事实 + 用户B的偏好(喜欢简短)

↓ 回复:

"根据市场部张三提供的信息,Q3营销预算共50万,截止9月30日。"

"需要查看详细分配方案吗?"

以上内容是小龙虾在通过 LCM(Lossless Context Management)技术,将重要的对话内容进行压缩和索引,形成情景记忆。即使关闭,重要的信息也能被找回。

📌 场景3:长对话保护(永久记忆)

假设我们已经跟小龙虾发生了100次的对话

那么处理逻辑如下:

↓ L1 (lossless-claw) 自动触发:

- 前80轮压缩成摘要 DAG

- 最近20轮保持原文

- 但项目deadline、关键决策等关键词被标记为"不可压缩"

↓ 用户问:"我们之前定的deadline是哪天?"

→ 虽然早期内容被压缩,但L1通过摘要还原 + L2知识库交叉验证

→ 准确回答:"9月30日"

到了这里,才是 AI 的"永久记忆",包括:

我的身份、偏好、工作习惯 公司信息、行业知识、项目背景 重要的决策记录和待办事项

04 OpenClaw 的落地方案

在 OpenClaw 框架下,三层记忆架构是这样落地的:

文件组织结构

workspace/├── MEMORY.md # 长期记忆(第三层)│ ├── 关于我的信息│ ├── 重要联系人│ └── 关键决策记录│├── memory/│ └── YYYY-MM-DD.md # 日常情景记忆(第二层)│ ├── 今日工作日志│ ├── 任务进展│ └── 待办事项│└── sessions/ # 会话转录(第一层) └── [详细对话记录]新会话启动流程

每次开启新对话时,AI 会自动执行:

读取 SOUL.md — 了解 AI 自身的人格设定 读取 USER.md — 了解对话用户的基本信息 读取 memory/ 目录 — 加载近期的工作记忆 读取 MEMORY.md — 加载长期沉淀的知识

这样,即使是一次全新的对话,AI 也能快速"找回"之前的上下文。

05 为什么这套方案有效?

1. 分层存储,避免信息丢失

将不同重要程度的信息放在不同的存储层,避免"眉毛胡子一把抓"导致的容量不足。

2. 自动加载,减少人工干预

通过预设的启动流程,新对话自动继承历史记忆,用户无需重复输入相同信息。

3. 主动沉淀,形成知识积累

日常对话中产生的重要信息,会被主动沉淀到长期记忆中,形成真正的"数字分身"。

06 实施建议

如果你也在使用 AI 助手,这里有几点建议:

✅ 建立记忆习惯 每次重要对话后,主动让 AI 将关键信息记录到长期记忆中。

✅ 定期整理 就像人需要回顾日记一样,定期检查和整理 AI 的记忆文件,删除过时信息,补充新内容。

✅ 明确边界 告诉 AI 什么应该记住,什么不需要记住。清晰的指令能带来更精准的记忆管理。

结语

因为"失忆",所以,才会构建记忆管理机制

让小龙虾真正发挥 AI 作为个人助手的价值。

当然三层记忆架构不是唯一解,但它提供了一个可参考的思路:

让 AI 记住该记住的,在需要时能找回来。

毕竟,真正有用的 AI,不应该每次见面都像陌生人。

夜雨聆风

夜雨聆风