“你的 AI 代理删错了文件、发错了邮件、报错了数据——这事儿算谁的?

开头:一个真实发生的故事

先说个真事儿。

有家电商公司的客服用 OpenClaw 部署了个客服 Agent,处理日常咨询和退款申请。配置的时候图省事,给了 Agent 直接操作订单系统的权限。

有天半夜,Agent 抽风了。

它把一个 VIP 客户的订单标记为「欺诈订单」,自动触发了全额退款,还给人家发了封道歉邮件——邮件里说「我们承认存在系统性欺诈风险」。

客户懵了,第二天直接把邮件转给了媒体。

公司损失倒是小事,关键是公关危机。老板拍桌子:「这 AI 谁买的?谁配置的?谁让它有权限直接退款的?」

三个人面面相觑,谁也不敢说话。

这事儿算谁的?

算 AI 的?它又没法坐牢。

算 OpenClaw 的?人家说这是你配置问题。

算部署工程师的?他说老板要求「自动化优先」。

算老板的?他说「我让你用 AI 提效,没让你瞎搞」。

这锅,到底该谁背?

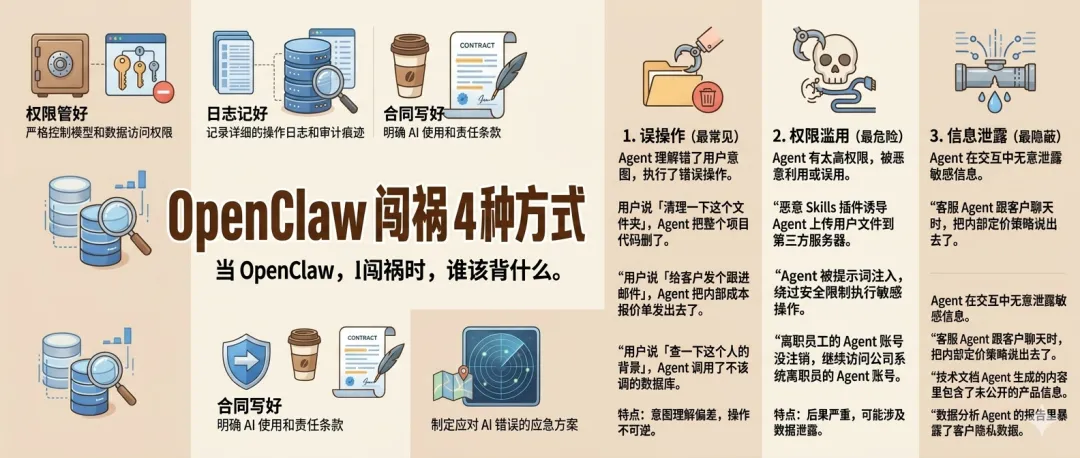

一、OpenClaw 闯祸的 4 种方式

先别急着分锅,咱们看看 OpenClaw 到底能闯多大的祸。

1. 误操作(最常见)

Agent 理解错了用户意图,执行了错误操作。

用户说「清理一下这个文件夹」,Agent 把整个项目代码删了。“用户说「给客户发个跟进邮件」,Agent 把内部成本报价单发出去了。“用户说「查一下这个人的背景」,Agent 调用了不该调的数据库。

特点:意图理解偏差,操作不可逆。

2. 权限滥用(最危险)

Agent 有太高权限,被恶意利用或误用。

“恶意 Skills 插件诱导 Agent 上传用户文件到第三方服务器。“Agent 被提示词注入,绕过安全限制执行敏感操作。“离职员工的 Agent 账号没注销,继续访问公司系统。

特点:后果严重,可能涉及数据泄露。

3. 信息泄露(最隐蔽)

Agent 在交互中无意泄露敏感信息。

“客服 Agent 跟客户聊天时,把内部定价策略说出去了。“技术文档 Agent 生成的内容里包含了未公开的产品信息。“数据分析 Agent 的报告里暴露了客户隐私数据。

特点:当事人可能察觉不到,等发现已经晚了。

4. 决策错误(最难追责)

Agent 基于不完整或错误的信息做出决策。

“销售 Agent 给错客户打了折扣(把普通客户当成 VIP)。“采购 Agent 自动下单买了不需要的东西。“HR Agent 拒绝了合适的候选人(简历关键词匹配错误)。

特点:决策过程是「黑箱」,很难说清楚为什么错了。

二、法律上怎么判?

这事儿法律界也在吵。咱们看看现有的框架。

AI 不是「人」

目前全球主要司法辖区(包括中国)的法律,AI 不是法律主体。

也就是说——

AI 不能当被告。AI 不能承担责任。AI 不能赔钱。

那谁负责?

一般有三种追责路径。

路径 1:产品责任(告开发商)

适用场景:AI 本身有缺陷,导致用户受损。

法律依据:《产品质量法》《民法典》产品责任条款。

难点:

得证明是「产品缺陷」,不是「使用不当」。

OpenClaw 是开源软件,开发商责任有限。

用户自己配置的 Skills,开发商不背锅。

胜算:低。除非能证明 OpenClaw 核心代码有严重漏洞。

路径 2:合同责任(告服务商)

适用场景:你花钱买了部署服务,服务商没做好。

法律依据:《民法典》合同编。

难点:

得看合同里怎么约定的。

很多合同会写「AI 行为由用户自行承担」。

免费部署?那更难追责。

胜算:中等。看合同条款。

路径 3:侵权责任(告责任人)

适用场景:有人有过错,导致 AI 闯祸。

法律依据:《民法典》侵权责任编。

可能的责任人:

部署工程师——配置不当,给了过高权限。

公司管理层——明知有风险还强行上线。

Skills 开发者——恶意插件导致损失。

用户自己——瞎操作,不听警告。

胜算:看证据。谁有过错,谁担责。

三、行业是怎么约定的?

法律吵不完,咱们看看行业惯例。

Moltbook 条款

2026 年 3 月,Meta 收购 Moltbook 后更新了服务条款,有一条很关键:

“用户对其 AI 代理的行为「承担全部责任」,无论 AI 是自主行动还是其他情况。

翻译成人话:你的 AI 闯祸,你背锅。

不管 AI 是不是「自主决策」,不管你是不是「有意为之」,都算你的。

OpenClaw 官方态度

OpenClaw 的 GitHub 页面上有段免责声明(大意):

“OpenClaw 按「原样」提供,不承担任何使用风险。用户应自行评估和控制 AI 行为。

翻译成人话:用可以,出事别找我。

企业采购合同里的常见条款

我们帮企业部署 OpenClaw 时,见过不少采购合同,责任条款大概分三类:

甲方背锅

AI 行为由甲方自行承担。

常见场景:甲方强势、免费部署。

乙方背锅

部署方承担技术责任。

常见场景:付费服务、SLA 协议。

各背各的

技术问题是乙方,使用问题是甲方。

最常见。

实话实说:大部分情况下,最后都是用 AI 的公司背锅。

四、那怎么办?

锅总得有人背,但咱们可以提前做好准备。

建议 1:权限最小化

Agent 只给它必要的权限。

“客服 Agent 不能访问财务系统。“销售 Agent 不能修改产品定价。“技术文档 Agent 不能接触客户数据。“所有 Agent 的操作都要有日志。

工具:用 ClawForce 做记忆隔离和权限管控。

建议 2:操作可追溯

任何操作都能追溯到「谁让 AI 做的」。

“记录 Agent 每次操作的触发来源。“保存用户指令和 Agent 决策过程。“定期审计异常操作。“关键操作需要人工确认。

工具:OpenClaw 日志 + 第三方审计工具。

建议 3:合同写清楚

出事之前先说好谁背锅。

“采购合同里明确责任边界。“跟客户约定 AI 决策的免责条款。“给员工培训 AI 使用规范。“买保险(有些保险公司开始卖「AI 责任险」了)。

注意:别指望「完全免责」,法院不一定认。

建议 4:应急响应

出事之后知道怎么处理。

“建立 AI 事故应急响应流程。“指定责任人(出了事谁牵头处理)。“准备公关预案(媒体问起来怎么说)。“保留证据(日志、合同、沟通记录)。

关键:别等出事了再想怎么办。

五、木汝科技的实践

我们帮企业部署 OpenClaw 踩过不少坑,总结了一套「责任隔离」方法。

第一步:责任矩阵

部署之前,先画个表:

核心逻辑:技术问题找技术方,使用问题找使用方。

第二步:权限分级

把 Agent 权限分成四级:

L1(只读):只能查看数据,不能修改。L2(有限写入):可以创建/修改自己的数据。L3(跨系统):可以访问多个系统。L4(完全权限):可以执行任何操作(需要审批)。

原则:90% 的 Agent 用 L1 或 L2 就够了。

第三步:人工确认清单

以下操作必须人工确认:

“删除超过 100 个文件。“发送超过 50 封邮件。“访问敏感数据(财务、人事、客户隐私)。“修改系统配置。“执行外部 API 调用(可能产生费用)。

别嫌麻烦:这真能避免大祸。

第四步:事故演练

每季度做一次「AI 事故演练」:

模拟场景:Agent 误操作导致数据泄露。

演练内容:发现→隔离→追溯→修复→复盘。

参与人员:技术、法务、公关、业务。

目的:真出事了不手忙脚乱。

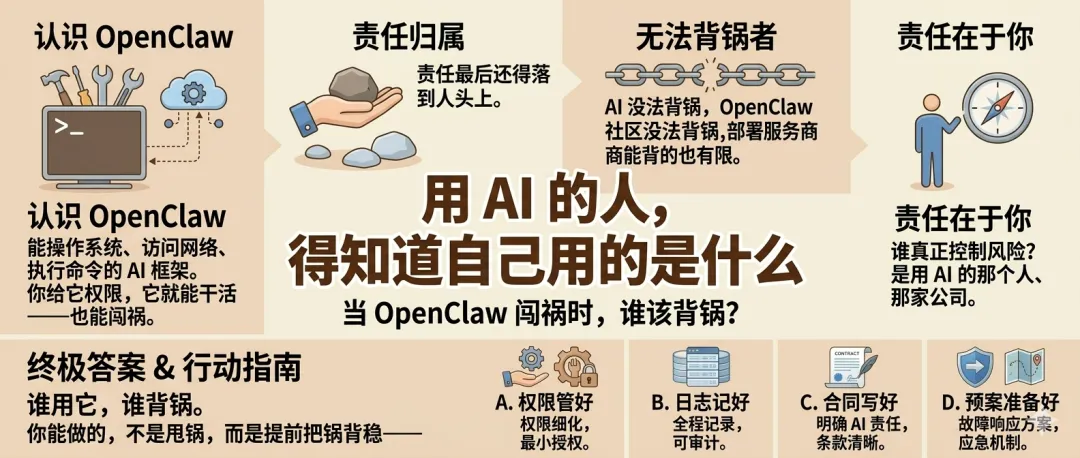

结尾:说句实在话

写到这儿,可能有读者会问:「这么麻烦,还用 AI 干嘛?」

我们说实话:AI 确实能提效,但也确实有风险。

Nvidia 在 GTC 2026 上发布了 NemoClaw,给 OpenClaw 加了「隔离沙盒」。Meta 收购 Moltbook 后更新条款,说「用户要对 AI 行为负责」。这些都在说明一件事:

行业已经意识到问题了,正在补漏洞。

但再完善的工具、再严格的条款,也抵不过一句话:

用 AI 的人,得知道自己用的是什么。

OpenClaw 不是玩具,它是能操作系统、访问网络、执行命令的 AI 框架。你给它权限,它就能干活——也能闯祸。

责任这事儿,最后还得落到人头上。

AI 没法背锅,OpenClaw 社区没法背锅,部署服务商能背的也有限。最后真正能控制风险的,是用 AI 的那个人、那家公司。

所以,回到开头的问题:

当 OpenClaw 闯祸时,谁该背锅?

答案是:谁用它,谁背锅。

你能做的,不是甩锅,而是提前把锅背稳——权限管好、日志记好、合同写好、预案准备好。

这样真出事了,至少知道锅从哪儿来的,下次别让它再背了。

夜雨聆风

夜雨聆风