最近很多人在聊 OpenClaw,兴奋点大多集中在 Agent、自动化工作流、多入口协作这些新奇的能力上。

但我越用越觉得,OpenClaw 真正厉害的地方,根本不是它塞给了你多少个牛逼的 Agent。而是它像一面镜子,逼你直面一个极其底层的硬伤:

如果没有一套统一的、可持续调用的“上下文系统”,Agent 根本跑不长。

这件事,在过去并不明显。因为我们人类太擅长“脑补”了。

你知道自己是谁、最近在忙什么、哪个项目最要紧、哪些坑已经踩过。哪怕这些信息像碎片一样散落在微信聊天、备忘录、文档甚至你的脑子里,只要一转念,你也能勉强把它们拼凑起来。

但 Agent 不行。

当你真的开始把核心任务交给 OpenClaw,让它在 CLI 里跑代码、在 IDE 里接手项目,或者在手机和电脑间来回切换时,你很快就会受挫。

你发现问题不在于 AI 不够聪明,而是你的上下文,根本没有被组织成一个它能持续调用的系统。

1. 暴露问题的,才是好系统

很多工具的价值,表面看是提供新能力;但真正厉害的系统,往往是先暴露你的旧问题。

OpenClaw 就是典型的后者。

如果你只把它当成一个“高级点的对话框”,它当然很好用。可一旦你让它处理连续任务,立刻就会撞上一堵无形的墙:

• 今天,你在 IDE 里让它改了一段代码。

• 明天,你想在 CLI 里让它顺着排查同一个 bug。

• 后天,你希望它结合云盘里的历史文档、项目背景,重新写一份执行方案。

这时候你会痛苦地发现:一个 Agent 能不能真正进入状态,靠的根本不是“单次回答有多聪明”,而是它能不能拿到同一套稳定、连续、可复用的上下文。

没有这套东西,Agent 每次面对你都像第一天入职的新人。它不是不能干活,而是永远只能干到一半,然后停下来等你喂信息。

所以,OpenClaw 真正逼你看到的现实是:你的信息系统,根本还没准备好给 AI 长期使用。

2. 为什么一用 Agent,上下文就成了硬门槛?

过去我们搞“知识管理”,核心诉求就俩词:保存和搜索。

我记下来没?存哪里了?以后要用还能不能搜到?

但在 Agent 时代,游戏的玩法变了。

Agent 不是人,它看见几个关键词,不会自动脑补出背后的江湖恩怨;它也天然不知道“这份文档”和“上周你的那个判断”其实属于同一条业务线。

你不给它结构化、可调用的上下文,它就只能像个近视眼一样,基于当前对话框里的那点破事儿做局部反应。

所以,一旦认真用起 Agent,真正的门槛就不再是模型能力,而是你的上下文质量。

这里的“上下文”,绝不是扔给它几段聊天记录,或者一整个塞满垃圾文件的文件夹。它至少要能清晰地回答 AI 这几个问题:

• 你是谁?你长期在解决什么核心问题?

• 当前这个任务,属于哪个项目?优先级是什么?

• 历史库里,哪些信息和这次任务真正相关?

• 绝对不能碰的规则、偏好和边界是什么?

如果这些信息没有被提前组织好,Agent 再强,也只能零敲碎打。

这也就是为什么,很多人总觉得 AI 明明越来越强了,但自己用起来还是那么累——总在重复解释、重复切换、重复从零开始。

不是工具不够多,而是底层没有统一的上下文。

3. 个人 OS:从“知识库”到“上下文系统”

这是我最近越来越确信的一个判断:

知识管理解决的是“保存”,而个人 OS(操作系统)解决的必须是“持续调用”。这两者,完全不在一个层级。

传统知识管理服务的对象,本质上是“未来的自己”。所以很多人的笔记软件,最后都沦为一个塞满文章但几年不看一次的“赛博废品收购站”。

但在 AI 时代,光做到“能找到”已经不够了。你现在要面对的是:

• 任务发生时,OpenClaw 能不能瞬间调用到关键背景?

• CLI 跑出来的有效结果,能不能立刻沉淀成下一次的上下文?

• 跨设备切换时,系统还能不能保持唯一的“真相源”?

个人 OS 不该再围绕“资料堆积”来设计,而必须围绕“上下文调用”来重建。

它不再是一个静态的仓库,而是一套让你和 Agent 共用底层事实的系统。

这也是为什么,你必须开始在意那些以前觉得无所谓的技术细节:多设备怎么同步?目录结构怎么做才稳定?哪些信息值得做 Embedding?哪些内容应该被 Recall 到当前任务里?

因为核心问题只有一个:你的知识,能不能被顺畅地持续调用,而不只是被偶尔想起?

4. 冲突吗?OpenClaw 的记忆 vs 你的个人 OS

肯定有人会问:既然 OpenClaw 自己就有记忆和上下文能力,我还费劲搭什么个人 OS?是不是多此一举?

我的答案是:不仅不冲突,而且缺一不可。前提是你要把“分层”做清楚。

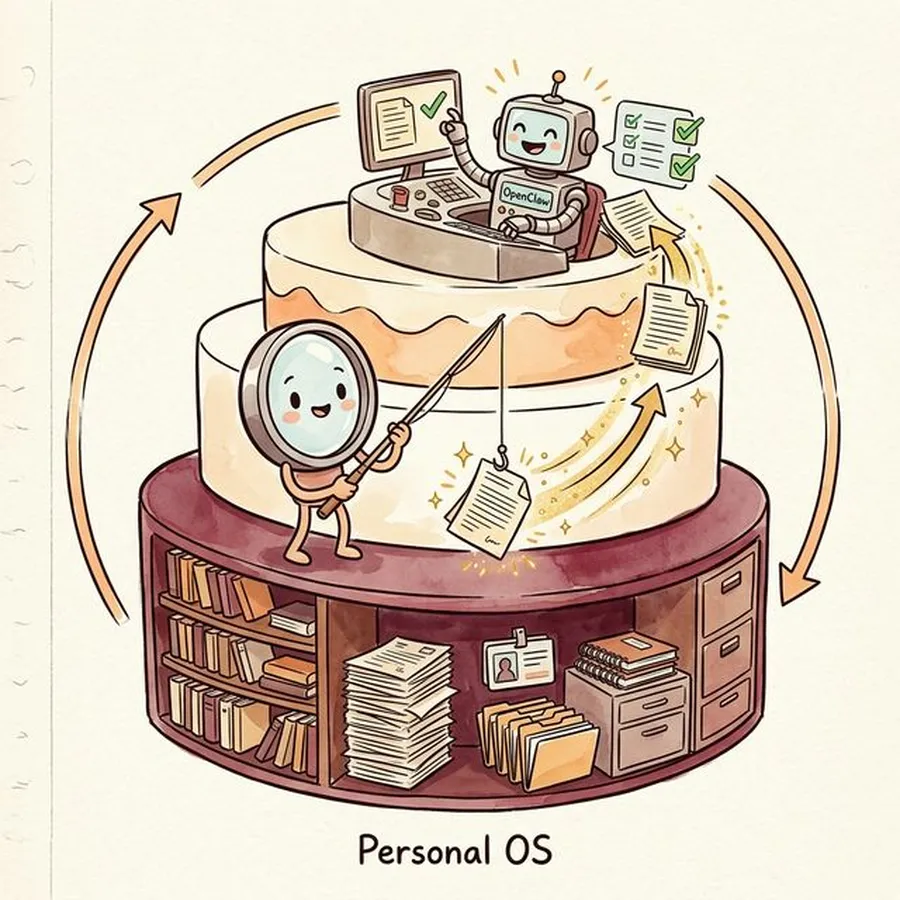

最合理的协作关系应该是这样的:

• 个人 OS(长期真相源):负责定义记忆。

它决定了什么东西值得长期存在(你的身份、项目状态、稳定规则、关键的运行结果)。

• Embedding / Recall(检索层):负责精准打捞。

不让 AI 每次都把海量资料全读一遍,而是按语义,把当前最相关的背景“召回”出来。

• OpenClaw(执行中枢):负责调用记忆。

它在任务现场调取这些上下文,指挥 Agent 干活,然后把有价值的产出,重新写回到你的个人 OS 里。

如果没有个人 OS,OpenClaw 的记忆就像浮萍,缺少稳定的底座;

如果没有 OpenClaw,个人 OS 又很容易退化成一潭死水。

OpenClaw 负责调用,你负责定义。真正高效的永远是分层协作,而不是二选一。

5. 最值钱的不是 Agent,而是“上下文主权”

说到底,OpenClaw 带来的最大震撼,不是让你手机里多了一个好用的 AI 软件。

而是它让你第一次深刻意识到:在 AI 时代,真正值钱的资产不是你拥有多少个 Agent,而是你是否掌握着自己的“长期上下文”。

如果你的记忆、偏好和项目背景永远散落在不同的平台、不同的对话框里,那你得到的永远只是局部的便利。没有一个工具能真正长期地接住你。

而构建个人 OS,就是为了把这件事反过来。

它不是为了去跟大厂的平台抢功能,而是为了把那些真正属于你的东西,从各个平台的“黑箱”里夺回来,放进一个你自己可控、可维护、可迁移的系统里。

当这一步完成,OpenClaw、CLI、IDE 才不再是各自为战的孤岛,而是开始共享同一套底层事实、同一个记忆主权。

到那一刻,你的个人 OS 才算真正成立。

下一步,怎么搭?

这篇文章,我花了大篇幅先讲“为什么”。

因为我发现,很多人卡住不是因为不会用工具,而是还没想明白:在 AI 时代,到底什么东西值得被重建?

我的答案很明确:不是去学更多自动化,不是去堆砌更多笔记,而是先把上下文重建出来。

只有把认知理顺了,下一步的“怎么搭”才有意义。所以,下一篇我会直接进入实操硬核区,把这件事掰开揉碎了讲:

• 个人 OS 到底该怎么分层,才能既适合你看,也适合 Agent 读?

• 身份层、项目层、运行层里到底该放什么?

• 为什么我强烈建议把它放在云端,多设备怎么无缝同步?

• OpenClaw、CLI、IDE 到底怎么共读同一套上下文?

• Embedding 应该在哪一层接入?

如果你这篇看懂了,且正在被“上下文断裂”折磨,想看我继续拆解下一篇的实操结构——

👇 可以在评论区留个【OS】,或者说说你现在用 AI 最大的卡点是什么。我会根据大家的留言反馈,优先爆肝下一篇!

夜雨聆风

夜雨聆风