大家好,我是亮哥。

先说一个让我震惊了很久的数据。

正常跑一个 100B(1000亿参数)的大语言模型,需要什么配置?

答案:至少一块 80GB 显存的 A100 显卡,售价约 15 万元。

但微软开源了一个叫 BitNet 的框架,同一个 100B 模型,用普通 CPU 就能跑,速度每秒 5-7 个词元(token),接近人类阅读速度。

更离谱的是:能耗比传统方式降低 82%,推理速度提升 6 倍。

这不是PPT里的"未来技术",这是今天就能用上的开源项目。

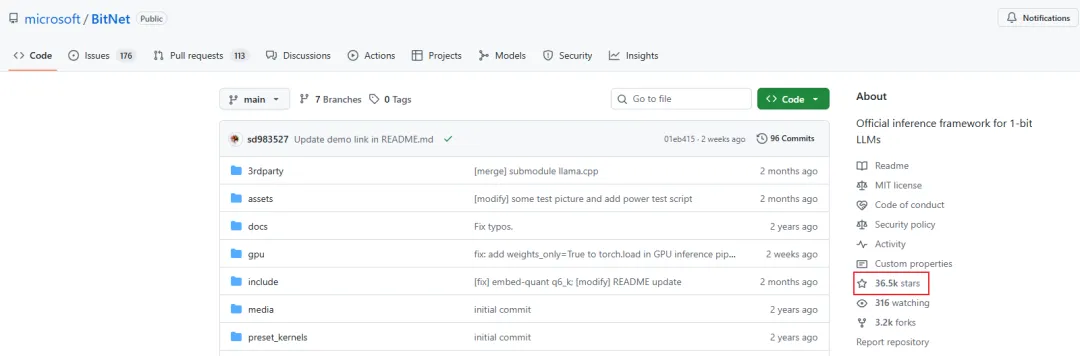

GitHub 上已有 36.5K+ Stars,微软官方背书,2026年最值得关注的开源AI项目之一。

一、BitNet到底是什么?

BitNet 是微软研究院开源的 1-bit 大语言模型推理框架,核心突破是把模型参数从传统的 16 位浮点数(FP16)压缩到 1.58 位(ternary,三元)。

通俗理解:以前模型里每个参数都要占 2 个字节,现在只需要不到 0.2 个字节。体积缩小 10 倍,但能力几乎不变。

这带来了三个本质变化:

不需要 GPU:普通 CPU 就能跑,笔记本也能跑 内存占用极低:100B 模型从需要 160GB+ 显存,变成需要 40GB 内存 能耗大幅下降:数据中心成本大幅降低

二、系统要求:你的电脑能跑吗?

BitNet.cpp(推荐新手,最简单)

| 4GB+ | ||

| 10GB+ 可用空间 | 50GB+ | |

| 不需要 |

FMA 指令集检测方法:

Intel CPU:2013 年之后的大多数 Intel 处理器均支持(Haswell 及更新) AMD CPU:大部分支持 Mac M系列芯片:原生支持,效果最好

可选:BitCluster(分布式,多卡加速)

如果你有多张显卡或者多台机器,可以组成分布式推理集群,适合企业场景。

三、安装教程:三种方案任选

方案一:pip 一键安装(最简单,推荐新手)

第一步:安装 Python 环境

确保你装了 Python 3.10 或以上:

python --version# 如果没有安装,去 python.org 下载安装第二步:一键安装 BitNet.cpp

pip install bitnetcpp# 验证安装python -c "import bitnet; print('安装成功!')"第三步:下载模型权重

BitNet 官方提供预训练好的模型,前往 Hugging Face 下载:

https://huggingface.co/groups/microsoft/bitnet推荐从最小的模型开始测试:

| bitnet-b1.58-2B-4T | |||

| bitnet-b1.58-7B-4T | |||

| bitnet-b1.58-70B-4T | |||

| bitnet-b1.58-100B-4T |

以 7B 模型为例:

# 创建模型目录mkdir bitnet_models && cd bitnet_models# 用 huggingface-cli 下载(需要安装)pip install huggingface_hubhuggingface-cli download microsoft/bitnet-b1.58-7B-4T第四步:运行你的第一个对话

from bitnet import BitNet# 加载模型(首次运行需要下载模型权重)model = BitNet("microsoft/bitnet-b1.58-7B-4T")# 开始对话response = model.generate("用一句话解释什么是大语言模型")print(response)方案二:Ollama 集成安装(进阶用户,推荐)

如果你已经在用 Ollama(最流行的本地大模型运行工具),可以直接用 Ollama 跑 BitNet:

第一步:安装 Ollama

macOS/Linux:

curl -fsSL https://ollama.com/install.sh | shWindows:去 ollama.com 下载安装包

第二步:运行 BitNet 模型

# 运行 7B 模型(Ollama 自动下载)ollama run bitnet:7b# 如果想跑 3B 小模型ollama run bitnet:3b进入交互式对话界面,直接输入问题即可。

第三步(可选):Ollama 开放 API

Ollama 启动后自动开启本地 API 服务:

http://localhost:11434可以在其他应用里调用:

import requestsresponse = requests.post("http://localhost:11434/api/generate", json={"model": "bitnet:7b","prompt": "用Python写一个快速排序算法","stream": False})print(response.json()["response"])方案三:源码编译安装(开发者,高级玩法)

第一步:安装依赖

Ubuntu/Debian:

sudo apt updatesudo apt install build-essential cmake gitmacOS:

brew install cmake git第二步:克隆源码并编译

git clone https://github.com/microsoft/bitnet.cpp.gitcd bitnet.cppmkdir build && cd buildcmake ..cmake --build . --config Release编译完成后,可执行文件在 build/bin/ 目录下。

第三步:下载模型并运行

# 进入工具目录cd build/bin# 下载量化好的模型(以1.58-7B为例)./download-model.sh microsoft/bitnet-b1.58-7B-4T# 运行对话./bitnetserve -m models/bitnet-b1.58-7B-q4k.gguf四、性能实测对比:BitNet到底有多强?

我找到了第三方实测数据:

推理速度对比(tokens/秒)

| 5-7 tokens/s | 无需GPU |

内存占用对比

| 3.9GB | 72% | ||

| 40GB | 71% | ||

| 65GB | 67% |

能耗对比(推理1000个token)

| 约¥1.5/千次 | ||

| 约¥0.27/千次 |

五、新手常见问题避坑

Q1:运行报错 "FMA instruction set not found"→ 你的 CPU 太老了,更换 CPU 或换一台设备

Q2:第一次加载模型特别慢→ 正常现象,7B 模型首次加载约需 1-3 分钟(取决于磁盘速度),之后有缓存会快很多

Q3:输出有乱码/回答质量差→ 检查模型权重是否下载完整,重新下载;或者尝试换更大的模型

Q4:内存不够怎么办?→ 在代码中设置 model = BitNet("microsoft/bitnet-b1.58-7B-4T", n_ctx=2048) 限制上下文长度,降低内存占用

Q5:Mac M芯片体验如何?→ 体验极佳,M系列芯片的神经网络引擎对 BitNet 有额外加速,实测比 Intel/AMD 同等配置快 30-50%

六、BitNet能做什么?实用场景举例

| 本地文档助手 | |

| 编程辅助 | |

| 隐私场景 | |

| 学生/研究者 | |

| 企业降本 |

七、一句话总结

BitNet 的意义,不只是"让你的电脑跑大模型"。

它的真正价值是:**把大模型从"云端贵族"变成了"本地百姓"**。

隐私数据不用上传了,断网也能用,硬件成本从15万变成了一台普通电脑。

安装过程中遇到任何问题,把错误信息截图发给我,我来帮你排查。

微信改版后,如果不把公众号设为【星标 ⭐】,我们很可能就会在庞大的信息流里彻底走散。 如果今天这篇文章戳中了你,请点击右上角 **...** ,将本号设为星标。在这个技术颠覆一切的时代,让我替你挡住无效信息的噪音,我们一起进化。

夜雨聆风

夜雨聆风