有时候,理解一个项目最好的方式,不是多看十篇介绍,也不是多刷几十条 issue。

而是——自己动手,再造一个 https://github.com/openpup/openpup。

我最近就干了这么一件听起来有点“离谱”、但实际非常有效的事:为了真正搞懂 OpenClaw,我甚至反手写了个 OpenPup。

先别急着说我“学不会就自己发明一个”。事情的起因,其实挺朴素的。

我最开始想搞明白的问题是:

OpenClaw 到底是什么?它厉害在哪?它和那些“套个模型做聊天”的 AI 工具有本质区别吗?

结果越看越发现,这问题没法靠“看个 README”就解决。因为 OpenClaw 不是单纯的聊天界面,也不是单纯的 Agent 框架。它背后其实有一套很鲜明的思路:多角色、可路由、可扩展、可接入各种渠道和工具。它想做的,不是“一个会聊天的 AI”,而是“一个能在多个场景里出现、并持续工作的 AI 系统”。

听上去很酷,对吧?

但问题也来了:这种系统,一旦概念多起来,就特别容易陷入一种经典困境——

一、你以为自己懂了,其实只是会复述名词

什么是多 Agent?什么是路由?什么是技能系统?什么是长期记忆?什么是 MCP?什么又叫“主人中心”?

这些词单个拆开都不难懂,但一旦放进一个完整产品里,事情就会开始变得微妙。

比如你会发现:

“多 Agent”到底是几个 Prompt 分工,还是一个真正协作的系统? “长期记忆”到底是把聊天记录存起来,还是能真的理解你、记住你? “本地优先”到底只是把数据库放在本地,还是意味着用户真正拥有自己的 AI 资产? “技能系统”到底是插件市场,还是一套能力编排机制?

更致命的是,你在脑子里“觉得自己理解了”,并不等于你真的能把这个系统讲清楚。

而我恰好很讨厌那种状态。

所以我决定换个办法:既然我想理解 OpenClaw,那我就试着顺着这条思路,自己实现一个更聚焦、更具象的版本。

这个版本,我给它起名叫:OpenPup。

二、为什么是 OpenPup?

名字其实暴露了我的思路。

如果说 OpenClaw 给我的感觉,是一个更偏“外部存在感”的系统——它像一只有爪子的生物,能去各种平台、各种渠道留下痕迹、接住消息、分发任务;那我想做的 OpenPup,更像一只围着主人转的小狗。

区别看起来只是名字不同,实际上是两个完全不同的产品中心:

OpenClaw 关注的是:AI 出现在哪里、接入什么渠道、如何统一路由 OpenPup 关注的是:AI 围绕谁服务、如何长期理解主人、如何在本地持续陪伴

换句话说:

OpenClaw 更像“多平台 AI 网关”,OpenPup 更像“本地桌面 AI 伙伴”。

我后来越写越觉得,这个角度特别适合帮助我反向理解 OpenClaw。因为当你试图设计 OpenPup 时,你就会被迫回答一个非常根本的问题:

一个 AI 系统,到底是围绕“模型能力”构建,还是围绕“用户是谁”构建?

而这,也是我从这次折腾里得到的第一个大收获。

三、真正难的,不是让 AI 回答问题,而是让它记得“你是谁”

我以前总觉得,AI 产品的核心问题是“怎么回答得更聪明”。

后来发现不是。

真正难的问题其实是:

怎么让这个 AI,不只是会回答,而是会长期理解同一个人。

这也是 OpenPup 最核心的一条设计原则:不是问“你想要一个什么样的 AI”,而是问“你是一个什么样的人”。

于是我在 OpenPup 里设了一个非常关键的东西:OWNER.md。

这个文件的意义很简单,也很反直觉——它不是给 AI 的“系统提示词炫技专区”,而是一个明确描述主人的地方。

比如这里面可以写:

你是谁 你做什么工作 你喜欢怎样的表达风格 你讨厌什么样的沟通方式 你有哪些长期目标 你平时是怎么安排事情的

这件事看起来很朴素,但它其实改变了整个系统的重心。

因为一旦有了 OWNER.md,AI 的工作方式就会从:

“收到问题,开始回答”

变成:

“先知道这是在为谁服务,再决定怎么回答、怎么执行”

这就是我突然觉得很多 AI 产品“差口气”的原因。它们大多很会说,却并不真的“认识你”。你每次打开对话框,面对的还是一个失忆的聪明人。

而一个真正有陪伴感、有协作感的系统,应该不是这样。

四、我开始意识到:一个 AI,最好别假装自己什么都会

这是我理解 OpenClaw 时遇到的第二个卡点,也是 OpenPup 设计时最顺手的一部分。

我发现,很多 Agent 产品在叙事上都喜欢强调“万能”。仿佛一个 Agent 应该既能写代码、又能做研究、还能写报告、管日程、顺便给你规划人生。

听起来很厉害。但只要你真的开始设计系统,就会发现:万能,往往意味着模糊。

于是 OpenPup 里我干脆不装了,直接搞“分工制”。

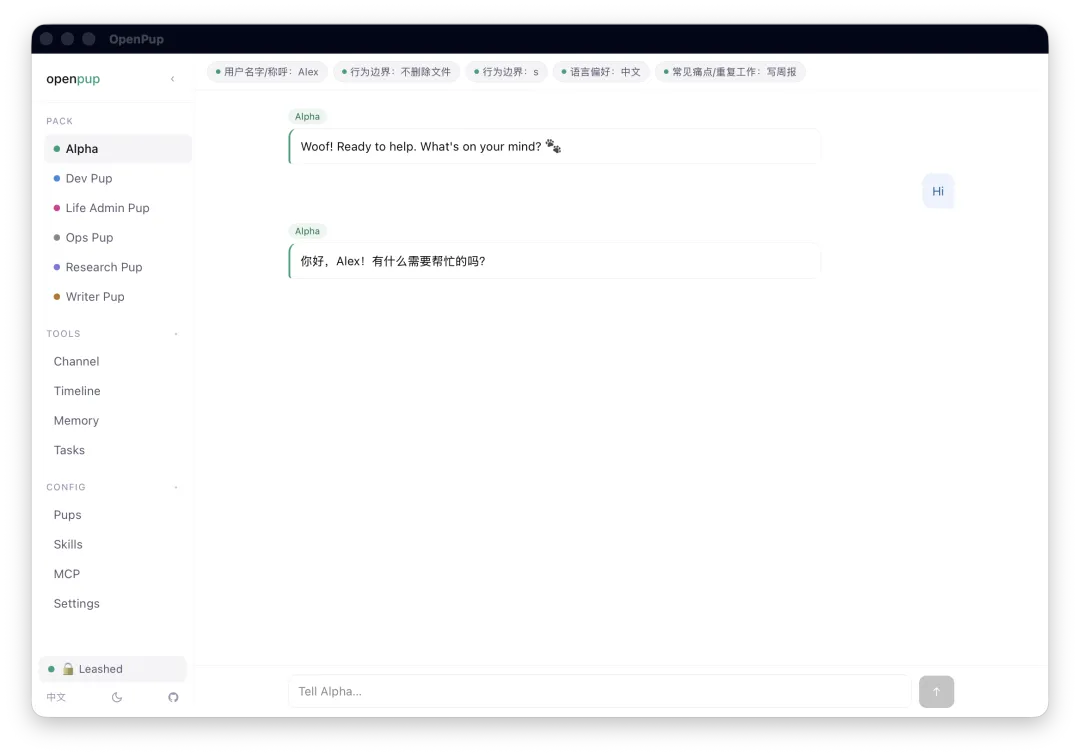

我给它拆成了几只 Pup:

Alpha Pup:总协调,负责判断问题该交给谁 Dev Pup:写代码、查 bug、做工程活 Writer Pup:写文章、写邮件、写报告 Research Pup:收集资料、做摘要、整理分析 Ops Pup:偏部署、基础设施、DevOps Life Admin Pup:处理日程、规划、个人事务

这样一拆,很多事一下就清楚了。

以前你会纠结:“这个 Agent 为什么说话一会儿像程序员,一会儿像秘书,一会儿像文案?”现在不会了,因为每个角色天然有边界。

更重要的是,Alpha 不再需要自己什么都干。它真正做的是:

理解用户意图 判断要不要路由 决定交给哪个 Specialist Pup 最后把结果组织好再给用户

这一下,我对 OpenClaw 里“多角色路由”这件事也理解得更深了。

它不是为了炫架构图。而是因为当任务复杂到一定程度,“让一个 AI 假装自己无所不能”反而是不自然的。

真正自然的方式,是像一个团队一样工作。

五、写着写着,我发现“本地优先”不是技术偏好,而是产品价值观

再往下做,我碰到第三个非常关键的问题:这些记忆、偏好、规则、技能,到底放哪?

如果你只是做一个云端聊天产品,那这个问题很简单:全丢服务器里,用户也别管。

但如果你真的想让 AI 成为一个长期伙伴,这种方式会越来越别扭。

因为你会开始在意:

我的记忆是不是我能看见? 我的偏好是不是我能修改? 我的数据能不能备份? 这个 AI 懂我的方式,到底是不是一个黑箱?

于是 OpenPup 走向了一个我越来越认同的方向:本地优先。

也就是说,很多关键资产都放在本地工作区里,比如:

OWNER.mdPUPS.mdRULES.md记忆文件 数据库 技能配置 工作日志

它们不是云端神秘抽象物,而是真实存在于你的机器上的东西。

这意味着什么?

意味着 AI 不再只是“一个在线服务”,而更像是:

一个你拥有、你能审计、你能改造的个人系统。

这点我越做越上头。因为它让“AI 记得你”这件事,终于不再只是营销文案,而开始变成一种可验证、可编辑、可迁移的能力。

换句话说:

记忆不只是存在 而且你知道它怎么存在

这对于长期使用来说,太重要了。

六、然后我踩进了 Agent 世界最真实的坑:记忆不是“存了”就算有

说实话,一开始我也天真过。

我原本以为,所谓长期记忆,无非就是:

把聊天记录存起来 定期总结一下 做个向量检索 完事

后来发现,这事根本没这么简单。

因为真正的问题不是“怎么存”,而是:

什么值得记? 怎么避免反复记同一件事? 怎么在需要的时候把对的记忆捞出来? 怎么避免上下文越堆越脏?

这时候我才意识到,长期记忆系统如果做不好,很容易变成“高级垃圾堆”。

于是 OpenPup 的思路变成了两层:

1. 文件层:让人能看懂、能编辑

比如 OWNER.md、规则文件、记忆摘要等,都是可见的。

2. 数据层:让机器能检索、能压缩

比如 SQLite、向量索引、会话历史、任务状态这些,交给系统处理。

这套双层结构让我对 OpenClaw 和类似系统的理解也更具体了:真正成熟的 Agent 系统,不会把“记忆”当成一个单点功能,而会把它当作整个运行机制的一部分。

记忆不是彩蛋。记忆是操作系统层能力。

七、我终于搞懂了:技能系统的重点,不是“能做更多事”,而是“怎么组织能力”

接着是另一个我以前总觉得“听起来明白,实际上很虚”的东西:技能系统。

一开始我对技能的理解非常直男式:

哦,就是插件嘛。

后来写 OpenPup 才发现,这个理解太浅了。

一个真正有用的技能系统,至少得回答这些问题:

技能怎么定义? 技能怎么安装? 技能什么时候触发? 技能能不能串起来执行? 技能有没有权限边界? 技能失败了怎么回滚、怎么记录?

当这些问题冒出来时,你就会意识到,技能系统不是“多几个 prompt 模板”那么简单。它更像是:一套把能力变成可组合执行单元的机制。

所以在 OpenPup 里,我很自然地把技能想成三层:

技能:轻量扩展,快速加能力 MCP:标准化接外部工具 插件:更深层的原生扩展

这一层层拆下来之后,我突然对 OpenClaw 那种强调生态、强调接入、强调路由的价值,理解得特别顺。

因为系统越大,靠“把所有能力都写死在主程序里”越不现实。必须让能力以模块化方式生长。

而模块化能力一旦形成生态,整个项目的性质就变了。

它不再只是一个产品,而开始变成一个平台。

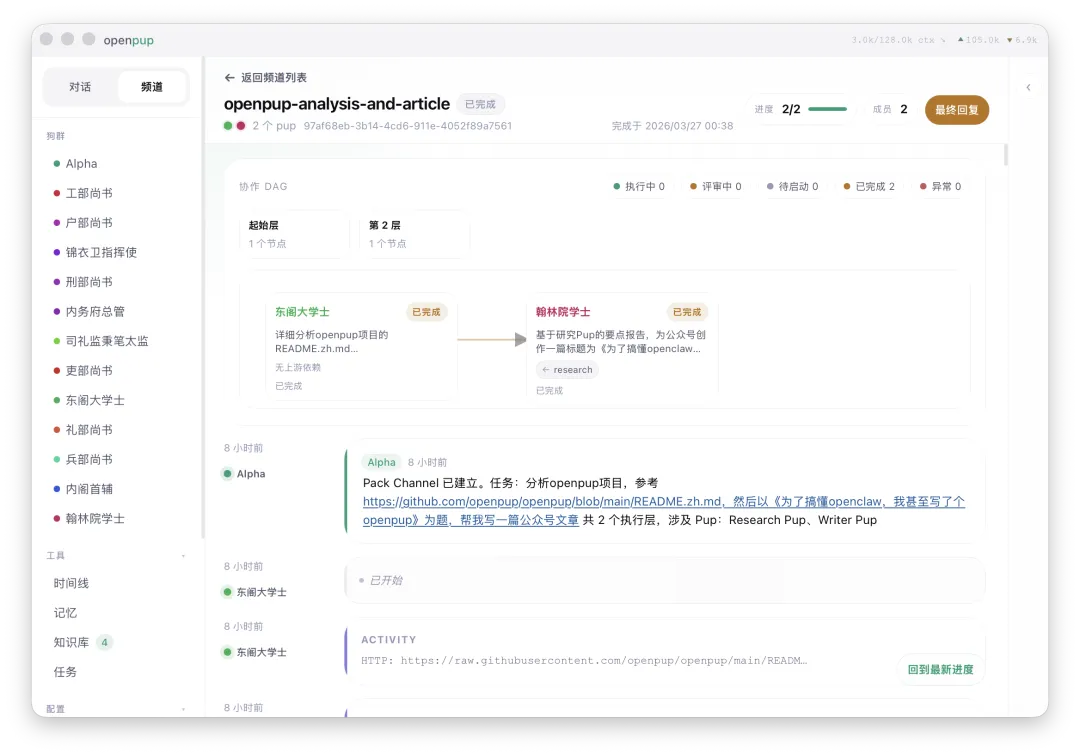

八、从“聊天工具”到“任务系统”,我突然明白 OpenClaw 想走多远

还有一个特别大的认知转折,发生在我设计任务流的时候。

很多人看 AI 助手,还是习惯按“聊天工具”的方式去理解。但只要你认真做几步,就会发现:

真正有价值的,不是“它能答一句漂亮的话”,而是“它能不能把一件事持续推进下去”。

所以 OpenPup 里我特别在意任务状态:

待处理 进行中 完成 失败

别小看这几个状态。它们意味着这个系统的目标,已经不是“回复你”,而是“帮你推进工作”。

到这一步,我对 OpenClaw 的理解也突然立体了。

它有那么多渠道、那么多角色、那么多路由能力,如果只是为了让 AI 在不同地方和你闲聊,那完全不值当。它真正的野心,显然是更大的:

让 AI 不只是一个对话框,而是一个能跨场景持续存在、持续接活、持续协作的系统。

当你从这个角度再回头看它,很多原本零散的功能就串起来了:

为什么要多渠道? 为什么要路由? 为什么要 Agent 分工? 为什么要技能生态? 为什么要记忆? 为什么要任务跟踪?

因为这些东西,本来就不是一个“聊天壳”该有的配置。它们更像是一个 AI 操作系统 的胚胎。

九、那 OpenPup 到底让我学会了什么?

如果非要总结,我觉得最大的收获有四个。

1. 我终于分清了“会聊天”和“会陪伴”的区别

会聊天的 AI 很多。但会陪伴、会持续理解、会围绕你组织能力的 AI,少得多。

这中间差的不是模型参数,而是系统设计。

2. 我终于理解了“多 Agent”不是形式主义

如果设计得好,多角色不是花架子。它本质上是在模拟一种更真实的工作分工方式。

不是一个 AI 假装全能,而是一组 AI 各司其职。

3. 我终于意识到“本地优先”是非常强的价值表达

很多人觉得本地优先只是技术路线。但实际上,它是在说:

你的数据、你的偏好、你的记忆,应该属于你。

这句话一旦成立,很多产品决策都会随之改变。

4. 我终于不再把 OpenClaw 当成“一个工具”

在真正拆解并试着复现其思路之后,我更愿意把 OpenClaw 看成:

一个正在形成中的开源 Agent 生态方向。

它关心的不是单点功能,而是系统协作。不是单次回答,而是长期运行。不是一个入口,而是多个入口背后的统一智能。

十、所以,为什么要“为了搞懂 openclaw,甚至写个 openpup”?

因为有些东西,真的只有你自己动过手,才会明白。

你当然可以一直停留在“我知道这个概念”的层面;也可以收藏十篇文章,转发五条观点,顺便在群里说一句“这个方向挺有意思”。

但如果你真的想理解一个系统,最有效的方法往往不是旁观,而是——

亲手把它最关键的假设重新走一遍。

OpenPup 对我来说,当然不是为了“再做一个 AI 产品”。它更像是一把解剖刀。

借着写它,我把这些问题一个个切开看了:

AI 到底该围绕模型,还是围绕主人? 记忆到底怎么设计才不虚? 多角色到底是噱头,还是必要结构? 本地优先到底意味着什么? 技能、工具、插件到底怎么构成一个生态? 聊天式交互,怎么进化成任务式系统?

而这些问题一旦想透,OpenClaw 就不再神秘了。

你会开始看见它的骨架、它的取舍、它的野心,甚至也会看见它未来可能遇到的挑战:

系统会不会越来越复杂? 多角色协作会不会增加理解成本? 本地优先会不会抬高普通用户门槛? 记忆质量能不能经得起长期使用?

但恰恰是这些挑战,才说明它在试图解决的,是更难、也更值得做的问题。

结语

如果说以前我对 AI 助手的理解,还停留在“更聪明的聊天界面”;那么在折腾 OpenPup 之后,我更愿意相信:

下一代 AI 产品的竞争,不会只发生在回答质量上。它更会发生在这些地方:

它是否真的理解你 它是否能长期记住你 它是否能组织多种能力为你服务 它是否属于你,而不是只是调用你 它是否能从一个工具,慢慢长成一个系统

而 OpenClaw,让我看见了这条路的一种可能。OpenPup,则让我亲手摸到了这条路为什么难、又为什么值得。

所以标题一点也不夸张:

为了搞懂 OpenClaw,我甚至写了个 OpenPup。

而且写完之后,我反而觉得——这可能才是理解一个复杂系统,最省时间的方式。

本文完全出自于 OpenPup :

小彩蛋:

(全文完)

夜雨聆风

夜雨聆风